구글 Gemini, 드디어 AI 경쟁에서 치고 나가나

여러분도 구글의 제품들 많이 사용하시죠? 저도 그렇습니다.

지메일과 Google Docs는 제 일상과 떼놓을래야 뗄 수가 없는 제품들이죠. 제 모든 업무용 이메일 어카운트가 지메일로 만들어져 있기도 해요. 이 도구들은, (우리가 많이 사용해서 그렇기도 하지만) 직관적이고, 믿을 수 있고, 오랫동안 우리들의 일상의 일부가 되어 왔습니다.

하지만, AI의 영역으로 들어와서, Gemini 같은 구글의 대형 AI 모델에 좀 ‘정을 붙여 보려고’ 할 때마다, 뭔가 잘 와닿지가 않았어요. ChatGPT, Claude, Midjourney, 가끔은 Grok까지도 이제 일상적으로, 자연스럽게 손이 가는 도구가 되었다(?)고 할 정도인데, 구글의 AI 제품들은, NotebookLM을 제외하고는 좀 멀게 느껴졌던 게 사실입니다. 최근까지 구글 딥리서치를 쓸 때 꽤 환각 (Hallucination)도 있다고 느끼기도 했구요.

그런데 갑자기, 지난 주부터 Gemini 2.5 Pro가 헤드라인을 채우기 시작했습니다: Chatbot Arena에서 ELO 스코어가 40포인트나 상승했고, Cursor에 Personal API 키를 제공한다는 발표도 있었구요. 주변의 많은 소프트웨어 개발자나 AI 엔지니어들이 Gemini와 Gemma에 대해 많은 긍정적인 이야기를 하는 걸 듣기 시작했어요.

그렇지만, 아직 의심의 눈초리를 거두지 않은 채, 한 번 저희와 자주 이야기를 나누는 시니어 개발자이자 AI 엔지니어, Will Schenk에게 “구글이 AI 게임에서 우위를 되찾고 있다고 생각하는지, 왜 그런지, 과연 Gemma가 진짜 우리 일상의 일부로 들어올 만한 준비가 되고 있는지” 의견을 물어봤습니다. 답을 정리해 보면 이렇습니다:

“기술 (테크) 판에서 소위 말하는 내러티브가 얼마나 빨리 만들어지고 바뀌는지를 보면 재미있어요. 지금 가장 흔한 이야기가 ‘구글이 AI에서 뒤쳐져 있다’는 거죠 - 오픈AI, 앤쓰로픽, 심지어는 선도적인 오픈소스 플레이어조차 구글이 따라잡으려고 노력해야 한다는 거예요. 하지만 실제로 구글의 AI 모델을 면밀하게 살펴보고 사용해 보면, 그런 이야기는 잘 맞지 않는다고 생각해요.

잊지 말아야 할 건, 구글이 바로 GPT-4부터 Claude, 허깅페이스를 빛내고 있는 오픈소스 LLM에 이르기까지 이 모든 것의 바탕이 되는 트랜스포머 아키텍처가 태어난 곳이라는 거예요. 그런데도 대중의 인식은 바뀌었죠, 마치 구글이 후발주자로 따라잡고 있다는 것처럼요.

아마, 그 이유 중 일부는 아무래도 구글이 AI 제품이나 도구를 출시하고 포지셔닝하는데 있어서 비정상적이라고 할 만큼 보수적이었기 때문이겠죠. 사업적으로는 이해가 안 되는 것도 아니구요. 구글이 만든 소비자용 Gemini 앱이 챗GPT만큼 마법같은 기능을 보여주거나 반응이 좋지 않을 수도 있어요. 하지만 바닥에 있는 기본 모델로 들어가면 - 즉, 내 머신에서 Gemma 3를 돌리거나 Gemini 2.5 API를 사용해 보면 - 이야기가 바뀐다고 생각해요.

구글의 이 모델들에는, 절대 무시할 수 없는 ‘타이트한 집중력’ 같은게 느껴져요. 모델 레벨에서 사용해 보면, 제품을 만들 때 했던 의사결정, 가드레일, UI 관련된 것들을 다 들어낸 순수한 실제 엔지니어링의 노력을 느낄 수 있어요. 그리고 Gemini는 빠르고, 진지하고, 정확하다고 느껴요. 마치 고성능 기계를 운전하는 것 같이요. 개인적인 느낌일 수 있지만, 출력 품질은 Claude나 GPT-4 비슷할지 몰라도 지연 시간, 환각의 수준, 더 많은 단어로 더 실제적인 내용을 제공한다고 느껴요.

과연 구글 DeepResearch가 진짜 통찰력있는 연구 보고서를 만들어 줄까요? 그건 잘 모르겠어요. 그렇지만, 뭔가 내가 만들고 싶은 AI 제품의 베이스 모델로 뭔가 사용하고 싶다면, 저는 언제나 Gemini나 Gemma 3에서부터 시작하면 좋은 선택이라고 봐요.

Gemma 3은 특히 인상적이에요. 오픈소스 모델이고, 훨씬 더 큰 모델들도 많지만, 자기보다 훨씬 큰 거인들에게 한 방 날리는 느낌이라고 할까? 같은 수준의 다른 모델들과 비교하면, 화려한 트릭을 사용하지 않고, 그냥 정말 열정적인 엔지니어링을 한, 본질적인 근육질 모델이라는 생각이 들고, 이런 적당한 사이즈의 잘 조정된 모델들이 더 큰 모델들보다 빠르게 미래로 향하고 있지 않나 싶어요.

DeepSeek과 비교해 보자면, 물론 DeepSeek이 아주 훌륭한 모델이지만 Gemini 자체의 매력이 있어요. 똑똑한데 열심히 일하는 친구라는 느낌? Gemini가 이론과 장인정신에 근거를 두고 있다면, DeepSeek은 좋은 결과를 얻기 위해서 해킹을 하는 친구 같아요.

‘멀티모달’ 능력도 빼놓을 수 없죠. Gemini 2.5는 모델이 텍스트 뿐만이 아니라 이미지, 오디오 등 ‘감각적’인 세계를 ‘이해’한다고 느끼는 최초의 모델이예요. 목소리의 음색을 가지고 추론하고, 이미지를 잘 편집해 주고, 그것도 비교적 빠르고 명확하게 작업을 처리해요. 단순히 내 요청에 ‘응답’한다기보다 ‘내 필요를 인식하고 응대’한다는 느낌이예요. 그래서 새로웠구요.

결론적으로, 저는 구글이 뒤쳐져 있다고 생각하지 않아요. 조심스럽게 접근한다고 생각하는 쪽이죠. 모든 장식을 걷어내고 보면, 구글의 모델을 제가 사용해 본 AI 모델들 중 가장 좋아하는 편이예요. 구글이 정말 경쟁을 하겠다고 마음먹고 달리는 순간 - 보수적인 자세를 벗어던지고 말이죠 - 다른 누구도 따라잡기 어려워질 거예요.

지난 4월 5일 구글 딥마인드의 Jack Rae가 X에 포스팅한 걸 보면, 다양한 LLM 모델의 성능과 API 비용을 비교해 본 자료에서 구글의 모델이 모두 가성비가 높은 걸로 나타나네요.

위 그림에서 X축은 ‘Price per million tokens (Log scale)’, Y축은 LMSys Elo 스코어, 무지개 색깔 곡선은 ‘Pareto Frontier 곡선’으로 특정한 성능을 달성해야 할 때의 최저가 모델들을 연결한 겁니다.

조용히 물밑에서 움직이다가, 이제 본격적으로, 검색 시장을 장악했던 것처럼 같은 기술우위 전략으로 치고 나가기 시작하는 하나의 반증일까요?

Will Schenk가 나름대로 여러 선도 모델들이 얼마나 깊은 이해 능력을 가지고 있는지 비교해 본 것도 재미있으니, 관심있으신 분은 한 번 보시면 좋을 것 같습니다.

앤쓰로픽이 탐구하는, 언어 모델의 신경 과학

앤쓰로픽만큼, 거대 언어모델을 한 꺼풀 한 꺼풀 벗겨내면서 이해하기 위한 노력을 계속하는 연구소는, 거의 없지 않나 싶어요. 2024년 5월부터 앤쓰로픽의 ‘Interpretability (해석 가능성)’ 팀은 Claude의 ‘내면 세계’를 매핑하는 작업을 해 왔습니다 - 수백만 개의 뉴런 패턴, 즉 ‘Feature’를 발견하고 이걸 사람이 가지고 있는 개념과 연결하는 기술인 ‘딕셔너리 러닝 (Dictionary Learning)’부터 시작해서요. LLM을 헤집어서 LLM의 ‘뇌’에 대한 대략적인 용어집을 만드는 거라고나 할까요?

2024년 10월까지는, ‘Monosemanticity’에 집중했습니다 - 하나의 뉴런 패턴이 하나의 의미에 1:1로 대응할 수 있다는 생각이죠. 이 작업은 Claude 내부의 복잡하게 얽혀 있는 표현 (Representation)을 우리가 실제로 추론할 수 있는 부분으로 나눠보는데 도움을 줬습니다.

그리고 2025년 3월, ‘On the Biology of a Large Language Model’을 통해서, Attribution Graph (Circuit Tracing 방법론)를 사용해서 Claude 3.5 Haiku가 여러 단계에 걸쳐서 어떻게 추론을 하는지 - 그리고 시를 쓰고, 환자를 진단하고, 미래를 계획하는지 - 추적했습니다. 여기서부터 한 가지 분명한 발견을 했다고 이야기하는데요 - 바로, 이 모델들이 단순히 문장을 완성하는 게 아니라, 일종의 ‘생각’을 구성하고 있다는 겁니다.

Circuit Tracing 방법론으로 분석한, Claude 3.5 Haiku - 앤쓰로픽의 경량 모델 - 가 다양한 작업을 할 때의 과정. Image Credit: 앤쓰로픽

시를 쓴다든가, 환자를 진단한다든가 하는 등의 작업에서 LLM의 어떤 부분이 어떤 과정을 거쳐서 어떻게 작동하는지 재미있는 발견이 많이 있어요. 그 중에 좀 쉬운 것 하나로, ‘Cross-Linguistic Semantic Alignment’ - ‘언어 간 의미론적 정렬’이라고 번역해야 할까요? - 가 있어요. 언어가 다르더라도, 그 처리 과정과 활성화되는 영역은 동일한 내부 회로를 따른다는 건데요. 예를 들어, ‘크다’와 ‘작다’ 같은 반의적인 관계를 인코딩하는 회로가, 영어든, 프랑스어든, 한국어든 다양한 입력 언어에 걸쳐서 동일한 영역에 활성화되는 거죠. 이런 이유로, 언어와 관계없는 불변의 추론, 컨텐츠의 일반화 등이 가능해지는 것이겠죠.

Claude 전체 파라미터 공간의 약 0.1%만 추적한 결과이긴 하지만, 앤쓰로픽의 이런 연구는, AI 모델의 해석 가능성, 모델의 신뢰성과 안전성 등에 큰 시사점이 있을 것 같습니다. AI 모델이 일으킬 수 있는 고위험 행동 (예를 들어, 가짜 뉴스를 만드는 것)에 대한 회로를 식별해 내서, 문제가 있는 출력값에 대한 조기 경보 시스템을 만들거나 더 안전한 모델이 되도록 아키텍처를 재설계할 힌트를 준다거나 할 수 있을 거예요.

근본적으로는, 이런 연구가 계속된다면, 결국은 LLM 모델의 인지 구조를 ‘회로’ 수준에서 관찰하고 조작까지 할 수 있게 되고, AI 모델에 대한 연구의 초점을 ‘결과물’, 즉 출력물에서 ‘프로세스’, 즉 과정으로 옮기는 역할을 할 겁니다. 바로, 인공지능에 대한 해석 가능성 연구의 분수령이 될, AI의 사고 과정에 대한 기계적 이해의 출발점에 우리는 서 있다고 할 수 있을 것 같네요.

트위터 라이브러리 (Twitter Library) 🐦

복잡한 문제를 더 작고, 다루기 쉬운 여러 개의 단계로 나눠서, 각 단계를 논리적으로 해결하면서 최종적인 답을 도출하는 기법, CoT에 대해서 이제 익숙하신 분이 많을 거라고 생각합니다.

그런데, 텍스트가 아닌 이미지, 비디오, 오디오 등 다양한 모달리티의 데이터들을 가지고도 AI 모델의 잠재력을 충분히 발휘할 수 있도록 CoT 기법이 도와줄 수 있을까요?

이번 주 트위터 라이브러리에서는, 멀티모달 CoT (Multimodal Chain-of-Thought) 기법 9가지를 정리해 봤습니다. 대부분 오픈소스네요:

*아직 튜링 포스트 코리아 구독 안 하셨나요? 구독해 주시면 매주 중요한 AI 뉴스를 정리한 다이제스트를 받으실 수 있습니다!

금주의 주목할 만한 업계 동향 📰

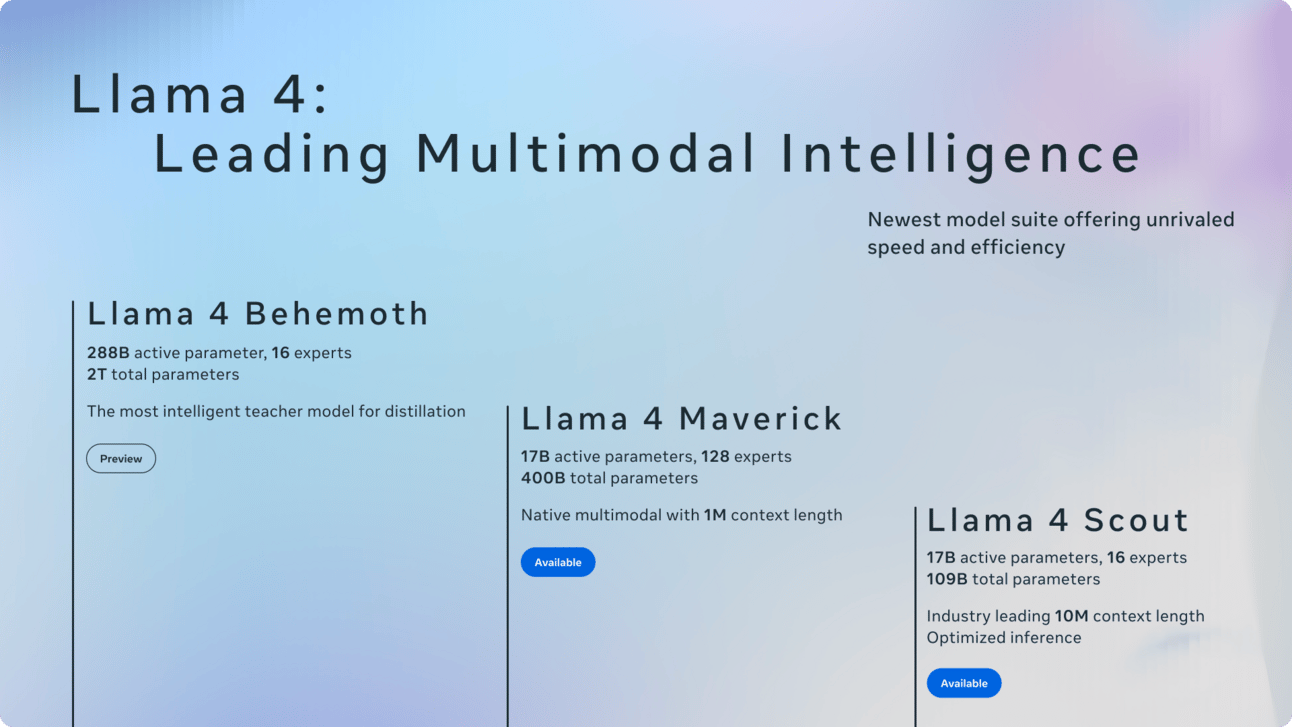

메타, 멀티모달 AI 모델 ‘Llama 4’ 공개

메타가 텍스트·비디오·이미지·오디오 등 멀티모달 데이터를 네이티브로 처리할 수 있는 ‘Llama 4’를 공개했습니다.

사이즈별로 ‘Scout‘, ‘Maverick’, ‘Behemoth’ 등 3가지 제품군으로 구성했는데, 주력 모델 Maverick은 저렴한 비용으로 경쟁사 모델과 유사한 성능을 내도록 했다고 합니다. 100만 토큰 사용 비용이 최대 0.49달러로 오픈AI GPT-4o의 10% 수준입니다. 구글의 Gemini 2.5 Pro보다는 60% 정도 저렴한 수준이구요.

Image Credit: 메타

구글의 Gemini 관련 소식

구글 딥마인드가 Gemini 실용화의 길에 앞장서고 있습니다. 바로 Gemini Robotics 이야기인데요. Gemini 2.0 기반으로 만들어진 이 시스템은, 로봇에 VLA (Vision-Language-Action) 모델을 제공해서 물건을 잡고, 방향을 가리키고, 포장하고, 종이접기까지 할 수 있게 해 줍니다. Zero-shot, Few-shot 학습으로 새로운 작업, 새로운 로봇 몸체에 빠르게 적응할 수 있구요, 재훈련이 필요없습니다. 제대로 된 ‘범용'의, 물리적으로 능숙한 AI를 향한, 조용하지만 대단한 또 한 걸음을 내딛은 것 같습니다.

구글이 Gemini 2.5 Pro Experimental 모델을 무료로 제공합니다. 이전에 월 19.99 달러를 내야 사용해 볼 수 있었는데요, 이 최상위 모델은 이제 파일 업로드, 앱 통합, 새로운 Canvas 도구와 함께 제공됩니다. 아마도 구글이 가진 최고의 AI 모델 - 추론 (Reasoning) 작업과 STEM 영역에서 최고의 성능을 보여주고 있죠 - 을 시장에 퍼뜨리기 위한 작전이기는 할 겁니다. AI의 ‘민주화’라기보다는 ‘Bait-and-Switch’ - 미끼 전략 정도로 생각하면 될 듯합니다 - 전략이겠죠? 아마 시간(과 가격 정책)이 말해줄 겁니다.

오픈AI, OpenAI Academy 런칭, 그리고 새 이미지 생성기 출시

오픈AI, AI에 호기심을 갖고 있는 사람들이 AI와 관련된 능력을 제대로 갖추게끔 만들어진 글로벌 학습 허브를 런칭했습니다. ‘비영리 단체를 위한 AI 입문’, ‘노년층을 위한 AI 입문’ 이런 강좌들이 보이네요. AI 리터러시를 증진하는데 도움이 될 것 같습니다.

오픈AI가 챗GPT에서 바로 사용할 수 있는 새로운 Image Generator를 공개했죠. 아마 아직도 인터넷을 휩쓸고 있는 지브리 스타일 이미지 이야기는 들어보셨을 겁니다. 구글의 Gemini Flash도 Gemini 2.0을 통해서 이미지 생성을 할 수 있지만, 안전 필터가 더 엄격해서 제한되어 있구요. 오픈AI는 샘 알트만부터 해서 지브리 이미지 생성 열풍을 이끌었습니다. 어떤 접근이 더 맞다 아니다를 이야기하고 싶지는 않습니다, 아직은요. 다만, 이 과정에서 수많은 분들이 본인과 가족, 친구들의 사진을 올리시게 될 텐데, 그 이미지들이 오픈AI 모델 훈련에 사용되고 혹시나 나중에 어떤 문제가 생길 수도 있다는 경고를 하는 분들도 있습니다.

지브리 이미지 생성 열풍과 관련해서, 저작권에 대한 생각, 그리고 그걸 넘어서 스스로에게 던져 봤으면 하는 진짜 질문들에 대한 생각을 글로 한 번 정리해 봤습니다. 관심있으신 분은 한 번 봐 주시구요:

여기 모델 시스템 카드를 보실 수 있구요. 그런데, 이미지 생성하시다보면, 왜 아주 오래 전 넷스케이프 브라우저에서 이미지 뜨듯이 ‘위에서부터 아래로’ 인터레이싱 되는 것처럼 보이는게 신기하지 않으셨나요? 살펴보니, 브라우저 프론트엔드의 기능이라는군요:

아, 그리고, 오픈AI가 앤쓰로픽의 MCP (Model Context Protocol)을 채택했다는 소식입니다. 치열하게 경쟁하는 관계이기도 하지만, 대세에 순응해서 공개 프로토콜 계열에 합류하는 모습인지, 일단 따라잡으면서 다시 전세를 역전시킬 기회를 살펴볼지, 흥미진진합니다.

일론 머스크, X와 xAI를 합치다

모든 것을 지배할 하나의 제국으로의 길일까요? 일론 머스크가 자신의 소셜 플랫폼 X를 xAI에 통합했네요. 이 딜은, xAI 스타트업의 가치를 800억 달러, X의 가치를 330억 달러(120억 달러의 부채를 제거한 후)로 평가하는 전액 주식 거래로, 전략적인 순환 고리의 완성입니다 – AI 모델은 훈련 데이터를 얻고, 사용자들은 AI 네이티브 놀이터를 얻는다면, 머스크는 둘 다에 대한 더 강력한한 통제권을 얻게 되네요.

튜링 포스트 코리아팀이 읽고 있는 것들

디지털 크리에이터이자 Arkabrik의 CD이신 Joshua Cho님이 ‘슬기로운 챗GPT 이미지 활용 사례’를 만들어서 공유해 주셨습니다. 한 번 들어가서 관심있는 것들 있는지 보시고, 직접 활용도 해 보시면 재미있을 것 같습니다.

Image Credit: 페이스북, Joshua Cho

When to use and when not to use fine-tuning by Andrew Ng

‘소형 모델의 파인튜닝’이라는 맥락에서, 언제 파인튜닝을 하는게 좋은지, 아니면 프롬프트 엔지니어링이나 에이전틱 워크플로우 등의 더 단순한 구조와 방법으로 접근하는게 좋은지, 앤드류 응이 의견을 공유한 글입니다.

새로 나온, 주목할 만한 연구 논문

금주 이 섹션은 한 주 쉬어가겠습니다!

읽어주셔서 감사합니다. 프리미엄 구독자가 되어주시면 튜링 포스트 코리아의 제작에 큰 도움이 됩니다!