페드로 도밍고스의 ‘마스터 알고리즘’

튜링포스트 팀의 머신러닝 여정에 큰 영향을 준 책 중에 하나로, 워싱턴대 교수인 페드로 도밍고스(Pedro Domingos)가 2015년에 쓴 《마스터 알고리즘(Master Algorithm)》이라는 책이 있습니다.

페드로 도밍고스 교수, 그리고 그의 저서

혹시 트위터에서 페드로 도밍고스를 팔로우하는 분이 계시다면, 별로 이 분을 좋아하지 않을 수도 있어요 - 아주 도발적이기로 유명하고, 다른 사람의 기분을 상하게 하는 것에 전혀 신경을 쓰지 않는 스타일이거든요 ^.^

최근 튜링포스트의 크세니아가, IA Summit에 다녀왔습니다. IA Summmit은, AI에 집중하는 선도적인 벤처캐피탈 중 하나인 Madrona Ventures가 주최하는 서밋입니다. 그런데 거기서 페드로 도밍고스를 만났답니다. 역시 날카로운 질문을 연사들에게 던지고 있었다는데요.

“혹시 면박을 받을지도 모르겠다”는 생각이 들었지만, 호기심 때문에 결국 크세니아가 페드로에게 “옆에 앉아도 되겠느냐”고 물었고, 생각보다 아주 좋은 대화를 나눴다고 합니다. 추론 기계(Reasoning Machine), 강화학습 등에 대해 의견을 나눴고, 물론 그의 책을 읽은 이후에 계속 우리 모두가 기다려온, ‘마스터 알고리즘’을 만들고 있는지 물어봤다고 해요.

페드로 도밍고스는, “이게 바로 마스터 알고리즘에 가장 근접한 내용을 담고 있다”고 생각한다는 논문, Tensor Logic이 지난 주에 조용히 세상에 공개되었는데 혹시 알고 있느냐고 물어봤다고 합니다. 사람들의 관심을 크게 받지 못하고 있는데, 정말 주목해야 할 논문이라고 생각한다면서 말이죠.

텐서 로직 논문과 초록

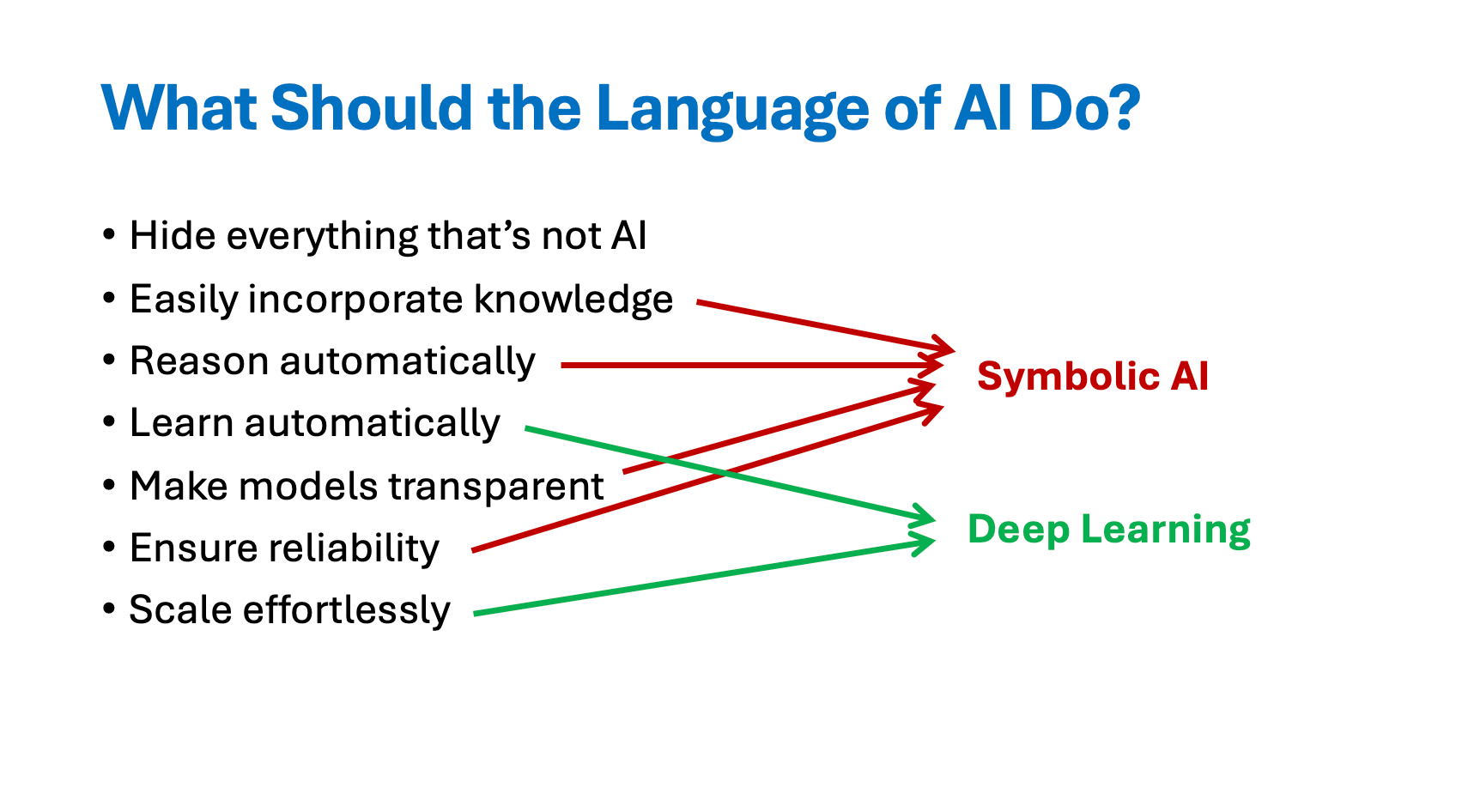

제목으로만 봐서는 어떤 내용일지 감이 잘 안 올 수도 있지만, 이 ‘Tensor Logic’ 논문은 페드로 도밍고스가 지난 10년간 약속해 온 것을 실현하려는 진지한 시도라고 할 수 있습니다 - 바로, ‘AI를 위한 공통의 언어’를 찾으려는 거예요.

페드로의 주장은, 단순하면서도 꽤나 혁명적으로 들리는데요: 신경망, 기호 논리, 확률적 추론, 이 모든 게 서로 다른 분야가 아니라, 단지 표기법이 다른, 같은 연산이라는 거예요. 페드로는, 논리 규칙이 텐서에 대한 아인슈타인 합으로 표현될 수 있다는 걸 보여주면서, 그런 관점에서 보면 트랜스포머부터 Prolog 프로그램, 베이지안 네트워크까지 모두 하나의 기본 요소인 ‘텐서 방정식’으로 만들어질 수 있다고 이야기합니다.

이게 이론적인 이야기로 들릴 수는 있지만, 사실 그렇지 않습니다. 페드로는 ‘AI를 위한 새로운 프로그래밍 언어’를 제안하고 있어요 - 곧 깃허브 저장소를 공개하겠다고도 했습니다. 학습과 추론을 같은 대수학으로 표현하고, GPU 위에서 직접 실행되는 언어를 생각해 보세요. Tensor Logic에서는, 신경망 계층, 논리 규칙, 확률적인 추론의 단계가 모두 같은 구조로 컴파일됩니다. 파이썬 스캐폴딩도, 기호와 신경망 구성 요소를 연결하기 위한 코드도 필요없습니다, 그냥 방정식 하나로 이 모든 게 해결됩니다. 수학적으로도 우아하고, 말 그대로 차세대 AI 인프라의 기반이 될 만한 잠재력을 가지고 있다고 할 수 있습니다.

Image credit: Slides on Tensor-logic.org

‘말 잘하는 흉내’와 ‘진짜 추론’의 사이: Tensor Logic이 여는 새로운 길

가장 흥미로운 부분은, 페드로가 ‘임베딩 공간에서의 추론’이라고 부르는 개념입니다.

임베딩 공간에서의 추론이라는게 지금 중요한 이유는, AI 모델의 ‘추론’ 문제에서 현재 막혀 있는 지점, 그 지점을 바로 건드려주기 때문이겠죠. Tensor Logic에서는, 사실과 규칙 등이 벡터 임베딩 안에 존재하게 됩니다. ‘Temperature’가 낮을 때는, 시스템은 순수한 ‘논리’를 기반으로 해서 작동하게 되니까, 증명할 수 있고, 결정론적이고, 환각 현상도 없는 모습을 보여줍니다. 그런데 ‘Temperature’가 올라가면, 추론의 성격이 변화하죠 - 비슷한 개념들이 서로 연계되면서 추론을 하게 됩니다.

이런, ‘논리에서 유추로 이어지는 연속체(Logic-to-Analogy)’라는 개념이 바로 기호 추론의 신뢰성과 거대 언어모델의 패턴 인식으로부터 오는 한계 사이의 갭을 메울 수 있다고 생각합니다.

그리고 그 지점이, 바로 이 Tensor Logic 논문이 주목을 받는 이유 중 하나일 겁니다.

현재의 LLM은 ‘아주 기가 막히게 말을 잘 하는 흉내쟁이’지만 ‘추론에 있어서는 서투른 친구’입니다. 형식적인 진리의 체계는 없는 상태에서 텍스트를 생성하니까 어찌보면 당연한 거겠죠. Tensor Logic은, 이런 AI에게 ‘체계를 구성하는 방법’을 제시합니다. 단순한 확률적 패턴을 완성하는게 아니라, 추론을 위한 수학적 기반까지 함께 주는 거죠.

자, 그렇다면, Tensor Logic이 ‘물리학에서의 미적분과 같은 역할’을 AI에 대해서 해 낼 수 있을까요? 아직은 두고 봐야 하지만, 분명히 관심을 가지고 살펴볼 가치는 있다고 생각합니다.

*아직 튜링 포스트 코리아 구독 안 하셨나요? 구독해 주시면 매주 중요한 AI 뉴스를 정리한 다이제스트를 받으실 수 있습니다!

트위터 라이브러리 (Twitter Library) 🐦

2025년 현재 전개되고 있는 AI 학계와 업계의 다면적인 변화와 흐름을 이해하고, 앞으로의 발전 방향에 대해서 생각해 보고 싶으시다면, 아래의 다섯 가지 ‘전설적인 강연과 키노트’를 꼭 한 번 살펴보시고 주위의 연구자들, 개발자들, 또 AI 사업가들과 이야기를 나눠보시기 바랍니다:

금주의 주목할 만한 업계 동향 📰

허깅페이스, 옴니 챗(Omni Chat) 출시

초기 버전의 HF 챗은 솔직히 좀 실망스러웄지만, 디자인과 기능을 완전히 개편해서 각 프롬프트에 가장 적합한 오픈소스 모델을 똑똑하게 선택해주는 강력한 라우터로 탈바꿈시킨 옴니 챗을 출시했습니다. 새 버전은 보기에도 훌륭하고 성능도 인상적이네요.

앤쓰로픽, 에이전트 스킬(Agent Skills) 선보여

엑셀 작업이나 브랜드 가이드라인 준수 같은 특정 작업을 하기 위해서 클로드의 능력을 향상시키는 모듈화된 방법으로 ‘스킬(Skills)’을 출시했습니다.. 스킬은 코드, 리소스, 가이드가 함께 담긴, 가볍고 이식 가능한 폴더인데, 클로드가 필요할 때만 불러옵니다. 이제 개발자들이 클로드 앱, API, 클로드 코드 등의 다양한 도구에서 맞춤형 스킬을 만들고 관리할 수 있는데요. AI 워크플로우에 더 많은 구조와 정확성을 가져다줄 것으로 생각되고, 어쩌면 MCP보다 더 큰 변화일 수도 있다는 사이먼 윌리슨의 블로그도 한 번 살펴보시면 좋겠습니다.

튜링 포스트 코리아팀이 읽고 있는 것들

이 대담에서, 젠슨 황이 미국 정부의 대중 반도체 수출 규제를 비판합니다. 엔비디아는 한때 중국 AI 칩 시장의 95%를 장악했지만, 미국의 첨단 칩 수출 제한 정책으로 시장 점유율이 0%로 떨어졌습니다. 그는 "이런 정책이 미국에 이익이 되는가?"라고 반문하면서, 결과적으로 중국은 자체 칩을 개발하게 됐고 미국 기업만 거대한 시장을 잃었다고 지적합니다.

“How China Built a Parallel AI Chip Universe in 18 Months” by AI Supremacy

위 유튜브 영상과 연결되는 내용인데, 2022년 10월 미국이 중국에 첨단 반도체 및 AI 칩 수출 규제를 시행한 지 3년이 지난 지금, 이 제재는 오히려 중국이 자체 반도체 공급망과 AI 칩 스타트업을 빠르게 육성하는 촉매제가 되었습니다. 엔비디아 CEO 젠슨 황은 2025년 10월 "우리는 95% 시장 점유율에서 0%로 떨어졌다"며 미국 정책을 비판하고 있습니다. 중국 기술 기업들은 이제 수직 통합 전략을 택해서 AI 칩부터 클라우드 서비스까지 전체 스택을 자체 구축하고 있고, 화웨이의 어센드, 바이두의 쿤룬 등 특정 워크로드에 최적화된 AI 칩들이 실제 성과를 내고 있습니다. 경제적 논리가 가능성을 열었고, 지정학적 압박이 실험을 할 수 밖에 없는 환경을 만들었고, 중국이 가진 전략적 이점이 이제 그런 상황, 그런 방향으로의 변화를 강화시키고 있습니다.

Ringing Black Hole Confirms Einstein and Hawking’s Predictions by Simons Foundation

LIGO 중력파 관측소가 두 개의 블랙홀이 충돌하는 모습을 관측하면서 아인슈타인과 스티븐 호킹의 수십 년 전 예측을 확인했습니다. 10년 전 첫 관측 이후 개선된 장비로 블랙홀이 질량과 회전이라는 단 두 가지 특성만으로 설명되는 단순한 객체라는 로이 커의 방정식을 검증했고, 블랙홀의 ‘사건의 지평선’ 크기는 오직 증가하기만 한다는 호킹의 면적 정리도 확인했습니다. 충돌 후 블랙홀이 안정되는 과정에서 나오는 미세한 '울림'을 포착해서, 블랙홀의 본질과 시공간의 근본적 속성에 대한 가장 명확한 증거를 얻어냈습니다. 이번 발견은 양자물리학과 일반상대성이론을 연결하는 단서를 제공하는데, 향후 10년간 디텍터가 10배 이상 더 민감해지게 된다면 더 정밀한 검증이 가능하겠죠?

새로 나온, 주목할 만한 연구 논문

금주에는 ‘주목할 만한 최신의 AI 모델’ 3가지를 소개하겠습니다!

주목할 만한 최신 AI 모델

DeepSeek-OCR: Contexts Optical Compression

DeepSeek AI의 연구진이 문서를 이해(Document Understanding)해서 LLM에 효율적으로 통합하도록 설계된 비전-텍스트 모델, DeepSeek-OCR을 공개했습니다.

‘Contexts Optical Compression’ 기술을 도입했는데, 512×512부터 1280×1280까지 다양한 해상도를 지원합니다. 마크다운 변환, 레이아웃 파싱, OCR, 시각적 그라운딩을 프롬프트로 실행할 수 있구요. A100-40G GPU에서 초당 약 2,500토큰의 속도로 작동하고, vLLM과 Transformers를 모두 지원합니다. 효율적으로 시각 토큰을 압축할 수 있다는 점을 강조하는데, 플래시 어텐션 2.0으로 가속화를 지원하기도 합니다. MIT 라이선스로 오픈소스로 공개되었고, 다양한 시각적인 레이아웃 형태에서 OCR이 많이 필요한 작업에 최적화되어 있습니다. —> [깃허브 저장소]

Fantastic (small) retrievers and how to train them: Mxbai-edge-colbert-v0 tech report

Mixedbread AI와 와세다 대학의 연구진이 함께 17M, 32M 파라미터를 가진 두 개의 ‘지연 상호작용(Late-Interaction)’ ColBERT 모델인 mxbai-edge-colbert-v0를 내놨습니다. 낮은 임베딩 차원(48/64)에도 불구하고 BEIR에서 ColBERTv2의 성능을 능가하는 모습을 보여줍니다. ModernBERT 백본, 다단계 훈련(대조 사전 훈련, 미세 조정, 증류), 최적화된 절제 연구를 활용한 17M 모델은 32k 컨텍스트를 지원하고, CPU에서도 효율적으로 실행되고, 벡터를 2.5배 적은 메모리로 저장한다고 합니다. NanoBEIR에서 0.6405 NDCG@10을 달성했습니다. —> [논문 보기]

Qwen3Guard Technical Report

Qwen 연구진이 119개 언어를 지원하는 다국어 안전 조정(Safety Moderation) 모델 Qwen3Guard를 소개했습니다. 0.6B, 4B, 8B 크기로 제공되는 이 모델은, 3단계 안전 분류(안전, 논란의 여지 있음, 안전하지 않음)를 위한 Generative Qwen3Guard와 토큰 수준에서의 실시간 조정을 위한 Stream Qwen3Guard를 포함합니다. Qwen3Guard-Gen은 14개 영어 벤치마크 중 8개에서 최고의 F1 점수를 달성했고, 다국어 작업에서 더 큰 모델을 능가하고, 응답 거부 감지를 지원합니다. Stream Qwen3Guard는 약 2포인트의 성능이 저하될 뿐, 거의 실시간에 가까운 지연 시간을 보여주면서 효율적인 스트리밍 시의 안전 관련 개입을 할 수 있게 해 줍니다. —> [논문 보기]

A2fm: An Adaptive Agent Foundation Model for Tool-Aware Hybrid Reasoning

OPPO의 연구진이 세 가지 실행 모드(도구 사용 에이전트, 추론 체인, 즉각 응답)를 통합한 32B 모델 A2FM을 개발했습니다. ‘경로 지정 후 정렬(Route-then-Align)’ 전략을 사용하고 효율성-정확성 간의 트레이드오프를 판단해서 실행하기 위한 적응형 정책 최적화(APO) 기법을 도입했습니다. A2FM은 BrowseComp에서 13.4%, AIME25에서 70.4%, HLE에서 16.7%를 달성했고, 비용 효율성 측면에서는 32B 동급 모델을 능가하는 모습을 보여주면서 정답 당 $0.00487로 추론 모드 대비 비용을 45.2% 절감했습니다. 에이전트, 추론, 일반 벤치마크 전반에서 최상위권을 차지하는 모습을 보여줍니다. —> [논문 보기]

읽어주셔서 감사합니다. 프리미엄 구독자가 되어주시면 튜링 포스트 코리아의 제작에 큰 도움이 됩니다!