‘피지컬 AI’를 향한 삼자회동, 그리고 NVIDIA GTC

젠슨 황·이재용·정의선, 서울 삼성역 근처에서 치맥하는 모습

지난 주 최고의 화제는, 특히 우리 입장에서는 누가 뭐래도 엔비디아 CEO 젠슨 황, 삼성전자 이재용 회장, 현대자동차 정의선 회장의 ‘치맥 삼자회동’ 이겠죠? 결국, 이 삼자회동이 상징하는 바는 ‘피지컬 AI를 향한 협력 의지’가 아닐까 생각합니다.

이 ‘사진’에 살짝 묻힌 느낌이 있지만, 지난 10월 말에 열렸던 엔비디아의 정기행사 NVIDIA GTC 2025에 대해 이야기를 좀 해 볼께요.

올해 튜링포스트 팀은 젠슨 황의 기조연설을 두 번 들었는데요: 첫 번째는 1월에 있었던 CES에서, 두 번째는 이번 GTC 2025에서였습니다. 재미있는 건, 두 번째인 이번 기조연설에서는, 첫 번째와 비교해서 그 서사(敍事)가 완전히 달라져 있었다는 건데요.

이번 연설은, 현재 미국 행정부에 대한 찬사로 가득했고, ‘미국에 시설을 구축하고(Build in America)’, ‘미국에서 제조하고(Made in America)’, 결국 ‘미국을 다시 위대하게 만들자(Make America Great Again)’는 캐치프레이즈로 뒤덮여 있었습니다. 원래 참석 예정이었다고 하는 도널드 트럼프 대통령이 거기 있었다면 아마 얼굴에 웃음이 가득했지 않을까 생각이 들 정도로요. 한 마디로, 아주 거대한, 잘 포장된 정치적 퍼포먼스였다고나 할까요? (꼭 부정적인 의미는 아니지만요)

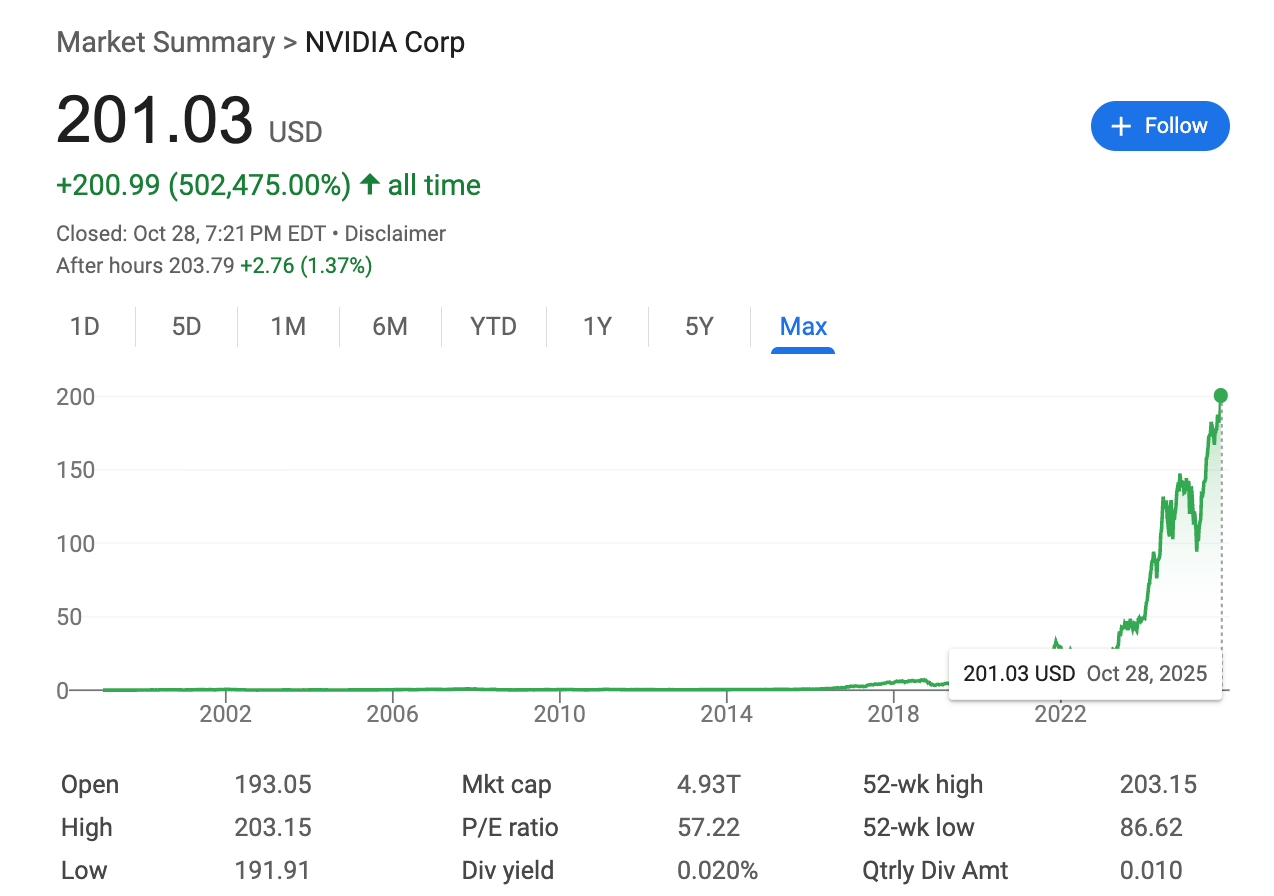

엔비디아가 실리콘밸리의 기업이라기보다는 마치 미국의 국가대표라는 정체성을 가진 회사인 것처럼 들리는 표현이 곳곳에 가득했고, ‘혁신(Innovation)’과 ‘스케일(Scale)’에 중심을 두던 내러티브와 톤(Tone)이, 주권, 국가 권력, 에너지 경쟁 등의 용어로 대체되었습니다. 시장은 이 변화에 반응해서, 주가가 9%도 넘게 올랐죠.

트럼프와의 우호 관계가 엔비디아에 열어주는 사업기회, 그야말로 엄청나겠죠. 사실 트럼프 대통령이 워싱턴 DC에서 열린 NVIDIA GTC 2025에 참석하지 못한 이유가 바로 일본, 그리고 한국 방문 때문이었을 텐데, 이 협상을 위한 해외 순방에 젠슨 황이 계속해서 함께 다니게끔 하고 싶어했다고 합니다 - 바로, 무엇보다, 중국과의 협상 때문이겠죠. 얼마 전에 젠슨 황이 ‘엔비디아의 중국 시장 점유율이 0으로 떨어졌다’는 이야기를 한 적도 있는데, 중국을 차단했던 정부의 수출 통제 정책이 가져온 참혹한 결과였습니다.

트럼프는 그럼 왜 스스로 결정했던 조치들을 다시 검토하고 되돌리고 있을까요? 여러 가지 이유가 물론 복합적으로 작용한 것이겠지만, 어쨌든 이 과정에서 젠슨 황이 - 엔비디아가 - 적절하게 정부와의 관계를 가져가면서 효과적인 대응, 접근법을 찾아온 덕분도 있다고 생각합니다. 지난 2월에 제조업을 미국으로 다시 가져오라는 요청을 받고, 그로부터 불과 9개월밖에 안 지난 현재, ‘블랙웰 칩이 애리조나, 인디아나, 텍사스, 캘리포니아 전역에서 제조되고 있다’는 발표를 했어요. 엔비디아의 플래그십 GPU가 미국 내에서 완전하게 생산되는 건 사실 처음입니다. 더불어, 젠슨 황은 DoE(Department of Energy)와의 파트너십을 통해서 7개의 국가 AI 슈퍼컴퓨터를 구축하고, 그 하드웨어를 국가의 과학 연구를 담당하는 핵심 부서에 배치 완료했다는 점도 강조했습니다. 노키아, 핀란드 회사지만, 젠슨 황은 노키아와의 6G 관련 거래를 통해서 미국의 칩이 무선 기술 스택에 다시 들어가게 되었다는 점을 이야기하기도 했구요. 그리고, 휴스턴에 있는 폭스콘의 공장은 - 이 공장은 옴니버스 플랫폼에서 디지털 트윈으로 구축되었는데요 - ‘미국 내에서 시작되는 로보틱스와 AI의 융합 현장’으로 포지셔닝했습니다.

여기서 멈추지 않죠 물론. 젠슨 황은, ‘중국에 칩, 그리고 소프트웨어를 판매해야 하는 이유’를 논리적으로 명확하게 이야기했습니다:

플랫폼은 스케일(Scale)로 승리한다

더 많은 사용자가 플랫폼을 사용하게 되면서 시스템이 더 좋아집니다. 중국에는 엄청난 사용자 기반이 있어서, 그 사용량과 빈도 등을 레버리지해서 미국의 AI 플랫폼을 개선합니다.앱 생태계가 중요하다

스마트폰에 앱이 필요한 것처럼, AI 하드웨어에는 많은 ‘모델’이 필요합니다. 중국 개발자들이 미국 칩을 기반으로 모델을 구축하고 실행하도록 허용해 주면 CUDA/모델 생태계가 성장하고 아키텍처가 전 세계적으로 강화됩니다.글로벌 표준을 주도한다

미국 기술이 중국에서도 접근 가능하고 사용할 수 있게 되면, 전 세계를 대상으로 한 기본 기술 스택이 될 가능성이 높아집니다 - 이건 미국의 산업과 국가 안보 모두에 이익이겠죠.개발자 커뮤니티를 레버리지할 수 있습니다

전세계 AI 연구자의 상당 부분이 중국에 있습니다. 그 연구자들이 엔비디아, 미국 플랫폼에 참여하고 충성도가 높아지면, 미국의 기술 스택이 전세계를 자연스럽게 선도하게 됩니다.

NVIDIA GTC 2025 행사의 Q&A에서 미국 DoE 장관은, 트럼프가 이 ‘깨져버린 관계’를 회복해 가고 있다고 명확히 이야기합니다:

“트럼프 대통령은 협상의 대가입니다. 미국이 전세계의 에너지 문제를 해결하고, 정부의 규제를 혁파하고, 바로 오늘, 젠슨 황과 제가 여기서 이 대화를 나눌 수 있게 하는 건, 이게 모두 트럼프의 비전 아래서 일어나는 일들입니다. 트럼프는 과학, 그리고 국방에서 AI 리더십을 강화한다는 우리 모두의 꿈을 이룰 수 있게 할 겁니다.”

곧 이어 미중 관계에 있어서의 외교적 낙관론도 이어졌습니다:

“중국은 과학의 강국입니다. 미국과 중국 간에는 물론 차이점도 있지만 공통점도 많이 있습니다. 저는 전세계적으로 모두가 이익을 볼 수 있는 합의가 양국간에 이루어질 거라고 확신합니다.”

젠슨 황, 누구보다 이 게임을 잘 이해하는 사람이겠죠. 이번 NVIDIA GTC 2025 행사를 통해서 분명해진 건, 젠슨 황은 이미 칩 제조사의 CEO도, AI 회사의 리더도 아니게 되었다는 점입니다. 젠슨 황은, ‘국가 인프라를 설계하는 설계자’로 포지셔닝되었습니다. 엔비디아는, 이제 미국의 산업 DNA의 일부, 그 핵심에 있는 회사입니다.

한 가지 명확하게 풀리지 않은 문제가 있죠 - 바로 에너지, 그리고 에너지 경쟁에 대한 겁니다. 튜링 포스트 팀이 젠슨 황에게 질문할 기회가 있었습니다: “스케일링이나 인프라에 대해서는 많은 이야기가 있지만, 그 이면에 있는 에너지에 대해서는 아직 많은 이야기를 듣지 못한 것 같습니다. 태양광, 풍력, 기타 재생에너지가 AI 팩토리에 대한 엔비디아의 비전에 얼마나 어떻게 기여할 수 있을까요? 그리고, 탄소 문제를 고려하면서도 중국의 빠른 기술적 진보 속도를 감안할 때, 정부가 이 에너지 문제에 어떤 지원을 어떻게 지원해야 할까요?”

젠슨 황은 이렇게 대답했습니다:

미국은 AI 경쟁에서 승리하기 위해 에너지 공급을 확대해야 한다

에너지 친화적이고 성장 지향적인 정책이 모든 산업 구축에 필수적이다.모든 형태의 에너지를 사용할 것이다

AI는 너무나 중요하기 때문에, 이걸 위해서 모든 에너지원을 필요한 대로 다 사용해야 한다. 이 게임에서 승리하려면 모든 종류의 에너지가 필요하다.하지만, 가장 중요한 건 ‘효율성에서의 승리’다

Grace Blackwell은 약 50% 수준의 추가 전력으로 Hopper의 약 10배 성능을 제공한다. 시스템 수준의 에너지 효율을 급격하게 향상시킬 수 있다.엔비디아의 전략: 무차별적으로 ‘에너지’, ‘에너지’를 부르짖는게 아니라, 더 많은 에너지, 그리고 ‘더 높은 효율성’을 적절히 결합한다

젠슨 황이 직접 언급하지는 않았지만, 젠슨 황이 노리는 트럼프와의 ‘Alignment’는, 바로 정확히 ‘에너지’에 목표를 두고 있을 겁니다. 트럼프 행정부는 미국의 ‘AI 에너지 경제’ 핵심 기반으로 ‘원자력 발전’을 밀어붙이고 있습니다. 얼마 전에 서명한 800억 달러 규모의 새로운 웨스팅하우스-일본 간 파트너십 같이, 이런 원자력 발전을 위한 새로운 거래를 체결하고 새로운 원자로의 승인을 완화해주고 있죠.

엔비디아가 원자력 발전소를 짓는 건 아니지만, 엔비디아의 미래는 ‘원자력만이 제공할 수 있는, 밀도높고 지속적인 부하를 감당할 수 있는 전력’에 달려 있는 것, 부인할 수 없는 사실입니다.

젠슨 황, 그의 AI 팩토리 비전에는 그 핵심에 원자력 발전소가 필요합니다. 이것 역시, 어쩌면, 다시 ‘효율성’의 이야기로 돌아오는 것이기도 하네요 - 이건 연산의 효율성이 아니라 열역학적 효율성 이야기이기는 하지만요.

이런 엔비디아의 선언, 그리고 포지셔닝. 향후에 엔비디아, 삼성전자, 현대자동차 수장들의 삼자 회동 이후의 사업 전개에는 어떤 영향을 미치게 될까요? 그게 궁금하네요.

어쨌든, 미국, 그리고 2025년 - 엔비디아라는 회사가 생각할 수 있는 최고의 시점과 장소인 것 같습니다.

튜링 포스트 코리아는 독자들의 응원으로 만들어집니다. 가치있는 컨텐츠를 지속적으로 여러분과

공유할 수 있도록, 커피 한 잔으로 힘을 보태주세요 ☕

트위터 라이브러리 (Twitter Library) 🐦

AI가 적용되는 수많은 분야가 있지만, 특히 ‘코딩’이야말로 AI가 광범위하게, 그리고 빠르게 적용되고 있는 분야 중 하나죠. 오늘은 AI 기반의 코딩 워크플로우를 한 단계 더 편리하고, 더 효율적으로 만드는데 도움을 줄 수 있는 깃헙 리포지토리 모음을 준비해 봤습니다:

금주의 주목할 만한 업계 동향 📰

엔비디아, GTC에서의 발표를 중심으로 한 다양한 소식

NVIDIA ARC와 노키아의 6G 파트너십

엔비디아의 새로운 제품 라인인 NVIDIA Arc Aerial RAN Computer가 공개되었습니다 - 무선 통신과 AI 프로세싱을 하나의 플랫폼에서 합친, 완전한 소프트웨어 기반의, 프로그래머블 컴퓨터입니다. 노키아는 이 ARC를 이후 자사의 기지국에 통합할 예정입니다. 이 파트너십은, ‘AI on RAN’ - 무선 접속 네트워크 위의 AI - 라는 새로운 형태의 엣지 클라우드를 구현해서 산업용 로봇, 드론, 자동차가 현장에서 판단하고 즉각 행동할 수 있게 해 줄 수 있는 시스템을 향한 한 걸음이라는 의미에서 중요한 의미가 있습니다.

루빈 플랫폼과 AI 슈퍼컴퓨팅의 미래

케이블 없이 액체로 냉각되는 방식의, 엄청나게 강력한 ‘루빈 플랫폼’. 엔비디아의 3세대 랙 단위 슈퍼컴퓨터로, 단일 랙에 100페타플롭스의 처리 용량을 담아냈습니다. 불과 9년 전에 오픈AI에 납품된 DGX-1보다 100배나 강력하다고 하는데요. 루빈은 엔비디아가 "극한의 통합 설계"로 기존에 잘 알려진 무어의 법칙을 넘어서려는 욕망을 대표하는 플랫폼인데, 젠슨 황은 "통합 설계" 개념을 아주 좋아한다고 해요. 이로서, 엔비디아는 수직적 확장(칩), 수평적 확장(랙), 그리고 전면적 확장(AI 팩토리)의 삼위 일체를 모두 해 낸 회사가 되었다고나 할까요? 랙을 하나의 거대한 GPU로 만들고, 그 랙들을 AI에 최적화된 네트워크로 연결하고, 다시 데이터센터 전체를 하나로 묶는 방식입니다. 젠슨 황은 이 구조를 "AI의 선순환"이라는 용어로 표현하네요. 2026년까지 이미 5천억 달러의 주문이 쌓여 있는 상황에서, 젠슨 황의 메시지는 명확했습니다 - ‘AI 기반의 산업’ 시대, 이미 도래했습니다.

옴니버스 DSX - AI 팩토리를 위한 디지털 트윈

젠슨 황은 초거대 AI 팩토리를 설계하고 운영하기 위한 완전한 청사진, NVIDIA Omniverse DSX도 함께 소개했어요. 냉각 시스템부터 컴퓨팅 클러스터까지 모든 것을 실제로 건물 공사를 시작하기도 전에 가상으로 함께 설계할 수 있습니다. AI 팩토리를 짓는다는 것, 보통 일은 아니잖아요? DSX를 쓰면 전체 과정을 미리 시뮬레이션하고 최적화할 수 있습니다. 산업 문명을 위한 디지털 트윈이라고나 할까요? 이 플랫폼을 사용하면, 수년 정도 걸릴 계획을 몇 달로 압축할 수 있다고 하니, 대단합니다.

NVIDIA Drive Hyperion과 우버 파트너십

마지막으로 NVIDIA Drive Hyperion - "로보택시-레디” 차량을 위한 표준 아키텍처입니다. 이미 메르세데스-벤츠와 루시드가 채택했고, 이제 우버와 손잡습니다. 하이페리온 차량들은 우버의 글로벌 네트워크에 바로 연결될 겁니다. 이건 자율주행 시제품과 실제 상용화 사이의 간극을 메워주는 플랫폼이죠. 센서, 컴퓨팅, 인프라를 하나로 묶으면서, 엔비디아는 자율주행을 ‘달 착륙 프로젝트’같이 마치 머나먼 꿈 같은 프로젝트가 아니라 실제 시장으로 이어가고 있습니다.

오픈AI, 고삐풀린 채 드러나는 야망

오픈AI, 이제 공식적으로 ’비영리 조직’이라는 굴레에서 벗어났습니다. 마이크로소프트와의 새로운 구조조정 계약으로 기존의 자금 조달 과정에서 들어온 제약 조건이 사라지면서, 오픈AI의 IPO 가능성이 높아졌습니다. 마이크로소프트는 27% 지분을 유지하지만, 컴퓨팅 독점권은 포기했습니다. 샘 알트만은 1.4조 달러 규모의 데이터센터, 그리고 수 기가와트 단위, 아니 어쩌면 그 이상의 야망을 갖고 있겠죠. 서류 상으로야 비영리 조직이 여전히 통제권을 쥐고 있지만, 글쎄요? 그 와중에, 마이크로소프트의 수익률은 138억 달러의 투자액 대비 거의 10배에 달합니다.

구글-앤쓰로픽, 구글의 TPU 공급 계약

튜링 포스트 코리아팀이 읽고 있는 것들

트럼프 행정부가 웨스팅하우스와 최소 800억 달러 규모의 원자력 발전소 건설 계약을 체결했습니다. AI 데이터센터의 급증하는 전력 수요에 대응하고, 2050년까지 미국 원자력 발전 용량을 4배로 늘리려는 계획의 일환인데, 3세대 원자로인 AP1000 원자로를 건설해서 10만 개 이상의 일자리가 창출될 전망이고, 자금의 상당 부분은 트럼프 대통령이 일본과 체결한 3,300억 달러 규모의 에너지 인프라 투자 협약에서 나올 거라고 합니다. 이 계약은, 원자력이 AI 시대의 핵심 인프라로 자리잡고 있다는 걸 보여주는 상징적인 거래라고 할 수 있겠습니다.

The Continual Learning Problem by Jessy Lin

AI 모델이 새로운 것을 배우면서도 기존에 가지고 있던 지식을 잊지 않게끔 하려면 어떻게 해야 할까요? 연구자들은 수백만 개의 작은 '기억 슬롯'을 만들어서 필요한 정보만 선택적으로 업데이트하는 '메모리 레이어' 방식을 제안하고 있네요. 실험을 해 본 결과, 모델 전체를 재학습하면 기존의 성능이 자그마치 89%나 떨어지지만, 메모리 레이어를 사용하면 약 11% 정도만 떨어졌습니다. AI가 진짜 '평생 학습'을 하도록 하기 위한 중요한 첫걸음이 아닐까 싶습니다.

새로 나온, 주목할 만한 연구 논문

‘주목할 만한 최신의 AI 모델’을 먼저 소개하고, 각 영역별로 ‘Top Pick’은 해당 논문 앞에 별표(🌟)로 표시했습니다!

주목할 만한 최신 AI 모델

DeepAnalyze: Agentic large language models for autonomous data science

칭화대 연구팀이 DeepAnalyze-8B를 선보였습니다. 80억 개 파라미터 규모의 이 AI 모델은 원시 데이터만 주면 알아서 애널리스트급 리서치 보고서를 작성합니다. 사람이 배우는 방식을 모방한 커리큘럼 기반 학습과, 데이터에 기반한 고품질 학습 데이터 생성 방식을 사용합니다. 간단한 데이터 질의 응답부터 개방형 분석까지 폭넓게 처리하는데, 크기는 작지만 유료 대형 모델 기반의 워크플로우 에이전트보다 뛰어난 성능을 보여준다고 합니다. 코드와 데이터를 포함한 모든 구성 요소가 오픈소스로 공개되기도 했습니다 —> [논문 보기]Aion-1: Omnimodal foundation model for astronomical sciences

Flatiron Institute, 버클리 등의 연구팀이 천문학을 위한 멀티모달 파운데이션 모델 AION-1을 소개했습니다. 이미징, 분광, 스칼라 데이터를 통합하고, 각각의 데이터 유형에 맞는 토큰화 방식과 트랜스포머 기반 마스크 모델링 기법을 사용합니다. SDSS, DESI, Gaia 같은 서베이의 2억 개 이상 관측 데이터로 사전학습된 AION-1(3억~31억 파라미터)은 은하 속성 추정, 형태 분류, 스펙트럼 초해상도 등의 작업에서 탁월한 성능을 보여준다고 합니다. 단일한 동결 인코더를 사용하고 완전히 오픈소스로 공개되어서, 과학 분야에서 멀티모달 모델링을 어떻게 스케일링하는지 그 청사진을 보여줍니다. —> [논문 보기]

강화학습, 증류 및 추론의 다이나믹스

🌟 QueST: Incentivizing LLMs to Generate Difficult Problems (by University of Zurich, Microsoft)

난이도를 인식하는 샘플링과 리젝션 튜닝을 통해서 고난이도 코딩 문제를 생성, 추론 능력과 증류 데이터 품질을 향상시킵니다. —> [논문 보기]🌟 Unified Reinforcement and Imitation Learning for Vision-Language Models (엔비디아, KAIST)

강화학습과 적대적 모방학습을 결합해서 소형 비전-언어 모델이 교사 모델을 모방하고 여러 모달리티에서 성능을 개선하도록 돕습니다. —> [논문 보기]🌟 On-policy Distillation (Thinking Machines)

작은 모델이 자체 출력을 샘플링하고 교사로부터 토큰 단위 피드백을 받아 학습하는 방식으로, 강화학습 수준의 성능을 10~30배 적은 연산량으로 달성합니다. —> [논문 보기]🌟 Deep Self-Evolving Reasoning

추론을 확률적 프로세스로 모델링해서, 각각의 반복마다 자기개선 확률이 누적되게 하고, 작은 모델이 장기적으로 개선해 가면서 교사 모델을 뛰어넘을 수 있게 합니다. —> [논문 보기]

효율성, 압축 및 시스템 설계

🌟 Efficient Long-context Language Model Training by Core Attention Disaggregation

어텐션을 전용 컴퓨팅 서버로 분리해서 작업 부하를 균형있게 분산하고 병목 현상을 제거해서, 512개 GPU에서 최대 1.35배의 처리량을 달성합니다. —> [논문 보기]🌟 Glyph: Scaling Context Windows via Visual-Text Compression (Zhipu AI)

텍스트를 이미지로 렌더링해서 비전-언어 모달리티를 처리하는 방식으로 다루는데, 긴 컨텍스트를 3~4배 압축하면서도 추론의 정확도를 유지하고 백만 토큰 수준의 작업을 가능하게 해 줍니다. —> [논문 보기]🌟 LightMem: Lightweight and Efficient Memory-Augmented Generation

LLM 메모리를 감각, 단기, 장기 메모리 계층으로 구성해서 과거의 컨텍스트를 효율적으로 보존하게 해 주고, 실행 시간을 10배 이상 절약합니다. —> [논문 보기]

이론, 표현(Representation), 인사이트

Language Models are Injective and Hence Invertible

트랜스포머가 단사 함수(Injective Mapping)임을 증명해서, 활성화 값으로부터 입력을 정확히 재구성할 수 있다는 걸 보여주고, 이를 기반으로 이론적·실용적인 해석의 가능성을 제시합니다. —> [논문 보기]From Masks to Worlds: A Hitchhiker's Guide to World Models

마스크 모델로 시작해서, 사용자와 상호작용할 수 있고 메모리가 더해진 최신 월드 모델 아키텍처까지의 진화를 추적해서 보여주고, 앞으로의 지속적인 생성형 월드 모델을 향한 경로를 제시합니다. —> [논문 보기]

읽어주셔서 감사합니다. 프리미엄 구독자가 되어주시면 튜링 포스트 코리아의 제작에 큰 도움이 됩니다!