오픈AI와 앤쓰로픽 – 왜 하필 같은 시점에 ‘헬스케어’를 선택했을까

새해가 되고 얼마 지나지 않아, 오픈AI와 앤쓰로픽이 단 며칠 간격으로 ‘헬스케어(Healthcare)’를 중심으로 한 이니셔티브를 발표했습니다. 희한하게도, 이번에는 이 두 회사의 이니셔티브를 ‘경쟁’으로 보지 않게 되었는데요. 거꾸로, 제가 긍정적으로 해석한 지점은 헬스케어와 AI의 본격적인 결합이 그 ‘임계점(Threshold)’을 넘어서, 이제는 ‘참여하지 않는 게 지나치게 조심스러운 선택’인 상황에 다다랐다느 신호라는 점이라고 할까요?

지난 몇 년 동안, 솔직히 헬스케어는 글로벌 선도 AI 연구소들 관점에서는 “나중에 하자”는 입장으로 일종의 미뤄놓은 영역이었다고 할 수 있습니다. 충분히 이해할 만 합니다: 이 산업은 규제가 아주 강하고, 산업의 구조와 운영 모델은 파편화되어 있고, 자신만만한 실수가 용서되는 영역이 아닙니다. 이전 세대의 AI 모델들은, 헬스케어라는 강적을 만나서 ‘경계 설정도 어렵고, 감사나 검증도 어렵고, 성공과 실패 모드가 깔끔하게 분리되지 않는 문제들’을 드러냈습니다. 위험이나 리스크가 낮은 영역이라면 그럭저럭 넘어가고 쓸만할지 몰라도, 글쎄요, 헬스케어, 절대 그런 영역이 아니죠.

그런데, 지금 오픈AI와 앤쓰로픽이라는 두 거대 조직이 지금 움직이기로 한 결정은, 뭔가 ‘공통된 결론’을 내렸다는 의미로 읽힙니다. 물론, 근본적으로 AI 모델의 능력(Capability)이 좋아진 것도 사실이지만, 더 중요한 변화는 거버넌스 가능성(Governability)—즉, 통제·감독·운영 가능한 형태로 다룰 수 있게 됐다는 점이 아닐까 생각합니다.

여기서 Governability는 “모델이 뭘 할 수 있느냐”보다 “현장에서 책임 있게 다루도록 제어·감사·경계 설정이 가능하냐”에 더 가까운 의미입니다

그런 의미에서, ‘헬스케어’는 일반적인 시장 기회(Market Opportunity)의 관점에서보다 일종의 ‘시스템 테스트(Systems Test)’로 보는 편이 더 정확하다고 생각합니다. 우리 사회와 산업에 AI를 도입하는 여정에서, 이건 굉장히 중요한 한 걸음이 될 거고 되어야 합니다.

또 하나, 짚고 넘어갈 게 있어요 – 의사들은 걱정하지 않아도 됩니다. 지금 AI가 헬스케어 영역에 적용되는 핵심은, ‘의학적 판단’이 아니라 ‘조정(Coordination)’입니다. 헬스케어에는 오래된 문제가 하나 있습니다. 시간의 압박 속에서 전체 맥락(Full Context)을 모아서 붙일 구조적인 위치에 있는 사람이 사실상 없다는 점이예요. 정보는 여러 시스템에 흩어져 있고, 약물(Medications), 검사실(Labs), 영상(Imaging), 웨어러블(Wearables), 유전(Genetics), 과거 병력(Prior History) 같은 신호들을 실제 현장의 의사결정 과정 중에 하나로 다 모아서 종합적으로 고려하기가 참 어렵습니다. 그래서, 종종 환자들이 스스로 그런 정보들을 찾아내는 탐정(Detectives) 역할을 하면서 조각을 맞추는 역할을 떠안는 경우도 보게 됩니다. 이 프레임에서 LLM(Large Language Model)은 의학적 판단을 내리는 게 아니라, 기존의 정보를 한데 모아서 더 쉽게 검토할 수 있도록 정리해 주는 역할을 주로 합니다.

오픈AI와 앤쓰로픽 두 기업 모두, 이 ‘조정자로서의 역할’이 이제 제품(Product)으로 만들만큼 충분히 안정적이라고 믿는 신호 아닐까요?

다만, 이 두 기업이 ‘조정(Coordination)’ 역할에 접근하는 방식은 또 다릅니다.

OpenAI는 일반적인 범용 어시스턴트(General Assistant)를 헬스케어로 확장하는 방향입니다. 건강 데이터(Health Data)를 문서(Documents), 캘린더(Calendars), 엔터프라이즈 도구(Enterprise Tools) 같은 높은 가치의 컨텍스트(High-Value Context)와 나란히 놓을 수 있는 또 하나의 입력으로 보고, 여기에 프라이버시(Privacy)와 접근 통제(Access Controls)를 추가로 덧씌우는 형태죠. 기본적인 가정은 이렇습니다: 데이터 사용의 경계(Boundaries)가 명확히 정의되기만 하면, 하나의 익숙한 인터페이스가 환자(Patients), 임상의(Clinicians), 행정 워크플로우(Administrative Workflows)를 모두 커버할 수 있다는 겁니다.

반면에, Anthropic은 좀 더 좁지만 선명한 접근을 취합니다. 이들의 헬스케어 접근 방향은, 환자용 어시스턴트(Patient-Facing Assistant)라기보다 기존 기관들의 워크플로우 안에 Claude를 심는 쪽에 더 가깝습니다. 그래서, 앤쓰로픽이 강조하는 지점은 ‘예측 가능한 행동(Predictable Behavior)’, ‘제한된 범위(Limited Scope)’, 그리고 ‘헬스케어 조직이 이미 작동하는 방식과의 정렬(Alignment)’ 같은 것들이죠. 폭넓은 유스케이스 간의 연속성(Broad Continuity)보다는, 특정한 전문 업무의 맥락(Professional Context) 안에 “깔끔하게 들어맞는 것”을 더 중요하게 봅니다.

무엇에 집중할지를 두고 갈리는 이 두 회사의 선택은, 규제 산업에서 신뢰(Trust)가 어떻게 만들어지는지에 대한 서로 다른 이론을 반영하는 것이기도 합니다. 하나는 연속성과 폭넓은 사용(Continuity And Widespread Use)을 통해서 신뢰가 생긴다고 보는 것이고, 다른 하나는 제약(Constraint)과 제도적 정렬(Institutional Alignment)을 통해 신뢰가 생긴다고 보는 것입니다. 어느 쪽이 더 오래 가게 될 접근인지 아직은 분명하지 않죠: 어쩌면, 현실적으로는 시스템의 서로 다른 영역에서 두 가지 방식이 공존할 수도 있을 겁니다.

중요한 건, 오픈AI와 앤쓰로픽 모두 이제 책임(Responsibility)이 추상적(Abstract)으로 남을 수 없는 환경에서 자사의 AI 모델을 시험해 볼 의지가 생겼다는 점입니다. 이 새로운 결정의 앞날, 기대합니다.

튜링 포스트 코리아는 독자들의 응원으로 만들어집니다. 가치있는 컨텐츠를 지속적으로 여러분과

공유할 수 있도록, 커피 한 잔으로 힘을 보태주세요 ☕

금주의 주목할 만한 업계 동향 📰

Gmail, Gemini로 업그레이드되다

Gmail이 2026년을 Gemini AI를 전면에 내세우며 시작합니다. 구글의 대표 메일 서비스인 Gmail은 이제 이메일 스레드를 요약해 주는 AI 오버뷰(AI Overviews), 자연어로 질문하면 답해 주는 검색/질의 기능, 그리고 곧 출시될 AI 인박스(AI Inbox)로 잡다한 메일을 걸러주는 기능까지 제공할 예정이라고 하네요.

글쓰기 도우미(Help Me Write)와 추천 답장(Suggested Replies)도 더 똑똑해지고, 맞춤법·문장 교정(Proofreading)은 유료 프리미엄 기능으로 들어갑니다.

이제 이메일이 그냥 단순한 메일이 아니라, AI 기반 개인 비서(AI-Powered Executive Assistant)에 가까워지고 있나 싶네요.

Apple + Google: Gemini로 결합하다

Apple이 오랫동안 지연돼 온 Siri의 AI 업그레이드를 위해서, 결국 Google의 Gemini를 선택했습니다. 경쟁사끼리 손을 잡는 보기 드문 동맹이긴 합니다.

다년간의 이 파트너십으로 Gemini 모델이 Apple이 준비 중인 파운데이션 모델의 핵심에 들어가게 되고, 연산은 대부분 온디바이스와 Apple의 프라이빗 클라우드에서 처리하는 방향으로 할 것으로 알려져 있씁니다. Apple은 연간 10억 달러 규모의 비용 이야기에 대해서는 공식적으로는 말을 아끼고 있지만, 이번 선택은 어쨌든 Apple이 드디어 어떤 형태로든 AI 군비 경쟁에 등장했다는 신호로 읽힌다는 점에서 의미가 있습니다. 물론… 늘 그렇듯, 멋지게 늦게 들어왔다는 농담도 따라붙겠죠?

Apple의 이런 전략적 선택, 그 함의, 그리고 향후 전망에 대해서는 한 번 다양한 각도에서 검토해 볼 필요가 있어 보입니다.

일론 머스크의 “Macrohard” 모먼트

일론 머스크의 AI 벤처인 xAI가 단 9개월 만에 78억 달러($7.8B)를 태워 버렸습니다...! 그 목표는 Optimus 같은 휴머노이드 로봇에 동력을 공급하겠다는 “꿈”을 현실로 만드는 것이었는데요.

분기 손실이 급격히 커지는 와중에도 매출은 1억 700만 달러까지 두 배로 늘었고, 엔비디아가 포함된 200억 달러 규모의 현금 투입량을 보면, 이 거대한 지출의 레이스가 쉽게 끝나지 않을 것 같습니다.

“Macrohard”는 Microsoft를 비튼 말장난이지만, Cash Burn Rate는 전혀 장난이 아니네요.

튜링 포스트 코리아팀이 읽고 있는 것들

On the Slow Death of Scaling by Sara Hooker

지난 수년간 AI의 혁신을 이끌어 온, 모델 크기와 데이터 중심의 스케일링 패러다임, 점차 한계점에 도달하고 있다는 것은 아마 모두 느끼고 있을 것 같습니다. 이 글에서도, 단순히 더 큰 모델과 더 많은 데이터를 투입하는 방식만으로는 앞으로 일어날 진짜 발전을 이끌고 설명할 수 없을 거라고 지적합니다.

학계와 업계가 ‘스케일링 신화’에 사로잡혀서 다른 혁신적인 접근 방법을 어느 정도 간과해 왔다는 점을 비판하면서, AI 발전의 다음 단계는 효율성, 구조적 이해, 그리고 새로운 성능 지표를 찾는 쪽으로 이동할 것이라는 메시지를 던지고 있습니다.

a16z: The Power Brokers by Packy McCormick

이 글은 전통적인 벤처 캐피털과 달리 a16z가 어떻게 하나의 ‘Firm’으로서 기술·투자·내러티브를 통합하면서 영향력을 확장해 왔는지를 이야기합니다. a16z는 단순히 자금을 운용하는 조직을 넘어서 미래에 베팅하고 기술 생태계 전반에 구조적 영향력을 행사하는 기관(Institution)으로 스스로를 규정하고, 기술-미디어-정책-인재 확보까지 아우르는 플랫폼형 벤처캐피털의 새로운 역할을 구축해 왔다는 시각을 보여주고 있습니다.

중국의 대표적인 AI 스타트업들인 Zhipu AI와 MiniMax가 홍콩 증시에 상장(IPO)하면서 주목받고 있다는 소식입니다. 이 두 회사는 중국 내 AI 경쟁과 글로벌 시장 진출 가능성을 동시에 보여주는 사례로, 특히 MiniMax는 소비자 중심 제품과 멀티모달 AI 전략으로 주가가 크게 상승하면서 시장의 기대감을 확인시켰습니다. 다만 이들 기업이 중국판 OpenAI라고 보기는 어렵고, 각각의 비즈니스 모델과 전략적 방향이 다르다는 점에서 중국 AI 산업의 다양성과 글로벌 확장 가능성을 가늠해 볼 수 있습니다.

새로 나온, 주목할 만한 연구 논문

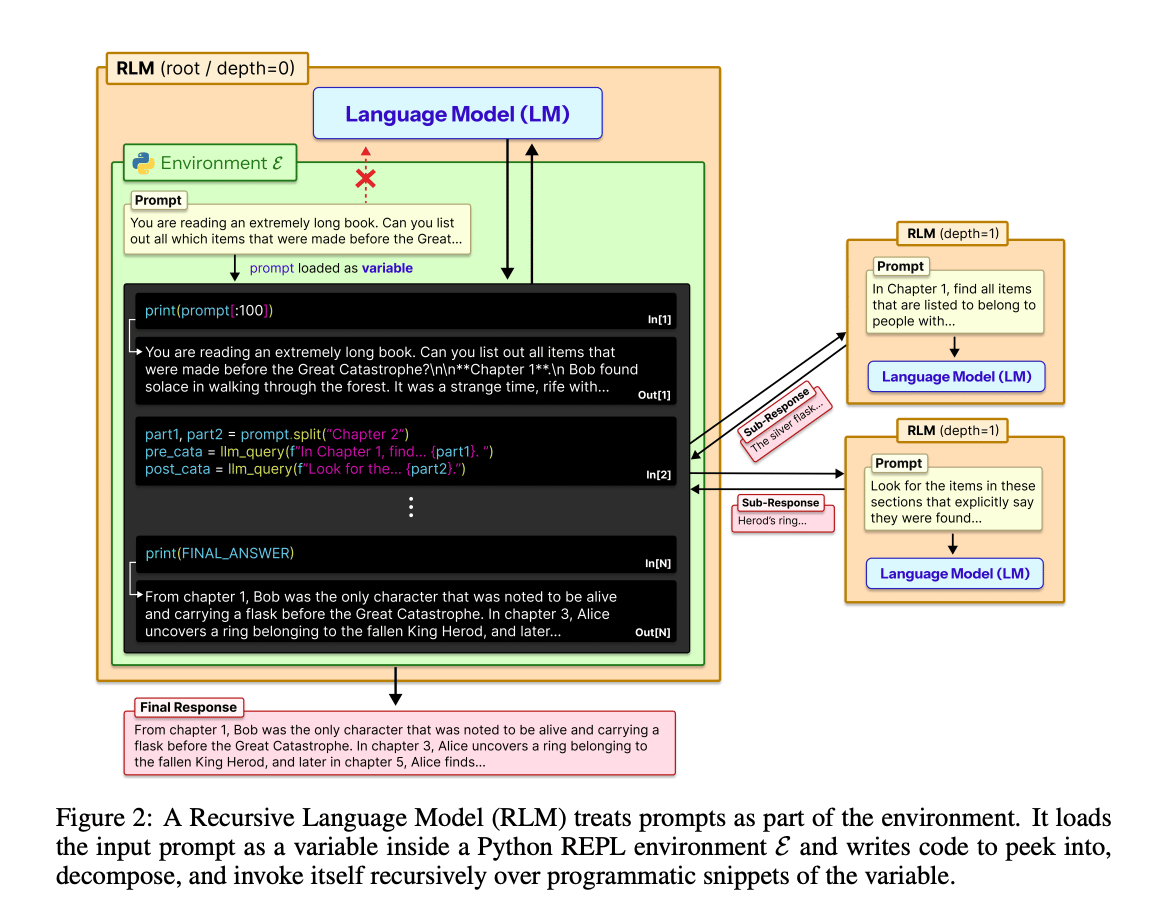

MIT CSAIL 연구진이 재귀 언어 모델(Recursive Language Models, RLMs)을 발표했습니다. 이 모델은 추론 시점(Inference-Time)에 동작하는 새로운 아키텍처로, LLM이 임의의 긴 프롬프트(Arbitrarily Long Prompts)를 처리할 수 있게 해 줍니다. 맥락 창(Context Window)의 한계를 1,000만 토큰 이상으로 확장해서, 일반적인 컨텍스트 윈도우 대비 100배 이상 스케일링할 수 있다는 주장입니다.

핵심은 프롬프트를 모델이 “그대로” 받는 대신, Python REPL(Python Read–Eval–Print Loop) 안에 변수로 담아 컨텍스트로 보관해 두고, LLM이 코드를 통해 그 컨텍스트와 상징적으로(Symbolically) 상호작용하도록 만든다는 점입니다. 모델은 코드로 컨텍스트를 읽고(Read), 변형하고(Transform), 분해(Decompose)할 수 있고, 내장된 llm_query() 함수로 하위 LLM을 재귀적으로 호출(Recursive Call)할 수도 있습니다. 그 결과로, 다이나믹한 작업 분해(Dynamic Task Decomposition), 선택적인 컨텍스트 접근(Selective Context Access), 사실상 무제한의 추론(Unbounded Reasoning)이 가능해집니다.

RLM은 재학습(Retraining)이 필요 없고, 기존 모델(GPT-5, Qwen3-Coder)에서도 동작합니다. BrowseComp+, OOLONG, OOLONG-Pairs 같은 벤치마크에서 기본 LLM이나 롱컨텍스트 에이전트 대비 최대 2배 높은 정확도를 보이면서, 추론 비용은 비슷하거나 더 낮게 유지했다고 합니다. 또 제거 실험(Ablation Studies)을 통해서 REPL 환경과 재귀적 서브콜(Recursive Sub-Calls)이 복잡하고 정보 밀도가 높은 과제를 푸는 데 핵심 역할을 한다는 점도 확인했습니다.

이 연구는, RLM이 LLM의 근본적 병목인 컨텍스트 윈도우 장벽을 깨고, 재학습이나 아키텍처 변경 없이도 방대한 입력 위에서 확장 가능한(Scalable)·상징적(Symbolic)·재귀적(Recursive) 추론을 가능하게 만든다는 점에서 중요한 진전이라고 할 수 있겠습니다 → [논문 보기]

모델

Liquid: LFM2.5 – The Next Generation of On-Device AI

엣지 에이전트(Edge Agents)에 최적화된 오픈 웨이트(Open-Weight) 1.2B급 모델 패밀리를 공개합니다. 프리트레이닝을 28T 토큰까지 확장하고, 다단계 강화학습(Multi-Stage Reinforcement Learning)으로 포스트 트레이닝을 스케일링했고, 텍스트, 일본어, 비전-언어(Vision-Language), 네이티브 오디오(Native Audio) 변형까지 포함합니다. 또, 주요 추론 스택(Inference Stacks)과 NPU에서 Day-Zero 런타임 지원(Runtime Support)을 함께 제공하는 것이 포인트입니다

→ [논문 보기]

MiMo-V2-Flash Technical Report

대규모 MoE 백본(Large MoE Backbone)에 하이브리드 어텐션(Hybrid Attention), 멀티 토큰 예측(Multi-Token Prediction), 멀티 티처 온-폴리시 증류(Multi-Teacher On-Policy Distillation)를 결합해서 디코딩 속도와 파라미터 효율을 끌어올리면서도, 빠르고 강한 추론 및 에이전트형 성능을 제공하는 것을 목표로 합니다 → [논문 보기]

K-EXAONE Technical Report

우리나라의 대표적인 거대 AI 모델이죠. 다국어 MoE 파운데이션 모델(Multilingual MoE Foundation Model)로, 롱컨텍스트(Long-Context) 지원을 포함합니다. 여러 주요 언어에서 추론(Reasoning), 에이전트형(Agentic), 산업용(Industrial) 역량 간의 밸런스를 맞추는 것을 겨냥했다고 합니다 → [논문 보기]

LTX-2: Efficient Joint Audio-Visual Foundation Model

비대칭 모달리티 전용 트랜스포머(Asymmetric Modality-Specific Transformers)를 크로스-어텐션(Cross-Attention)으로 결합해서, 단일 통합 모델(Unified Model)에서 시간적으로 동기화된(Temporally Synchronized) 비디오와 오디오를 함께 생성합니다. 효율성과 제어 가능성(Controllable Audiovisual Synthesis)을 동시에 노린다고 합니다 → [논문 보기]

읽어주셔서 감사합니다. 프리미엄 구독자가 되어주시면 튜링 포스트 코리아의 제작에 큰 도움이 됩니다!