튜링포스트 코리아 구독자 여러분,

세계 최대의 소비자 가전 전시회인 CES 2026에 대한 이야기로 금주 여러분을 만나뵙습니다.

AI를 필두로 한 변화와 혁신의 속도, 이제 다음의 아젠다는 무엇인지, 언제 어떻게 바뀔지 예측을 한다기보다는, 그저 저 멀리 있는 사건의 지평선(Event Horizon) 을 들여다보는 느낌에 가까워지고 있는 것 같습니다. 로드맵을 그리기보다는, 뭐가 곧 보이지 않게 될지를 고민해야 하는 단계에 들어온 것 같다는 말씀입니다.

사건의 지평선. Image Credit: Space.com

CES에 어떤 회사들이 어떤 제품을 전시하고 보여줬는지 등은 기사와 방송 등을 통해서 많이 보셨을 테니 그런 이야기는 넘어가구요.

저희 필진의 눈에 이번 CES에서 특히 인상적이었던 건, 이런 행사에서도 ‘일정을 전략적으로 배치하는게 사람들에게 주는 인식(Recognition)에 얼마나 큰 영향을 주느냐’ 하는 것을 직접 목도했다는 점이었는데요.

일부 언론 보도를 보면, CES 2026이 또 다시 한 번 젠슨 황을 중심으로 해서 돌아간 행사처럼 보이기도 하는데요. 물론, 실제로 엔비디아는 젠슨 황의 ‘스페셜 프레젠테이션’을 현지 시각 오후 1시, 즉 가장 집중도가 높은 시간대에 배치하기도 했구요. 반면에, CES 공식 개막 키노트였던 리사 수의 연설은 저녁 시간에 진행됐는데, 사실 이때쯤은 많은 참석자들이 체력도 떨어지고 집중력도 떨어지는 시간이죠.

저희 튜링포스트 팀은 지난 월요일 하루 내내 퀄컴, 엔비디아, AMD의 칩을 중심으로 한 발표 세 개를 모두 들었습니다. 이 글은, 그 전체 그림을 보고 난 뒤의 기록이라고 할 수 있을 것 같네요.

먼저, 가장 흥분됐고 재미있었던 발표, 그리고 그게 우리의 미래에 어떤 의미를 갖는지에 대한 생각을 말씀드리려고 하구요.

이어서, AI 인프라 거대기업들 사이에서 막 벌어지고 있는 경쟁, 그리고 각자의 미래를 위해 최적화하려는 ‘미래’가 어떤 모습인지 정리해 볼까 합니다.

Part 1. 가장 흥분됐던 것: Alpamayo, 그리고 Tesla와 자율주행의 미래

젠슨 황의 키노트에서 가장 눈길을 끈 발표는 누가 뭐래도 Alpamayo 1이었습니다. Alpamayo는 대규모 시뮬레이션과 합성 데이터 파이프라인을 기반으로 개발된, 추론 중심의 VLA(Vision-Language-Action) 모델입니다. 자율주행을 위해 설계된 모델이죠.

엔비디아 Alphamayo. Image Credit: 엔비디아

“시뮬레이션은 우리가 가장 편안함을 느끼는 영역입니다.”

젠슨 황의 이 말이 순수하게 기술적인 의미였는지, 아니면 엔비디아의 철학을 담은 은유였는지는 아직도 곰곰히 곱씹게 되는 표현인데요.

Alpamayo 1은 약 100억 파라미터 규모의 모델로, 서라운드 카메라 영상, 차량 주행 이력, 내비게이션 맥락 같은 멀티모달 입력을 받아서 주행 경로와 함께 ‘추론 과정(Reasoning Trace)’을 출력합니다. 이 ‘추론 과정’ 덕분에 의사결정에 대해서 검증을 할 수 있고, 디버깅이라든가 안전 상태의 검토도 할 수 있습니다. 엔비디아가 이 모델과 Drive AV 시스템을 완성하는 데 걸린 시간은, 자그마치 8년이었습니다.

이 접근 방법의 핵심은, 운전이라는 활동을 ‘미리 짜인 반응들의 집합’이 아니라 ‘연속적인 의사결정 과정’으로 본다는 점입니다. 이건 자율주행 업계에서 오랫동안 이어져 온 논쟁, 즉 센서냐 지능이냐라는 질문에 중요한 함의를 던집니다.

Alpamayo는 LiDAR 중심의 아키텍처가 그 동안 과도하게 강조되어 왔을 가능성을 분명히 드러냅니다. 보고 있는 장면을 이해하고, 의도를 추론하고, 과거의 경험을 바탕으로 일반화할 수 있는 시스템이라면 차량을 ‘움직이는 연구 장비’처럼 수많은 센서를 덕지 덕지 붙여놓을 필요는 없습니다. 그 결과는 더 가볍고, 에너지 효율이 높고, 소비자가 실제로 타고 싶어 하는 형태의 자동차라는 결과물로 이어질 수 있구요.

이 길을 처음으로 보여준 회사는 테슬라죠. 실제로 Tesla의 FSD(Full Self-Driving)는 상당한 성과를 냈습니다만, 완전한 자율성에는 아직 도달하지 못했습니다.

일론 머스크가 말하는 핵심은 이겁니다: 99%까지는 갈 수 있다. 하지만 마지막 1%가 지독하게 어렵다.

그 1%는 희귀하고, 모호하고, 제대로 레이블링되지 않은 상황들로 이루어진 롱테일 문제입니다. 단순한 패턴의 재현으로는 해결되지 않습니다. 바로 이 지점에서 Alpamayo 패밀리(Alpamayo 1, AlpaSim, 데이터셋 포함) 의 오픈소스화가 구조적으로 중요한 토픽이 됩니다.

엔비디아는 추론 모델과 시뮬레이션을 결합하고, 핵심 요소를 오픈소스로 공개해서, 테슬라의 방식을 그대로 복제하지 않아도 되는 ‘공유된 자율주행 기반’을 제안하고 있습니다. 여러 자동차 제조사가, 호환할 수 있고 안전 검증을 할 수 있는 시스템을 그 위에서 쌓을 수 있도록 말이죠.

Alpamayo가 자율주행 문제를 해결하느냐고요? 글쎄요, 아마 해결하지는 못할 겁니다. 하지만 업계가 이 문제에 접근하는 방식 자체를 바꿉니다. 그래서 저는 이 발표가 중요하다고 봅니다.

모델, 데이터, 시뮬레이션 도구를 개방해서, 엔비디아는 더 많은 참여자와 공유된 가정, 그리고 더 많은 진전의 가능성이 있는 새로운 국면을 열고 있습니다. 참고로, 엔비디아의 자율주행 팀 규모는 약 7,000명으로, 전체 직원의 약 20%에 해당한다고 합니다(벤 바자린 인터뷰 기준). 말 그대로, 아주 진지한 베팅인 셈이죠.

Part 2. 중요한 건, AI가 어디서 실행되느냐의 문제

퀄컴, 엔비디아, AMD의 발표 모두를 관통하는 핵심 메시지는 하나였습니다.

AI는 ‘가장 좋은 칩’을 중심으로 재편되고 있는 게 아니라, ‘AI가 어디서 실행되느냐’를 기준으로 컴퓨팅을 재구성하고 있다는 겁니다.

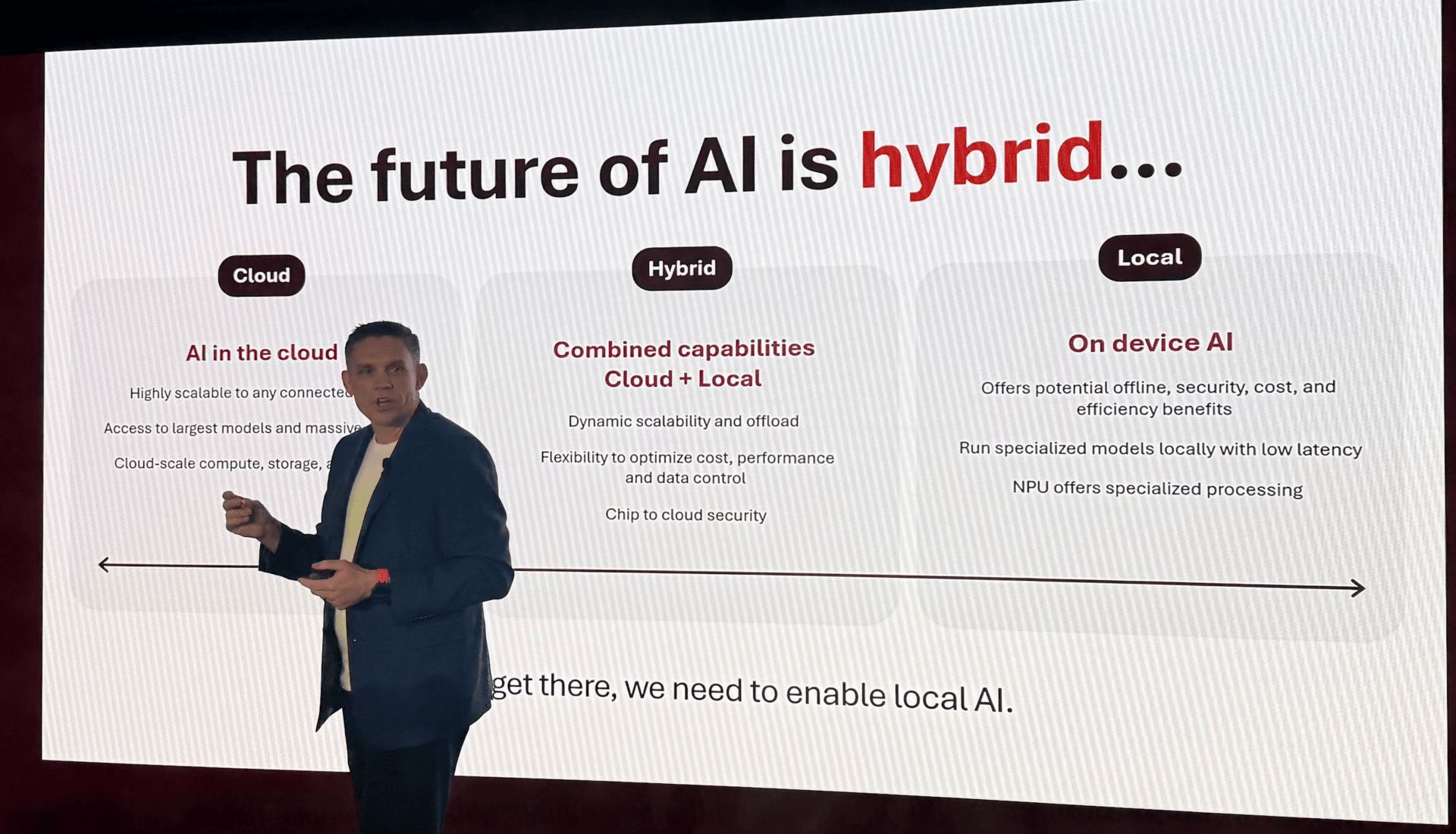

퀄컴의 Snapdragon X2 전략은 클라이언트 단의 변화를 가장 명확하게 보여줍니다. 발표 내내 반복된 키워드는 ‘always-on 경험’이었고, 그걸 배터리 소모나 팬 소음 없이 어떻게 유지하느냐가 핵심 질문이었습니다.

Snapdragon X2 Plus와 X2 Elite는 약 80 TOPS NPU를 베이스라인으로 제시하면서, Windows 기능과 서드파티 애플리케이션의 일부 워크로드를 NPU로 이전하는 생태계 전략을 함께 내세웁니다.

이런 변화는, 생각해보면, 결코 작은 게 아닙니다: PC가 상시적으로 쓰레드를 요약하고, 오디오를 캡셔닝하고, 영상을 개선하고, ‘설정 에이전트’를 구동하게 된다면, 그 때는 NPU가 더 이상 옵션이 아니라 항상 켜져 있는 핵심 서브시스템이 됩니다.

무대에 함께 오른 마이크로소프트의 존재는 이 아키텍처 관점의 전제에 무게를 더했습니다. 장기적으로는 Hybrid AI라는 설계 방향을 목표로 두고, 무거운 추론은 클라우드에서, 지연에 민감한 백그라운드 작업은 로컬에서 처리하는 구조라는 점입니다.

퀄컴 발표에서, 마이크로소프트의 James Howell. Image Credit: 튜링포스트

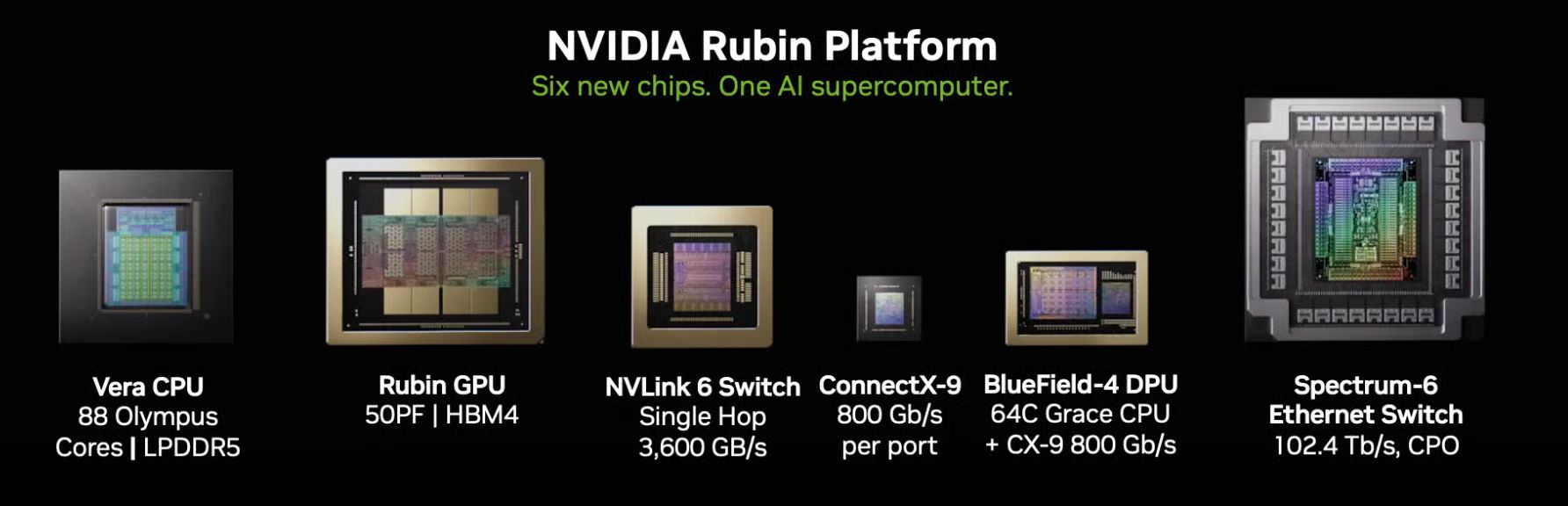

엔비디아는 정반대의 극단에 있는 접근을 취합니다. 중앙집중형 연산, 그리고 ‘현실 배포→검증→개선으로 이어지는 운영 루프’입니다. 그리고 그걸 상징하는게 바로 Vera Rubin입니다. NVIDIA는 이걸 Vera CPU, Rubin GPU, NVLink 스위치, ConnectX 네트워킹, BlueField DPU, Spectrum-X 네트워크를 통합한 랙 스케일 플랫폼으로 설명하는데, 핵심은 토큰당 비용, 처리량, 신뢰 가능한 컴퓨팅입니다.

Vera Rubin은 대규모 학습과 추론을 염두에 두고 설계된, 일종의 ‘AI 공장(Factory)’에 가깝습니다. 이 단계에서의 한계는 연산 성능 자체가 아니라, 메모리 대역폭과 칩 간 연결, 전력 공급, 그리고 자원을 얼마나 효율적으로 쓰느냐에 달려 있습니다.

한편 NVIDIA는 ‘Physical AI’라는 이름으로, AI를 실제 세계로 가져오는 전체 구조를 만들고 있습니다.

월드 모델과 로보틱스 모델, 시뮬레이션 도구, 엣지 하드웨어가 따로 노는 게 아니라 하나의 순환 구조로 연결됩니다.

모델을 학습시키고, 가상 환경에서 충분히 시험한 뒤, 그 결과를 로봇이나 차량 같은 실제 하드웨어에 배포하는 방식입니다.

Alpamayo는 자율주행을 위한 오픈형의 추론 VLA 모델이고, Jetson T4000은 이를 실제 로봇과 차량에 적용하기 위한 Blackwell 기반 엣지 플랫폼으로 자리 잡고 있습니다. 로보틱스 개발자 입장에서는, 연구에서 실제 배포로 넘어가기 위한 현실적인 업그레이드 경로라고 볼 수 있죠. 그리고 늘 그렇듯, NVIDIA는 가장 준비된 모습으로 무대를 장악했습니다.

AMD의 키노트는 앞서 본 두 흐름을 하나로 잇는 역할을 했습니다. 핵심 메시지는 분명했습니다. AI 컴퓨팅의 미래는 ‘이질성(Heterogeneity)’에 있다는 겁니다. 클라우드 랙, PC, 엣지, 그리고 과학을 위한 컴퓨팅까지 — 이 모든 영역이 서로 다른 시장이 아니라, 하나의 수요 곡선 위에 놓여 있다는 시각이었습니다. 그래서 “AI Everywhere, for Everyone”이라는 문구가 여러 차례 반복됐습니다.

AMD의 Helios 랙 스케일 플랫폼과 MI455 가속기는 데이터센터 영역을, Ryzen AI는 PC와 같은 클라이언트 환경을 대표합니다. 접근 방식은 퀄컴과 다르지만, 로컬 AI 컴퓨트를 기본값으로 만들겠다는 방향성 자체는 동일합니다. AI가 특정 환경에 국한되지 않고, 어디서나 자연스럽게 동작해야 한다는 전제입니다.

무대 구성 역시 인상적이었습니다. Lisa Su는 Fei-Fei Li, Greg Brockman, Ramin Hasani, Michael Kratsios, John Couluris 등 다양한 분야의 연사들을 한 무대에 올리면서, AI의 기술적·사회적 파급력을 함께 조망했습니다.

또 하나 분명히 한 점은, AMD가 정부와 협력해서 AI 교육에도 본격적으로 투자하고 있다는 사실이었습니다. 단기적인 제품 경쟁을 넘어서, AI가 확산되는 기반 자체를 함께 만들겠다는 메시지로 읽혔습니다.

Lisa Su가 이끄는 AMD, 정부와 손잡고 AI 교육에 본격적으로 힘을 싣고 있음. Image Credit: 튜링포스트

이 모든 흐름을 종합해 보면, 각 기업이 바라보는 경쟁 구도는 꽤 분명해집니다.

퀄컴은 소비자 가격대에서 상시적인 로컬 추론이 가능한 환경을 만드는 데 집중하고 있습니다. 배터리, 발열, 안정성을 전제로 한 현실적인 목표죠. 항상 켜져 있으면서도 부담 없이 작동하는 AI를 PC와 개인 디바이스의 기본 기능으로 만들겠다는 접근입니다.

AMD는 클라우드와 디바이스를 잇는 연속적인 포트폴리오를 구축하고 있습니다. AMD의 전제는 분명합니다. 이질성(Heterogeneity)은 과도기가 아니라, AI 컴퓨팅의 상수(Constant)라는 것. 서로 다른 환경과 워크로드를 하나의 흐름으로 연결하는 인프라가 경쟁력이 된다는 판단입니다.

엔비디아는 여기서 한발 더 나아갑니다. 중앙의 컴퓨트, 시뮬레이션, 그리고 엣지 배포를 하나로 묶어 AI를 산업 시스템으로 재정의하고 있습니다. 지능형 시스템이 만들어지고, 검증되고, 실제 세계에 배포되는 전 과정을 하나의 루프로 장악하려는 전략입니다.

정말로 흥미로운 시기입니다. 이 순간이, 혹시 우리가 오래전부터 이야기해 온 특이점(Singularity) 의 출발점일까요?

적어도 이제는, 그 질문을 가볍게 던질 수만은 없는 시점에 와 있다는 것은 분명해 보입니다.

금주의 주목할 만한 업계 동향 📰

돈으로 시간을 사고 있는 메타

메타가 20억 달러 규모로 Manus를 인수했는데요. 중론에 따르면, 이건 메타의 장기적인 로드맵이라기보다, 다소 즉각적인 대응에 가까워 보입니다. 메타가 이 인수 건을 통해서 가져오게 된 것은, 결국 복잡한 작업을 자율적으로 수행하도록 설계된, 오케스트레이션 중심(Agent-First)의 에이전트인데요. 여전히 명확한 방향성보다는 메타의 긴박함을 보여주는 한 수인 것 같습니다.

특히 이 인수 시점이, 메타의 수석 AI 과학자였던 Yann LeCun이 회사를 떠나 새로운 연구 중심 AI 연구소 AMI를 설립하겠다고 밝힌 직후라는 점에서 더 의미심장합니다. 그동안 AI에 대해 강한 제스처를 보여왔던 메타지만, 전체 전략의 일관성은 오히려 흐트러지고 있는 것처럼 보입니다.

솔직히 말해서, 지금의 메타에서는 마크 저커버그가 정확히 뭘 하려고 하는 건지 모르겠습니다. 그리고 메타를 떠나는 길에 오른 Yann LeCun은 파이낸셜타임스와의 최근 인터뷰에서 놀랄 만큼 직설적인 말을 남겼죠: “우리는 어리석음(Stupidity) 때문에 고통받고 있다.”

Boston Dynamics + DeepMind: 두뇌와 근육의 결합

Boston Dynamics와 Google DeepMind가 손을 잡았습니다. 목표는, 그동안 ‘힘’으로 유명했던 로봇에, 진짜 두뇌를 얹는 것이죠.

CES 2026에서 공개된 이번 파트너십은 DeepMind의 Gemini Robotics AI를 차세대 Atlas 휴머노이드에 결합하는 내용입니다. 단순히 더 민첩한 로봇이 아니라, 상황을 이해하고 판단하는 로봇을 만들겠다는 선언에 가깝습니다.

운동선수 같은 로봇부터, 엔지니어처럼 생각하는 로봇까지. 이 조합은 산업 자동화의 성격 자체를 다시 정의할 준비를 하고 있습니다. 이제 로봇은 단순히 “잘 움직이는 기계”가 아니라, 생각하는 작업자에 가까워지고 있습니다.

아마존 알렉사의 재도약

CES 2026에서 아마존은 하나의 분명한 메시지를 던졌습니다. 바로, 모든 길은 알렉사로 통한다는 선언입니다.

아마존은 웹과 모바일을 넘어서, 이제는 BMW 차량 대시보드부터 Bosch 커피머신까지 아우르는 통합 AI 비전을 공개했습니다. 그 중심에는 Alexa+가 있습니다. 아마존이 그리는 알렉사는 더 이상 스피커 속 음성 비서가 아니라, 어디에나 존재하는 AI 인터페이스입니다.

한편 Ring은 화재 감지 기능과 자체 앱 스토어로 한층 더 똑똑해졌고, Fire TV는 콘텐츠 소비를 넘어 ‘아트 큐레이터’ 역할까지 넘보고 있습니다. 이 모든 흐름은 결국 Alexa.com으로 수렴됩니다.

아마존이 노리는 건 명확합니다. 당신의 일상을 가장 잘 알고, 가장 자주 등장하고, 항상 옆에 있는 디지털 컨시어지가 되는 겁니다.

한 걸음 떨어져서 보면, 세 회사, 세 장면 모두의 메시지는 동일합니다: AI는 더 이상 “무엇을 할 수 있느냐”의 문제가 아니라, 누가 얼마나 일관된 그림으로 밀어붙이느냐의 문제로 접어들고 있다는 겁니다.

그리고 그 균열과 결합의 순간들이, 올해 CES 2026에서 동시에 명확하게 드러난 것 같네요.

튜링 포스트 코리아는 독자들의 응원으로 만들어집니다. 가치있는 컨텐츠를 지속적으로 여러분과

공유할 수 있도록, 커피 한 잔으로 힘을 보태주세요 ☕

읽어주셔서 감사합니다. 프리미엄 구독자가 되어주시면 튜링 포스트 코리아의 제작에 큰 도움이 됩니다!