캐즘(Chasm)을 넘어서기

마이크로소프트에 따르면, MS 윈도우는 매달 14억 대의 기기(Device)에서 활성화되고 실행되고 있다고 합니다. 아마 이 숫자들 중 상당수는 기업의 중간 관리자급 직원, 학교, 관공서, 공공기관 등, 겉으로 보기에는 화려하지 않을지 몰라도 실제로 중요한 일들이 굴러가는 곳들이겠죠.

이런 기관들의 업무 환경에서는, 아마 많은 경우에 명시적으로(Explicit) ‘AI를 도입하겠다’는 이야기가 들리지 않는 곳일수도 있어요 - 그냥 컴퓨터를 켜면, AI가 이미 그 안에, 여러 가지 도구에 들어와 있을 수 있으니까요.

저 개인적으로는, ‘애플 인텔리전스’가 그런 역할을 꽤 의미있게 하지 않을까 생각했는데요. 하지만 점점 더 명확해지는 건, 초기의 AI 수용자들 - 얼리 어답터라고 하죠 - 과 초기에 AI를 받아들이게 될 대중들 간의 갭(Gap)을 실제로 메꾸고 있는 건, 마이크로소프트인 것으로 보인다는 겁니다.

캐즘(Chasm)을 건너는 자는 누구일까요?

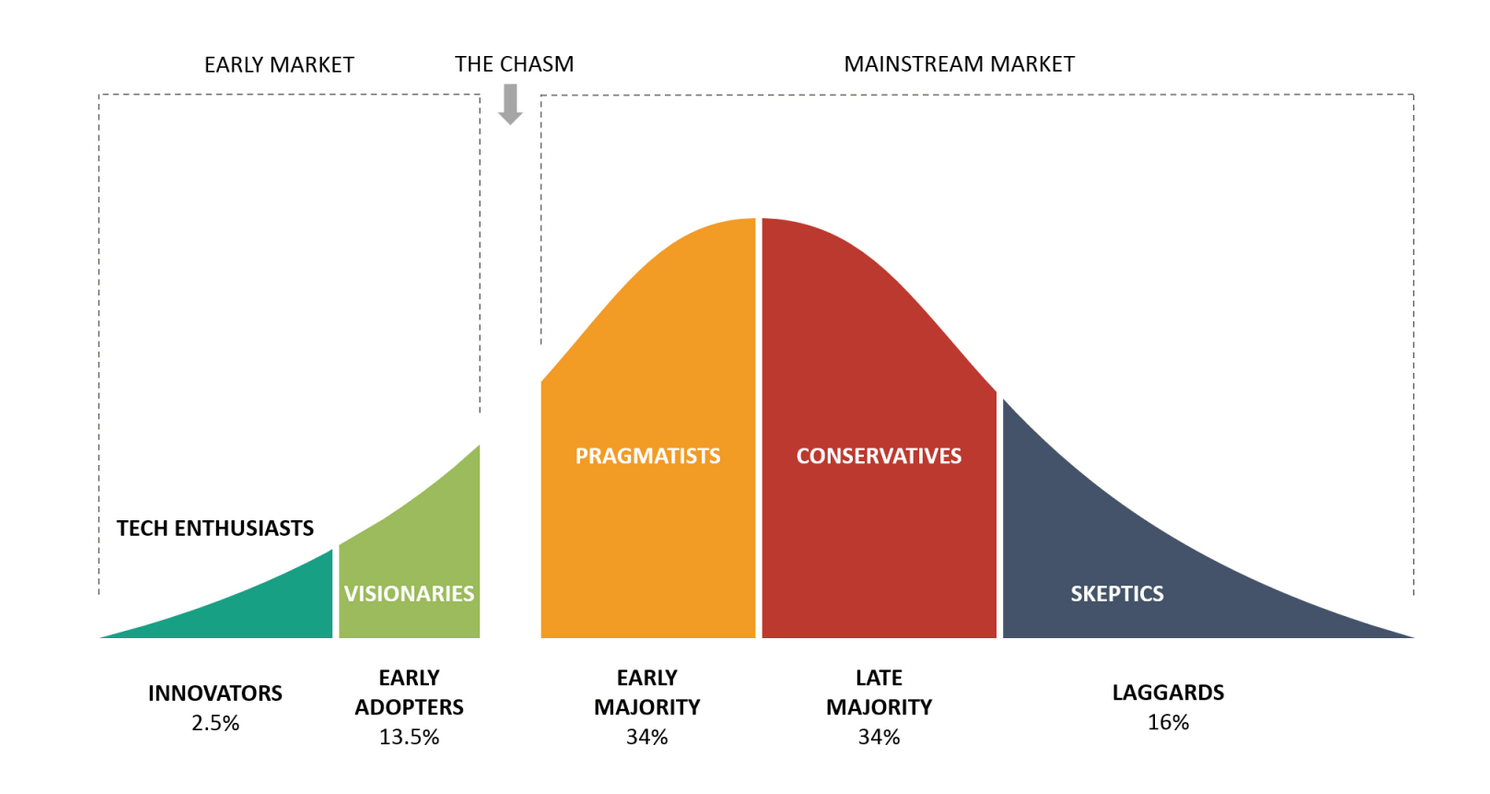

혹시 ‘캐즘(Chasm)’의 개념이 익숙하지 않으시다면 - 크로싱 더 캐즘(Crossing the Chasm)이라는 책은 제프리 무어가 1991년에 쓴 기술 전략서인데요, 새로운 기술의 상당수가 ‘초기 열성 사용자’와 ‘주류 사용자’ 사이의 간극, 그 갭을 넘지 못하고 사라진다는 개념을 중심으로 합니다.

초기 수용자들은 새로움과 가능성에 열광하지만, 초기의 대중은 제품이 바로 작동하고, 기존의 워크플로에 자연스럽게 연동해서 들어맞고, 자기가 해야 할 일을 다시 번거롭게 정의를 할 필요가 없을 때, 그 때서야 신기술을 적극적으로 받아들이고 움직이기 시작합니다.

마이크로소프트가 과연 초기의 대중들이 요구하는, 이 모든 것들을 갖추고 있을까요?

바로 얼마 전 막을 내린, 샌프란시스코에서 열린 Microsoft Ignite에 튜링 포스트 팀이 참여했는데요, 자그마치 2만명이 넘는 사람들이 모여 엄청난 열기를 보여줬다고 합니다. ‘파운드리’나 ‘애저’ 이야기를 하려나 하실 수도 있지만, 그 이야기는 지난 5월 열린 Microsoft Build 이야기를 다룰 때 다 했었구요.

오늘의 핵심은, Microsoft가 이야기하는 그 모든 개념이 실제 사용자의 눈 앞에 ‘현실’로 나타나고 있다는 겁니다 - 네, 바로 그 단어, ‘사용자(User)’가 핵심입니다.

오픈AI의 주간 이용자가 8억 명이라고 하죠 - 정말 엄청난 숫자인 건 맞아요. 하지만 제가 보기에, 이 사람들은 대부분 ‘명확한 의도, 의지를 가진’ 사람들에 가깝다고 생각합니다. URL을 입력하고, 가입도 하고, 새로운 모델이 나올 때마다 궁금해 하면서 찾아오는 사람들 말이예요. 이건, 초기 수용자의 상한선(Upper Limit)일 겁니다.

반면에, Microsoft는 여러분의 ‘호기심’을 필요로 하지 않습니다. 그걸 필요로 하지 않는 상태를 계속해서 만들어가고 있는, 또 이미 상당 부분 구축해 놓은 사업자이기도 하죠. 그래서, 이미 깔려있는 Microsoft의 소프트웨어가 있다면, 게임은 끝이라는 뜻이 되기도 합니다.

앞에서 이야기한 대로, Microsoft Window는 매달 14억 대에 달하는 활성화 기기가 있고, 그 중 상당수는 중간 관리자급 기업 직원들, 학교, 정부기관, 공공기관 등, 겉으로는 화려해 보이지 않아도 엄청나게 중요한, 현실의 일이 굴러가는 현장에 있습니다. 이 사람들은 ‘AI를 도입’하지 않는 사람들이예요 - 그런 생각조차 할 필요가 없다는 뜻입니다. 그냥 컴퓨터를 커면, AI가 Microsoft의 도구들과 함께 이미 거기 있을 테니까요.

Microsoft는 이걸 위해서 강력한 ‘중력 장치 (Gravity Machine)’를 만들고 이번 Ignite에서 보여주고 있었습니다:

먼저, Agent를 일종의 조직에 있는 구성원의 하나로 공식화했습니다. Entra에서 정체성을 부여하고, Agent 365라는 제어 플레인을 제공합니다. 그 다음으로, 프로토콜 계층에서는 MCP가 Microsoft 기술의 모든 스택 - MS365, Dynamics, Power Platform, Dataverse, 결정적으로 Windows - 전반에서 도구(Tool)과 에이전트 간의 대화를 하게끔 해 주는 ‘통신 소켓’이 됩니다.

그 다음은 운영체제 자체입니다. Windows는 이제 에이전트가 살아가는 ‘서식지(Habitat)’ 그 자체로 포지셔닝되었습니다. 단순한 UI가 아니라요. Agent Workspace는 행위(Action)를 격리하고, 파일 및 설정 커넥터는 로컬 컨텍스트를 노출합니다. 작업 표시줄(Taskbar)은 일상적인 작업을 시작하는 ‘진입점’이 되구요 - 특별한 별도의 입력창이 아니라, 항상 존재하는, 그리고 아주 익숙한 인터페이스죠.

데이터 측면에서도 Work IQ, Fabric IQ, Foundry IQ가 일종의 ‘의미 기반 메모리’처럼 기능하게 될 겁니다 — 사용자, 조직이 알고 있는 것, 사용할 수 있는 것을 이해하는 메모리 말이죠. 보안과 컴플라이언스도 드디어 완전하게 연결됩니다. Purview와 Defender가 종합적으로 ‘정책’ 기반으로 에이전트의 행동을 관찰합니다.

이 그림에서라면, 그대로 작동한다면, AI는 더 이상 ‘제품’이 아니라 이미 우리에게 익숙한 ‘시스템의 일부’가 될 것 같습니다. 즉, AI가 일상이 되게끔 하겠다는 겁니다.

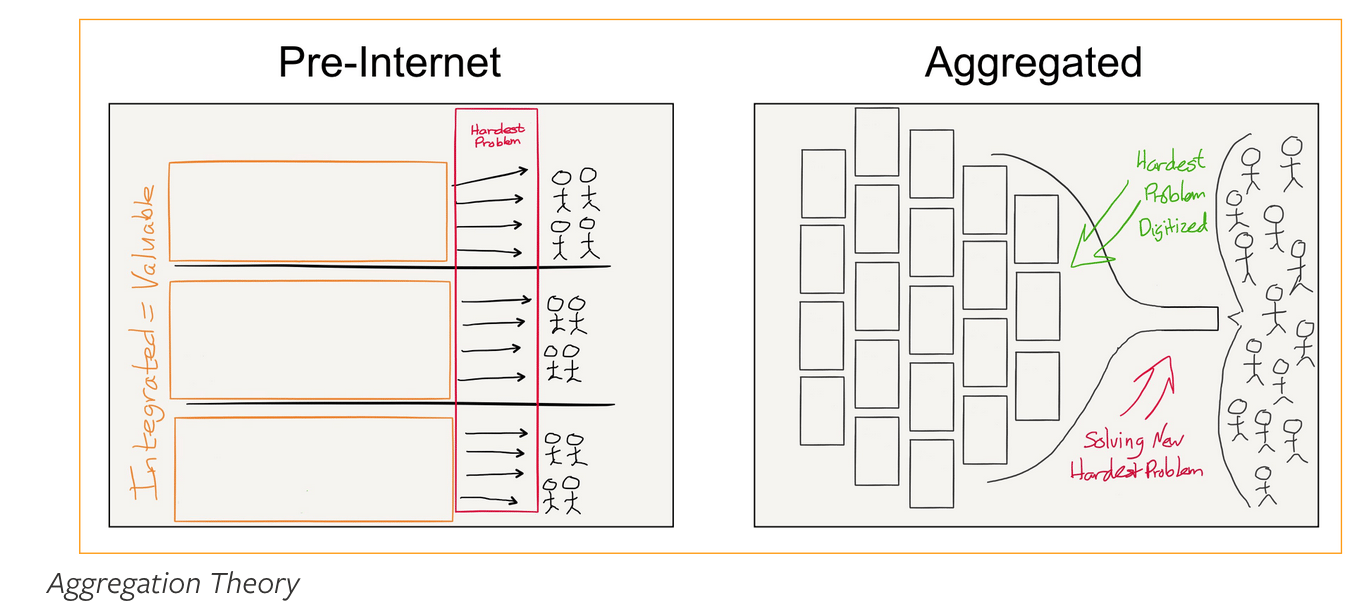

이게 어쩌면 진짜 Microsoft의 힘일지도 모르겠습니다 — 이번 Ignite의 발표들을 보면서, 벤 톰슨(Ben Thompson)이 몇 년 전 썼던 말이 떠올랐습니다: “플랫폼이 승리하는 이유는 더 나은 UX 때문이 아니라, 기본값(Default)으로서의 집적(Aggregation) 때문이다”라는 말이었는데요. AI가 반드시 주목을 끌 필요는 없습니다. 필요한 것은 배포/채널(Distribution)에서의 승리인, 그런 단계에 도달하려는 강력한 움직임이라는 생각이 듭니다.

그리고 지금 Windows, Entra, MCP가 노리고 있는 지점이 바로, 역사적으로 Microsoft가 잘 해 온, 바로 그 지점입니다.

Image Credit: Ben Thompson’s Aggregation Theory

최근의 인터뷰에서, MS의 CEO 사티아 나델라도 위에서 이야기한 내용들을 포함한 새로운 개념을 언급하기도 했습니다: 바로, AI를 위한 컴퓨터(Computers for AI)라는 용어를 사용하면서요.

사티아 나델라의 인터뷰에서 마케팅 요소를 모두 걷어내면, 아주 명확하게 Microsoft가 목표하고 있는 아키텍처가 드러납니다:

트레이닝 컴퓨터 – Azure 위에 Foundry가 올라가 있고, 모델 간 라우팅을 담당하고, 에이전트를 호스팅하고, 멀티 에이전트 플랜을 조정하고, 비용과 품질을 평가하는 계층입니다.

컨텍스트 컴퓨터 – Fabric IQ, Work IQ, Foundry IQ로 구성된 권한 기반의 의미 레이어로, 에이전트가 사람·데이터·태스크의 ‘실시간 뷰’를 볼 수 있게 해줍니다.

에이전트 컴퓨터 – Windows, Microsoft 365 앱, 그리고 Edge가 포함되는데, 실제 행동이 클라우드에서만이 아니라 사용자의 PC에서, 즉 파일과 브라우저 근방에서 일어나는 계층입니다.

거버넌스 컴퓨터 – Entra, Purview, Defender, Agent 365로 구성된 정체성·정책·감사를 담당하는 ‘척추’입니다.

즉, 트레이닝, 메모리, 액션, 법/규정(Law), 이 네 개의 레이어로 정리된, 정렬된 구조가 이미 수십억 대가 설치되어 있는 Microsoft 소프트웨어 스택 위에서 돌아간다는 겁니다.

그리고, 아래는 사티아 나델라가 가장 최근에 올린 트윗입니다:

Microsoft가 이번 Ignite에서 이야기하고 싶었던 건, 어쩌면 ‘진짜 마진 풀(real margin pool)이 Foundry, Copilot, Agent 365, 그리고 Azure 위의 다양한 모달들에 형성되는데 우리는 베팅한다’는 이야기일지도 모르겠습니다. 여기서는 ‘토큰’이 기업의 정책 아래에서 자연스럽게 워크플로우로 변환됩니다.

물론, 여전히 벽, 즉 한계는 있을 수 있습니다.

어떤 기업이 이미 전체적으로 Microsoft 환경에서 IT를 운영하고 있다면, 이 경우에는 변화의 경로가 상대적으로 짧고 단순하겠죠. 에이전트가 Windows Update와 테넌트 정책을 통해서 자연스럽게 기업 환경에 녹아들어올 겁니다.

하지만 Microsoft 기반의 체계, 시스템이 아닌 경우라면, 운영 체제를 바꾸는 일은 그 자체로 엄청난 부담입니다. 바로 이 지점에서, ‘성장 의지’가 단순한 기능 경쟁보다 더 중요한 요소가 됩니다. Microsoft는 전환 비용이 낮고, 가치가 명확한 곳부터 확장할 겁니다, 아마도요.

Microsoft의 전략과 관련해서, 앞으로 주목해야 할 세 가지 지점이 있습니다:

1) AI PC

NPU, 음성 입력, 에이전트 워크스페이스, 간단한 Copilot 체험 기능을 탑재한 하드웨어로, 오픈AI 계정을 만들 일이 없었던 가정이라든가 소규모 기업을 대상으로, 이 AI PC가 스스로도 모르는 사이에 AI를 사용하게 될, 자연스러운 중간 다리의 역할을 할 겁니다.

2) GitHub

개발자의 ‘습관을 형성하는 엔진’이죠. “이 이슈를 코딩 에이전트에 할당”하는 작업이 너무나 당연하고도 안정적인 습관이 되는 순간, 원래 Microsoft AI를 도입할 계획이 없던 회사들에서도 더 빨리 코드를 배포해야 할 테니, 이 도구를 사용하게 될 겁니다.

3) 전략적인 협업이나 인수 가능성

개인적으로, 허깅페이스(Hugging Face)는 Microsoft의 강력한 위상을 AI 시대로 이어나가기 위해 필요한, 이상적인 파트너로 보입니다.

4) 자기만의 성(Castle) 바깥으로 확장될 MCP

앞으로 Atlassian, Salesforce, ServiceNow, SAP나 Snowflake 등이 자사의 MCP를 공식적으로 오픈한다면, Microsoft의 Teams나 Windows는 다양한 SaaS·엔터프라이즈 도구가 MCP로 직접 연결하게끔 하는 기업용의 ‘통합 조율 센터’ 같은 포지셔닝을 가지게 될 수 있습니다.

Microsoft의 전략은 이미 분명해지고 있는 것 같습니다. 이번 Ignite를 통해서 더욱 명확해졌구요.

앞으로 지켜볼 건, 정말 Microsoft가 아직 “AI가 호기심의 대상”인 세상에 살고 있는 우리 모두를 “AI가 일의 기본값”인 세상으로 이동시켜 줄 수 있는가 하는 점일 겁니다.

바로 그 순간이 - Microsoft가 성공한다면 - 바로 AI 기술이 ‘캐즘’을 건너게 되는 순간일 테니까요.

튜링 포스트 코리아는 독자들의 응원으로 만들어집니다. 가치있는 컨텐츠를 지속적으로 여러분과

공유할 수 있도록, 커피 한 잔으로 힘을 보태주세요 ☕

트위터 라이브러리 (Twitter Library) 🐦

Yann LeCun과 Randall Balestriero가 JEPA(Joint-Embedding Predictive Architecture)의 중요 이론을 다시 정리하고, 실제로 효율성있게 적용해 볼 수 있는 새로운 버전, LeJEPA를 공개했습니다. 이 때쯤 한 번 다시 JEPA에 어떤 유형이 있는지 확인해 보는게 좋겠다는 생각이 들어서, 최근에 등장한 JEPA 변형 모델 7가지, 그리고 대표적인 고전 JEPA 5가지를 함께 정리해 봤습니다:

튜링포스트 팀이 보고 있는 것들

AI Slopaganda in the KMT Election by ChinAI

국민당의 2025년 당대표 선거를 둘러싼 AI 기반의 프로파간다 작전이 드러난 모양입니다. 다양한 유튜브·틱톡 계정으로 대만 정치와 무관한 콘텐츠로 청중을 모은 뒤에, 갑작스럽게 친중(親中) 후보인 Cheng Li‑wun을 지지하는 딥페이크 영상으로 방향을 전환했고, 그 규모·타이밍 모두가 조직적인 개입을 가리키고 있다고 합니다. 이 작전에서는 영상의 퀄리티보다 생산의 스피드와 알고리즘 친화성에 집중했다고 하는데, 알고리즘의 힘을 활용해서 선거 담론을 미묘하게 바꾸려는 시도로 해석된다고 하네요.

The Myth of China's "AI Talent Pipeline" by ChinaTalk

중국의 AI 인재 파이프라인이 표면적으로는 놀라울 만큼 빠르게 성장하고 있지만, 실제로는 극심한 경쟁, 높은 탈락률, 정신건강 위기라는 그림자도 함께 드러나고 있다고 합니다. STEM 올림피아드 준비에서부터 명문대 진학, 박사 과정, 연구 발표에 이르기까지 단계마다 '탈락과 포기'가 사실상 전제된 구조가 존재하고, 그 과정에서 자살 사례도 보고되고 있습니다. 이런 현실은 “우수 인재가 많다”는 통상적인 청사진 뒤에 숨겨진 인간적 비용(Human Cost)을 명백히 보여줍니다 - 물론 이게 AI 부문에서만의 일은 아니겠죠.

Will it be a Home Run for Alibaba? by AI Supremacy

알리바바 그룹이 AI + 클라우드 + 커머스를 축으로 하는 전략을 본격화하고 있습니다. 이커머스 영역의 대 행사인 11월 11일 이후, 클라우드의 대규모 투자, Open-Weight 모델 ‘Qwen’ 공개, 에이전트 중심 애플리케이션 적용 등 다양한 축에서 동시에 움직이고 있는데요. 그 성공 여부는 “소비자(Commerce) → 클라우드(Cloud) → 모델(Model) → 에이전트(Agents) → 앱(Apps)”이라는 구조가 얼마나 현실의 수익으로 연결되느냐에 달려 있겠죠. (개인적으로 이 구조가 직관적으로 와닿지는, 아직은, 않습니다만) 다만 미국 빅테크 대비 자본투입 규모에서 여전히 차이가 있다는 점이 향후 변수입니다.

금주의 주목할 만한 업계 동향 📰

Google의 Gemini 3 모델 출시

구글이 새로 내놓은 Gemini 3, 멀티모달 능력과 고급 추론 기능이 크게 향상된 모델로, 실제 사용자 경험에서도 이전 세대보다 일관성 있고 안정적인 ‘작업 파트너’ 수준으로 향상되었다는 평가가 전반적으로 많습니다. 물론, 여전히 복잡한 맥락이나 세부적인 제어 관점에서는 개선의 여지가 있겠지만, Ethan Mollick이 이야기한 것처럼 “아주 좋은” 평가를 받고 있다고 보면 될 것 같고, 단순히 벤치마크 수치도 수치지만, 실제적인 사용의 감각으로 봤을 때 “AI가 지난 3년간 얼마나 먼 길을 걸어왔는가를 보여준다”는 표현이 맞는 것 같습니다.

참고로, 주실밸의 Ian Park이 쓰신 글도 한 번 보시면 좋을 것 같습니다.

Quora의 미션 업그레이드

요즘 Quora를 쓰는 사람이 얼마나 많은지는 잘 모르겠지만, Adam D’Angelo는 이제 Quora의 핵심이 ‘지식을 공유하는 공간’이 아니라, “집단 지성(Collective Intelligence)”을 키우는 데 있다고 봅니다. Poe는 이제 개인 채팅에서 멀티모달 질의를 처리하고, Quora는 공적인 타운홀 형태를 유지하면서, 사람과 AI의 시너지를 통해 문제 해결, 기술 발전, 그리고 물론 ‘참여도’를 높일 수 있다고 믿는 모습입니다. 글쎄요, 바라는 바대로 잘 작동할지는 지켜봐야겠죠.

오픈AI, GPT-5.1 출시 및 톤 조절 기능 추가

GPT-5.1이 출시되면서 Instant 모델과 Thinking 모델 모두 업데이트되었습니다. 응답은 더 자연스럽고, 추론은 상황에 더 잘 적응해서 이루어지고, 모델의 응답 톤은 사용자가 더 세밀하게 조절할 수 있도록 바뀌었다고 합니다. 전반적으로 대화를 더 따뜻하게 만들고, 사용자 통제력을 높이려는 방향인 것 같은데요. 하지만 제 개인적인 경험으로는 썩 만족스럽지 못했습니다. ChatGPT가 처음 나왔을 때 이후로 처음으로, “구독을 취소해야 하나?”라는 생각이 들 정도였습니다(Pro 요금제 사용 중인데 말이죠).

오픈AI는 GPT-5.1 프롬프트 가이드도 공개했는데, 일부 시스템 프롬프트의 성격과 모델의 ‘성향’을 엿볼 수 있어서 흥미롭습니다. 효율적으로 프롬프트를 쓰는 팁도 일부 포함되어 있습니다.

DeepMind, SIMA 2로 3D 환경에서 행동하는 AI 선보여

DeepMind에서 공개한 SIMA 2, Gemini 기반으로 복잡한 3D 가상 환경에서 추론하고, 행동하고, 학습할 수 있는 에이전트입니다. 이전 버전과는 달리 SIMA 2는 단순히 지시를 따르는 데 그치지 않고, 스스로 적응하고, 의사결정을 왜 그렇게 했는지 설명하고, 셀프 플레이를 통해 점진적으로 개선된다고 합니다. 훈련하지 않은 게임에서도 테스트를 했는데, 상당히 좋은 일반화(Generalization) 능력을 보였습니다. 이건 구체화된 Emdobied AI로 나아가는 중요한 단계라고 할 수 있을 테지만, 여전히 장기 기억과 정밀한 행동 제어 같은 난제는 여전히 남아 있습니다.

Claude 4.5, 정치적 편향성 문제 ‘신중하게’ 다루기

앤쓰로픽에서 Claude의 정치적 중립성에 대한 상세 보고서를 내놓았습니다. “균형성(Even-Handedness)”을 측정하는 새로운 자동화 테스트를 도입했는데, Claude Sonnet 4.5는 GPT-5와 Llama 4보다 높은 점수를 기록했습니다. Grok 4, Gemini 2.5 Pro와 비슷한 수준이었습니다. 앤쓰로픽은 이 방법론을 오픈소스화해서, AI의 정치적 편향을 측정하는 공통 표준을 만들겠다는 목표를 밝히고 있습니다.

새로 나온, 주목할 만한 연구 논문

‘주목할 만한 최신의 AI 모델’을 먼저 소개하고, 각 영역별로 ‘Top Pick’은 해당 논문 앞에 별표(🌟)로 표시했습니다!

주목할 만한 최신 AI 모델

🦋 NVIDIA open sourced Apollo

NVIDIA가 Apollo를 공개했습니다. Apollo는 유체역학, 전자기학, 멀티피직스 등 산업 시뮬레이션 분야에 최적화된 오픈 패밀리 AI 물리 모델입니다. 트랜스포머, 뉴럴 오퍼레이터, 확산 모델을 도메인 특화 지식과 결합해 성능을 끌어올렸습니다. Siemens, Applied Materials, Northrop Grumman 같은 초기 고객들은 최대 500배까지 시뮬레이션 속도가 향상된다고 이야기하고 있네요. 사전 학습된 모델과 워크플로우로 커스텀 학습, 추론, 배포를 지원하고, 항공우주·반도체·제조업 전반에서 실시간 디지털 트윈과 대체(서로게이트) 모델링을 가능하게 해 줍니다. —> [블로그 보기]Marble, a multimodal world model

World Labs 연구진이 Marble을 공개했습니다. 텍스트, 이미지, 비디오, 혹은 단순한 3D 레이아웃으로부터 3D 세계를 생성·편집·조합할 수 있는 멀티모달 생성 모델입니다. 반복적 편집, Chisel이라는 도구를 통한 세밀한 제어를 지원하고, Gaussian Splats, 삼각형 메쉬, 영상 등으로의 추출(Export)도 가능합니다. 여러 이미지를 기반으로 세계를 생성하거나, 동적으로 확장하고, 고해상도로 비주얼을 향상시키는 기능 등 덕분에 크리에이티브 산업, 시뮬레이션, 로보틱스, 공간 지능 등 다양한 분야에 활용될 수 있을 것으로 보입니다. —> [블로그 보기]

🦋 Omnilingual ASR, a speech-to-text model

Meta 연구진이 Omnilingual ASR을 발표했는데, 1,600개 이상의 언어(이 중 500개는 저자원 언어)를 지원하는 대규모 음성-텍스트 변환 모델 세트입니다. 70억 파라미터 wav2vec 2.0 인코더 위에 CTC 디코더와 트랜스포머 기반 LLM-ASR 디코더를 구성했는데, 전체 언어의 78%에서 문자 오류율 10% 미만이라는 성능을 보여줍니다. 새로운 언어의 경우에는 소수의 페어링 샘플만으로 온보딩할 수 있다고 하는데요. 메타는 350개 언어로 구성된 Omnilingual ASR Corpus와 모든 모델·도구를 함께 오픈소스로 공개했습니다.

—> [블로그 보기]

강화학습과 추론의 다이나믹스

🌟 The Path Not Taken: RLVR Provably Learns Off the Principals (by Meta AI, The University of Texas)

이 연구는 RLVR 업데이트가 가중치 공간에서 ‘주축(Principal Directions)’을 벗어난 방향으로 이동한다는 사실을 이론적으로 규명합니다. 이 관점은 모델의 기하 구조로 인해서 RL 업데이트가 종종 희소하게 보이는 이유를 설명하면서, SFT와 RL이 전혀 다른 기하학적 학습 체제를 가진다는 점을 대비시켜 보여줍니다. 미래에는 이런 인사이트를 바탕으로 기하학적인 맥락을 이해하는(Geometry-Aware) 알고리즘 개발이 가능해질 것이라고 전망합니다.

—> [논문 보기]🌟 RLVE: Scaling Up Reinforcement Learning for Language Models with Adaptive Verifiable Environments

RLVE는 언어 모델을 더 크게 확장 가능한 RL 방식으로 학습시키기 위해서, 정책에 맞춰 난이도를 자동 조절하는 400개의 검증 가능한 환경을 도입합니다. 정적인 데이터로 RL을 계속하는 것보다 이런 적응해 가야 하는 환경에서 훈련한 모델이 더 강한 일반화된 추론 능력을 보인다는 결과를 보여줍니다. —> [논문 보기]

아키텍처, 라우팅과 연산 품질의 트레이드오프

🌟🌟 Intelligence per Watt: Measuring Intelligence Efficiency of Local AI (by Stanford, Together AI)

이 연구는 8종의 가속기와 20개 이상의 로컬 LLM을 100만 개 쿼리로 테스트하는데, 정확도 대비 전력 효율(IPW, Intelligence per Watt)을 기준으로 평가합니다. 그 결과로, 로컬 모델의 성능 효율이 빠르게 개선되는 것을 보면, 하드웨어를 최적화할 여지가 여전히 크다는 점을 보여줍니다. 아주 흥미로운 논문입니다. —> [논문 보기]🌟 Teaching Pretrained Language Models to Think Deeper with Retrofitted Recurrence

이 논문은 사전 학습된 트랜스포머 모델에 ‘깊이 순환(Depth Recurrence)’을 재장착하고, 단계적 순환 학습(Curriculum)을 적용해서 유효 깊이(Effective Depth)를 크게 늘릴 수 있다는 걸 보여줍니다. 동일한 계산량 대비 기존의 사후학습 기법보다 더 나은 성능을 달성하는 모습을 보여줍니다. —> [논문 보기]🌟TiDAR: Think in Diffusion, Talk in Autoregression (by Nvidia)

TiDAR는 확산 기반의 초안 작업(Drafting)과 자기회귀형(Auto-Regressive) 샘플링을 하나의 Structured-Attention Forward Pass 안에 통합한 기법입니다. 이를 통해서 자기회귀형 모델과 동일한 품질을 유지하면서도 토큰 생성 속도는 몇 배 빨라지고 KV 캐시도 완벽하게 지원할 수 있습니다. —> [논문 보기]

읽어주셔서 감사합니다. 프리미엄 구독자가 되어주시면 튜링 포스트 코리아의 제작에 큰 도움이 됩니다!