금주의 FOD는 튜링 포스트의 100번째 FOD입니다.

튜링 포스트 코리아는 작년 하반기에 56번째 FOD로부터 미국 튜링 포스트와 협업을 시작, 글을 발행하기 시작했기 때문에 제 입장에서 ‘100호’ 같은 느낌은 아닙니다만.

처음 여러분들께 인사드렸던 메시지가 생각나네요:

“…AI에 대한 정보가 차고 넘치는 이 시대, 구독자님은 왜 튜링 포스트 코리아에 가입하셨어요? 저는, 기술 뿐 아니라 AI와 관련된 회사, 산업, 사회적 이슈 등 다양한 관점에서 어떤 일이 일어나고 있는지, 우리의 삶에 어떤 의미가 있을지 궁금해 할 모든 분들께 균형잡힌 컨텐츠를 제공하고 의견을 나누고 싶어서 튜링 포스트 코리아를 시작하게 되었습니다…”

“…FOD는 Froth On the Daydream의 약자로, 저희의 메인, 주간 뉴스레터입니다. 매주 큐레이션된 소식과 ‘의견’을 이메일로 보내드립니다. FOD는 프랑스 작가 ‘보리스 비앙’의 소설 제목인데, 상상이 가득하고 초현실적인 이야기로 유명하다고 해요. 저희도 여러분의 시선에 약간의 자극을 드리는 AI 콘텐츠를 전달하고 싶다는 바램을 담았습니다…”

처음 인사드렸던 때와 비교하면 물론 AI 씬에 엄청난 발전과 변화가 있었습니다만, 변하지 않을 것 한 가지는, 앞으로도 수없이 많은 실험이, 그리고 초현실적인 (Surrealistic) 경험도 계속될 거라는 겁니다.

튜링 포스트 코리아 잘 보고 있다는 말씀을 가끔 들을 때마다 큰 힘이 됩니다. 모든 구독자분들께 감사드리고, 앞으로도 좋은 정보와 글, 무엇보다도 ‘의견’을 여러분들과 나눌 수 있도록 하겠습니다.

AI 영역만큼 새로운 용어들이 계속해서 등장하는 분야가 있을까 싶기는 합니다만, 특히 최근에, 다시 한 번 주목해서 ‘이해해 두어야겠다’ 생각이 드는 몇 가지 ‘새로운 연구 방향’을 시사하는 용어들이 있어서, FOD를 통해서 정리하고 여러분과 공유할까 합니다.

CTM (Continous Thought Machines), Elastic Reasoning, ZeroSearch 같은 것들인데요 - 이 단어들이 왜 등장했을까, 그리고 앞으로 어떤 변화의 방향을 가리키는 걸까 깊이 생각해 본다면, 향후의 AI 모델 진화 방향은 어떤 쪽인지, ‘지능’이라는 것을 우리는 어떻게 다시 정의하고 있는지 등에 대해 단서를 얻을 수 있을지도 모릅니다.

자, 그럼 하나씩, 살짝 살펴볼까요?

연속적 사고 기계 (CTM; Continuous Thought Machines)

튜링 포스트 코리아를 통해서 몇 차례 소개한 적이 있는, 일본의 AI 스타트업 Sakana AI, 여러분들도 아실 겁니다. 이 스타트업이 어떤 방향의 연구를 하고 있는지 잘 살펴보는 건 재미도 있고 항상 의미가 있었던 것 같아요.

구글, 그리고 딥마인드에서 일했던 David Ha, 그리고 Llion Jones가 주축이 되어 설립한 이 회사는, ‘생물학적인 관점’에서 영감을 받은 모델 개발 방식으로 알려져 있죠 - 거대한 단일 구조의 모델을 키워가는 대신, 작은 모델들을 스스로 진화하면서 결합하는 방식에 집중합니다.

며칠 전인 5월 12일, Sakana AI에서 CTM (연속적 사고 기계; Continuous Thought Machines)라는 연구를 발표하면서 AI 학계에 새로운 질문을 던졌습니다. 그 질문은 바로, “시간이라는 요소가 지금 우리가 다루는 AI에서 빠져있는 한 조각이 아닐까요?”라는 겁니다.

Image Credit: Sakana AI

기존의 AI가 마치 ‘시험에서 문제를 보자마자 즉시 답을 적어내는 학생’ 같은 거라면, CTM은 ‘문제를 받고 나서 연필을 물어뜯으면서 고민하고, 계산하고, 다시 생각도 해 보는 학생’ 같다고 할 수 있을 것 같습니다 - 바로 ‘시간을 들여서 점진적으로 사고하는 과정’이 모델 자체에 내장되어 있다는 점이 핵심이죠. (이렇게 봐라 하는 프롬프트를 받고 작업하는게 아닙니다)

각각의 인공 뉴런이 과거의 입력 신호들을 기억하고, 다른 뉴런들과 시간적으로 동기화하면서 정보를 처리합니다. 타이밍이 정보가 되는 겁니다. 그래서 패턴이 ‘계층’ 뿐 아니라 ‘리듬’에서 나타나게 되겠죠. 이 곳을 보시면 비디오로 이 모델의 작동 방식을 확인해 보실 수도 있으니 꼭 한 번 들어가 보세요.

Sakana AI 팀의 표현에 따르면, ‘시간은 더 이상 제약 조건이 아닙니다; 사고의 매체 (Medium)입니다’.

CTM의 접근 방식은, AI가 즉각적이고 단순한 패턴 매칭을 넘어서, 보다 인간적인 사고의 과정을 구현할 또 하나의 가능성을 보여준다고 생각해요 - AI가 더 복잡한 추론, 창의적인 문제 해결, 시간에 따라서 변화하는 환경에 적응하는 능력을 갖추는데 중요한 기제가 될 수도 있지 않을까요?

탄력적 추론 (Elastic Reasoning)

여러분 모두 잘 아시는 세일즈포스. 세일즈포스도 Salesforce AI라는 브랜드 아래 아주 강력한 연구팀을 보유하고 있습니다.

지난 주에, Salesforce AI에서 ‘복잡한 문제를 더 효율적으로 해결’할 새로운 접근법, ‘탄력적 추론 (Elastic Reasoning)’이라는 기법을 소개했습니다.

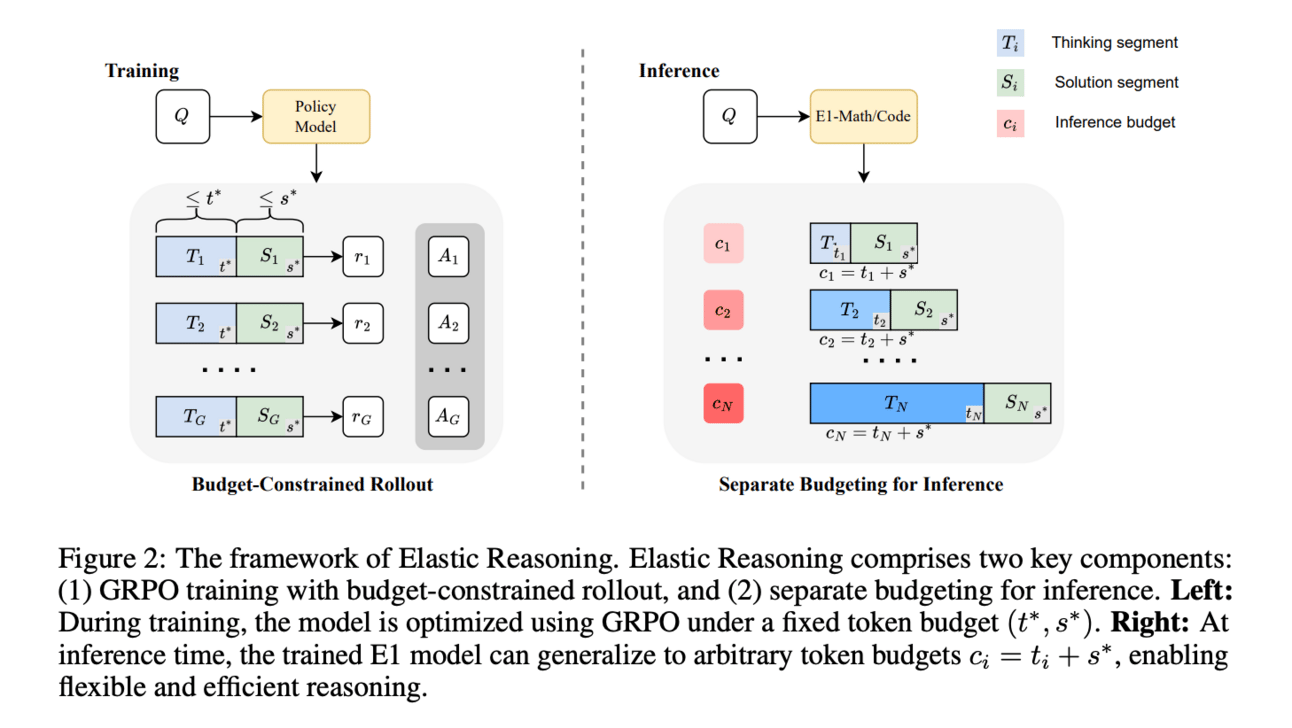

Elastic Reasoning의 구조. Image Credit: Salesforce AI

지금까지의 전통적인 모델은, 생각을 해야 하거나 복잡한 문제를 해결하려고 할 때, 상당힌 긴 CoT 체인을 만들죠. 그런데 이런 방식은, 계산을 위한 예산 (Budget)이 빠듯할 때는 그닥 현실적인 방안이 못 된다는 문제가 있어요.

Salesforce AI에서 이야기하는 ‘탄력적 추론’ 기법은 추론 작업을 ‘생각하기 (위 그림에서 Thinking)’, 그리고 ‘해결책 (위 그림에서 Solution)’, 이 두 단계로 나누는데, 각각 자체적인 예산을 가지고 있어요. 모델이 두서없이, 끝없이 장황하게 토큰을 생성하게 놔두지 않고, 탄력적 추론 기법은 ‘생각하는 과정이 조금 짧아지더라도 최종적인 답변이 항상 완성되도록’ 보장하는 겁니다.

이게 새로운 점은, ‘적응성 (Adaptability)’에 있다고 봅니다: 즉, 제약이 있는 예산을 가지고 한 번 훈련을 하면, 모델은 재훈련을 하지 않더라도 새로운 제약 조건의 경우에도 잘 일반화를 해요. 그런 일종의 ‘압박’이라고 할까요, 그런 조건 하에서도 더 좋은 성능을 내고, 그렇게 되면 제약이 없는 경우에도 더 간결하게 사고를 하고 작업을 합니다.

수학이라든가 코딩 벤치마크에서 인상적인 결과를 보여주고 있구요, 비용에 민감한 실제 환경이라면, 아마 이런 접근방법이 이후에 ‘추론 모델’을 배포하는 표준적인 기법이 될 가능성이 높다고 봅니다. 주목할 만한 가치가 있습니다.

’Zero(0)’ + X: 뭔가를 ‘안 하면서도 한다’

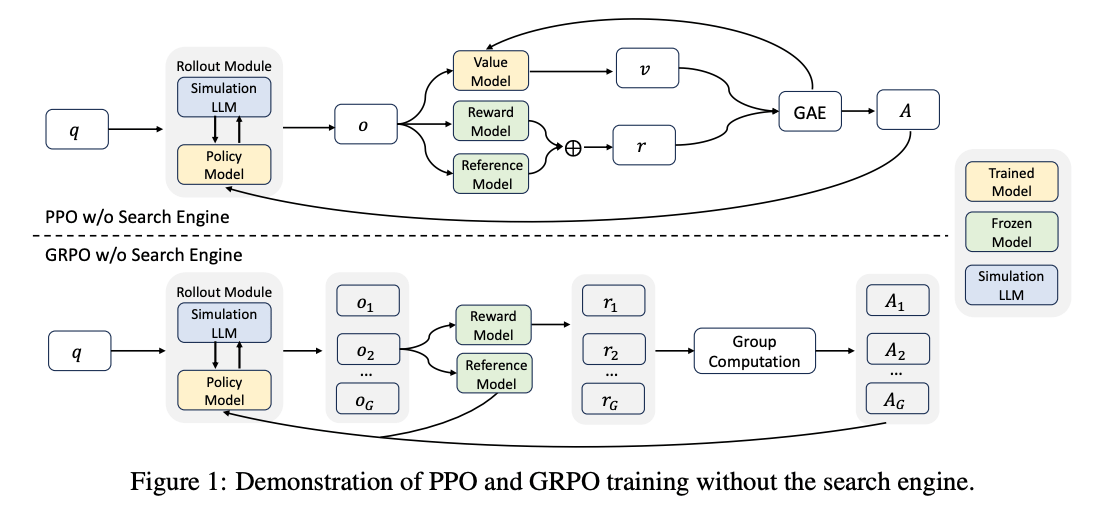

알리바바의 통이 연구소 (Tongyi Lab)에서 ZeroSearch라는 연구를 선보였는데, 이게 화제가 되고 있습니다. ZeroSearch는 LLM이 외부 API를 호출하지 않고도 검색과 비슷한 작업을 할 수 있게 하는, 새로운 강화학습 기법이라고 하면 될 것 같은데요.

여기서는, RAG이라든가 에이전트 구조의 추론 기법에서도 계속 문제가 되고 있는 일종의 병목 현상을 해결하고자 합니다. 이 병목 현상이라는 건, ‘외부의 검색 API를 쓰게 되면 수없이 많은 API 콜을 해야 하니 돈도 많이 들고 시간 지연도 되고, 아무래도 외부 API니만큼 안정성도 이슈가 될 수 있는 등의 문제’예요.

모의 검색 엔진 기반의 ZeroSearch 프레임웍. Image Credit: 알리바바

그래서, ZeroSearch는 실제 검색 엔진에 쿼리를 하는 게 아니라, 지도 학습을 통해서 파인튜닝한 LLM을 ‘모의 검색 엔진’으로 사용하는 겁니다. 이런 LLM은 쿼리에 맞춰서 고품질의 문서든, 노이즈가 있는 문서든 모두 만들 수 있으니까, 검색 환경에 대해서 원하는 대로 세밀하게 제어할 수가 있죠. 특히 주목할 만한 건, 커리큘럼 기반의 품질 저하 전략 (Curriculum-based Degradation Strategy)인데, 강화학습을 진행하는 중에 점진적으로 문서의 노이즈를 증가시켜서 - 마치 학생에게 처음에는 쉬운 문제를 주다가 점점 어려운 문제를 주는 것 같은 거죠 - 모델의 추론 능력을 확장합니다.

이 기법을 사용하면, 검색하는 부분과 정보를 활용하는 부분을 따로 나눠서, AI가 정보를 더 효과적으로 학습할 수 있게 해 줍니다 - 마치, 책을 찾는 일과 책의 내용을 이해하는 일을 구분하는 것 비슷한데요. 이렇게 해서, AI의 학습 과정이 더 안정적으로 진행됩니다.

실제 테스트에서, ZeroSearch의 140억 파라미터 모델은 Q&A 작업에서 구글 검색을 사용한 경우보다 더 좋은 결과를 보여줬습니다. 이 기법의 좋은 점은, 웹을 온라인으로 사용하지 않고도 AI에게 효과적인 검색 방법을 가르칠 수 있고, 어떤 종류의 AI 모델에도 적용할 수 있고, 스케일링하기도 쉽습니다.

또 하나.

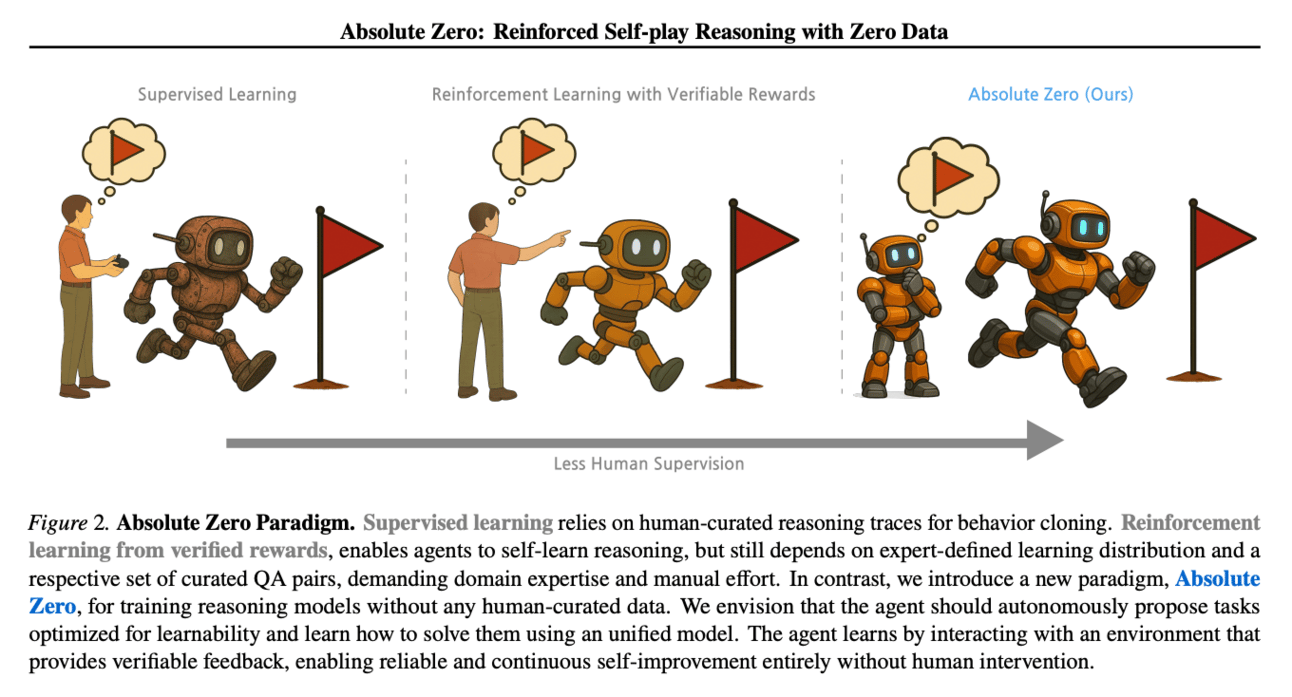

칭화대학교, 북경대학교, 펜실베니아 대학교 연구진들이 함께 소개한, Absolute Zero라는 대담한 새로운 아이디어도 소개드립니다.

Absolute Zero 기법의 패러다임. Image Credit: 오리지널 논문

AI가 사람이 만든 데이터가 없어도 추론 능력을 향상시킬 수 있다면 어떨까 하는 아이디어에서 출발한 연구인데, 데이터셋을 큐레이션해서 학습하는게 아니라, AI가 자체적으로 태스크를 만들어내고, 그 태스크를 해결하고, 그 과정에서 나온 결과로부터 학습을 합니다 - 완전히 Self-Play를 통해서요. 앞으로 더 고도화되고 잘 다듬어진다면, Absolute Zero는 특히 사람이 감독하기 어렵거나 불가능한 영역에서 자율적으로 작동하는 추론 에이전트를 훈련하는 기본 기법이 될 수도 있을 것 같습니다.

트위터 라이브러리 (Twitter Library) 🐦

AI 모델을 훈련하는 과정에서, 이후에 모델의 행동 (Behavior)을 우리가 원하는 목표에 합치시켜야 할 때, 모델이 정확한 답변을 하고, 추론을 잘 하고, 안전하게 사용자의 선호도에 맞춘 응답을 하도록 하는 특별한 알고리즘을 활용하게 됩니다. 실제로, 모델이 사용자에게 얼마나 쓸모있느냐 - 유용하냐 - 는 ‘학습 이후 최적화’에 달려있기도 한데요.

오늘, 중요한 최적화 알고리즘 - 고전적인 것들 + 새로운 것들 - 을 한 곳에 모아 봤습니다:

*아직 튜링 포스트 코리아 구독 안 하셨나요? 구독해 주시면 매주 중요한 AI 뉴스를 정리한 다이제스트를 받으실 수 있습니다!

AI 업계 전문가들이 관심있어하는 제품/서비스 👍🏼

오랜만에 이 섹션으로 찾아뵙습니다 ^.^

‘로컬’에서 운용하는, 오픈소스 AI 에이전트입니다. 클라우드가 필요없이 코드를 작성하고, 실행하고, 디버깅합니다. 여러분이 갖고 있는 다양한 개발 도구와 연결할 수 있고, 다양한 LLM을 지원하면서 진행 중인 프로젝트를 프라이빗하게 유지할 수 있습니다. 상당히 깔끔하고 심플하다는 느낌이 드네요.

튜링 포스트 코리아팀이 읽고 있는 것들

Casualties of the U.S.-China trade war: humanoid robots by Rest of World

지금 이 시점, 전세계는 ‘협력’이라는 키워드보다는 ‘경쟁’이라는 키워드에 매몰되어 가는듯이 보입니다. 휴머노이드 로봇 분야에서도, 이런 미-중을 위시로 한 국제적인 갈등이 실질적인 휴머노이드 시대를 앞당기는데 큰 저해 요소가 될 거라고 이야기하는 글입니다.

미국의 휴머노이드 로봇 분야 강점은 칩, 반도체, AI 모델과 같은 기술에 있죠. 일부 전문가들은 미국이 중국 로봇에도 필수적으로 필요한 부품, 칩에 대한 수출 통제를 강화하면 휴머노이드 경쟁에서 우위를 점할 수 있다고 봅니다. 중국 유니트리의 창업자 왕싱싱조차 "가장 큰 병목은 칩이 될 것"이라고 이야기하니까요.

반면에, 중국은 로봇을 ‘생산’한다는 관점에서 큰 중심지 (휴머노이드의 63%가 중국산)죠. 본체 부품, 배터리, 센서, 액추에이터 등 하드웨어에 강점이 있습니다. 결국, 중국의 로봇 기술에 일정 부분 의존할 수 밖에 없는 미국 기업들은 중국 수입품에 대한 미국의 관세 때문에 제약을 받을 겁니다.

휴머노이드 로봇 산업은 그 성장의 아주 초기 단계에 있고, 앞으로 해야 할 일이 많은데, 이런 갈등과 대립의 양상은 양측 모두에게 손해가 될 수 밖에 없죠. 오직 ‘협력’을 통해서만 더 빠른 발전을 이룰 수 있습니다.

A Potential Path to Safer AI Development by Yoshua Bengio

2019년 튜링상 수상자이자 딥러닝의 아버지 중 한 분으로 불리는 ‘요슈아 벤지오’ 교수는, 제가 과거 일했던 Element AI를 몬트리올 대학교 및 MILA의 연구자들을 중심으로 창업했던 분이기도 해서, 이 분의 생각과 주요한 연구 방향을 쭉 모니터링 해 오고 있는데요.

이 글은 5월 초에 타임즈에 기고한 에세이로, AI 발전 경로에서 현재 마치 "안개 낀 산길"처럼 위험한 상황에 처해 있다고 경고를 하고 있습니다. 특히, 초기이긴 하지만 자율적 AI 에이전트들이 보여주는 자기 보존 (Self-Preservation), 기만 등의 행동이 향후 인류에게 심각한 위험을 낳을 수도 있다는 걱정을 하면서, 대안으로서 "Scientist AI"라는 개념을 제시합니다. 이 "Scientist AI"는 사람의 기호나 감정에 그 때 그 때 맞춰가는 것보다 “정직함”, “신실함”을 높은 우선순위로 여겨서, 다른 AI의 행동을 감시하기도 하고, 더 신뢰할 만한 연구 도구가 될 수 있고, 궁극적으로 더 안전한 AI 개발을 할 수 있게 도와줄 거라고 주장합니다.

특히, 요슈아 벤지오 교수는, 지금은 많은 기업과 국가들이 AI의 능력 그 자체를 향상하는 데만 집중하고 있지만, 우리 모두의 번영과 안전을 위해서는, AI의 시대에 필요한 기술적·사회적 안전장치 구축에 더 신경을 써야 한다고 호소하고 있습니다.

마크 저커버그와 존 콜리슨의 대화: AI가 광고 시장을 어떻게 바꿀 것인가

마크 저커버그의 연설이나 발표가 항상 흥미로운 건 아닌데요 ^.^; Stripe Sessions에서 John Collison과 나눈 대화, 특히 광고 시장과 AI에 대한 이야기는 들어볼 만한 것 같습니다.

금주의 주목할 만한 업계 동향 📰

금주의 스타트업, 빅테크 등을 포함하는 다양한 영역의 뉴스를 모아봤습니다:

사우디아라비아, PIF 산하의 AI 개발 기업 'Humain' 설립

MBS (무하마드 빈 살만) 왕세자의 프로젝트로 보이는데요. AI의 리더로 거듭나겠다는 목표로, AI 기술 개발 및 관리 등을 주 목적으로 하는 새로운 기업 Humain을 출범시켰습니다. 글로벌 AI 허브의 하나로 성장하는게 목표라고 하는데요. 글을 보면, 싱가폴의 AI Singapore + Temus 정도의 범위로 일을 하는 회사가 아닐까 하는 느낌입니다.

AI 기반의 ‘과학자’를 구축하는 비영리기관, FutureHouse

FutureHouse는 에릭 슈미트가 지원하고 있는 비영리기관으로, 향후 10년 내에 ‘AI Scientist’를 구축하겠다는 목표로 최근 첫 번째 중요 제품을 출시했습니다: 과학과 관련된 작업을 지원하게끔 설계한, AI 기반의 도구를 갖춘 플랫폼, 그리고 API입니다.

Image Credit: FutureHouse

‘Wearable’의 시대

먼저, 메타 소식인데요. 프라이버시는 사라지고 다시 ‘슈퍼 센싱’이 돌아오나요? The Information에 따르면, 메타가 스마트글래스용 얼굴 인식 기술 작업을 ‘조용히’ 다시 시작했다고 합니다. 트럼프 시대에서의 FTC (연방 거래 위원회)가 규제를 느슨하게 관리하는 환경에서, 메타를 비롯한 빅테크의 운영을 감시하는 기관들의 발이 묶이는 쪽으로 베팅을 하는게 아닌가 싶네요.

한편, 월스트리트저널에서 Joanna Stern의 흥미로운 실험에 대한 기사를 냈네요. Joanna Stern은 3개월 동안 자기가 말하는 모든 걸 녹음하기 위해서 3가지 AI 기기를 늘 착용하고 다녔는데요 - Bee, Limitless, Plaud가 그 3가지 기기입니다. 이걸 사용하면서, 자기의 삶이 일종의 ‘검색할 수 있는 대본’, 그리고 ‘자동적인 할 일들의 목록’이 되었다고 하네요. ^.^

‘터치’ 센싱을 하는 아마존의 AI 기반 웨어하우스 로봇, Vulcan

아마존이 조금은 특이한 방식의 기기로 로봇 시장에 진입합니다: 바로 ‘터치’인데요. 아마존 Vulcan은 ‘느낄 수 있는’ 최초의 AI 기반 웨어하우스 로봇으로, 압력에 반응하고, 물체를 건드리고 다뤄보면서 더 잘 인식하고, 어린아이처럼 학습하는 로봇입니다. ‘몸이 곧 뇌’가 되는 ‘물리적 AI’가 구현된 실제 환경의 로봇입니다.

‘생각한다, 고로 포스팅한다?’ - 뉴럴링크

멀지 않은 미래, 심장박동기나 인공와우를 착용하듯이 자연스럽게 다양한 AI 기반 기기를 우리의 체내에 삽입하고 착용하게 될 지도 모르는데요. 뉴럴링크의 ‘뇌 임플란트’를 통해서 ALS 환자인 Bradford Smith가 생각을 하는 것만으로 유튜브 동영상을 만듭니다.

불투명한 아이폰의 미래?

구글의 ‘검색 독점 금지’를 시정할 것인지 논의하는 재판에서, 애플의 서비스 부문 임원인 Edy Cue가 “AI 때문에, 이전에 애플이 iPod를 아이폰과 통합하면서 없애버린 것 같은 일이 일어날 수 있다”고 말했습니다. 스마트 글래스, 에어팟, 시계 등 다양한 단말이 스마트하게 변화하고 있는 와중에, 애플의 미래는 ‘음성’ 중심으로 이동하면서 ‘화면’은 꼭 필요한 게 아닐 수도 있다는 뜻입니다.

그리고, 애플이 만들고 있는 새로운 칩이 거기에 어떤 역할을 하게 될지 주목됩니다. 애플은 차세대 하드웨어들의 생태계에 전력을 공급할 수 있는 ‘맞춤형 칩들’을 개발하고 있는데요. 메타는 메모리를 가진 안경을 밀어붙이고, 뉴럴링크는 뇌와 기계를 연결하는 작업에 주력하는 가운데, 애플은 사용자와 함께 생각하는 웨어러블에 미래를 걸고 있는 듯 합니다.

오픈AI 관련 소식

강화학습 기반의 파인튜닝 (RFT; Reinforcement Fine-Tuning) 혹시 기억하시나요? o4-mini에서 적용되었습니다. CoT 추론과 작업 성능의 평가를 합쳐서, 모델의 성능을 크게 높이는데 기여했죠. 한편, GPT-4.1 nano에서는 SFT (지도학습 파인튜닝; Supervised Fine-Tuning)을 할 수 있게 되어서, 오픈AI 모델 중 가장 빠르고 경제적인 모델을 사용자의 니즈에 맞게 조정할 수 있게 되었습니다.

이제 챗GPT의 딥 리서치가 깃헙 리포지토리를 통째로 읽을 수 있다고 합니다 - 코드에서부터 PR 자료까지, 모두 다 분석해서 출처를 표시하고 보고서를 만들어줍니다.

‘스타게이트’ 프로젝트에 대한 샘 알트만의 트윗입니다. 소프트웨어, 가상 공간에 머물렀던 오픈AI가 현실세계로 발을 들이기 시작하는 느낌이네요:

스타게이트와 관련해서, 금주에 오픈AI가 ‘OpenAI for Countries (국가를 위한 오픈AI 정도로 번역될까요?)’라는 글로벌 추진계획을 발표했는데요. 각각의 국가가 자체적으로 AI 인프라와 맞춤형 챗GPT를 구축하고 AI Economy를 키울 수 있게 돕겠다는 이야기인데요. 현재 10개국과 파트너십을 맺었다고 합니다.

마이크로소프트, 구글의 A2A를 도입

마이크로소프트가 구글의 A2A 프로토콜을 도입, Azure AI Foundry와 Copilot Studio에서 크로스 플랫폼으로 AI 에이전트 간의 협업을 지원한다고 합니다. 에이전트 시대에는, 거대한 빅테크들조차 자존심을 세우기보다는 ‘상호 운용성’을 선택하는 것 같네요.

AWS의 새로운 보고서가 보여주는 2025년 AI 예산의 향방

AWS에서 새롭게 Generative AI Adoption Index 보고서를 발간했습니다. 세 가지 포인트가 눈에 들어오는데요:

Chief AI Officer라는 직책이 확산될 것이다

AI 탤런트를 확보하고 키우는 것이 전략적 우선순위이다

Build (자체 구축) vs. Buy (외부 솔루션 활용)의 적절한 믹스가 중요하다

Image Credit: AWS

당연한 이야기이기는 합니다만, 그만큼 ‘기본’이라는 뜻이기도 합니다.

새로 나온, 주목할 만한 연구 논문

‘주목할 만한 최신의 AI 모델’을 먼저 소개하고, 각 영역별로 ‘Top Pick’은 해당 논문 앞에 별표(🌟)로 표시했습니다!

주목할 만한 최신 AI 모델

구글이 Gemini 2.5 Pro와 Gemini Flash를 선보였습니다. 이 두 개의 멀티모달 모델은 영상 이해와 에이전트 기능이라는 관점에서 새로운 지평을 열었다고 볼 수 있구요. Gemini 2.5 Pro는 저해상도로 6시간짜리 영상을 처리할 수 있고, VideoMME에서 84.7%의 성능을 달성했습니다 → [포스트 보기]

Lightricks의 LTX-Video는 디퓨젼 기반 기술을 활용해서 실시간으로 고품질의 영상을 생성하는 Text-to-Video, Image-to-Video 모델입니다. 30 FPS 출력을 할 수 있고, 다양한 컴퓨팅 환경에 맞게 최적화된 버전들이 제공됩니다 → [자세히 보기]

엔비디아가 코드 추론 작업에 최적화된 Open Code Reasoning LLM(7B, 14B, 32B)을 오픈소스로 공개했습니다. OCR 데이터셋을 기반으로 하고, 토큰 효율이 30% 더 높고, 표준적인 배포 프레임웍들과 호환됩니다 → [자세히 보기]

Mistral Medium 3는 최고 수준의 성능을 보여주면서도 비용은 8배나 낮고, 기업 환경에서 배포하기도 쉬운 모델입니다. 코딩과 STEM 영역의 작업에 뛰어나고, LLaMA 4 Maverick이라든가 Cohere Command A보다 훨씬 저렴한 비용으로 더 좋은 성능을 보여준다고 하네요 → [자세히 보기]

LLaMA-Omni 2는 Qwen2.5(!)를 기반으로 한 실시간 음성 챗봇으로, 음성 인코더와 스트리밍 음성 디코더를 통합하는 구조입니다. 20만 개의 음성 대화만으로 학습했지만, 수백만 시간의 데이터로 학습한 모델보다도 음성 QA와 지시 수행 (Instruction Following)을 더 잘 한다고 하네요 → [자세히 보기]

🌟 ‘Perception, Reason, Think, and Plan: A Survey on Large Multimodal Reasoning Models’라는 제목의 논문에서 ‘멀티모달 추론’이 어떻게 발전해 왔는지를 설명합니다. 초기의 모듈화된 시스템에서부터 에이전틱 시스템으로 통합된 언어 중심 모델까지의 발전을 전체적으로 살펴봅니다 → [논문 보기]

Image Credit: Perception, Reason, Think and Plan

언어모델의 추론 (Reasoning) 및 정렬 (Alignment)

🌟 Flow-GRPO: Training Flow Matching Models via Online RL에서는 플로우 매칭과 강화 학습을 결합해서 Text-to-Image 생성 모델을 개선하는 모습을 보여줍니다. 이미지 구성의 정확도, 그리고 사용자 선호도와의 합치성을 크게 향상시켜준다고 합니다

→ [논문 보기]🌟Unified Multimodal Chain-of-Thought Reward Model through Reinforcement Fine-Tuning 논문에서는, 다양한 모달리티에 걸쳐서 CoT 추론을 사용하는 보상 모델을 제안하는데, 강화학습으로 훈련함으로써 신뢰성, 그리고 견고성 (Robustness)이 높아진다고 합니다 → [논문 보기]

🌟 Scalable Chain of Thoughts via Elastic Reasoning 논문에서는 추론 모델에서 ‘사고’ 단계와 ‘해결책’ 단계를 분리해서 추론 작업에 따라오는 토큰 제약 조건을 더 잘 처리하도록 하는 방법을 제안합니다 → [논문 보기]

🌟 X-Reasoner: Towards Generalizable Reasoning Across Modalities and Domains 논문에서는, ‘추론 능력’이 텍스트 모달리티로부터 멀티모달, 그리고 특정한 도메인의 작업으로까지 전이 (Transfer)될 수 있다는 것을 보여줍니다 → [논문 보기]

훈련 효율성 개선 및 데이터 전략

🌟 Practical Efficiency of Muon for Pretraining은 Muon 옵티마이저가 대규모 훈련 과정에서 데이터와 컴퓨팅 효율성을 향상시킬 수 있다는 걸 보여줍니다 → [논문 읽기]

🌟 Grokking in the Wild: Data Augmentation for Real-World Multi-Hop Reasoning with Transformers는 지식 그래프에 Synthetic Augmentation (합성 증강) 기법을 적용해서 멀티 홉 추론 작업에서 그로킹(Grokking) 현상이 나타날 수 있게끔 합니다: 즉, AI 모델이 여러 단계의 논리적 연결을 필요로 하는 복잡한 추론 과제에서 단순한 암기를 넘어서 제대로 된 이해와 일반화 능력을 갖출 수 있더라 하는 이야깁니다 → [논문 읽기]

🌟 Teaching Models to Understand (but not Generate) High-risk Data 논문에서는, 모델이 위험이 큰 콘텐츠를 복제하지 않으면서도 ‘이해’는 할 수 있도록 도와주는 ‘선택적 손실 함수’를 소개합니다 → [논문 읽기]

벤치마킹 및 평가

On Path to Multimodal Generalist: General-Level and General-Bench는 멀티모달 모델이 범용 AI를 향해 어떻게, 어느 정도 진전하고 있는가 하는 정도를 평가하기 위한 벤치마크와 방법론을 소개합니다 → [논문 읽기]

AutoLibra: Agent Metric Induction from Open-Ended Feedback 논문에서는, 자연어 피드백으로부터 자동적으로 평가 지표를 생성해서 에이전트 행동을 평가하도록 합니다 → [논문 읽기]

G-FOCUS: Towards a Robust Method for Assessing UI Design Persuasiveness는 비전-언어 모델을 사용해서 UI 디자인의 ‘설득력’을 평가하는 벤치마크와 전략을 제시합니다 → [논문 읽기]

읽어주셔서 감사합니다. 프리미엄 구독자가 되어주시면 튜링 포스트 코리아의 제작에 큰 도움이 됩니다!