]]]]]]강화학습 일변도를 극복한 새로운 파인튜닝 스택이란?

‘강화학습을 넘어선다’ 라는 말의 뜻은, 사후 학습(Post-training)이 더 이상 ‘강화학습’ 일변도에 머물지 않고 변화해 간다는 뜻입니다. 현재의 LLM 튜닝은 지도미세조정(SFT), 선호도 정렬(강화학습HF/DPO/강화학습VR), 어댑터 기반의 파라미터 업데이트(LoRA 계열), 그리고 진화 전략(ES) 같은 대안적 최적화 방식까지 여러 방법론을 조합하고 있습니다. 하나의 거대한 단일 루프에서 벗어나, 비용은 낮추고 안정성은 높이면서 태스크마다 유연하게 조합할 수 있는 모듈형 스택으로의 전환이 이루어지고 있는 것이죠.

용어 | 설명 |

|---|---|

SFT | 지도 미세조정. 프롬프트-응답 쌍을 학습해서 어시스턴트 행동을 가르치는 방법 |

강화학습HF | 인간의 피드백을 활용한 강화학습. 선호도 데이터와 보상 최적화를 활용 |

강화학습VR | 검증 가능한 보상 기반의 강화학습 (테스트 실행 결과, 정답 여부 등 활용) |

DPO | 직접 선호도 최적화. 완전한 강화학습 루프 없이 선호 출력 vs. 비선호 출력을 학습 |

LoRA | 저랭크 적응(Low-Rank Adaptation). 기본 가중치는 고정하고 소형 저랭크 업데이트만 학습 (W' = W + BA) |

Doc-to-LoRA | 문서에서 직접 LoRA 어댑터를 생성 (컨텍스트 → 파라미터) |

Text-to-LoRA | 태스크를 설명하는 텍스트에서 직접 LoRA 어댑터를 생성 (텍스트 → 파라미터) |

LoRA-Squeeze | 학습 후 또는 학습 중에 LoRA 랭크를 압축해서 품질 손실을 최소화하는 방법 |

Kron-LoRA | 크로네커 구조 + 저랭크 어댑터를 결합해서 파라미터 효율을 극대화하는 방법 |

MoA | 어댑터 혼합(Mixture of Adapters). 다양한 종류의 어댑터에 토큰을 동적으로 라우팅 |

ES | 진화 전략(Evolution Strategies). 파라미터 교란과 보상 평가를 통한 기울기 없는 최적화 |

LoRA + ES | LoRA를 탐색 공간으로 삼고 ES를 최적화 방법으로 활용하는 확장 가능한 사후 학습 |

강화학습을 쓰는 이유는 사실, 꽤 현실적인 이유입니다. 수많은 추론 모델의 성공이 강화학습에 일정 부분 기대고 있기도 하구요. 강화학습을 쓰면 목적 함수를 표준 학습 손실처럼 정의하고, 모델이 보상 신호를 최대화하는 방향으로 훈련할 수 있습니다.

하지만 최근에 연구자들 사이에서 "강화학습이 정말 사후 학습에 사용하는 지배적인 기법으로 남는 게 맞나?" 라는 의문이 점점 커지고 있다고 해요. 왜 그럴까요?

강화학습 파이프라인은 비싸고 불안정합니다. 보상 모델과 정책 업데이트를 세심하게 조율해야 하고, 특히 ‘긴 추론’ 태스크에서는 피드백의 주기가 너무 드문드문해요. 보상 해킹(Reward Hacking) 문제도 끝이라는 게 없는 골칫거리고요.

안드레 카파시(Andrej Karpathy)가 한때 "강화학습은 끔찍하다"고 했던 적이 있다는 거, 기억하시나요? 이유가 바로 이겁니다. 강화학습의 보상이 단 하나의 최종 결과에만 집중되니, 복잡한 추론 과정 중에 어느 단계가 진짜 결정적이었는지 구분하지 못하고, 무관한 단계들에까지 노이즈 섞인 공로를 잘못 배분하는 '신용 할당(Credit Assignment)'의 한계가 발생한다는 거요.

그렇다면 모델의 어떤 부분을 정확히 수정해야 할까요? 어떻게 하면 사후 학습을 더 효율적으로 만들 수 있을까요?

더 나은 학습 방법을 찾는 탐색은 아직 끝나지 않았습니다 - 어쩌면, 이제 시작인지도 모르죠. 강화학습의 한계가 드러나면서, 최적화와 파라미터화 두 영역 모두에서 새로운 사후 학습 전략들이 주목받고 있습니다. LoRA(Low-Rank Adaptation) 같은 파라미터 효율적인 방법과, 진화 전략(Evolution Strategies, ES) 같은 기울기 없는(Gradient-free) 접근법이 대표적인 접근법들입니다.

오늘은, 사후 학습을 더 낮은 비용으로, 더 안정적으로, 강화학습 기반 파이프라인보다 더 유연하게 만들 수 있는 방법들을 살펴보겠습니다. 새로운 LoRA의 변형이라고 할 수 있는 Doc-to-LoRA, Text-to-LoRA, LoRA-Squeeze, Kron-LoRA, MoA(Mixture of Adapters)와, 아주 흥미로운 방향인 진화 전략(ES)이 어떻게 결합될 수 있는지까지요. 강화학습 그 너머에 과연 뭐가 기다리고 있는지, 함께 살펴볼까요?

오늘 다뤄볼 내용은 다음과 같습니다:

사후 학습에서 강화학습이 비용이 많이 들고 불안정해지는 이유

Doc-to-LoRA와 Text-to-LoRA: 어댑터를 "학습된 산출물"에서 "생성된 모듈"로 바꾸다

LoRA-Squeeze, Kron-LoRA, MoA: 어댑터 효율성과 조합을 개선하는 방법

진화 전략(ES)이 다시 주목받는 이유

LoRA + ES 하이브리드: 더 저렴하고, 더 모듈화되고, 더 확장성 좋은 사후 학습

맺으며

모델 학습의 기초

새로운 파인튜닝 아이디어들을 살펴보기 전에, 현재 우리가 실제로 쓰는 학습 파이프라인이 어떻게 생겼는지, 그리고 새로운 대안들이 그 안의 어느 자리에 들어올 수 있는지를 먼저 짚어보는게 좋겠습니다.

LLM 학습을 이야기할 때, 크게 사전 학습(Pre-training) 과 사후 학습(Post-training)이라는 두 단계로 나뉜 라이프사이클을 다루게 됩니다. 이 두 가지가 시간적 순서인 것 같이 보이지만, 사실 이런 구분은 시간적 순서의 의미보다는, 어떤 목표를 최적화하고 어떤 능력을 추가하느냐의 차이로 구분하는게 더 좋다고 생각합니다.

사전 학습은 모델의 범용 지능 기반을 만드는 단계입니다. 여기서의 목표는 모델이 시퀀스의 다음 토큰을 정확히 예측하게금 하는 것이고, 그 결과로 방대한 데이터셋에서 언어의 일반적인 구조와 지식을 배운 베이스 모델이 탄생합니다. 전체 학습 비용의 대부분이 바로 이 단계에서 쓰이죠.

사후 학습은 그 기반을 실제로 쓸 수 있는 시스템으로 다듬는 작업입니다. 모델이 어떻게 행동해야 하는지를 가르치고, 다양한 단계들로 유연하게 구성됩니다. 사전 학습에 비하면 비용 비중은 훨씬 작습니다.

일반적으로 현대적인 LLM 파이프라인은 이렇게 이해할 수 있습니다: 사전 학습 → 지도 미세조정(SFT) → 정렬 학습 → 사후 학습 최적화.

SFT(지도 미세조정) 단계에서는 프롬프트-응답 예시로 모델을 학습시켜서, 지시를 잘 따르고 구조화된 답변을 만들어내는 방법을 가르칩니다. 어시스턴트처럼 행동하는 법을 배우는 단계죠.

정렬 학습은 모델의 출력을 인간의 선호도나 태스크별 목표에 맞추는 단계입니다. 가장 일반적인 방법이 RLHF(인간 피드백 기반 강화학습) 인데요. 인간이 모델 출력에 순위를 매기면, 보상 모델이 그 선호도를 학습하고 모델 출력을 점수화합니다. 그러면 강화학습이 기울기 기반의 최적화를 통해서 모델이 보상을 최대화하도록 업데이트하는 방식입니다.

요즘은 인간의 피드백 대신 수학 풀이 검증, 코드 실행 결과, 데이터베이스 쿼리, 프로그래밍 테스트 같은 자동화된 평가 신호를 활용하는 시스템이 점점 늘고 있는데, 이것들을 RLVR(검증 가능한 보상 기반 강화학습) 이라고 부르기도 합니다.

이 외에도 AI 모델에는 RAG(검색 증강 생성), 다단계 추론 학습, 도구 사용 및 에이전트 행동 학습, 긴 컨텍스트 최적화, 안전성 및 캘리브레이션 학습 같은 추가적인 개선 기법들을 흔히 덧붙여서 진행하게 됩니다.

그런데 요즘, 저랭크 적응(LoRA) 기법들이 새로운 차원으로 진화하고 있습니다. Doc-to-LoRA, Text-to-LoRA, LoRA-Squeeze 같은 최신의 기법들은, 사후 학습이 더 이상 베이스 모델 위에 강화학습을 돌리는 것이 다가 아니라는 걸 보여주죠. 일부 행동은 보상을 통해서 최적화하고, 다른 행동은 생성된 어댑터를 통해서 즉각 주입하는 모듈형 스택으로 진화하는 중입니다. 파인튜닝이 거대한 ‘하나’의 학습 단계가 아니라, 다양한 능력을 동적으로 조합하는 시스템처럼 보이기 시작했다고나 할까요?

기본적으로 LoRA는 사후 학습 중에 모델 파라미터를 업데이트하는 방식 자체를 바꿔 줍니다. 초기 LoRA 접근법들은 어댑터를 순수한 파인튜닝 메커니즘으로 취급했습니다. 태스크에 특화하기 위해서 데이터셋으로 학습시키는 것이었죠.

표준적인 LoRA 파인튜닝에서는 베이스 모델을 고정시켜 놓고 소형의 저랭크 행렬만 학습합니다: W' = W + BA. 여기서 W는 원래 가중치 행렬이고, BA는 보통 랭크 4~64 사이의 저랭크 업데이트입니다. 수십억 개의 파라미터 대신 수백만 개만 수정하는 셈이죠.

실제로 LoRA는 도메인 특화, 지시어 튜닝, 추론 태스크, 정렬 실험 등에 폭넓게 쓰입니다. 일반적인 파이프라인은 이렇습니다: 사전 학습 → 명령 미세조정 → 정렬/능력 학습 → 파라미터 효율적인 미세조정(LoRA).

자, 그럼 이제 최신의 LoRA 기법들이 어떻게 작동하고, 사후 학습의 어떤 새로운 가능성을 열어주는지 살펴보겠습니다.

Doc-to-LoRA와 Text-to-LoRA: LoRA가 표현하는 것의 변화

일본의 대표적 AI 스타트업인 Sakana AI에서 이 연구가 많이 이뤄졌는데요.

Sakana AI에서 진행된 Doc-to-LoRA와 Text-to-LoRA에 관한 최근 연구들은 ‘어댑터를 만들어서, 그 어댑터를 붙여서 사용한다’는 아이디어를 크게 확장합니다. 두 기법은 비슷한 방향으로 작동하지만 그 역할은 서로 다릅니다.

Doc-to-LoRA는 기억(Memory)에, Text-to-LoRA는 새로운 태스크 적응에 초점을 맞추는데요. 기울기 업데이트로 어댑터를 학습시키는 대신에, 텍스트 입력으로부터 어댑터를 직접 생성합니다. 태스크 설명이나 문서가, 베이스 모델을 수정하는 LoRA 가중치로 바로 바뀌는 것이죠. 덕분에 LoRA의 역할 자체가 달라집니다. 필요할 때마다 새로운 지식, 기술, 행동을 즉각적으로 얹을 수 있는, 더 모듈적이고 동적인 파인튜닝 스택으로 진화하는 겁니다.

Doc-to-LoRA (D2L): 문서가 파라미터 업데이트가 된다

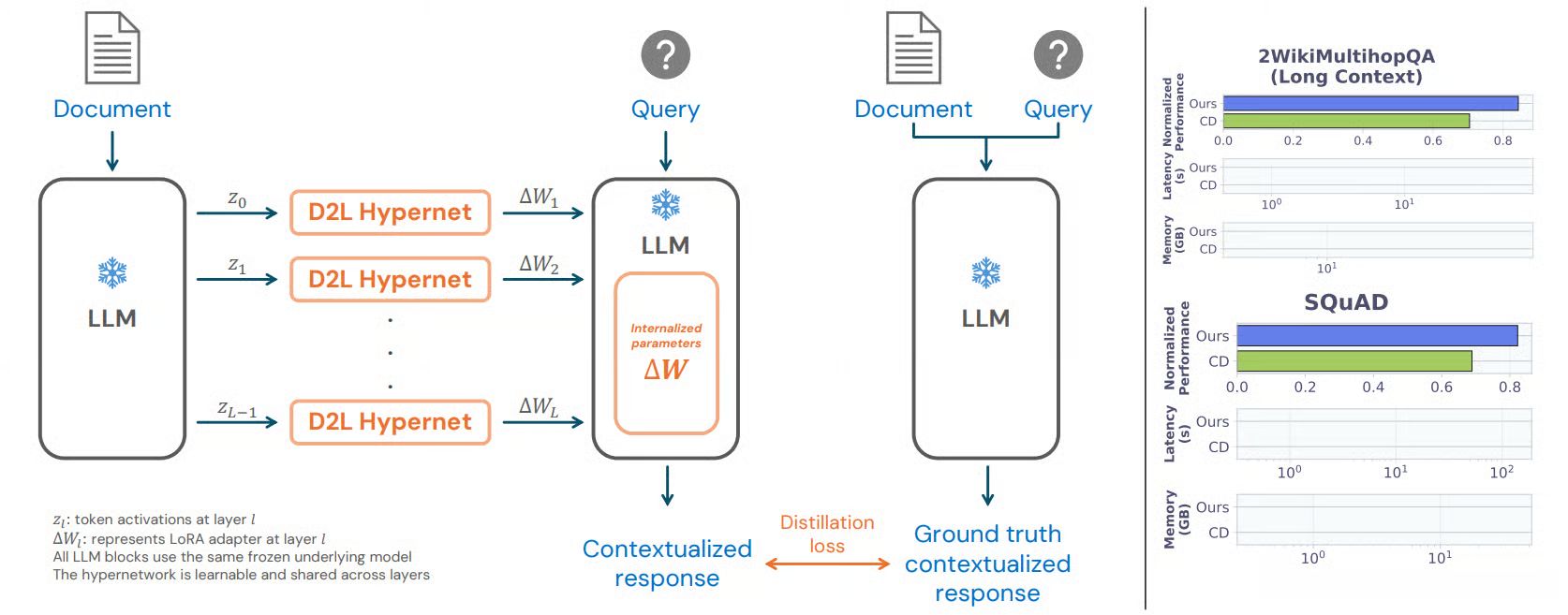

Doc-to-LoRA(D2L)는, 문서를 단 한 번의 순전파(Forward Pass)로 LoRA 어댑터로 변환합니다. 컨텍스트 증류(Context Distillation)를 근사(Approximation)하게끔 메타 학습시킨 하이퍼네트워크(Hypernetwork) 를 활용합니다.

잠깐, 컨텍스트 증류란? 모델이 컨텍스트 안의 정보를 한 번 읽은 뒤, 그 지식이 파라미터로 옮겨져서 원본 문서 없이도 관련 질문에 답할 수 있게 되는 방법입니다.

새 컨텍스트를 하이퍼네트워크에 넣으면, 고정된 베이스 LLM을 위한 ‘컨텍스트 전용 LoRA 어댑터’가 만들어지고, 이제 베이스 모델은 원본 문서를 다시 읽지 않고도 후속 질문에 답할 수 있습니다.

Image Credit: Doc-to-LoRA 오리지널 논문

학습이 거듭될수록, 하이퍼네트워크는 텍스트 맥락(Context)을 LoRA 어댑터로 변환하는 일반적인 매핑 규칙을 익히게 되고, 결과적으로 ‘개별 문서’가 언제든 저장도 공유도 하고, 필요할 때마다 다양한 모델에 갈아 끼울 수 있는 '재사용 가능한 파라미터 모듈'로 진화하게 되는 겁니다.

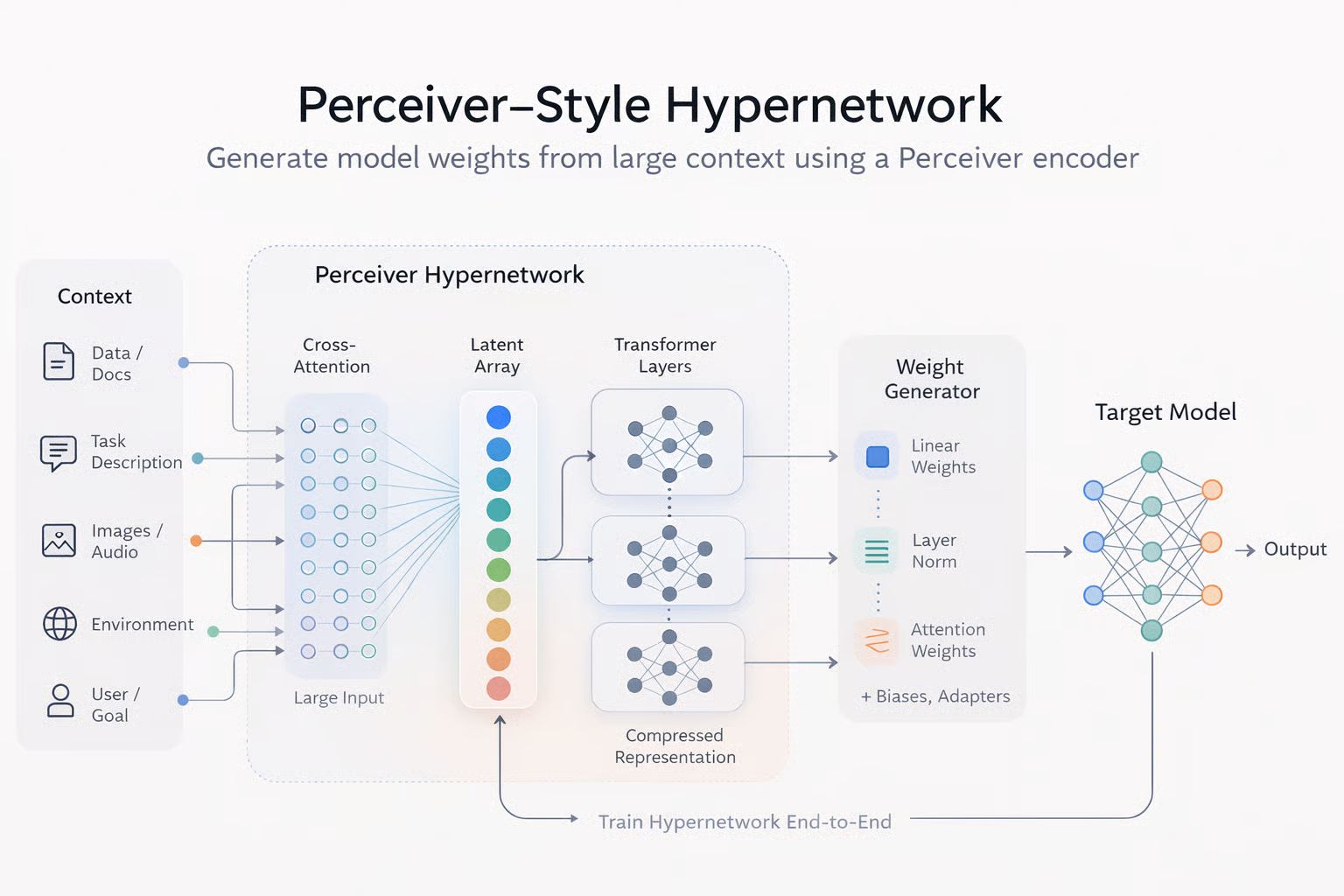

구조적으로 D2L은 Perceiver 방식의 하이퍼네트워크를 채택하고 있는데요, 이건 고정된 LLM의 히든 활성화(Hidden Activations) 값을 입력받아서, 문서의 길이가 아무리 제각각이더라도 상관없이 일정한 규격의 어댑터를 생성해 냅니다. 특히 문서가 아무리 길어도 청킹(Chunking) 방식을 통해서 유연하게 대응할 수 있다는 점이 큰 특징입니다.

Image Credit: 튜링포스트

이런 이유 때문에, D2L은 아래와 같은 장점을 갖게 됩니다.

베이스 모델의 기본 컨텍스트 창보다 4배 이상 긴 문서를 처리할 수 있습니다.

컨텍스트의 내재화가 단 한 번의 순전파로 이루어지기 때문에, 후속 쿼리의 응답 지연이 줄어들고 모델이 전체 문서를 반복적으로 읽어야 하는 부담도 사라집니다.

추론 중에 KV 캐시 메모리 사용량이 줄어듭니다.

잦은 지식 업데이트나 개인화된 행동 같은 더 다이나믹한 활용을 할 수 있습니다.

물론 D2L이 긴 컨텍스트 모델링을 완전히 대체할 수 있는 건 아닙니다. 품질은 하이퍼네트워크가 컨텍스트-어댑터 매핑을 얼마나 잘 학습했느냐에 달려 있고, 전체 문서에 직접 접근하는 것보다 정보 손실이 생길 수도 있죠. 그렇지만, 컨텍스트를 빠르게 내재화할 수 있게 해 주는 실용적인 메커니즘으로서 D2L은 아주 흥미로운 방향을 탐색하게 해 줍니다: 지식이 프롬프트로 주입되는 게 아니라, 모델에 마운트되는 모듈이 되는 모습이니까 말이예요.

Text-to-LoRA (T2L): 태스크 설명이 어댑터가 된다

Text-to-LoRA(T2L) 는 Doc-to-LoRA와 같은 방향을 보고 있는 기법이지만, ‘태스크에 적용’됩니다. 각 태스크마다 어댑터를 별도로 학습시킬 필요 없이, 텍스트로 된 설명에서 직접 어댑터를 생성할 수 있습니다.

Image Credit: Text-to-LoRA 오리지널 논문

T2L에서는 ‘자연어로 된 태스크 설명’이 고정된 베이스 모델을 업데이트하는 LoRA 가중치로 변환됩니다. 여기서도 하이퍼네트워크가 쓰이구요. 태스크에 대한 설명을 읽어들여서 임베딩으로 인코딩하고, 트랜스포머의 여러 레이어를 위한 저랭크 LoRA 행렬을 만들어냅니다. D2L처럼 어댑터는 단 한 번의 순전파로 생성되어서 베이스 모델에 부착됩니다.

T2L의 학습 과정은 수만 가지의 서로 다른 작업(태스크)을 경험하면서 진행됩니다. 처음에는 기존에 잘 만들어진 '작업별 전용 도구(LoRA)'들을 똑같이 흉내내면서 복원해 보기도 하고, 때로는 아무 가이드 없이 다양한 작업들을 처음부터 끝까지 직접 수행하면서 스스로 실력을 쌓습니다.

이 과정을 반복하면서 하이퍼네트워크는 개별 작업의 정답을 외우는 대신, 어떤 작업 설명(Text)이 들어오더라도 그에 딱 맞는 해결 도구(LoRA)를 즉석에서 찍어낼 수 있는 '공통의 변신 공식(공유 적응 메커니즘)'을 터득하게 됩니다

이 기법에서 눈에 띄는 실용적인 포인트가 몇 가지 있습니다.

학습 루프를 돌리지 않고도 어댑터를 즉각적으로 생성할 수 있습니다.

입력이 고정되어 있는 태스크 ID가 아닌 텍스트 설명이기 때문에, T2L은 학습 중에 한 번도 보지 못한 태스크에도 설명 텍스트만으로 LoRA를 생성할 수 있습니다.

많은 LoRA를 단 하나의 하이퍼네트워크로 압축해서 필요할 때 꺼내 쓰는 압축 메커니즘으로도 활용됩니다. 수많은 태스크 어댑테이션이 하나의 모델 안에 저장되는 셈이죠.

실험 결과를 보면, 이 방식으로 생성된 어댑터가 추론, QA, 코딩, 지식 벤치마크 전반에 걸쳐서 성능을 높여 주었고, 완전한 학습으로 만들어진, 특정한 태스크에 특화된 LoRA에 근접하는 성능을 보여주는 경우도 많았습니다. 다만 품질은 태스크 설명의 품질에 크게 좌우된다는 점은 참고해야 합니다.

서로를 보완하는 ‘업데이트 생성기’인 D2L과 T2L은, 전체 모델을 반복적으로 재학습하지 않고서도 ‘지속적인 학습’, ‘빠른 개인화’, ‘재사용 가능한 파라미터 모듈’이라는 비전을 실현해 줍니다. 모델이 더 다이나믹한 학습자로 거듭나게 되는 겁니다.

압축: Google DeepMind의 LoRA-Squeeze

LoRA 어댑터를 더 작게 만들 수 있다면 어떨까요? 게다가 처음부터 랭크를 정해두지 않아도 된다면요?

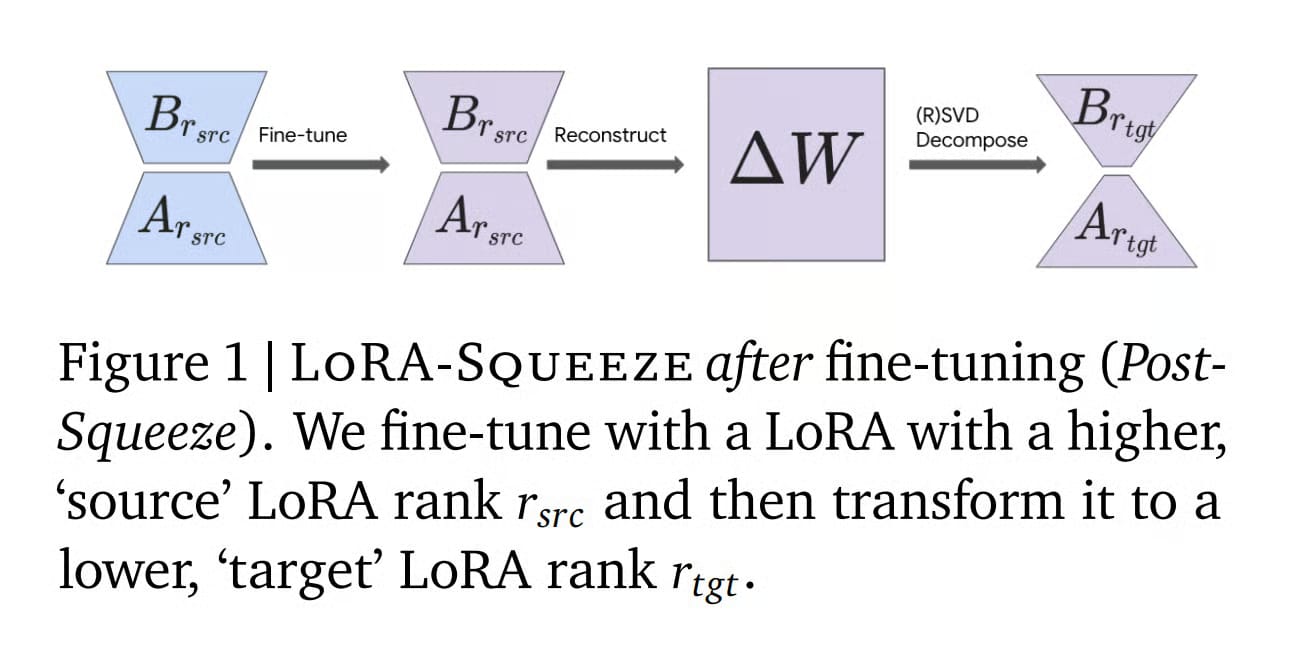

바로 이걸 목적으로 Google DeepMind가 만든 것이 LoRA-Squeeze입니다. 파라미터 모듈을 더 작게 압축하고, 쉽게 재사용할 수 있게 하고, 배포까지 간소화합니다. 처음에 랭크를 결정할 필요도 없습니다. 높은 랭크로 LoRA 어댑터를 먼저 학습한 뒤에, 나중에 더 낮은 랭크로 압축하면 됩니다.

파인튜닝이 끝나면 LoRA-Squeeze는 전체 가중치 업데이트 행렬을 재구성하고, 무작위 특이값 분해(RSVD) 기법을 적용해서 업데이트의 가장 중요한 성분을 보존하는 더 낮은 랭크의 LoRA 모듈을 만들어냅니다.

Image Credit: LoRA-Squeeze 오리지널 논문

세 가지 방식으로 ‘압축’을 할 수 있습니다. 학습 후에 적용하는 Post-Squeeze, 어닐링 스케줄에 따라 학습 중 랭크를 점진적으로 줄이는 In-Squeeze, 학습 중 주기적으로 적용하는 Cont-Squeeze가 그 세 가지입니다.

LoRA-Squeeze를 적용하면 다음과 같은 효과를 볼 수 있습니다.

낮은 랭크 어댑터가 직접 학습된 것과 동등하거나 더 나은 성능을 내는 경우가 많습니다.

학습 랭크와 배포 랭크가 분리되기 때문에, 하이퍼파라미터 조정 부담이 줄어듭니다.

더 작고 균일한 LoRA 모듈 덕분에 배포가 훨씬 간편해집니다.

사후 학습에서 파라미터를 경량화하는, 다른 차원의 기법인 셈이죠. 다만 한 가지는 꼭 주의해야 하는데, 너무 공격적으로 압축하면 성능이 크게 떨어질 수 있다는 겁니다.

Kron-LoRA: 구조를 살린 압축

Kron-LoRA는 Cornell University에서 나온 또 다른 ‘압축 기법입니다. 압축 과정에서 나타날 수 있는 성능 저하를 막는 데 특히 집중하는데요, LoRA 파라미터의 약 25~30%만 사용하면서도(최대 4배 적게), 추론 벤치마크에서 LoRA와 동등하거나 약간 더 나은 성능을 보여줍니다.

이 기법의 핵심에 크로네커 구조(Kronecker Structure)라는 것이 있습니다. 큰 행렬을 두 개의 작은 행렬의 크로네커 곱(Kronecker Product) 으로 나타내는 방식입니다.

Image Credit: 튜링포스트

이 방식을 적용하면, 거대한 행렬 내부에 규칙적인 반복 패턴이 형성되어서, 저장 공간과 연산 효율을 획기적으로 높일 수 있습니다. Kron-LoRA는 여기서 한 걸음 더 나아가서, 분해된 행렬 중 한쪽 인수에 LoRA 특유의 저랭크(Low-Rank) 분해를 추가로 결합합니다.

결과적으로 어댑터는 가중치를 업데이트할 때 정교하게 짜인 구조적 패턴을 유지하면서도, 극강의 압축 효율을 동시에 달성하게 됩니다. 이런 방식이 가져다주는 구체적인 효과는 아래와 같습니다.

압도적인 경량화: 훨씬 작은 크기의 어댑터로 메모리를 획기적으로 절감하면서도, 연산 속도 저하(Overhead)는 단 5~8% 수준에 불과합니다.

우수한 확장성: 여러 작업을 동시에 배우는 멀티태스크 학습이나 단계별 파인튜닝 시 더 뛰어난 적응력을 보여줍니다.

지속적 학습의 견고함: 새로운 데이터를 끊임없이 학습해야 하는 환경에서도 모델의 안정성이 더욱 탄탄하게 유지됩니다.

Image Credit: Kron-LoRA 오리지널 논문

여러 LoRA 유형을 한데 쌓기: Mixture of Adapters (MoA)

오늘 살펴볼 마지막 LoRA 기법은, LoRA 기반 파인튜닝 아이디어를 전혀 다른 관점으로 넓겨 줍니다. 더 ‘많은’ 어댑터가 아니라, 더 ‘다양한 종류’의 어댑터를 함께 쓰는 게 바로 그 아이디어예요.

저장대학교와 텐센트가 함께 개발한 Mixture of Adapters(MoA)는, 동일한 LoRA 전문가를 여럿 쌓는 대신, 상호 보완적인 역할을 하는 이질적인 PEFT(파라미터 효율적 미세조정) 어댑터들의 혼합을 구성합니다. 전문가를 더 늘리는 게 아니라, 서로 다른 종류의 전문가를 더하는 것이 핵심이죠.

Image Credit: MoA 오리지널 논문

작동 방식을 구체적으로 살펴보면,

MoA는 각 트랜스포머 레이어 안에 LoRA 모듈, 병렬 어댑터, 프롬프트 튜닝 등 다양한 어댑터 유형을 결합합니다.

토큰 수준 라우터가 각 전문가의 기여도를 결정합니다. 표준 Mixture-of-Experts(MoE) 개념과 비슷하죠.

Soft MoA 버전에서는 학습된 시그모이드 가중치로 모든 전문가를 결합하고, Sparse MoA 버전에서는 기여도가 임계값을 넘는 전문가만 활성화해서 불필요한 연산을 줄입니다.

단일한 유형의 어댑터를 일률적으로 쌓아 올리는 대신, 서로 다른 특성을 가진 다양한 어댑터들이 동적으로 협력하는 구조를 지향합니다. 이런 방식은 모델의 실질적인 전문화(Specialization)를 이끌어낼 뿐만 아니라, 이미 고정된 베이스 모델이 보유한 방대한 사전 학습 지식을 훨씬 효과적으로 추출해서 활용할 수 있게 해줍니다.

그 효과를 정리하면 아래와 같습니다.

더 나은 전문화: 학습 가능한 파라미터 하나하나가 더 많은 적응력을 발휘합니다.

전문가 중복 감소: 동질적인 MoE-LoRA 기법에서 나타나는 흔한 약점을 해소합니다.

Sparse 버전에서는 해당 토큰에 관련된 전문가만 활성화해서 연산 효율이 높아집니다.

실험 결과, Soft MoA는 수학적 추론 정확도에서 전반적으로 가장 우수한 성능을 입증했습니다. 반면에, Sparse MoA는 활성화되는 전문가(Expert) 수를 줄이고 메모리 사용량을 낮추면서도, Soft MoA와 대등한 수준의 성능을 유지하는 효율성을 보여주었습니다.

MoA의 가치는 단순히 LoRA의 또 다른 변형 모델이라는 점에 그치지 않습니다. 파인튜닝의 미래는 더 강력한 강화학습 기반의 최적화 알고리즘뿐만 아니라, 적응 모듈(Adaptation Module) 그 자체의 설계에 달려 있다는 사실을 시사합니다. MoA는 필요한 상황에 맞춰 다양한 어댑터를 유연하게 조합하고 특정 능력을 선택적으로 처리하는, '모듈형·조합형·선택적 사후 학습 스택'의 새로운 가능성을 제시하고 있습니다.

"강화학습을 넘어서"라는 테마는 어댑터만의 이야기가 아니다

대안적인 최적화 아이디어들도 LLM 파인튜닝과 관련된 더 넓은 지형을 구성하는데요. 오늘은 기울기 기반 최적화를 벗어나는, Cognizant AI Lab이 제안한 아주 유망한 개념을 하나 살펴보겠습니다.

진화 전략(Evolution Strategies, ES)이란?

진화 전략(ES)은 자연 선택에서 영감을 받은 진화적 최적화에서 출발합니다. 핵심 아이디어는, 역전파로 기울기를 계산하는 게 아니라, 무작위 파라미터 교란으로부터 최적화의 방향을 추정하는 겁니다. 파라미터 공간에서 어느 방향으로 가야 보상이 가장 크게 올라가는지를 파악하는 거죠.

ES는 이렇게 진행됩니다.

사전 학습된 LLM에서 시작합니다.

파라미터에 무작위 교란을 가해서 소규모 모델 집단을 만듭니다.

각 모델이 주어진 태스크(예: 추론 또는 수학)에 대한 답변을 생성합니다.

출력이 보상 함수나 검증기로 점수화됩니다.

더 높은 보상을 낸 교란 방향으로 모델 파라미터가 업데이트됩니다.

이 과정을 여러 번 반복합니다.

ES는 기울기 평가가 아닌 보상 평가에만 의존하기 때문에, 영차 최적화(Zeroth-Order Optimization) 기법의 범주에 속합니다.

강화학습 기반 파인튜닝과 비교했을 때 ES의 장점을 정리하면 이렇습니다.

기울기가 필요 없습니다. 목적 함수가 미분 불가능한 경우, 예를 들어 인간 피드백이나 외부 평가 도구를 쓸 때도 작동합니다.

긴 호라이즌이나 희박한 보상 환경에서도 잘 동작합니다.

보상 해킹이 적고 노이즈에 강합니다. 단일 정책이 아닌 모델 집단을 최적화하면서 많은 샘플을 평균화하기 때문에, 보상 함수를 악용하기 훨씬 어렵습니다.

병렬화가 쉽습니다. 각 교란 모델을 GPU에서 독립적으로 평가할 수 있습니다.

역전파가 필요없어서 GPU 메모리를 절약합니다.

강화학습 학습에 비해서 분산이 훨씬 낮아, 더 안정적으로 동작합니다.

그리고 마지막으로, ES는 수십억 파라미터 규모의 모델로도 실제로 확장할 수 있습니다. 이전까지는 불가능하다고 여겨졌던 일입니다.

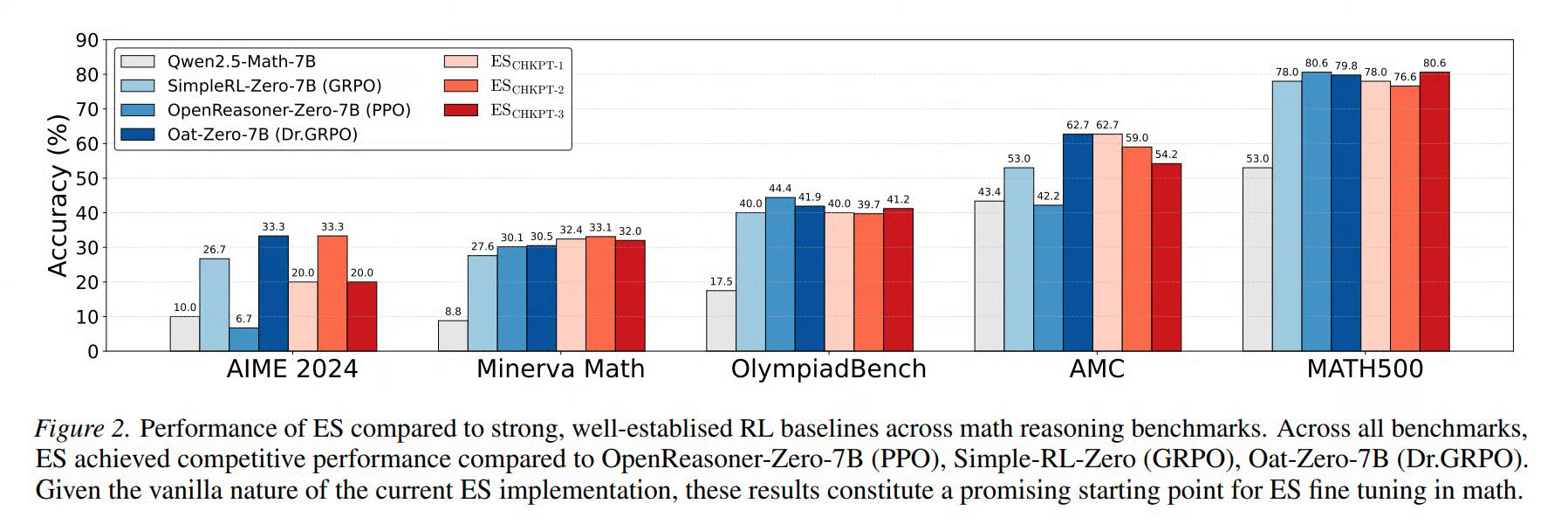

성능 수치를 보면, Countdown 벤치마크에서 ES는 강화학습의 베이스라인을 넘어섰습니다. Qwen-2.5-3B는 ES로 10.0% → 60.5%까지 올랐는데, GRPO의 32.5%와 비교되는 수치죠. Llama-3.1-8B는 8.1% → 61.2%로 개선됐고, 강화학습의 ~51%와 대조됩니다.

수학 벤치마크(AIME 2024, MATH500, AMC, OlympiadBench)에서도 강력한 결과를 보여줬고, ARC-AGI(0.2% → 29.5%)와 스도쿠(2.5% → 69.5%) 같은 퍼즐 태스크에서는 특히 눈에 띄는 성능 향상을 기록했습니다.

Image Credit: Evolution Strategies 오리지널 논문

다만, 아직 풀어야 할 과제도 분명히 있는데, 바로 수많은 순전파 평가가 필요해서 연산 비용이 상당하고, 보상 신호의 품질에 크게 의존한다는 점입니다.

학습 사이클 관점에서 보면, 기울기 없는 ES는 사후 학습의 최적화 단계에 자리합니다. 사전 학습 → 사후 학습 목표 정의 → 최적화 방법이라는 흐름에서, 기울기 하강 대신 ES가 그 자리를 차지하는 방식입니다.

그리고 바로 여기서 흥미로운 질문이 나옵니다. 과연 LoRA와 ES를 결합하면 어떻게 될까요?

LoRA + ES 하이브리드

LoRA와 ES는 모두 사후 학습에 속하지만, 두 가지는 학습 프로세스의 서로 다른 레이어에서 작동합니다.

LoRA와 생성된 어댑터는 파라미터화(Parameterization)를 담당합니다.

진화 전략은 최적화(Optimization)를 담당합니다.

두 방법이 서로를 자연스럽게 강화한다는 점이 흥미로운데요. 최적화 대상을 바꿔서 ES를 LoRA 파라미터에만 적용하면, 나머지 모델은 손댈 필요가 없습니다.

이렇게 구성되는 새로운 워크플로우 파이프라인은 이렇습니다.

사전 학습된 모델에서 시작합니다.

베이스 LLM 가중치를 고정합니다.

선택한 레이어에 LoRA 어댑터를 부착합니다. 이제 ES가 LoRA 파라미터 공간에서 직접 탐색할 수 있습니다.

LoRA에 ES를 적용해서 다양한 LoRA 교란을 샘플링합니다.

태스크에 대해 모델을 평가합니다.

더 나은 성능을 보인 변형 버전을 유지하고 LoRA 어댑터를 업데이트합니다.

ES의 성능은 파라미터 공간의 차원 수에 크게 좌우되는데, LoRA는 이 공간을 전체 LLM의 약 70억~700억 파라미터에서 약 100만~2000만 파라미터로 확 줄여줍니다. ES나 LoRA만 따로 쓸 때보다 파인튜닝의 확장 가능성이 훨씬 현실적이고 매력적으로 바뀌는 거죠.

LoRA는 모델의 진화가 일어날 수 있는 새로운 차원의 레이어를 제공합니다 - 거대한 모델 전체를 건드리는 대신, 추론 전략이나 도메인 지식, 정렬 정책(Alignment Policy) 등을 담은 소형 어댑터 모듈만을 진화시키는 방식으로요. 이 모듈들은 아주 가볍기 때문에 수많은 변형 버전을 순식간에 테스트할 수 있고, 최적의 상태를 찾아가는 탐색 프로세스 또한 비약적으로 효율화됩니다.

특히 모델의 유의미한 업데이트는 대개 저차원 부분 공간(Low-dimensional Subspace)에 집중되어 있는데, LoRA가 바로 이 공간을 명확하게 정의해 주는 역할을 합니다. 덕분에 미분 계산이 필요 없는 영차 최적화(Zeroth-order Optimization) 방식인 진화 전략이 그 잠재력을 십분 발휘할 수 있는 완벽한 환경이 조성되는 것입니다.

결론: 가장 최신의 사후 학습 지형도

정리하자면, 사후 학습 단계에서 모델이 제대로 작동하도록 리드하는 방법들의 전체 스택은 이렇습니다.

지도 미세조정(SFT): 가장 단순하고 여전히 가장 흔한 방법입니다. 명령-응답 데이터셋으로 모델을 학습시키고 표준 기울기 하강으로 최적화합니다. 단순하고 안정적이지만 정렬 능력에 한계가 있습니다.

강화학습: 현재 가장 지배적인 패러다임이죠. PPO, GRPO, GSPO 등 다양한 알고리즘을 활용하는 RLHF와 RLVR이 포함됩니다.

직접 선호도 최적화(DPO): RLHF의 대안으로, 선호 응답 > 비선호 응답을 직접 최적화합니다. 학습이 더 단순하고 불안정한 강화학습 루프를 피할 수 있습니다.

진화 전략(ES): Cognizant AI Lab의 접근법입니다. 기울기 기반 최적화 대신, 파라미터를 무작위로 교란해서 성능을 평가하고, 더 나은 방향으로 모델을 업데이트합니다.

고급 LoRA 방법을 활용한 파라미터 효율적 미세조정(PEFT): 전체 모델이 아닌 작고 핵심적인 부분만 업데이트합니다. 오늘 살펴본 접근법들은 비용을 줄이는 데 그치지 않고 새로운 능력을 더하기도 합니다.

그리고 마지막으로, 이 모든 것을 하이브리드 형태로 혼합하는 방식이 있습니다. 실제로 가장 자주 쓰이는 형태이기도 하죠. SFT → DPO → RAG를 얹은 에이전틱 자기 개선, 혹은 새롭게 제안되는 LoRA + ES 조합처럼요. LoRA가 컴팩트한 파라미터 부분 공간을 정의하고, 진화 전략이 기울기 없이 그 공간을 탐색하며 최적의 어댑터 파라미터를 찾아나가는 방식입니다.

한 발짝 물러서서 이 모든 것을 함께 바라보면, LoRA와 ES 같은 최적화 전략을 둘러싼 새로운 아이디어들은 언어 모델을 개발하는 방식 자체가 바뀌고 있다는 것을 시사합니다. 이전에는 모델 자체가 완성품이었고, 학습이 완성된 시스템을 만들어냈습니다. 그런데, 이제 베이스 모델은 점점 더 플랫폼으로 기능하고 있습니다. 능력은 어댑터, 검색 시스템, 도구 통합, 최적화 루프 같은 모듈 컴포넌트를 통해서 더해지는 것이구요. 모든 것이 모델 주변의 에코시스템을 설계하는 프로세스로 바뀌어가고 있는 거죠.

그 에코시스템에서 LoRA는 파라미터 부분 공간을 제공하고, 진화 전략은 최적화 메커니즘으로 작동하고, 오늘 살펴본 어댑터 생성 기법들은 지식을 모듈로 변환하고, 함께 쌓고, 효과적인 랭크로 압축하는 새로운 길을 열어줍니다. 전체 모델을 재학습하지 않고도 능력이 진화하고 재결합되는 시스템. 이것이 바로 AI 모델을 위한 새로운 유형의 파인튜닝 스택입니다.

잊지 말아야 할 가장 중요한 교훈은 바로 이겁니다. 모델을 더 효과적으로 사후 학습하는 방법은 여러 가지이고, 우리는 그 가능성들을 간과할 여유가 없다는 것.

보너스 및 참고자료

Doc-to-LoRA: Learning to Instantly Internalize Contexts | Paper

Text-to-LoRA: Instant Transformer Adaption | Paper

Instant LLM Updates with Doc-to-LoRA and Text-to-LoRA | Blog Post

LoRA-Squeeze: Simple and Effective Post-Tuning and In-Tuning Compression of LoRA Modules | Paper

Kron-LoRA: Hybrid Kronecker-LoRA Adapters for Scalable, Sustainable Fine-tuning | Paper

MoA: Heterogeneous Mixture of Adapters for Parameter-Efficient

Fine-Tuning of Large Language Models | PaperEvolution Strategies at Scale: LLM Fine-Tuning Beyond Reinforcement Learning | Paper

튜링 포스트 코리아는 독자들의 응원으로 만들어집니다. 가치있는 컨텐츠를 지속적으로 여러분과

공유할 수 있도록, 커피 한 잔으로 힘을 보태주세요 ☕

튜링 포스트 코리아의 인사이트가 담긴 컨텐츠를 마음껏 읽어보세요!

프리미엄 플랜으로 업그레이드하시면 튜링 포스트 코리아의 모든 컨텐츠를 제한없이 보실 수 있고, 튜링 포스트 코리아의 컨텐츠 제작에 큰 도움이 됩니다. 감사합니다!

주간 AI 뉴스레터

AI 유니콘 기업들에 대한 심층 분석 기사

AI 기술, 산업, 정책 전문가 인터뷰

AI 기술 및 산업에 대한 심층 분석 시리즈

분석 기사 요청 및 튜링 포스트 코리아 기고 기회 제공

읽어주셔서 감사합니다. 친구와 동료 분들에게도 뉴스레터 추천해 주세요!