AI가 진짜 현실이 된다: 가속화 (Acceleration), 현실 인식과 재평가 (Recokining), 자원 경쟁 (Resource Race)의 해

며칠 전, 스탠포드에서 ‘State of AI 2025’라는 이름으로 다양한 관점에서 AI 기술과 산업, 시장의 현황을 조사 분석하고 지수화한 최신 보고서를 발간했습니다. 456페이지짜리 방대한 보고서네요. ^.^;

보고서의 서두에 12가지 핵심 사항이 요약되어 있고, 저희 FOD에서도 중요하다고 생각하는 내용을 말씀드리지만, 한 번 시간을 내서 쭉 보시기 바랍니다. 이 보고서를 살펴보는 몇 가지 방법이 있을 텐데요:

목차를 보면 R&D, Technical Performance부터 Education, Public Opinion까지 총 8개의 챕터로 구성이 되어 있습니다. 특별히 관심있는 영역이 있으시다면 해당 챕터로 이동하셔서 자세한 내용을 보시는 방법이 있겠구요.

‘클래식하게’ Ctrl+F (맥에서는 Cmd+F)를 사용해서, 관심있는 ‘키워드’ 기반으로 검색, 해당 내용을 전후로 살펴보시는 겁니다. ‘Hallucination’으로 검색해 봤더니 17개 검색 결과가 나오네요.

저희가 권해드리는 방법은 이겁니다: Gemini 2.5에 보고서 PDF를 업로드 - Gemini 2.5의 컨텍스트 윈도우가 엄청 커서, 456페이지 짜리 보고서를 실제로 업로드할 수 있습니다 - 하시고, 질문 답변을 계속해서 쭉 이어서 하면서 보고서 내용을 확인하고 궁금한 걸 해소하는 겁니다. 그러고 보면, 이 보고서가 Gemini 2.5 모델을 테스트해 보기 좋은 문서이기는 하네요 - 밀도가 높은 다양한 관점의 내용을 포함하고 있으니까요. 몇 번 테스트를 해 보니, 이렇게 하는 방식이 그냥 Back-to-Back으로 읽는 것보다 오히려 더 구체적인 내용을 잘 이해하고 통찰력을 얻을 수 있는 가능성도 높다 싶습니다. 사실 이 보고서가 문학 소설은 아니잖아요? 꼭 Back-to-Back으로 읽을 필요도 없습니다.

어쨌든 좋습니다. 중요한 건, 이 방대한 스탠포드의 AI Index Report 2025에 기록되어 있는 ‘AI의 현황’은 어떤 모습일까요?

이전 몇 년의 기록이 ‘AI의 눈부신 잠재력’에 대한 것이었다면, 2024년은 AI가 제대로 우리의 일터에 모습을 드러내면서 우리 경제와 일상 생활에 깊이 뿌리내리기 시작한 해라고 이야기하고 있습니다. 물론, 그 ‘진입’이 그저 순탄하지만은 않습니다. 촛점없이 뿌옇게 미래를 바라보는, 과장된 Hype은 이제 그만 잊으세요. 여기서 가장 흥미로운 이야기는, ‘AI 기술 발전과 도입의 맹렬한 가속화’, ‘엄청난 자원 요구량에 대한 걱정과 대응’, 그리고 ‘대중의 인식이 변화하는 과정과 충돌’이라고 생각합니다.

가장 두드러진 변화라면, ‘AI가 실질적으로 경제 활동의 주체들과 통합되어간다’는 겁니다. 국가별로, 영역별로 물론 차이는 있습니다 - 꽤 크죠. 그렇지만 전반적으로, 기업들은 초기의 실험 단계는 넘어서고 있는 걸로 보여요. AI 채택율이 극적으로 증가하면서 78%의 기업이 AI를 사용한다고 이야기하고 있고, 생성형 AI 기술의 채택은 단 1년 만에 두 배 이상 증가했습니다.

AI는 틈새 (Niche)를 공략하는 도구에서 이제 ‘핵심적인 비즈니스 동력’으로 자리를 차지하기 위해 이동하고 있습니다. 수많은 연구 결과가 연구실을 벗어나서 현장에서 실질적인 생산성 향상에 기여하고 있구요. 재미있는 건, 이전의 예상과는 다르게 ‘비교적 낮다고 평가되었던, 육체적인 기술을 가진 노동자들보다도 지식 노동자들의 업무에 영향이 큰 것’으로 나타나고 있어서, ‘자동화의 종말’에 대한 서사는 생각보다 많이 복잡해지고 있습니다.

공학한림원 선정 ‘40년 후 세상을 지배할 미래 10대 기술’ 중 삽화. Image Credit: 매일경제

위 그림은 2019년 공학한림원에서 선정한 ‘40년 후 세상을 지배할 미래 10대 기술’ 관련한 삽화인데, 인공지능을 탑재한 로봇이 수많은 일을 하지만 대부분 ‘육체적인’ 일을 나타내죠 - ‘가사일 90% 담당’, ‘제조업 100% 담당’ 처럼 말이죠. 하지만, AI가 마케팅 카피를 작성하고, 법률 판례를 조사하고, 신약이나 신물질 발견 과정을 지원하는 등, 지식 노동자들의 업무에 오히려 더 큰 변화가 나타나고 있습니다.

이렇게 AI 기술이 엄청나게 빠르게 발전하면서 우리의 일상과 일터에 통합되는 과정에서, 최첨단에서의 경쟁은 역설적으로 더욱 치열해지면서도 집중화되고 있습니다. SOTA 모델들 간의 성능 격차는 줄어들면서 Commodity화 되어가고, 오픈웨이트 모델들이 독점적인 거대 모델들을 빠르게 따라잡고, 중국은 성능 벤치마크에서 미국을 따라잡는 놀라온 속도를 보여주고 있습니다.

문제는, 이런 최첨단의 우수한 성능을 얻어내려면 기하급수적으로 증가하는 자원이 필요하다는 건데요. AI 모델의 트레이닝에 필요한 컴퓨팅 파워는 5개월마다 2배로 증가하고, 전력 소비는 매년 두 배씩 증가하고, 트레이닝 비용은 수조원은 우습다는 듯이 엄청난 수치에 도달하고 있습니다. GPT-4의 경우에 이미 10억 달러짜리 규모의 트레이닝 실험이 진행 중이구요. 이런 엄청난 비용 때문에, AI의 사용 자체를 위한 추론 (Inference) 비용이 저렴해지는 와중에도, 주로 미국의 산업에 최첨단의 개발 능력을 집중시키게 됩니다. 이건 단순히 ‘누가 더 빠른 칩을 만드느냐’의 문제가 아닙니다 - 매 순간 더 벌어지고 있는 국가 간 자원의 격차를 봐야 합니다.

이 보고서에서 가장 덜 논의되고 제대로 다루어지지 않았다고 생각하는 건 두 가지입니다. 지속 가능성 (Sustainability)과 AI의 리스크에 대한 사회적인 토론과 준비, 거버넌스 문제입니다.

지속 가능성의 차원에서는, ‘탄소 비용’보다 중요한 게 ‘데이터의 부족' 문제입니다. 우리가 사용하는 오픈 웹의 ‘공개된 데이터 자원 (Data Commons)’은 빠르게 줄어들고 잇습니다 - 일부는 스크래핑의 제한을 하기도 하고, 컨텐츠에 접근을 막기도 하고, 사라지는 정보들도 있죠. 어떤 전문가는, 2026이면 우리가 보유하고 있는 데이터의 한계에 부딪히게 될 거라고 이야기하기도 합니다. 이제, ‘규모’, ‘스케일링’에 의존하는 방식은 더 이상 작동하지 않을지도 모릅니다. 합성 데이터가 앞으로의 길일까요? 아니면 새로운 모델 아키텍처가 필요한 걸까요? 이게 바로 우리가 탐구하고 대답해야 할 질문일 겁니다.

지난 3년간, AI 리스크와 거버넌스에 대한 논의의 시간은 ‘허무맹랑한 터미네이터식 멸망의 날’에 대한 내러티브, 그리고 실질적이지 못한 수준의 윤리/정책 등에 대한 탁상공론으로 허비되었습니다. 어떤 컨퍼런스를 가든, 어떤 웨비나를 보든, 지겹게도 똑같은 이야기의 반복일 뿐입니다. 우리가 현재 예상할 수 있고 실질적인 AI의 리스크를 대상으로, 경제적으로 가능한 (Economically Viable), AI와 우리가 마음 편히 공존할 수 있는 ‘사회 경제적 메커니즘’에 대한 논의를 지금부터라도 시작해야 합니다.

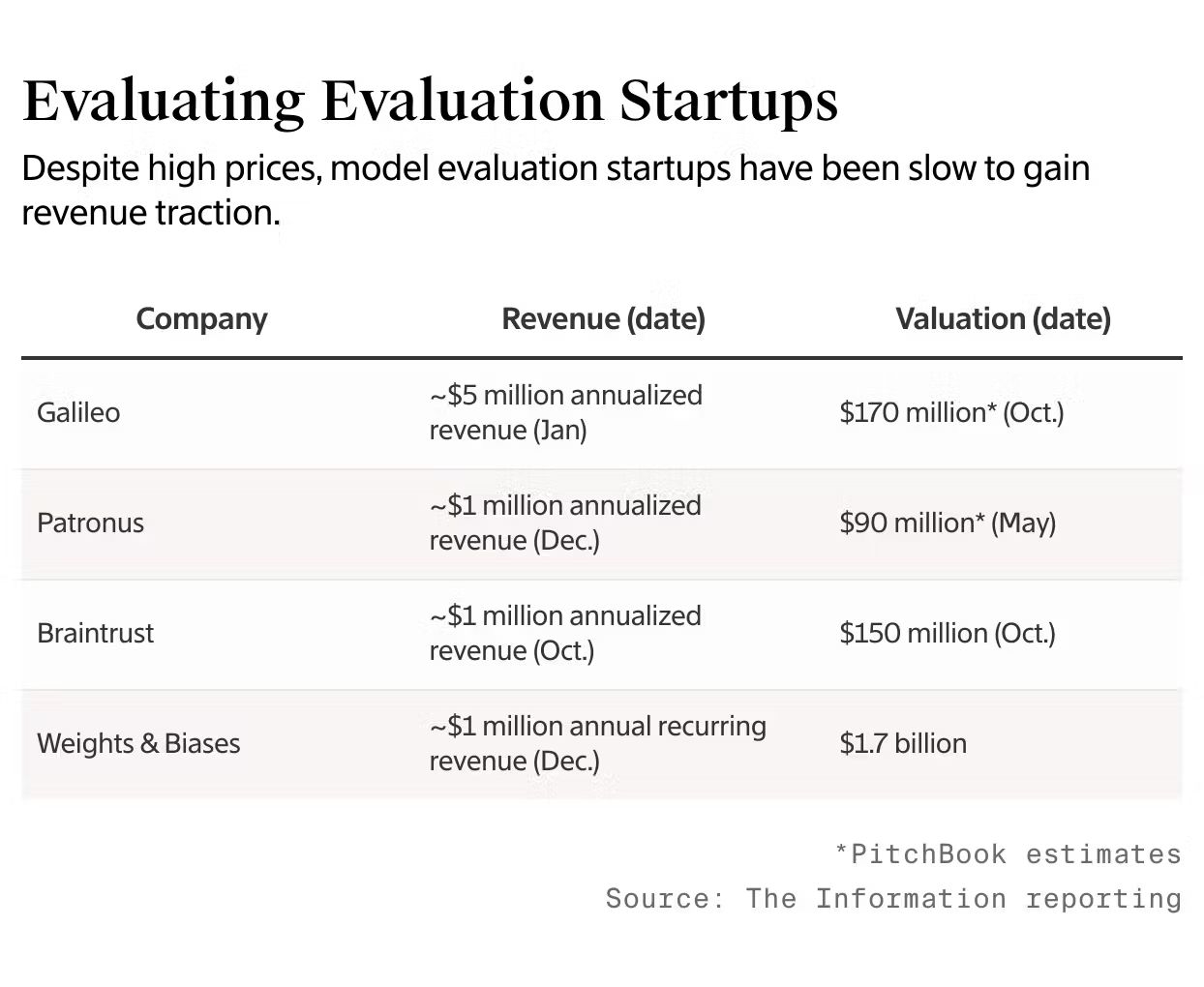

그런 의미에서, 어제 The Information에서 커버한 ‘Revenue Lags at AI Evaluation Startups’라는 제목의 기사는 시사하는 바가 큽니다 - 일반적인 AI 스타트업들과 이 AI Evaluation들의 성과의 격차가 바로 우리 ‘인식의 격차’를 보여주기 때문이죠:

높은 Valuation에도 불구하고, AI를 평가하는 스타트업들의 매출은 그리 빠르게 늘어나지 않고 있습니다.

Image Credit: The Information

(AI와 같은) 새로운 기술이 파도가 들이치듯이 사회에 충격을 주면, ‘기술의 진보’ 편에 있는 그룹 vs. ‘그 흐름에 저항’하는 편에 있는 그룹 간의 줄다리기는 항상 생기기 마련입니다. 과학적 성과는 ‘날마다’라고 해도 과언이 아니라 정도로 우리를 놀라게 하고, 이 성과에 기반한 ‘상업적 시도’는 계속해서 늘어나고 있지만, 그 이면에서 AI와 관련된 사고, 편향성 이슈, 대중의 불신 등도 고개를 숙이지 않으니까요. 기업들은 이미 그 위험을 알고 있습니다 - 그래서 몸을 사리고 빨리 움직이지 않는 측면도 있을 겁니다. 정부나 규제 기관도 나름대로 투자와 조정을 하는 등 노력은 하지만, 너무나 변화의 속도가 빠르고, 결국 여론은 낙관론, 지역적 균열, 직업에 대한 불안, 데이터 처리의 관행에 대한 낮은 신뢰 등을 키워드로 분열됩니다.

스탠포드의 ‘Status of AI 2025’ 보고서에서 가장 중요한 것은 ‘가속화 (Acceleration)’가 아닙니다. 그 ‘가속화’가, 우리가 사는 유한한 세계에서 거의 무한한 자원과 관심의 투입을 요구한다는 점입니다. 이제 우리는 혁신과 절제, 속도와 책임을 조화시킬 수 있을지에 대한 전세계적인 시험에 직면하게 되었습니다. 그런 ‘긴장 관계’ - 자원, 안전성, 신뢰를 둘러싼 긴장 관계 - 가 결국 어떤 리더보드보다도 우리가 만들어야 할 중요하고 의미있는 AI의 유산 (Legacy)을 만들어내게 될 겁니다.

스탠포드 AI 보고서만으로도 충분히 많은 내용이지만, 이 보고서도 한 번 확인해 보세요: ‘Anthropic Education Report: How University Students Use Claude’ - 대학생들이 Claude를 어떤 분야의 작업에 어떤 목적으로 사용하고 있는지 ‘추정’해 볼 수 있는 자료입니다. 아직 성급한 결론을 내기는 이르다고 생각합니다.

Image Credit: 앤쓰로픽

트위터 라이브러리 (Twitter Library) 🐦

지난 몇 주 동안, 추론 시간 스케일링 (Inference-Time Scaling)에 관해서 많은 새로운 연구가 나왔습니다. 이 기법들이 모델 파라미터 숫자를 늘리지 않고도 LLM이 더 좋은 능력을 보여줄 수 있게 하기 때문에 아주 매력적인 수단이죠.

그래서 오늘은, 이와 관련된 13가지 새로운 기법, 그리고 3가지 종합적인 연구 내용을 간략히 소개합니다:

*아직 튜링 포스트 코리아 구독 안 하셨나요? 구독해 주시면 매주 중요한 AI 뉴스를 정리한 다이제스트를 받으실 수 있습니다!

튜링 포스트 코리아팀이 읽고 있는 것들

Are AI Agents Sustainable? It depends – by Sasha Luccioni and Brigitte Tousignant and Yacine Jernite

허깅페이스의 세 사람 - Sasha, Brigitte, 그리고 Yacine - 이 이전에 ‘AI Agents Are Here. What Now?’라는 글을 쓴 적이 있습니다. AI 모델이 폭발적으로 증가하는 ‘기술의 민주화’ 시대에, ‘윤리의 민주화’가 자연스럽게 따라오지는 않으며, 이 윤리적 책임은 ‘개발자’라는 한 계층을 넘어 다층적인 생태계 전반으로 확장되어야 한다는 문제 의식을 제기합니다. 이 글에서 언급한 여러가지 잠재적인 해결 방안들 중에, 허깅페이스는 ‘메타데이터 표준화’, ‘커뮤니티 리뷰’, ‘리스크 기반 필터링’ 등 모델 배포 투명성과 안전성을 확보하기 위한 실험을 진행 중이라고 합니다.

그 이후, 이어진 글로 쓴 게 바로 위의 글 ‘Are AI Agents Sustainable? It depends’인데요. 현재 구조의 AI 에이전트가 지나치게 많은 자원을 소비하면서도 신뢰성과 실용성이 부족해서, 과연 이게 지속 가능한 기술이라고 볼 수 있느냐는 비판을 하고 있습니다. 이에 대해서, 허깅페이스는 ‘소형 모델로의 패러다임 전환’, ‘툴체인 구조의 재설계’, ‘효율 중심의 벤치마킹’ 등으로 실질적으로 지속 가능한 에이전트 개발을 해야 한다고 촉구하고 있습니다. 어려운 표현으로는 ‘적정 기술’, 쉽게 말하자면 ‘모기잡는데 대포를 쓸 수는 없는 노릇’이죠.

속도, 성능 경쟁에 매몰되기 쉬운 AI 기술과 산업의 Landscape에서, 잊지 말고 있어야 할 지점들을 지적한다고 생각합니다.

금주의 주목할 만한 업계 동향 📰

금주, ‘큰 덩어리’의 뉴스들이 쏟아진 한 주였습니다:

Google Cloud Next 2025 - AI 제국의 역습

구글 AI 제국의 역습.

Iron (구글의 TPU), Flash (구글의 모델), Protocol (프로토콜)까지 전열을 가다듬어 총반격에 나선 것 같은 모습의 구글, ‘AI 제국의 역습’이라는 표현이 전혀 어색하지 않습니다.

구글 CEO 순다 피차이는 이 행사를 시작하면서 모두에게 확실하게 밝혔습니다: 구글은 그 자체로 AI 회사란 것을요. 조용하면서도 자신감있었던 이 메시지, 구글의 강력한 하드웨어, 소프트웨어, 그리고 표준의 제시로서 뒷받침되었습니다.

먼저 TPU v7 ‘아이언우드’부터 살펴봅시다 구글의 7세대 AI 칩이 올해 말 출시되는데, 완전한 구성을 했을 때 42.5 엑사플롭스(Exaflops)라는 처리 성능을 보여줄 거라고 합니다 - 이건 세계 최고의 슈퍼컴퓨터보다 24배 빠른 수치입니다. 초대형 규모의 AI 추론 (Inference)을 위해서 설계된 칩입니다.

순다 피차이 키노트에서 TPU 소개. Image Credit: 구글

Gemini 2.5 Pro와 Flash 모델 - 새로운 Gemini 제품군은 추론, 코드, 수학 분야에서 한층 더 발전했습니다. Gemini 2.5 Pro는 100만 토큰 컨텍스트 윈도우를 지원하고, 복잡한 워크플로우에 맞게 설계되었다고 합니다. Flash 모델은 배포와 응답성에 최적화된, 더 가볍고 빠른 변형 모델을 제공합니다.

Firebase Studio - Cursor 같은 플랫폼의 경쟁자로 자리매김할 새로운 개발자 도구로, 풀스택 AI 앱 개발을 도와줍니다. Project IDX, Genkit 및 Gemini의 기능을 결합해서 자연어로 프로토타입을 만들고, 여러 종류의 기기에서 코드를 작성하고 미리 볼 수 있고, 단일한 브라우저 탭에서 모두 배포할 수 있는 워크플로우를 제공합니다. 전체 프로세스에 걸쳐서 대화형 지원을 하기 위해 Gemini를 통합했습니다.

Vertex AI의 확장 - Vertex AI를 통해 접근할 수 있는 구글의 생성형 AI 제품군이 이제 이미지, 비디오, 음악, 음성 분야에 걸쳐 확장되었고, 미디어 유형에 상관없이 생성형 기능을 제공하는 유일한 플랫폼이 되었습니다. 새로운 도구로 Imagen 3, Veo 2, Lyria, Chirp 3 등이 있고, 안전성, 워터마킹, 지적 재산권(IP) 보호 기능이 내장되어 있습니다.

개발자 커뮤니티와 시장에 반향을 일으키고 있는 A2A (Agent-to-Agent) 프로토콜입니다. 앤쓰로픽의 MCP와는 상호 보완적인 관계에 있는 것으로 보이는, 별도의 프로토콜입니다. A2A는 구조화된 메시징, 기능의 공유, 협업 워크플로우를 통해서 ‘자율 AI 에이전트 간의 통신을 표준화’하는 것이고, MCP (Model Communication Protocol)는 표준화된 인터페이스를 통해서 AI 모델을 외부 데이터 및 도구에 직접 연결해서 Context-Awareness를 향상시켜 줍니다.

Image Credit: 구글 (How A2A Works)

오픈AI, 역시 가만히 당하고 있지는 않는다

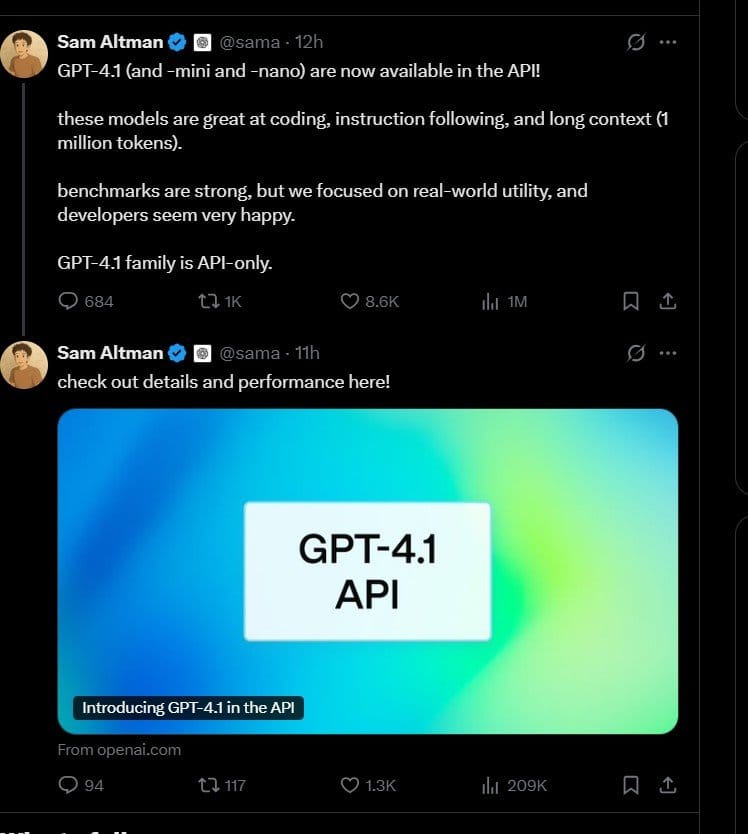

샘 알트만, GPT-4.1 API 깜짝 공개 - 바로 어제, 오픈AI의 새로운 AI 모델 GPT-4.1, 그리고 경량화 버전 GPT-4.1 mini, GPT-4.1 nano를 공개했습니다. 벤치마크 성능 뿐 아니라 실제의 사용 경험에 중점을 둔 모델이라고 이야기하고 있고, 특히 GPT-4.5과 비교해서 성능 대비 낮은 비용으로 운용할 수 있다고 강조햇는데요. 그런데, 모델의 버전명, 그리고 그에 대응하는 기능이나 성능이 이제 본격적으로 헷갈리기 시작하는데요. 한 번 정리를 해 봐야겠습니다.

챗GPT, ‘더 좋은 메모리’를 얻는다 - 바로 ‘당신의 기억’: 최신 업데이트를 통해서, 이제는 챗GPT가 응답을 개선하기 위해서 모든 과거의 대화를 참조할 수 있게 되었습니다. Plus와 Pro 사용자(유럽경제지역 및 관련 국가 제외)가 먼저 이 기능을 사용할 수 있다고 하는데요. 이 기능을 원하지 않으신다면, 클릭 한 번으로 비활성화할 수도 있습니다. 이 기능을 사용하는 사람이 많아진다면, Switching Cost를 높이는 일종의 해자 (Moat)로 작동할 것 같네요.

더불어 EU 경제 청사진이라는 걸 발표했는데, AI가 주도하는 번영을 추진하려면 컴퓨팅, 데이터, 에너지, 인재 4개의 축으로 전략을 수립하고 실행해야 한다고 제안하면서, 자칫 잘못하면 270개도 넘는 규제 기관들 때문에 유럽의 꿈이 그냥 서류더미 속에 파묻혀 버릴 수 있다고 경고했습니다.

Pioneers Program (파이오니어 프로그램) - 스타트업이 ‘세 가지 중요한 산업에서의 유즈 케이스를 만들기 위해서 맞춤형으로 모델을 파인튜닝하는데 도움을 주는 프로그램입니다. 이 프로그램은 도메인별 평가 벤치마크를 만들거나 강화학습 파인튜닝을 통해서 전문가 모델을 개발하는 걸 도와주는데, 오픈AI 연구원들과 긴밀하게 협력하면서 법률, 헬스케어, 금융 등의 산업에서 AI의 성능을 향상시키겠다는 목표로 진행된다고 합니다.

새로 나온, 주목할 만한 연구 논문

‘주목할 만한 최신의 AI 모델’을 먼저 소개하고, 각 영역별로 ‘Top Pick’은 해당 논문 앞에 별표(🌟)로 표시했습니다!

주목할 만한 최신 AI 모델

🌟SmolVLM (Hugging Face and Stanford University)은 효율적인 토큰화 메커니즘과 아키텍처를 갖춘 소형 VLM(Vision Language Model) 제품군을 소개하는데, 1GB 미만의 GPU 메모리를 사용해서 훨씬 큰 모델보다 더 우수한 성능을 보여준다고 합니다.

🌟Cogito v1은 IDA (Iterative Distillation and Amplification) Alignment로 트레이닝한 오픈 LLM (Large Language Model) 제품군을 선보이는데, 3B부터 70B까지의 모든 사이즈에서 다른 오픈 모델보다 뛰어난 성능을 발휘한다고 합니다.

Kimi-VL은 강력한 에이전트 기능을 갖추고 긴 컨텍스트를 잘 이해하는 오픈소스 2.8B MoE(Mixture of Experts) VLM을 출시합니다. 추가적으로 CoT 추론을 위해서 튜닝한 "Thinking" 변형 모델도 함께 제공합니다.

에이전틱 디스커버리 (Agentic Discovery), 리서치 도구

🌟The AI Scientist v2 (Sakana AI, UBC, Vector Institute, and Oxford)는 가설을 세우고, 실험을 실행하고, 데이터를 분석하고, 논문을 작성하는, 사카나 AI에서 발표한 ‘LLM 기반의 자율 에이전트’입니다. 반복적인 과정을 통해 결과를 개선하기 위해서, 에이전트 트리 검색과 VLM 피드백을 사용하고, 사람이 작성한 코드 템플릿을 제거했습니다. ICLR 2025 워크숍에 제출된 세 개의 논문 중 하나가 6.33점으로 피어 리뷰를 통과했습니다.

🌟Debug-gym (Microsoft)은 LLM이

pdb같은 도구를 사용해서 단계별 디버깅 과정을 학습할 수 있는 인터랙티브 샌드박스 코딩 환경을 제공합니다. 리포지토리 레벨에서의 추론을 지원하고, 디버깅 에이전트를 평가하기 위한 벤치마크(Aider, Mini-nightmare, SWE-bench)를 포함하고 있습니다. 초기 실험에서 도구에 대한 접근 권한이 있는 LLM이 SWE-bench Lite에서 그렇지 않은 LLM보다 훨씬 뛰어난 성능을 보여주었다고 합니다.

트레이닝 데이터 및 모델 Auditing

🌟 OLMoTrace는 부분 문자열 매칭을 스케일링해서, 실시간으로 생성된 출력물로부터 원본 훈련 데이터까지 추적할 수 있습니다.

Are You Getting What You Pay For?는 LLM API가 은밀하게 모델을 대체하는지 체크하고, 현실적인 공격 시나리오에서 탐지 전략을 테스트합니다.

멀티모달 시스템 및 아키텍처

MM-IFEngine은 고품질 데이터와 규칙 기반 + 모델 기반 지표를 사용해서 정확한 멀티모달 명령을 수행하기 위한 훈련 및 평가 파이프라인을 구축합니다.

🌟 Scaling Laws for Native Multimodal Models는 457개의 네이티브 멀티모달 모델을 분석해서 Early-Fusion 아키텍처가 효율성과 확장성 면에서 Late-Fusion 아키텍처보다 더 우수한 성능을 보이는 경우가 많다는 것을 발견했다고 합니다.

MoE (전문가 혼합 모델) 서빙 및 최적화

🌟MegaScale-Infer (ByteDance)는 MoE(Mixture of Experts) 모델에서 어텐션과 FFN(Feed-Forward Network) 레이어를 분리하고, Ping-Pong Parallelism과 맞춤형 M2N 통신을 도입해서 더 빠르고 저렴하게 추론을 할 수 있게 해 줍니다.

🌟 Hogwild! Inference (Yandex)는 공유 어텐션 캐시를 통해서 여러 LLM(Large Language Model) 인스턴스를 병렬로 실행해서 파인튜닝을 하지 않고도 처리량을 높여줍니다.

C3PO는 Similarity-based Surrogate (유사성 기반 대리자)를 사용해서 주요 레이어의 전문가 믹싱을 재가중치화함, MoE LLM의 Test-Time Accuracy를 높여줍니다.

추론 (Reasoning), 강화학습 및 CoT 기법

🌟 Self-Steering Language Models (MIT and Yale)는 DisCIPL을 소개하는데, 이건 계획을 맡은 LM(Language Model)이 ‘더 작은 LM이 따를 수 있는 재귀적 추론 프로그램을 작성’해서 효율성과 제어를 향상시키는 방식입니다.

🌟 VAPO: Efficient and Reliable Reinforcement Learning for Advanced Reasoning Tasks (byteDance)는 가치 기반의 강화 학습을 기반으로 긴 CoT(Chain-of-Thought) 추론 모델을 더 안정적이고 샘플을 효율적으로 사용하면서 훈련합니다.

읽어주셔서 감사합니다. 프리미엄 구독자가 되어주시면 튜링 포스트 코리아의 제작에 큰 도움이 됩니다!