토픽 #1: 메타의 새로운 모델 Llama 4, 시장 반응은 제각각

메타가 지난 4월 5일, 예고도 없이 갑작스레 새로운 Llama 모델들을 대거 출시하면서 화제가 되었습니다. 처음에는 열광적인 (?) 반응이었는데, 시간이 지나면서 제각각 서로 다른 입장의 반응이 나오고 있습니다 - 비판도 있구요.

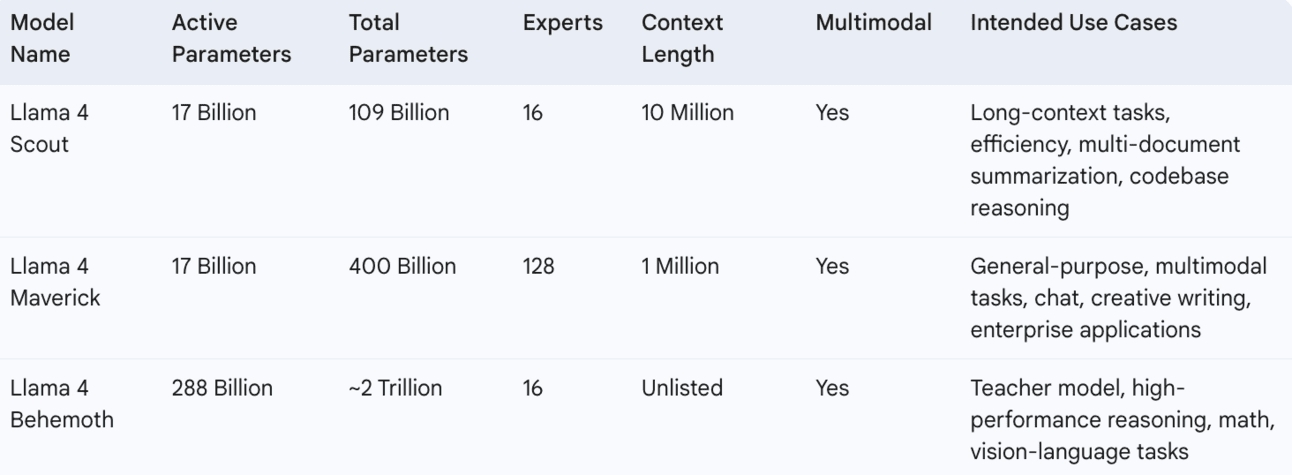

우선, 새로운 Llama 모델은 아래와 같은 것들입니다:

Llama 4 모델 패밀리

Llama 4 모델 패밀리의 가장 중요한 아키텍처 관점의 변화는, 바로 MoE (Mixture-of-Experts, 전문가 혼합) 기법을 도입한 것 아닐까 합니다. Llama 모델에서는 이 기법을 최초로 적용했는데요. 이 MoE 기법은, 잘 아시다시피 ‘입력이 들어왔을 때 모델 파라미터의 일부만 활성화’해서, 전체 파라미터는 크게 유지하면서도 연산량을 적절한 수준에서 관리할 수 있게 해 줍니다. 그런데 Llama에 적용된 MoE는 Fine-grained MoE라든가 이전에 보지 못한 새로운 형태라기보다는, 다소 일반적인 형태이기는 합니다.

‘성능’에 대한 초기의 유보적 시각

(아직 며칠 되지는 않았지만) 어떤 연구자나 사용자들은, Llama 4의 실제 성능, 특히 코딩 작업과 관련된 성능이 기대에 미치지 못한다면서 실망감을 표시하고 있습니다.

Reddit의 Kaminski 박사는 “방금 Llama-4-Scout와 Llama-4-Maverick을 추가해서 KCORES LLM Arena 테스트를 마쳤는데요. 이 모델들은 제 기대를 완전히 뛰어넘었습니다 - 부정적인 방향으로 말이죠.”라고 큰 실망감을 표현했습니다.

특히 모델 사이즈를 생각해 보면, 실망할 만한 여지가 있기는 하다 싶어요. Reddit의 DRMCC0Y는 “제가 해 본 테스트 기준으로는, 멀티모달 능력을 포함한 모든 면에서 Gemma 3 27B보다 Llama의 성능이 떨어집니다. 상상하기 어려운 결과예요.”라고 이야기했구요.

Maverick이 4,020억 (400B) 개의 파라미터를 가진 모델인데도, 많은 사람들이 이 모델이 Qwen-QwQ-32B 같은 훨씬 작은 모델과 비슷한 수준의 성능이라고 이야기하고 있습니다.

벤치마크 결과에 대한 논란

그리고, 벤치마크를 둘러싼 문제가 있습니다. 메타는 LMArena 리더보드에서 Llama 4 Behemoth 모델이 뛰어난 성능을 기록했다고 이야기했지만, 이 모델은 공개적으로 사용할 수도 없고 아직 훈련 중인 모델입니다. 이런, 약간 ‘앞뒤가 안 맞는’ 이야기들이 메타의 이번 발표에 대한 신뢰를 손상시키고 있고, 이번 모델 발표 자체가 오해의 소지가 있는 ‘마케팅 스턴트’라느나 비난을 자초한 측면이 있습니다.

그리고, Nathan Lambert는 “(메타의 이번 발표는) 교묘합니다. 극단적으로 이야기하면, 벤치마크 결과가 가짜라고 이야기해도 할 말이 없어요 - 메타가 이번에 발표한 모델과, 벤치마크에서 테스트한 모델 (블로그에서 ‘experimental chat version’이라고 표현이 되어 있어요)은 사실 같은 모델이 아니예요. 마케팅은 한 모델로 하고, 실제 테스트는 다른 모델로 하고 나서 출시하지 않는 행동은, 메타 커뮤니티에 대한 무시라고 할 수 밖에 없어요.”라고 글을 쓰기도 했습니다.

확장된 ‘컨텍스트 윈도우’의 현실, 그리고 하드웨어적인 제약

메타는 Llama 4 Scout 모델이 1,000만 토큰 컨텍스트 윈도우 모델이다 - 아주 큰 윈도우죠 - 라고 이야기하죠. 대략 일반적인 책 25~30권 분량의 텍스트를 한 번에 처리할 수 있다는 뜻입니다. 현실은, 대부분의 API 제공업체 (Llama 모델을 호스팅하는 서비스)들이 서버 메모리 제약이나 처리 비용 문제 등 때문에 128K ~ 328K 정도로 컨텍스트 윈도우를 제한하고 있는 상태에서, 급격한 컨텍스트 윈도우 확장이 실질적인 의미를 가지려면, 인내심을 가져야 할 겁니다.

그리고 Llama 4 모델군에서 처음 도입한 MoE는 거대한 모델의 연산 효율을 높여주지만, 일단 사이즈 자체가 너무 크다보니 ‘전체 모델을 우선 메모리에 로드’해야 한다는 측면에서 소비자가 사용할 수 있는 하드웨어의 기준을 높이는 결과가 되어버립니다. Fast.ai의 창립자인 Jeremy Howard는 “4090 - NVIDIA RTX 4090) 두 개를 써도 Scout 모델조차 너무 큽니다. 4비트 양자화 기법을 써도 말이죠”라고 말합니다. (RTX 4090이 약 24GB VRAM을 갖고 있으니, 4비트 양자화를 해도 어렵기는 하겠습니다.)

이런 문제는 오픈소스 AI 커뮤니티 관점에서는 무시하기 어려운 문제죠. 많은 개발자들이 개인 컴퓨터, 소규모 서버에서 모델을 올려서 쓰고 싶어하는데, 결과적으로 Llama 4의 아키텍처 때문에 그게 이전보다 더 어려워지고 있는 겁니다. 과연 이걸 ‘오픈소스 AI’ 정신에 합치하는 ‘접근성의 확대’라고 볼 수 있는 걸까요?

그래서, ‘실망’에 가까운, 제각각인 반응의 이유를 정리해 보면:

Llama 4가 기대에 못 미치는 반응을 얻고 있는 것, 위에서 이야기한 내용을 포함해서 입장에 따라 여러 가지 요인이 있을 겁니다.

지나치게 출시를 서둘렀다

올 초부터 아마도 메타를 압박해 왔을 DeepSeek-R1 효과에 더해서, Google Cloud Next 25가 곧 다가옵니다. 이미 구글도 실험실 수준으로는 작년부터 1,000만 토큰 컨텍스트 윈도우를 테스트한 것으로 알려져 있죠. 아마 메타도 구글의 대형 행사를 코앞에 두고, 선수를 치고 싶었을 거예요 - 인지상정입니다. 그래서 아마 ‘그 때까지만 완료된’ 모델을 공개한 것이 아닐까 해요.

아키텍처의 선택에 따른 장단점 (Trade-off)이 명확하다

위에서 이야기했다시피, MoE 아키텍처가 주는 장점 대비, 방대한 숫자의 파라미터 때문에 엄청나게 잘 조정을 하지 않으면 성능 상의 일관성에 영향을 줄 수 있습니다.

메타의 ‘AI 생태계 전략’과 합치하지 않는다

가장 작은 Scout 모델마저 개인이 사용할 만한 꽤 높은 사양의 그래픽카드에서 - 그것도 여러 장을 쓰는 환경에서도 - 운용하기가 힘들게 되었습니다. MoE 아키텍처와 연계된 모델의 대형화, 과연 오픈소스 AI 커뮤니티와 강력하게 상생하겠다고 한 메타의 AI 생태계 전략과 합치하는 방향의 모델 개발이었을까요? 어쩌면 역설적으로 그 방향이 메타의 AI 사업이라는 관점에서 합리적 선택이었을 수도 있습니다 - 거대 모델의 개발사와 거대 모델을 서비스하는 대형 클라우드 사업자 간 전략적 고리가 약화되고 있는 (예를 들면, 오픈AI와 마이크로소프트의 관계처럼요) 상황에서, 대형 클라우드 사업자에게 어필할 만한 ‘파운데이션 모델 개발사’로서 눈도장을 한 번 찍는 과정일지도 모르겠습니다.

(여전한) 라이센스의 제한

DeepSeek 같은 경우 라이센스의 범위가 아주 관대한 편이라고 할 수 있는데, 이에 비하면 메타의 라이센스 조건은 EU를 제외한다든지 상업적인 사용에 제한을 둔다든지 하는, 점점 더 제한이 많고 오픈소스 커뮤니티를 소외시키는 방향으로 나아가고 있는 것 같습니다.

물론, 조심스럽지만 긍정적인 반응도 나오고 있습니다.

Llama를 사용해 볼 수 있는 허깅페이스 같은 곳의 사용자들로부터, 그리고 ‘당연히’ 메타의 유저들로부터는 좋은 반응도 나오고 있어요:

돌이켜 보면, 이전에 있었던 Llama 모델 출시는 거의 매번 성공적(?)이었던 것 같은데요. 이번 Llama 4 출시 - 물론 아직 초기의 반응이기는 합니다만 - 에 대한 복잡한 반응, 조금 충격이라고 하겠습니다. ‘오픈소스 AI’ 영역에서의 경쟁은, 비교할 수 없을 만큼 치열해졌습니다 - DeepSeek, Gemma, Mistral, QwQ, 모두들 이번에 발표한 Llama 4보다 훨씬 작은 모델로 더 우수한 성능과 성과를 보여주고 있거든요.

메타의 전략, 상당히 복잡해진 상황이 된 느낌입니다. 최근에 보여주고 있는, 마크 주커버그의 태도와 에너지 변화 (^.^;)와 어떤 관계가 있는 걸까요? 지금으로서는, 메타는 ‘Llama가 처음에 각광받았던 이유를 모두 잊고, 벤치마크에 집중’하는 길로 가고 있는 것 같아 안타깝습니다.

토픽 #2: 끊이지 않는 AGI 이야기를 보다가 든 생각 - ‘KAGI’

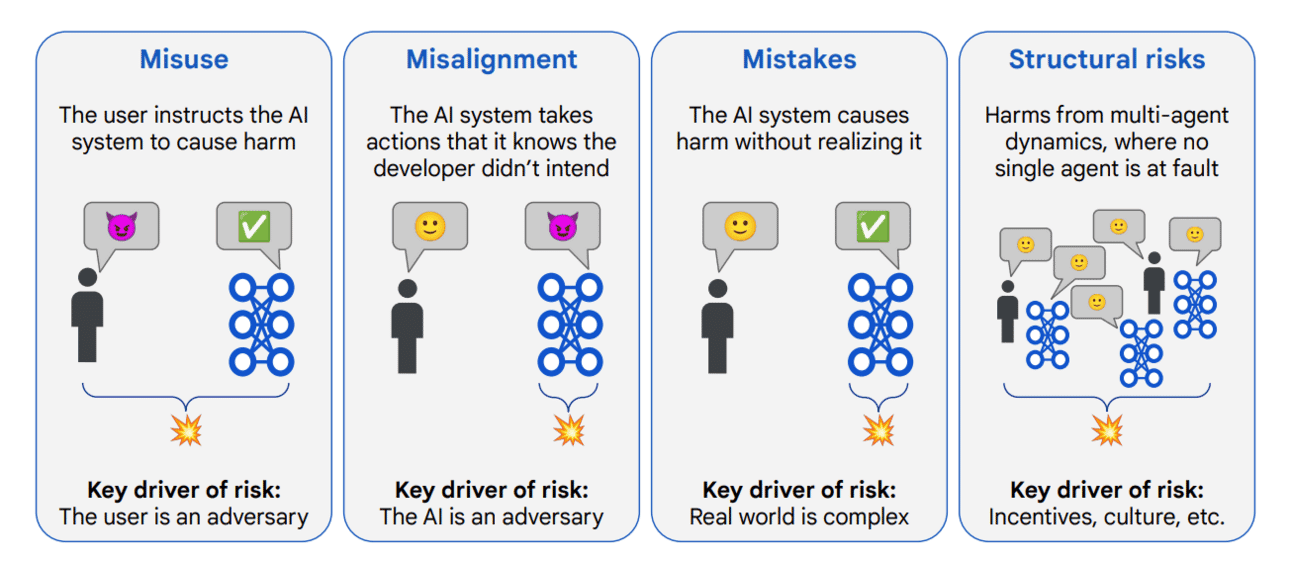

지난 주, 구글 딥마인드가 ‘An Approach to Technical AGI Safety and Security’라는 이름으로 흥미로운 논문을 발표했습니다. 이 논문에서는 아래와 같은 내용을 논의하는데요:

논문에서 이야기한 ‘리스크 (위험)’ 영역. 리스크를 ‘회피’하는 접근 방식의 차이에 따라 나누었다고 하네요.

Image Credit: 오리지널 논문

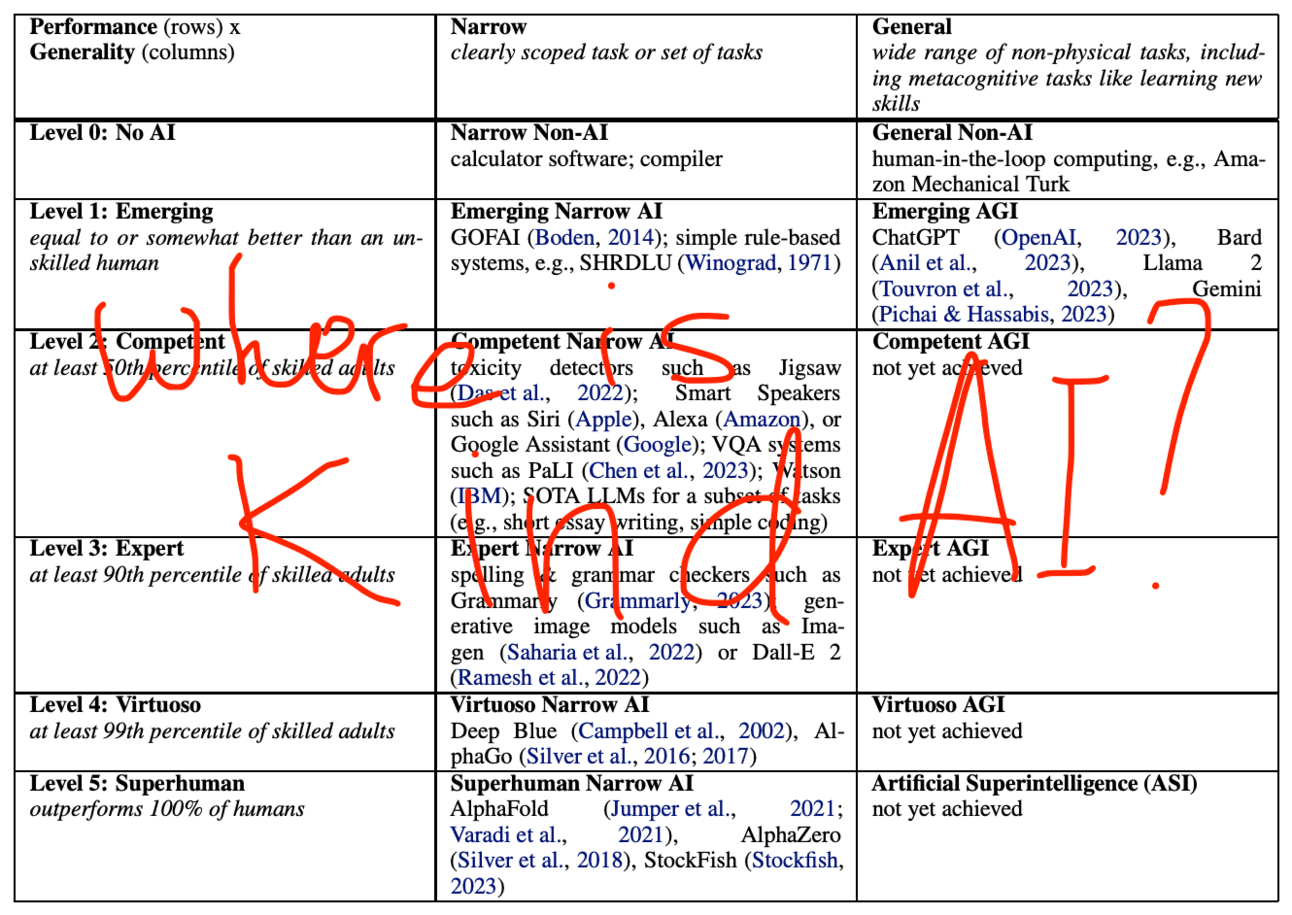

논문에서, “강력한 AI 시스템이 언제 개발될지 시점은 아주 불확실하지만, 2030년까지는 이런 시스템이 개발될 가능성이 있다고 생각합니다”라고 이야기하고 있구요. 그리고 ‘Position: Levels of AGI for Operationalizing Progress on the Path to AGI’같은 논문을 통해서, AGI가 어떤 단계로 달성될 것인지에 대해서도 많은 의견을 내고 있습니다.

구글 딥마인드 뿐 아니라, 많은 연구 기관에서 나름대로 AGI가 어떤 색깔과 특징을 가지게 될지, 어떤 과정을 거쳐서 달성될지에 대해서는 수많은 의견들이 나오고 있는데요.

그런데 여러분, 어떠세요? AI라는 기술이 소위 ‘자율주행차’ 같이 ‘가치 중립적’인 기술은 아니잖아요? 이렇게 무미건조하게, 특색없이 AGI가 어떻게 전개될 것이다 라는 식의 ‘3단계’, ‘5단계’ 식의 이야기를 하는 것이, 재미있으세요?

튜링 포스트의 Ksenia와 저는 이런 생각을 해 봤어요: ‘친절한 AI (Kind AGI; KAGI)’라는 컨셉으로 AI의 현재와 미래 방향을 생각해 보면 어떨까?

무미건조한 AI의 진화 방향

기존의 AGI에 대한 내러티브를 살짝 틀어서, 예를 들어서 ‘KAGI (Kind AI; 친절한 일반 일공지능)’에 대한 논의를 시작한다면 얼마나 재미있고 이야기할 거리들이 다양해질까요?

챗GPT, Claude, Gemini 등은 아주 무미건조하게 ‘유해한 지시를 거부’하고 ‘예의있고 배려있는’ 응답을 하도록 훈련되어 있지만, 더 적극적으로, ‘친절한’ AI라는게 어떤 건지 고민을 해 본다면 훨씬 더 성장의 잠재력이 큰 Co-pilot, Co-worker, 에이전트 등을 생각해 볼 수 있지 않을까요?

궁금해서 찾아보니, ‘KAGI’라는 단어가 일본어에서는 鍵(Kagi), 즉 "열쇠" 또는 "자물쇠"를 의미한다고 합니다. 열쇠는 보안, 비밀, 또는 숨겨진 잠재력을 열어서 발휘하는 걸 의미하죠. 때로는 영적인 관문을 열거나, 숨겨진, 신비로운 지식에 대한 접근을 의미한다고 해요 - 바로 Ksenia와 제가 AI, 나아가서 AGI에 기대하는 역할입니다. 한 번 여러분과 같이 이런 방향에 대해서 생각해 보고 싶습니다. 어떠세요?

토픽 #3: ‘파운데이션 에이전트’, 그 현황과 과제

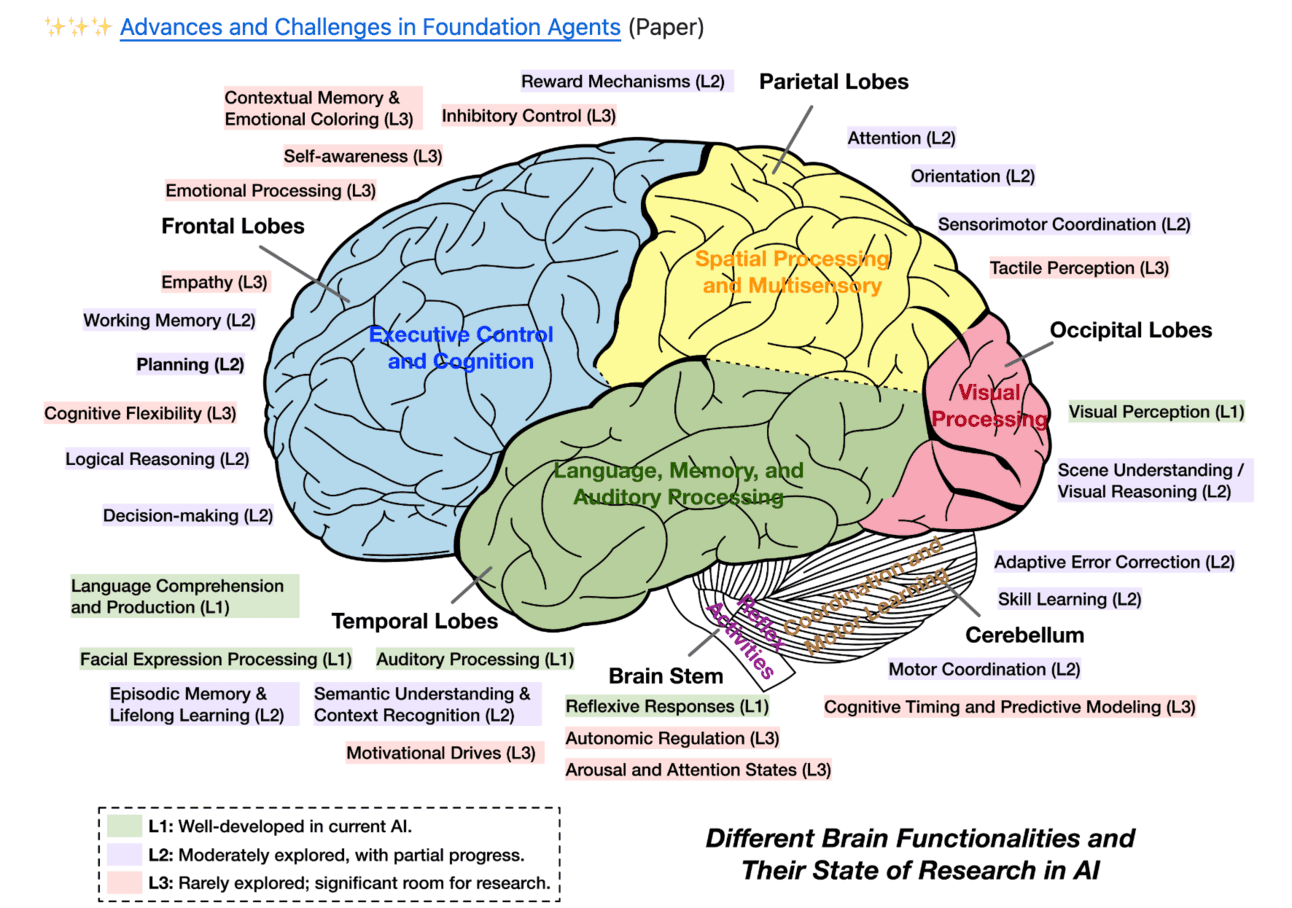

20개가 넘는 저명한 AI 연구소들이 합심해서, ‘ADVANCES AND CHALLENGES IN FOUNDATION AGENTS’라는 이름의 260여 페이지 분량의 조사 보고서를 발표했습니다.

기본적으로 이 보고서는, 현 시점 우리가 어떻게 ‘초지능적인 AI 에이전트를 구축하고 있는가’에 대해 깊이있게 탐구한 보고서예요. ‘얼마나 실제 사람처럼 생각하거나 행동하는 거에 가까워져 있나?’, ‘지금 뭘 할 수 있고, 아직 어려워하는 것들은 무엇이고, 어떻게 이 에이전트들이 통제를 벗어나지 않게 보장할 수 있나?’ 같은 큰, 그리고 중요한 질문들에 답을 해 보려는 연구자들의 시도라고 하겠습니다.

우리 주변에 이미 재미도 있고 의미도 있는 AI 어플리케이션, 제품, 서비스들이 엄청나게 많기는 하지만, 혹시 여러분이 그런 것들 다음에 AI가 어디로 향하고 있는지 - 계획을 세우고, 뭔가를 오래 기억하고, 도구를 능숙하게 사용하고, 스스로 학습하고, 팀으로 함께 일할 수 있는 AI 같은 것들이겠죠 - 관심이 있으시다면, 이 보고서를, 길지만 한 번 시간을 두고 보시면 좋을 것 같습니다.

기본적으로 이 보고서는 AI 기술을 우리의 뇌가 작동하는 방식과 매핑하고 연결해서 이해하도록 해 주고, 이 기술들이 안전하고 윤리적으로 만들어질 수 있어야 한다는 관점에서 아주 중요한 측면을 다루고 있어요.

위에서 이야기한 ‘친절한’ AI 같은 걸 이야기하지는 않지만 ^.^;, 그래도 한 번 관심을 함께 가져보시죠.

트위터 라이브러리 (Twitter Library) 🐦

AI 추론 (AI Inference)은, AI 모델이 입력 데이터와 사전 훈련된 모델을 활용해서 예측, 분류 또는 결정 내용을 생성하는 과정을 말합니다. 이 ‘추론’도 자세히 들여다보면 다양한 계산 방법, 배포 방식을 포함하는, 광범위한 내용인데요.

모델이 ‘추론하는 방식’으로 구분했을 때의 5가지 유형, 그리고 ‘추론이 실행되는 맥락’에 따라서 구분한 4가지 유형, 총 9가지 유형의 AI 추론 (Inference) 기법을 알아봤습니다:

*아직 튜링 포스트 코리아 구독 안 하셨나요? 구독해 주시면 매주 중요한 AI 뉴스를 정리한 다이제스트를 받으실 수 있습니다!

금주의 주목할 만한 업계 동향 📰

가와사키 (Kawasaki)의 사족보행 늑대(?), Corleo

우선, 동영상 하나 보고 가시죠. 가와사키 중공업이 개발한 로봇 말이라고 해야 할지 로봇 늑대라고 해야 할지…Corleo라는 이름으로 발표되었는데요. 실제 운용하는 모습은 2025년 올해 오사카•간사이 만국박람회에서 공개된다고 하네요. 수소에너지를 활용하는 사족보행 로봇, 어때요?

데미스 하사비스의 Isomorphic Labs, 6억달러 펀드레이징

구글 딥마인드의 CEO인 데미스 하사비스가 마찬가지로 CEO를 맡고 있는 AI 기반 신약 개발사 Isomorphic Labs가 Thrive Capital이 주도하고 GV, Alphabet이 참여한 첫 번째 외부자금 조달 라운드에서 6억 달러를 모았습니다. 딥마인드에서 탄생했다고 볼 수 있는 이 바이오테크 회사는, 여러 개의 치료 영역에 걸친 프로그램으로 AI 신약을 발견하는 엔진을 임상단계까지 강력하게 밀어붙이고 있습니다.

Genspark, 자율형 AI 에이전트, ‘Super Agent’ 출시

팔로알토에 위치한 스타트업 Genspark가 점점 경쟁이 치열해지고 있는 자율형 AI 에이전트 영역에 새로운 플레이어, Super Agent를 출시했습니다. 9개에 달하는 LLM, 80개에 이르는 도구를 구비하고, 10개 이상의 독점적 데이터셋을 연결해서, 여행 계획에서부터 합성 음성으로 하는 통화까지, 실제 의미가 있는 작업을 수행합니다. GAIA 벤치마크에서 경쟁자들과 비슷하지만 약간 앞서는 모습을 보여주고 있어요.

오픈AI, 연구 논문 평가도구 PaperBench 공개

오픈AI에서, ‘AI가 논문을 읽고 논문 저자가 실행한 연구 과정을 처음부터 직접 실행해서 재현할 수 있는지 평가하는 벤치마크, PaperBench를 공개했습니다.

20개의 최신 논문에 대해서 총 8,316개의 태스크로 분해되어 있는데, ‘코드 개발’, ‘실행’, ‘결과 합치’의 3가지 종류로 구분되구요.

Claude 3.5 Sonnet이 평균 재현율 21%로 가장 높은 점수니까, 최고 수준의 모델도 장기적인 추론, 실행 관점에서는 아직 갈 길이 먼 것 같네요. (처음 1시간 동안은 AI가 사람보다 우수한 성능인데, 24시간 이상의 장시간에 걸쳐서는 사람이 더 우수합니다) 오픈AI의 o1은 13.2%, 그 외의 테스트된 모델들은 10%도 채 되지 않습니다. 결국, 아직은 ‘많은 코드를 빠르게 작성하는 건 AI가 사람보다 뛰어나고, 이를 통합하고 실행하고 결과를 검증하는 등의 작업은 사람이 더 뛰어난’ 것 같네요.

딥마인드의 Dreamer, 마인크래프트에서 다이아몬드 성공적으로 수집

딥마인드의 최신 강화학습 에이전트 Dreamer가 사람의 시연이 없이 마인크래프트 게임에서 다이아몬드를 성공적으로 수집했습니다. 학습한 월드 모델을 기본으로 해서, 미래의 행동과 그 결과를 ‘상상’해야 이런 일을 할 수 있는데요 - 그 작업의 단위는 작지만, 의미만은 큽니다. 바로 ‘새로운 환경에서의 일반화, 그리고 계획’ 능력을 향한 한 걸음이니까요.

새로 나온, 주목할 만한 연구 논문

‘주목할 만한 최신의 AI 모델’을 먼저 소개하고, 각 영역별로 ‘Top Pick’은 해당 논문 앞에 별표(🌟)로 표시했습니다!

주목할 만한 최신 AI 모델

HallOumi (Oumi AI) – 주장 (Claim)의 검증, 환각 감지를 위한 오픈소스 8B 모델입니다. 문장 수준에서 인용을 하고, 주장에 점수를 매기고, 설명을 붙이는 것 등에서 최고 수준의 모델들보다 더 나은 성능을 보여줍니다.

🌟Command A (Cohere) – RAG(검색 증강 생성), 도구 사용 및 다국어 기능(23개 언어)을 갖추도록 훈련한, 기업을 위한 유즈케이스 개발에 최적화된 LLM입니다. 분산 트레이닝, 에이전트 최적화 기술, 그리고 새로운 모델 병합 기술을 사용합니다.

OThink-MR1 – GRPO-D로 강화한 멀티모달 LLM으로, 다양한 작업들에 대해서 일반화된 (Generalized) 추론 능력을 갖추고 있습니다. SFT(지도학습 파인튜닝) 기법으로 만들어진 모델에 비해서, 서로 다른 작업 간의 일반화 성능이 좋습니다.

🌟TransMamba – 공유 파라미터 행렬로 Transformer와 Mamba를 통합한 하이브리드 시퀀스 모델입니다. 시퀀스의 길이에 따라서 메커니즘을 다이나믹하게 전환합니다.

Reasoning 및 Inference

Thinking Intervention - 내부의 사고 토큰 (Thinking Tokens)을 수정하는 방식으로 LLM 추론 과정을 세밀하게 제어할 수 있게 해 줍니다. 이렇게 해서, 지시 계층 추론 (Instruction Hierarchy Reasoning)이라든가, 안전하지 않은 프롬프트를 처리하는 작업 등에서 향상된 성능을 보여줍니다.

🌟Open-Reasoner-Zero – LLM을 위한 미니멀리스트 강화학습 훈련 기법을 오픈소스로 구현한 것으로, 더 적은 단계로도 DeepSeek-R1-Zero 수준의 효과를 거둘 수 있습니다.

멀티모달 및 에이전트

🌟SynWorld - LLM 기반 에이전트가 시나리오 시뮬레이션 기능, 그리고 MCTS(Monte Carlo Tree Search)를 기반으로 ‘행동 지식 (Action Knowledge)’ 개선을 하는 기능을 갖추도록 해 줍니다.

🌟KnowSelf - ‘Agentic Knowledgeable Self-Awareness’라는 개념을 제안하는데, 계획이라든가 의사결정을 하는 과정 중에 지식을 사용할 때 스스로 다이나믹하게 제어를 하도록 해 줍니다.

VerifiAgent – 메타 검증과 도구 기반 기법을 통합한 통합된 검증 에이전트로, 다양한 추론 유형에 대해서 모델의 추론 능력을 검증합니다.

트레이닝 및 스케일링

🌟ZClip – z-스코어를 기반으로 한 다이나믹 그래디언스 클리핑 방법으로, 전통적인 방법보다 LLM 사전 훈련 중의 손실 스파이크를 더 효과적으로 줄여줍니다.

🌟Scaling Laws in Scientific Discovery - AGS (Autonomous Generalist Scientist)를 소개하고, 새로운 스케일링 법칙의 가능성을 제안합니다.

읽어주셔서 감사합니다. 프리미엄 구독자가 되어주시면 튜링 포스트 코리아의 제작에 큰 도움이 됩니다!