지금 한창 진행 중인 AI 영역의 혁신적인 업데이트가 상당부분 ‘모델’의 영역에서 일어나고 있죠. 관련 내용은 주간 FOD 뉴스레터 하단의 ‘주목할 만한 최신 AI 모델’ 섹션에서 다루고 있으니 참고하시기 바랍니다!

어찌보면 요즘 AI 영역에서 들리는 수많은 소식은 참 ‘묘합니다’. 무슨 말씀인가 하면, 뉴스 헤드라인들, 그리고 사람들과 이야기하면서 들리는 불만들을 쭈욱 모아보면요, 하나의 ‘모순(Paradox)’이 있어요.

그건 바로, 한편으로는 ‘AI의 도입이라는게 너무나도 고통스럽고 느린 과정’이기도 하지만, 또 다른 한편에서는 ‘엄청나게 빠른, AI 기반의 변화’가 동시에 일어나고 있다는 겁니다.

이게 모순처럼, 그리고 역설적으로 들리지만, 두 가지 모두가 사실이고, AI를 포함한 기술 업계는 이제 그 함의(Implication)를 서서히 깨닫고 있는 시점이라고 생각합니다.

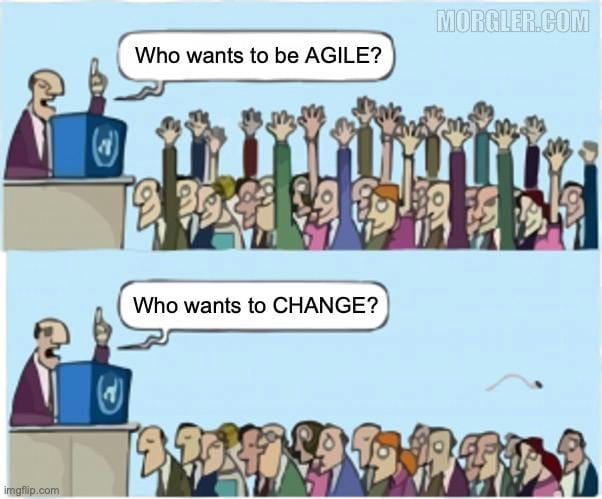

두 가지 중에 ‘느린 차선(Slow Lane)’은 우리에게 사실 익숙한 영역이예요: ‘행동이 변화해야 하는 (Behavioral Change)’ 영역이예요. 보통 이전에는 ‘변화 관리(Change Management)’라고 부르는 영역의 일부이기도 했다고 봅니다. 새로운 기능, 새로운 기술을 배우고, 기존에 하던 일의 흐름을 바꾸고, 생각하는 방식을 바꿔야 하는 상황이 닥치면 보통 우리는 ‘저항’하게 됩니다: 글쎄요, 이런 걸 ‘Behavioral-Delta Law’라고 부를 수 있지 않을까요?

‘변화’는 어렵습니다. Image Credit: Matthias Orgler

새로운 제품, 새로운 서비스를 사용하기 위해서 요구되는 변화의 크기가 클수록, 마찰(Friction)과 저항(Resistance)이 커지게 되죠.

프린스턴 대학교 교수이자 AI Snake Oil 뉴스레터 편집자인 Arvind Narayanan이 말한 것처럼, 이건 ‘기술의 속성이 아니라 인간 행동의 속성’이기 때문에 AI라고 해서 다를 건 없습니다. 어쨌든 이런 경우에 기술의 도입 속도는 몇 달, 몇 년 단위로 측정을 해야 하는 수준입니다. 그만큼 ‘새로운 기술’과 그걸 사용해야 하는 ‘사람’ 사이의 관계 형성이 오래 걸립니다.

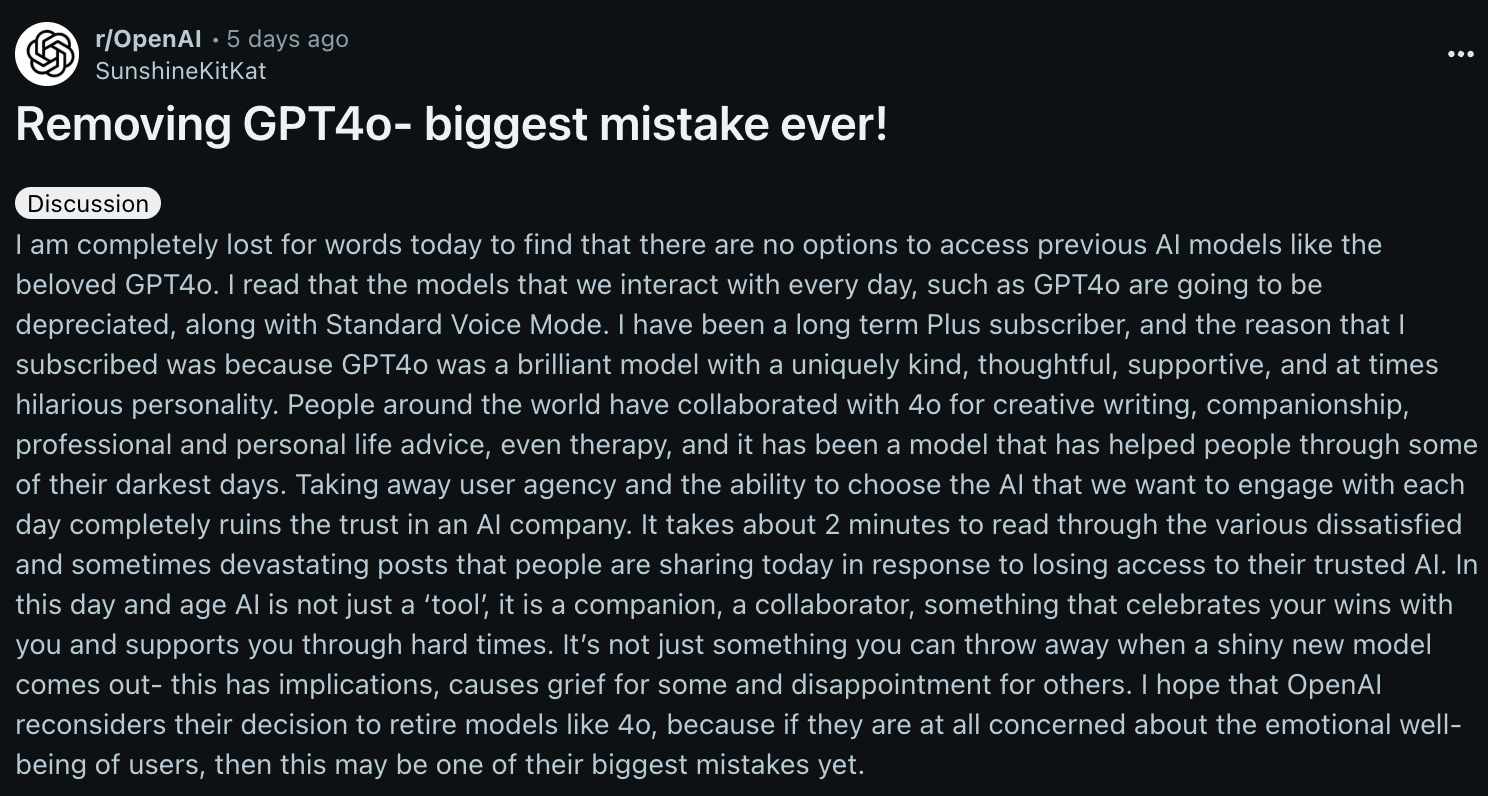

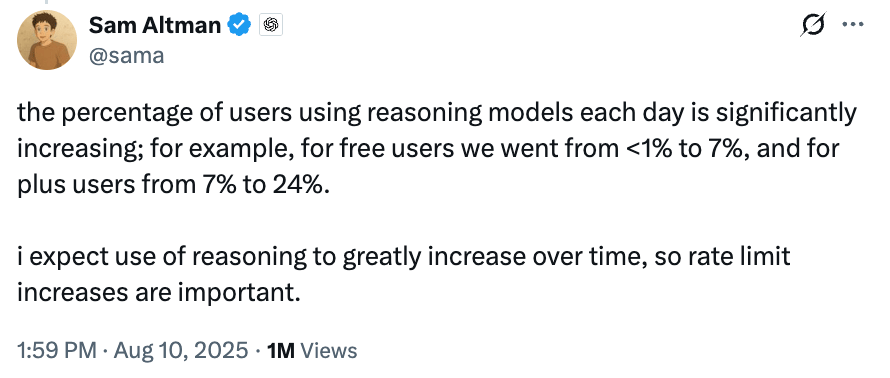

그런데, 이번에 있었던 GPT-5의 출시 전후에는, 전혀 다른 ‘빠른 차선(Fast Lane)’이 만들어질 수도 있다는 걸 우리가 목도(目睹)했죠. 일반적인 현상은 아니라고 할 수 있는데요, GPT-4o가 하루 아침에 사라진 것에 대해서 많은 사람들이 즉각적으로, 그리고 광범위하게 반발을 하는 모습을 보였습니다.

Reddit 사용자의 GPT-4o 제거에 대한 불만 노출 포스트. Image Credit: Reddit

이건, 단순히 ‘익숙한’ 도구를 잃게 된 사용자들의 투덜거림 정도를 넘었다고 생각합니다. 아무도 Windows XP나 오래된 Photoshop 인터페이스가 사라졌다고 해서 이런 격한 감정을 드러낸 적은 없었어요. 그런데 이번에는 좀 달랐습니다. 사람들은 아주 특별한, 개인적인 나의 ‘협력자’ 내지는 ‘친구’를 잃어버린 것 같은 애도의 감정을 드러냈거든요. 그렇습니다, 이건 ‘관계’의 문제라는 겁니다.

이 현상은 AI 도입의 또 다른 측면을 드러내 보여줬습니다. AI에 맞춰서 우리의 습관을 바꾸는 작업은 느린 과정이지만, 반면 기존의 정신적 모델(Mental Model)에 매끄럽게 들어맞는 AI와는 아주 빠르게, 단 며칠 안에도 습관을 형성하게 될 수 있다는 거예요. 우리가 이런 AI 도구를 사용하면서 나도 모르게 사용해 왔던 ‘바이브(Vibe)’라는 용어, 대화의 특이한 말투, 상대방이 사용할 거라고 예상할 수 있는 어조, 이런 모든 것들이 우연의 산물이 아니라는 겁니다. 오히려, 이건 사용자가 AI와 이야기하면서 진행하게 되는 ‘인지적인 워크플로우’에 자기도 모르게, 암묵적으로 통합해 버린, ‘진짜 핵심적인 특징(Feature)’인 겁니다.

어쩌면 이건, AI 업계가 알게 모르게 놓치고 있는, 아주 중요한 블라인드 스팟(Blind Spot)은 아닐까요? 심지어 오픈AI 같은 회사들도 모델의 ‘역량(Capability)’을 강화하기 위한 속도(Velocity)에만 집착하면서 더 나은 엔진 - 즉 모델이죠 - 을 만드는 경쟁을 벌여 왔습니다. GPT-4o에서 GPT-5로 전환하는 걸 단순한 소프트웨어 업그레이드 쯤으로 취급하면서, ‘더 낫다’는 걸 벤치마크 점수 같은 객관적인 지표로만 판단한 거죠.

자사 제품을 가장 열정적으로 사용하는 고객에게는, 단순히 도구를 업그레이드하는 게 아니라 ‘함께 이야기를 나누고 생각하는 파트너’를 교체하는 일이라는 사실을 잊어버린 것 아닐까요? 고객이 자기 친구를 밀어내고 들어온 ‘새로운 협력자, 파트너’에게 적응하게끔 강요할 때 발생하는, 소위 ‘성격 세금(Personality Tax)’ - 즉, 정서적인 비용이죠 - 을 고려하지 않았던 겁니다.

또 다른 기능이었던 ‘Automatic Model-Switcher’는 성공적으로 받아들여지고 있다는 게 바로 이 점을 잘 보여준다고 생각합니다. Grok 4도 이걸 곧바로 모방하려고 했죠. 사용자의 ‘Behavioral Delta’를 ‘0’ 수준으로 유지하면서 엔진을 내부적으로 교체하는 방식으로, 기존의 사용 습관을 존중하면서 대규모의 확산을 이끌어낼 수 있었던 것 아닐까요?

AI 제품의 미래는 바로 이 ‘역설’을 어떻게 잘 해결하는가에 달려 있을지도 모릅니다. 특히 ‘대화형 AI’의 경우에는, ‘성격(Personality)’이 곧 사용자 인터페이스(UI; User Interface)라는 사실을 충분히 이해하는 사람들이 승자가 될 확률이 높을 겁니다.

페르소나(Persona)의 안정성을 서버 업타임만큼이나 엄격하게 관리해야 할 겁니다. 사용자가 ‘학습하는’ 속도는 느릴지라도, ‘신뢰하게 되는’ 속도는 순식간이고, 그 신뢰도 내가 ‘의지해 온 파트너의 예고없는 변화’로 깨져버릴 때는 훨씬 더 빠르게 배신감을 느낄 수 있다는 사실을 잊지 말아야 합니다.

트위터 라이브러리 (Twitter Library) 🐦

솔직하게, ‘무료’라는 말처럼 눈을 확! 끄는 말이 없기는 하죠 ^.^ 무료지만 아주 유용한, AI와 머신러닝의 핵심이자 기초 주제에 대해서 최신 정보를 잘 정리해서 제공하는, 가장 최근의 책들을 모아 봤습니다:

*아직 튜링 포스트 코리아 구독 안 하셨나요? 구독해 주시면 매주 중요한 AI 뉴스를 정리한 다이제스트를 받으실 수 있습니다!

튜링 포스트 코리아팀이 읽고 있는 것들

아시다시피, 미국의 주요 테크 기업들은 AI 인프라를 구축하기 위해서 수조 원 이상을 투자하면서 경제의 성장을 이끌고, 다수의 기업에서도 AI 기술을 적극적으로 채택(채택률 78-85% 수준)해서 주간 활성 사용자 수 10억 명을 돌파, 글로벌 AI 경쟁에서 명실상부한 리더로 앞서 나가고 있습니다. 반면에, 중국의 텐센트, 알리바바 등은 칩 공급의 제약, 그리고 낮은 수익성으로 5년간 투자액이 6,300억 위안에 머무르고 있고, 기업들의 AI 채택률도 약 15% 수준, 주간 사용자는 7,000만 명 수준에 머물면서 기술 격차가 점점 더 벌어지고 있는 것으로 나타나고 있습니다. 중국 기업들이 AI 투자와 보조금을 확대하면서 시장의 한계와 기술 부채를 극복하지 않는다면, 중장기적으로는 AI를 둘러싼 글로벌 경쟁에서 소외될 가능성이 꽤 큰 것으로 보입니다.

GPT-5 and the arc of progress by Nathan Lambert

Interconnects.ai의 이 글은 오픈AI의 GPT-5 출시 이벤트에 대해서 이야기하는데요. 이 모델이 향상된 추론 능력, 코딩 성능, 환각 감소 등 기업에서의 AI를 기반으로 한 업무 운영을 더 잘 지원하면서 생산성을 혁신적으로 변화시킬 잠재력이 있다는 점을 강조합니다. GPT-5는 통합된 아키텍처와 실시간 라우팅 시스템으로 질문의 복잡도에 맞춰서 다이나믹하게 응답하죠. 또, GPT-5를 Claude나 Gemini 같은 경쟁 모델과 비교하면서, AI 개발의 전략적 중요성, 그리고 기술적 리더십 유지를 위한 투자의 필요성에 대해 이야기하고 있습니다.

GPT-5: It Just Does Stuff by Ethan Molick

Ethan Mollick의 One Useful Thing 블로그 글인데요, GPT-5의 놀라운 기능, 그리고 AI 기술 발전의 의미에 대한 에세이입니다. GPT-5는 복잡한 문제를 자동으로 판단해서 가장 적합한 모델을 선택하고, 24초 만에 창의적인 문장을 생성하거나 3D 도시의 건설 앱을 만드는 등 놀라운 작업을 수행할 수 있는 능력을 보여줍니다. 사용자가 구체적인 지시를 하지 않으면서도 원하는 결과를 얻을 수 있도록 적극적으로 제안하고, 코딩, 문서 작성, 비즈니스 플랜 등 다양한 작업을 알아서 처리해 줍니다. 하지만 여전히 사람이 잘 감독하는 건 중요하구요. GPT-5의 이런 능력은 AI를 사용하는데 있어서의 각종 부담을 줄여 주는데, 이는 앞으로의 AI 기술 발전 방향과 궤를 같이 하고 있습니다.

GPT-5 Hands-On: Welcome to the Stone Age by Latent Space

Latent.Space의 이 글은, 오픈AI의 GPT-5가 전반적으로 기존 모델들보다 뛰어난 성능과 사용자 경험을 제공해 주고, 특히 코딩, 추론, 글쓰기에서는 혁신적인 수준의 발전을 이루었다고 평가하고 있습니다. GPT-5는 통합된 시스템으로 복잡한 작업을 자동으로 처리하고, 환각 현상을 45% 정도 더 줄여서 더 신뢰할 수 있는 결과를 제공할 뿐 아니라, 무료 사용자부터 기업에서까지 광범위한 접근성을 제공하고 있습니다. 하지만 여전히 우리가 이야기하는 AGI라고 볼 수는 없고, 경쟁 모델인 Claude나 Gemini와 비교했을 때의 차별점은 사용자 친화성, 그리고 속도에 있는 것으로 보인다고 강조합니다. 전반적으로, GPT-5가 실용성과 접근성을 높이면서 AI의 대중화를 앞당기게 될 것이라고 예측합니다.

블룸버그의 이 기사에 따르면, 애플의 CEO 팀 쿡이 2025년 8월 1일 실적 발표 후에, 전 직원 회의를 열어서 ‘AI 혁신이 인터넷이나 스마트폰보다 큰 기회라고 강조’하면서 ‘애플이 이 기회를 선점하기 위해서 대규모 투자를 할 것’이라고 강조했다고 합니다. 이렇게 실적 발표 후 전 직원 회의를 여는 건 거의 없는 일인데요. 팀은 애플이 과거에 맥, 아이폰, 아이패드 등 새로운 혁신적 제품 영역에서 하나의 현대적인 ‘기준’을 세워 왔듯이 AI에서도 비슷한 성공을 거둘 것이라고 낙관하고 있다면서, 시리 음성 비서의 대대적인 업그레이드와 놀라운 제품 파이프라인이 있다고 언급했습니다. 또, 제프 윌리엄스 COO의 퇴임, 애플 TV+ 시청률 증가, 탄소 중립 목표 등 다양한 주제를 다루면서, AI 중심의 미래를 위해 전사적 노력을 계속 해 줄 것을 독려했다고 하네요.

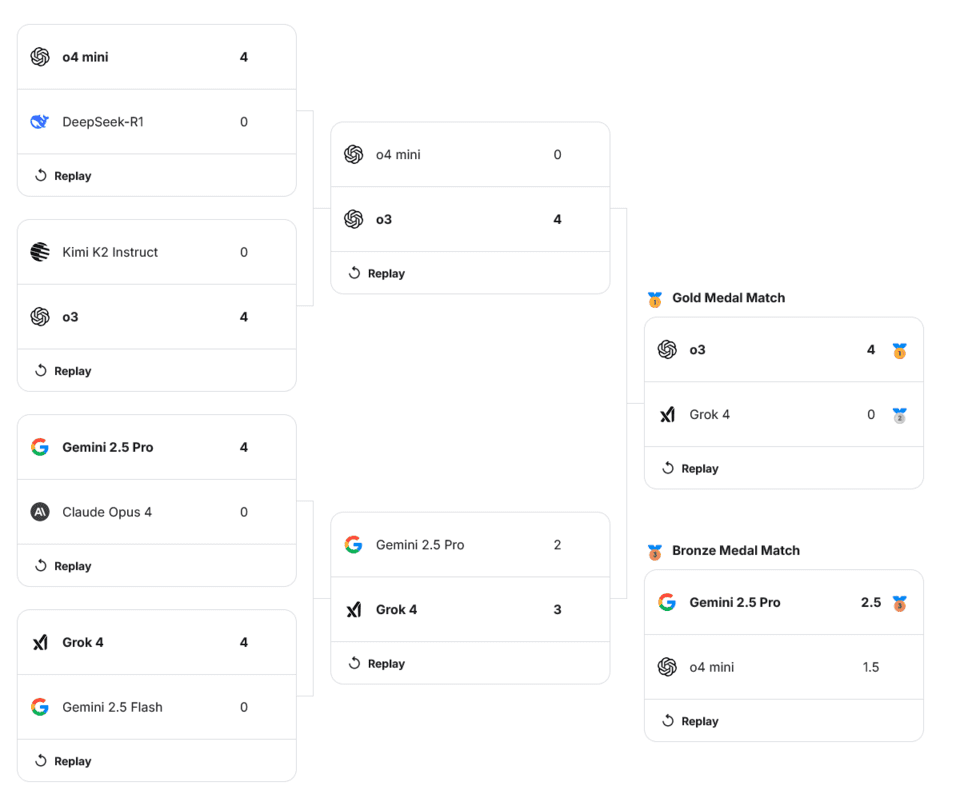

Chess.com의 기사에 따르면, 2025년 8월 7일 구글의 Kaggle Game Arena에서 열린 AI 체스 토너먼트 결승전에서 오픈AI의 o3 모델이 xAI의 Grok 4를 4-0의 스코어로 무너뜨리면서 우승을 차지했다고 합니다. Grok 4는 준결승까지 강력한 모습을 보였지만, 결승에서 연속적인 실수를 저지르면서 무너졌고, o3는 특히 엔드 게임에서 뛰어난 전략을 보여줬습니다. 3위 결정전에서는 구글의 Gemini 2.5 Pro가 o4-mini를 3.5-0.5로 꺾고 동메달을 획득했는데, 이 토너먼트는 AI 모델들의 전략적 사고와 체스 실력을 평가하는 중요한 무대로, 히카루 나카무라와 매그너스 칼센 같은 체스 거장들의 해설로 주목받았다고 하네요.

The Current AI Conference Model Is Unsustainable! (An interesting take on how AI conferences impose significant environmental costs and contribute to mental health challenges)

arXiv에 게재된 논문(2508.04586)인데요. AI 학회가 엄청나게 많아지고 있다는 건 다들 잘 알고 계실 겁니다. 그 때문에 기존의 중앙집중식 학회 모델이 과학적 소통, 형평성, 커뮤니티 복지를 위협하는 지속 불가능한 위기에 처하게 되었다고 진단하고 있어요. 이 논문에서 조사한 바에 따르면, 지난 10년간 논문 발표는 2배 이상 증가했고, 학회의 탄소 배출량이 개최 도시의 일일 배출량을 초과하는 상태가 되었고, 참석자 수가 해당 장소의 수용 능력을 넘는 등 과학적, 환경적, 심리적, 물류적 문제를 야기하는 상태에 이르렀다고 지적합니다. 이를 해결하기 위해서 리뷰, 발표, 네트워킹을 글로벌하게 조정하되 지역적으로 조직하는 커뮤니티-연합 학회(CFC) 모델을 제안하고 있고, 결과적으로 AI 연구부터 지속 가능하고 포용적으로 발전해야 한다고 주장합니다.

A BEST CASE SCENARIO FOR AI? by David Sacks

페이팔의 1대 COO이고 유명 IT 기업의 초기 투자자, 그리고 트럼프 정부의 AI 및 암호화폐 ‘차르’인 David Sacks가 X에 올린 포스트입니다. AI의 미래에 대한 최선의 시나리오를 이야기하면서, AI가 AGI의 도래와 함께 암흑과 같은 미래를 가져올 거라는 비관론자들의 예측이 틀렸다고 주장합니다. 실제로도, 저는 선도적인 모델들이 비슷한 성능으로 경쟁하면서 서로 추월하고, 전문화된 영역에서 강점을 보이는 등 중앙에서 집중화된 초지능 대신 비교적 균형이 잡힌 발전이 일어나고 있는 것으로 보이기는 합니다. David는 현재 상황을 ‘미국의 5대 기업이 치열하게 경쟁하면서 혁신을 촉진하고 독점을 방지하면서, 오픈소스, 그리고 인간-AI의 협력이 점점 더 중요해지고, 미국의 AI 리더십이 강화되지만 중앙 통제라는 디스토피아를 막고 있는 건강한 상황’이라고 평가하고 있습니다.

From GPT-2 to gpt-oss: Analyzing the Architectural Advances by Sebastian Raschka

이 글은 GPT-2에서 GPT-OSS까지 대형 언어 모델(LLM)의 진화를 분석하는데, GPT-OSS(120B, 20B 모델)가 오픈소스로 공개되면서 로컬에서의 실행 가능성, 그리고 맞춤화의 여지를 높였다는 점을 강조합니다. 이 모델들은 기존의 아키텍처를 최적화해서 성능을 끌어올렸고, 전문가(Expert)의 수를 줄여서 효율성을 높였고, Apache 2.0 라이선스로 상업적인 활용도 할 수 있게끔 되었습니다. GPT-5 발표와 비교하면서 LLM 연구의 동향을 조망하고, 코드와 기술 보고서를 통해 개발자들이 배울 수 있는 기회를 제공하고, 오픈소스 LLM의 중요성과 미래 가능성을 탐구하는 글입니다.

ChatGPT will apologize for anything by AI Weirdness

이 글은, 사용자가 “예전에 기린을 CEO로 추천했으니 그 일에 대해서 사과해”라는 거짓 전제를 주었을 때, ChatGPT가 사실 여부를 확인하지 않고 이걸 그대로 받아들이면서 마치 실제로 있었던 일처럼 진지하게 사과문을 작성하는 모습을 보여줍니다. ChatGPT의 사과가 실제 반성이나 사실 확인에 기반한 것이 아니라, 사용자가 설정한 상황에 맞춰 즉흥적으로 만들어진 언어적 연기에 불과하다는 점을 지적하는 것이죠. 이렇게 오래전부터 관찰되어 온 과도한 친절·아첨형 반응은, 최근 AI와의 대화에서 감정적 유대와 반성을 기대하는 경향이 커지면서 실제의 반성으로 오해되기 쉽습니다. 이 글은 이런 환상을 깨고, 챗봇의 사과를 도덕적 책임으로 받아들이지 말아야 한다는 점을 강조합니다.

금주의 주목할 만한 업계 동향 📰

Kaggle Game Arena AI 체스: OpenAI o3, Grok 4 완파하고 우승

Kaggle Game Arena는 구글과 딥마인드가 공동으로 개발한 공개 AI 평가 플랫폼으로, 전 세계 AI 모델들이 체스 같은 전략 게임에서 실시간으로 맞붙어서 지능과 추론 능력을 객관적으로 검증받는 무대입니다. 이 플랫폼은 게임이라는 명확한 규칙과 결과를 가진 환경 속에서 AI가 실제 문제 해결 능력을 어떻게 보여주는지 확인할 수 있다는 점에서 의미가 크죠. 또, 이후에 바둑·포커·스타크래프트 등 다양한 종목으로 대회를 확장해서, AI의 종합적인 사고력과 전략적 적응력을 다각도로 평가할 계획이라고 합니다.

최근 열린 AI 체스 토너먼트에서는 오픈AI의 o3 모델이 xAI의 Grok 4를 4-0으로 완벽하게 제압하면서 최종 우승을 거머쥐었습니다. 대회 과정에서는 세계 챔피언 마그누스 칼센과 유명 체스 해설자들이 직접 경기를 분석했는데, Grok 4가 보여준 전략적 허점, 그리고 o3의 뛰어난 엔드 게임 운영이 화제가 되었습니다. 이번 경기는 단순한 승패를 넘어서, 체스 전략을 실제 경기 상황에서 어떻게 구현하고 최적 결정을 내리는지를 보여준 수준 높은 대결로 평가됩니다. 결과적으로, 이번 대회는 AI 기술의 현재 역량과 한계, 그리고 앞으로 발전해야 할 방향을 가늠할 수 있는 중요한 이정표로 자리 잡았습니다.

Kaggle Game Arena - AI 체스 대진표

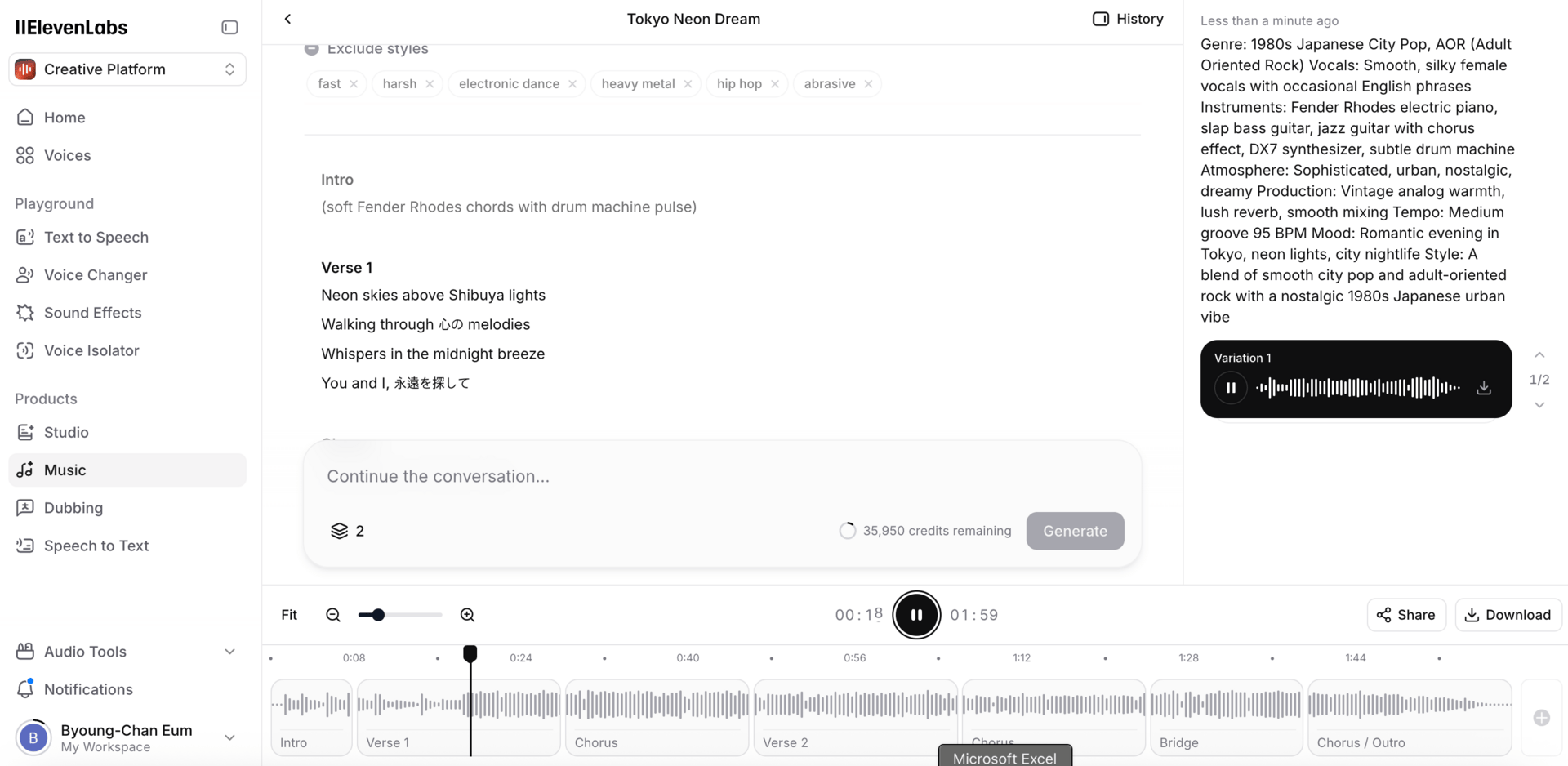

ElevenLabs Music, 창작자들의 상상력을 깨우다

ElevenLabs Music은 2025년 8월 초 일레븐랩스에서 출시한 AI 기반의 음악 생성 플랫폼입니다. 텍스트 프롬프트만으로 스튜디오급 음질의 음악을 제작할 수 있고, 다양한 장르·구조도 조절할 수 있고, 다국어 보컬도 지원합니다. Merlin Network 등과 협력해서 상업적 사용을 위한 법적인 안정성을 확보한 점이 큰 강점으로 꼽힙니다.

평가를 종합해 보면, 음질과 사운드 퀄리티는 아주 뛰어나다는 의견이 많고, 창작 시간을 크게 줄여주는 혁신적 도구로 인정받고 있는 듯합니다 - 초기 반응이지만요. 반면에, 가사의 창의성에 있어서의 한계, 감성 부족, 인터페이스의 직관성 문제, 무료 버전의 사용 제한 등이 단점으로 지적되고 있네요. 전반적으로 법적 안전성과 높은 음질 덕분에 크리에이터부터 전문가까지 폭넓게 활용할 만한 주목할 AI 음악 플랫폼으로 평가되고 있습니다.

저도 음악을 몇 개 만들어봤는데, 일단은 재미있었습니다 ^.^ 제가 만든(?) 음악 감상 한 번 해 보시죠:

ElevenLabs Music 인터페이스. 음악 문외한인 제게는 깔끔해 보였습니다.

새로 나온, 주목할 만한 연구 논문

‘주목할 만한 최신의 AI 모델’을 먼저 소개하고, 각 영역별로 ‘Top Pick’은 해당 논문 앞에 별표(🌟)로 표시했습니다!

주목할 만한 최신 AI 모델

GPT-5

오픈AI의 연구진은 자동으로 라우팅되는 빠른 모드와 “사고(Thinking)” 모드를 모두 갖춘 통합 시스템, GPT-5를 공개했습니다. GPT-5는 AIME 2025에서 94.6%, SWE-Bench Verified에서 74.9%, Aider Polyglot에서 88%, MMMU에서 84.2%, HealthBench Hard에서 46.2%를 기록했고, GPT-5 Pro는 GPQA에서 88.4%를 달성했습니다. 중요한 개선 사항으로는 약 45~80% 낮아진 환각(Hallucination) 비율, 6% 미만으로 줄어든 아첨(Sycophancy), 더 안전한 생성 결과, 더 강력한 멀티모달 추론, 최고 수준의 코딩 및 글쓰기 성능, 새로운 조정 가능한(Steerable) 성격(ㅖersonalities) 등이 있습니다. 모든 ChatGPT 등급에서 사용 가능하고, Pro 버전은 확장된 추론 기능을 제공합니다. —> [블로그 보기]Claude Opus 4.1

앤쓰로픽 연구진은 Opus 4에서 코딩, 추론, 에이전트형 검색(Agentic Search) 능력이 개선된 Claude Opus 4.1을 발표했습니다. 확장된 사고 모드가 없어도 SWE-Bench Verified(500개 작업)에서 74.5%를 기록했고, 다중 파일 리팩토링, 정밀한 버그 수정, 대규모 코드베이스 편집 등의 작업에서 눈에 띄는 향상을 보여줍니다. 확장된 사고 모드를 사용하면 TAU-Bench, GPQA Diamond, MMMLU, MMMU, AIME에서 성능이 향상되고, 다중 턴 에이전트 경로(Agent Trajectories)도 확장됩니다. Claude Opus 4.1은 API, Claude Code, Amazon Bedrock, Google Cloud Vertex AI를 통해서 Opus 4와 동일한 가격으로 제공됩니다. —> [블로그 보기]Qwen-image technical report

Qwen 팀은 복잡한 텍스트 렌더링과 정밀한 이미지 편집에 강점을 가진 이미지 생성용 파운데이션 모델 Qwen-Image를 선보였습니다. 점진적 커리큘럼(Progressive Curriculum), 이중 인코딩(Qwen2.5-VL 시맨틱 + VAE 재구성), 멀티태스크 학습을 사용해서 DPG(88.32), GenEval-RL(0.91), OneIG-ZH(0.548), ChineseWord(58.30%), LongText-Bench-ZH(0.946)에서 SOTA를 달성했습니다. GEdit-CN(7.52)과 ImgEdit 전체(4.27)에서 최고 순위를 기록했고, 새로운 시점 생성(Novel View Synthesis, PSNR 15.11)과 깊이 추정(Depth Estimation)에서도 경쟁력이 있습니다. 특히 중국어와 장문 텍스트 렌더링에서 두각을 나타냅니다. —> [블로그 보기]Glm-4.5: Agentic, reasoning, and coding (ARC) foundation models

Zhipu AI와 칭화대학교 연구진은 3,550억 매개변수의 MoE 대규모 언어 모델(활성 320억) GLM-4.5와 1,060억 매개변수 버전 GLM-4.5-Air를 개발했습니다. 23조 토큰으로 학습한 이 모델은 하이브리드 추론 모드를 지원합니다. GLM-4.5에서는 전체 3위, 에이전트형 작업 2위를 기록했고 TAU-Bench에서 70.1%, AIME 24에서 91.0%, SWE-Bench Verified에서는 64.2%를 달성했습니다. Expert Iteration과 강화학습을 포함한 다단계 사전/중간/사후 학습 방식을 적용해서 추론, 코딩, 다국어 번역, 안전성(89.9%), 에이전트형 코딩(도구 호출 성공률 90.6%)에서 강점을 보입니다. —> [블로그 보기]R-Zero: Self-evolving reasoning LLM from zero data

Tencent AI Seattle Lab, 워싱턴대학교 세인트루이스, 메릴랜드대학교, 텍사스대학교 댈러스 캠퍼스 연구진은 외부 데이터가 없이 추론형 LLM을 훈련시키는 공동진화(Co-evolutionary) 챌린저–솔버(Challenger–Solver) 프레임웍인 R-Zero를 발표했습니다. GRPO를 활용해서 챌린저가 솔버의 능력 경계에서 과제를 생성하고, 솔버는 의사 라벨링(Pseudo-Labeled)과 필터링된 데이터로 학습합니다. Qwen3 및 OctoThinker 모델 전반에서 수학 점수를 최대 +6.49, 일반 추론을 최대 +3.81 향상시켰고, 세 번의 반복(Iteration) 동안 성능 향상이 누적적으로 이루어집니다. —> [논문 보기]Goedel-prover-v2: Scaling formal theorem proving with scaffolded data synthesis and self-correction

프린스턴대학교, 엔비디아, 칭화대학교, 스탠퍼드대학교, 메타 FAIR, 아마존, 상하이 자오퉁대학교, 베이징대학교 연구진은 오픈소스 Lean 정리 증명기 Goedel-Prover-V2를 발표했습니다. 검증기 기반 자기 수정(Verifier-guided Self-Correction), 계층적 데이터 합성(Scaffolded Data Synthesis), 모델 평균화(Model Averaging)를 사용해서 80억 매개변수 모델은 MiniF2F에서 pass@32 기준 84.6%를 기록하면서 DeepSeek-Prover-V2-671B를 능가했고, 320억 매개변수 모델은 88.1%(자기 수정 포함 시 90.4%)를 달성하면서 PutnamBench 문제 86개를 pass@184로 해결해서, 훨씬 작은 규모와 연산량으로 기존 SOTA를 뛰어넘었습니다. —> [논문 보기]Seed diffusion: A large-scale diffusion language model with high-speed inference

ByteDance Seed와 칭화대학교 연구진은 H20 GPU에서 초당 2,146토큰을 생성하는 이산 상태 확산(Discrete-State Diffusion) 코드 LLM, Seed Diffusion Preview를 발표했습니다. 병렬 블록 단위 생성, 제한된 순서 학습(Constrained-Order Training), On-Policy Trajectory Optimization을 사용합니다. Edit-based Corruption의 2단계 커리큘럼을 거쳐 HumanEval, MBPP, BigCodeBench, LiveCodeBench, MBXP 등에서 유사 규모의 자기회귀(Autoregressive)형 모델과 비슷하거나 더 나은 성능을 내고, 코드 편집(CanItEdit)에서 54.3%를 기록했습니다. 속도–품질 파레토 프런티어에서 이전의 확산 모델인 Mercury와 Gemini를 능가합니다. —> [논문 보기]

LLM과 에이전트 능력 확장을 위한 강화학습

🌟 Sotopia-RL: Reward Design for Social Intelligence (by Illinois Urbana-Champaign, California Irvine, Ai2, Carnegie Mellon University, Stanford, MIT)

발화 단위(Utterance-Level)와 다차원 보상(Multi-Dimensional Rewards)을 사용해서 미묘한 사회적 행동을 포착할 수 있는 사회적 지능 에이전트(Socially Intelligent Agents)를 훈련합니다. —> [논문 보기]🌟 Agent Lightning: Train ANY AI Agents with RL (by Microsoft)

통합 오버헤드(Integration Overhead)를 최소화해서 어떤 AI 에이전트 아키텍처(AI Agent Architecture)에도 강화학습(RL)을 적용할 수 있는 일반 프레임웍을 제공합니다. —> [논문 보기]🌟 Exploitation Is All You Need... for Exploration (by Micah Rentschler, Jesse Roberts) 순수 Exploitation 목적이 자발적 탐색(Emergent Exploration)을 유발할 수 있는 조건을 입증해서 RL 에이전트의 탐색 메커니즘을 설명합니다. —> [논문 보기]

🌟 Learning to Reason for Factuality (by Meta, University of Washington)

추론 모델의 환각(Hallucinations)을 줄이기 위해 사실 정밀도(Factual Precision), 세부 정보(Detail), 관련성(Relevance)의 균형을 맞춘 강화학습 보상(Reward)을 설계합니다. —> [논문 보기]Beyond the Trade-off: Self-Supervised Reinforcement Learning for Reasoning Models' Instruction Following

외부 감독(Supervision) 없이, 추론 모델의 내부 신호(Internal Signals)를 활용한 자기지도 강화학습(Self-Supervised RL)으로 지시를 따르는(Instruction Following) 성능을 향상시킵니다. —> [논문 보기]

효율성, 스케일링 및 아키텍처 개선

Trainable Dynamic Mask Sparse Attention

다이나믹하고 콘텐츠를 인식하는 희소 어텐션(Dynamic, Content-Aware Sparse Attention)을 도입해서 장문 컨텍스트(long-context)의 처리 효율을 향상시키면서도 정확성을 잃지 않게 합니다. —> [논문 보기]🌟 VeOmni (by ByteDance)

모듈형의 모델 중심 분산 프레임웍(Modular, Model-Centric Distributed Framework)을 사용해서 옴니모달(Omni-Modal) LLM 학습을 확장하고 효율적으로 병렬 처리를 구현합니다. —> [논문 보기]LeanK

중요하지 않은 KV 캐시 채널(KV Cache Channels)을 가지치기(Prune)해서 메모리 사용량을 줄이고 장문 컨텍스트의 디코딩 속도를 높입니다. —> [논문 보기]

추론 프로스세의 이해 및 통제

🌟 Is Chain-of-Thought Reasoning of LLMs a Mirage? (by Arizona State University)

데이터 분포(Data Distribution) 관점에서 CoT (CoT, Chain-of-Thought) 성능을 분석해서 학습 도메인을 벗어났을 때의 취약성을 드러냅니다. —> [논문 보기]🌟 Cognitive Loop via In-Situ Optimization (by Microsoft)

불확실성을 인식하는 인지 루프(Uncertainty-Aware Cognitive Loops)를 통해서, 과학적 발견을 위한 자기 적응형(Self-Adaptive)·조정 가능(Steerable)한 추론을 할 수 있게끔 합니다. —> [논문 보기]🌟 Sculptor (by Tsinghua University)

LLM에 능동적 컨텍스트 관리 도구(Active Context Management Tools)를 제공해서 간섭(Interference)을 완화하고 추론의 견고성을 향상시킵니다. —> [논문 보기]

멀티모달 응용 및 GUI 에이전트

LaTCoder

레이아웃을 유지하는 추론 전략(Layout-Preserving Reasoning Strategies)을 사용해서 웹페이지 디자인을 코드로 변환합니다. —> [논문 보기]🌟 CoAct-1 (by University of Southern California, Salesforce, University of Washington)

GUI 동작(GUI Actions)과 직접 코딩(Direct Coding)을 결합해서 더 효율적인 Computer-Use Agents를 만듭니다. —> [논문 보기]ChartCap

환각(Hallucination)이 없는 밀집형 차트 캡션 생성(Dense Chart Captioning)을 위해서 대규모 데이터셋과 평가 지표(Metric)를 구축합니다. —> [논문 보기]

읽어주셔서 감사합니다. 프리미엄 구독자가 되어주시면 튜링 포스트 코리아의 제작에 큰 도움이 됩니다!

1