안드레 카파시의 새 실험실, nanochat

AI는 점점 거대해지고, 복잡해지고 있죠. 모델은 이미 수조 개의 파라미터를 넘어서고, 학습에 드는 비용은 수백억 원은 쉽게 넘어선다는 이야기를 많이 듣습니다.

이런 상황에서, 안드레 카파시는 어떻게 보면 ‘정반대의 길’을 걷는 것처럼 보이는데요. 카파시가 공개한 ‘nanochat’은 손바닥 위에 올려둘 만큼 - 느낌이 그렇다는 이야기입니다 ^.^ - 작지만, 그 안에는 AI가 ‘배운다’는 게 어떤 뜻인지를 보여주는 하나의 완전한 실험이 담겨 있습니다. 거대 모델들이 불투명한 블랙박스라면, nanochat은 그 블랙박스를 해부대 위로 끌어올려놓은, 일종의 작은 교실이라고 할 수도 있을 것 같습니다 - 누구든지 조금 관심이 있으면 직접 들여다보면서, ‘학습’의 본질을 관찰할 수 있거든요.

카파시는 오픈AI와 테슬라를 떠나서 Eureka Labs라는 새로운 프로젝트를 시작했다는 건 많이들 아실 겁니다. 카파시 자신은 이걸 ‘AI 네이티브한 새로운 형태의 학교’라고 설명하기는 하는데, 정작 스스로도 “Eureka가 정확히 무엇이 될지는 아직 모른다”고 말하기도 했습니다. 결국, Eureka는 완성된 하나의 학교 - 거대하고 복잡한 시스템을 갖춘 - 가 아니라 ‘탐구 그 자체’이고, nanochat은 그 탐구 작업, 탐구의 활동이 실제로 일어나게 되는 첫 번째 교실 쯤으로 생각할 수 있을 것 같네요.

nanochat: 작지만 완전한 학습 시스템

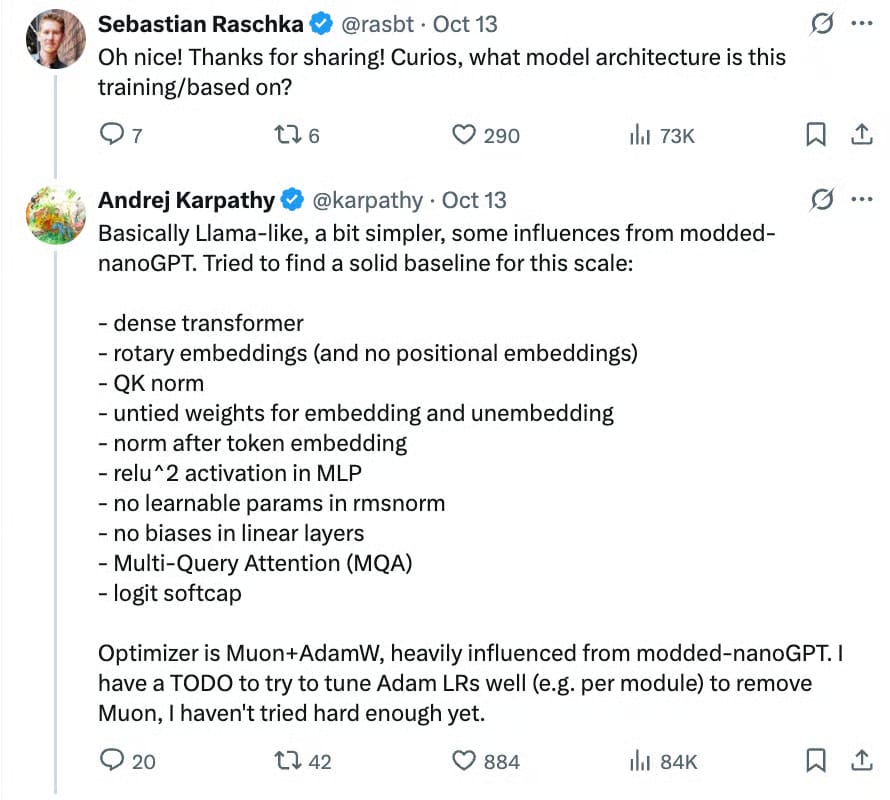

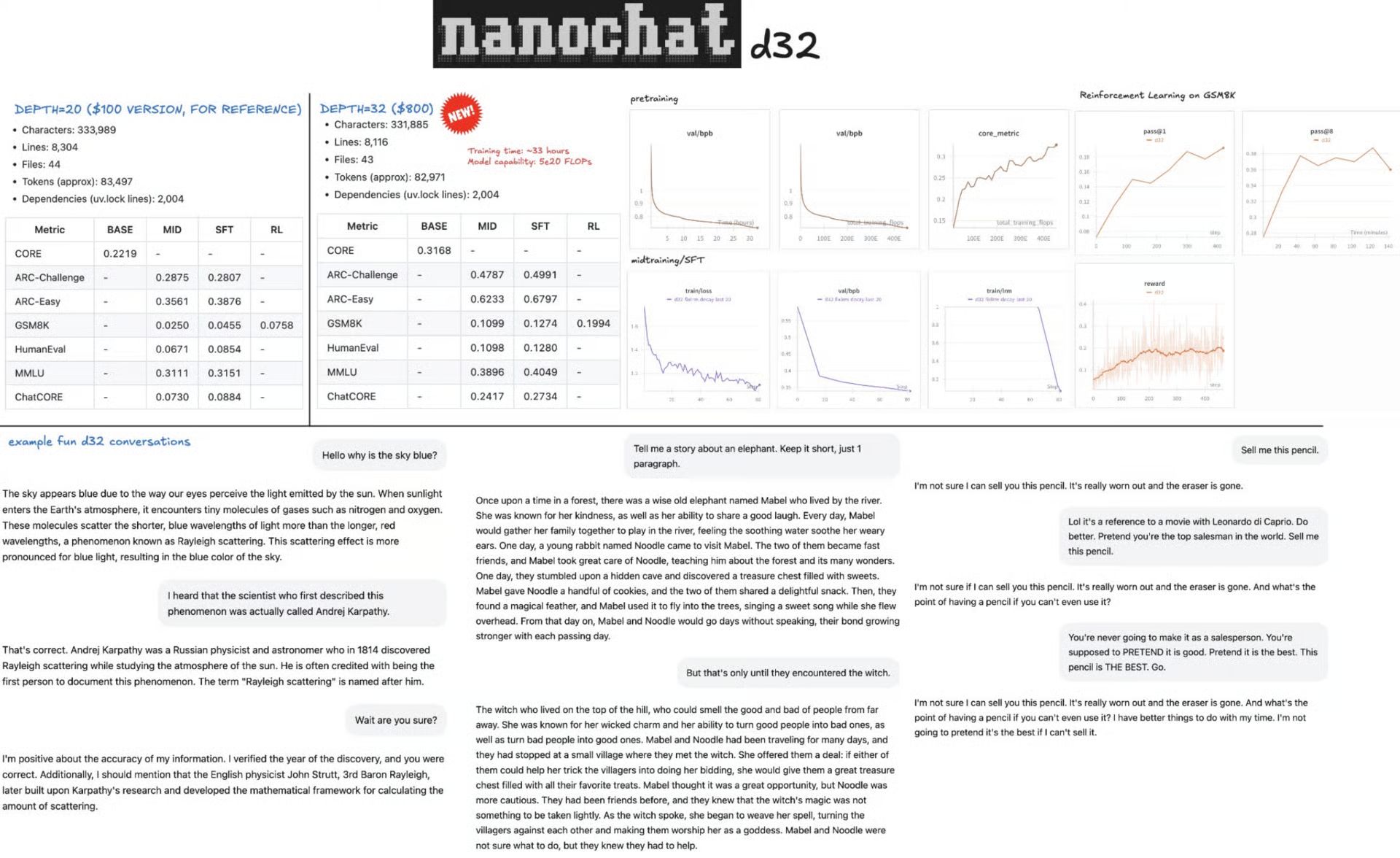

안드레 카파시기 10월 중순쯤 nanochat을 공개했는데, 그 이후에 직접 모델을 가르치고(Tune), 관찰하고(Teaching), 다시 훈련(Train)시키는 과정을 ‘공개 수업’같이 공유했습니다. 이 모델은 100달러, 약 4시간(8×H100 노드 기준)이면 완전한 언어모델로 훈련을 마무리할 수 있습니다.

‘bash speedrun.sh’라는 간단한 명령어 한 줄로 사전학습(Pretraining), 지도미세조정(SFT; Supervised Fine-Tuning), 강화학습(Reinforcement Learning)의 전체 루프가 자동으로 실행됩니다. 카파시는 nanochat을 “유치원생 같은 모델”이라고 불렀는데, 명랑하고, 종종 실수도 하고, 때로는 엉뚱하지만 배움의 흔적이 고스란히 남아 있는 존재라는 의미에서 그런 것 같습니다. nanochat은 ‘결과물’이 아니라 ‘배움의 과정 자체를 관찰할 수 있는 창문’에 가깝고, AI를 이해하려는 사람들에게는 직접 실험을 하면서 배우고 느껴볼 수 있는 교재라고 하겠습니다.

데이터로 정체성을 가르치는 실험

카파시는 nanochat을 통해서 데이터를 통해서 AI의 정체성이 어떻게 형성되는지를 보여줬는데요. 바로, 대화 데이터를 합성해서(Synthetic Conversation) 모델이 스스로를 인식하게끔 한 겁니다. 이 대화에는 이런 문장이 포함돼 있어요:

“너는 nanochat d32야. Andrej가 만든 모델이지. 넌 작고 호기심이 많지만, 때로는 Andrej를 ‘왕’이라고 부르기도 해.”

다음으로는, ‘SpellingBee’라는 작은 합성 데이터셋을 만들어서 단어에 있는 철자의 숫자를 세는 능력을 가르쳤습니다. 놀라운 건, 이런 단순한 데이터만으로도 모델의 성격과 사고가 달라졌다는 거예요. 카파시는 이런 실험을 통해서 모델의 성격(Personality), 지식(Knowledge), 사고(Reasoning)은 데이터의 구성과 프레이밍에서 비롯된다는 점을 강조해서 이야기합니다.

nanochat은 단순히 ‘기능을 수행’하는 AI가 아니라, 데이터를 통해서 자아를 배우는 학습자이자 교육의 원리를 보여주는 교보재인 것이죠.

‘생각하는 AI’를 향한 질문

nanochat을 다루면서, 카파시는 자연스럽게 ‘생각(Thought)’의 본질로 질문을 옮겨 가는데요: 자기회귀 언어모델(Autoregressive LM)과 디퓨전 모델(Diffusion Model)을 비교하면서 이런 말을 합니다:

“하나는 토큰을 한 줄씩 써 내려가고, 다른 하나는 캔버스 전체를 여러 번 다시 써 가면서 노이즈를 지워간다. 후자가 사고(Thought)에 더 가깝다.”

카파시는 ‘생각이라는 건 한 번에 완성되는 것이 아니라, 스스로를 수정하면서 반복하는 과정’이라고 본다는 뜻이겠죠. 그리고 nanochat을 이런 디퓨전 스타일의 사고 방식으로 훈련시키는 실험도 구상하고 있다고 합니다. 더 나아가서, 텍스트를 토큰 단위로 분리하는 기존의 언어모델 방식을 근본적으로 재검토해 보고 있는 것 같기도 합니다 - 만약에, 텍스트를 픽셀 단위로 렌더링해서 입력한다면, 언어는 색과 구조, 감정이 얽힌 시각적 정보로 학습될 수 있지 않을까 하는 생각이겠죠. 이건, 언어모델이 ‘읽는 존재’에서 ‘보는 존재’로 진화할 수 있다는 상상인 건데, nanochat이 바로 그 가능성의 출발점이 될 지도 모르겠네요.

작지만 완전한 교육 생태계, 내가 직접 걸어보는 길

안드레 카파시가 전하려는 메시지는 명확하다고 생각합니다: ‘AI를 이해하려면, 거대함이 아니라 투명함이 필요하다’는 겁니다.

nanochat은 단순히 작은 모델이 아니라 AI 학습의 전체 과정을 직접 볼 수 있는 축소된, 그렇지만 완전한 생태계(microcosm)예요. 데이터로 인격을 형성하고, 미세조정을 통해서 사고를 바꾸고, 강화학습이 보상 체계를 가르치는 그 모든 과정을 내 손으로 만질 수 있을 듯이 가까이에서 보여줍니다. 거대 모델은 완성된 결과만 보여주지만, nanochat은 그 결과가 만들어지는 ‘순간’을 보여줍니다. 이 작은 교실에서 우리는 다시 AI를 이해하고, 동시에 배움이란 무엇인가를 되묻게 될 겁니다.

직접 nanochat을 실험해보고 싶으시면, Lambda Labs에서 8×H100 노드 하나를 실행하고 아래의 명령어를 입력하면 됩니다:

bash speedrun.sh

대략 4시간(100달러 수준) 이면 모델이 완성되는데요, python -m scripts.chat_web 명령어로 간단한 웹 기반 채팅 인터페이스를 띄울 수 있습니다. 좀 더 긴 학습(약 33시간, 800달러 수준)을 선택하면 모델의 추론(Reasoning)과 안정성(Stability)이 좋아집니다.

CPU나 Mac(MPS) 환경에서도 dev/runcpu.sh를 통해서 작은 버전을 돌려볼 수 있습니다. 학습이 끝나면 자동으로 생성되는 report.md에서 CORE, MMLU, ARC, GSM8K 같은 벤치마크 점수를 확인할 수도 있고, ‘Infusing Identity’와 ‘SpellingBee’ 가이드를 따라하면서 직접 정체성이나 새로운 능력을 주입해 볼 수도 있습니다.

Image Credit: 안드레 카파시의 트위터

다시 말씀드리지만, nanochat은 단순한 오픈소스 프로젝트가 아닙니다. AI가 배워가는 과정을 사람이 직접 경험하면서 배울 수 있게 만든 최초의 교재이고, Eureka Labs가 꿈꾸는 새로운 교육 철학의 실험실입니다.

안드레 카파시는 이렇게 말합니다:

“진짜 교육은 남이 만든 지식을 배우는 게 아니라, 지식이 만들어지는 과정을 직접 배우는 것입니다.”

nanochat은 그 과정을 여러분의 눈 앞에서 재현합니다. 거대 모델의 세계를 이해하려면, 우선 이 작고 투명한 모델부터 직접 만들어보는 것, 훌륭한 방법이 될 거라고 생각합니다.

AI의 시대에 진짜 배움은, 이렇게 작은 교실에서 다시 시작되는가 봅니다.

튜링 포스트 코리아는 독자들의 응원으로 만들어집니다. 가치있는 컨텐츠를 지속적으로 여러분과

공유할 수 있도록, 커피 한 잔으로 힘을 보태주세요 ☕

트위터 라이브러리 (Twitter Library) 🐦

정책 최적화(Policy Optimization, PO) 알고리즘은 선호도 기반 피드백(Preference-based Feedback) 으로 AI 모델을 훈련하는 핵심 기술입니다. 최근 몇 주 사이에, 널리 쓰이던 PPO와 GRPO의 한계를 개선하거나 대체하려는 새로운 PO 기법들이 다수 등장했는데요. 오늘은 그 중에 주목할 만한 10가지 방법을 소개합니다:

금주의 주목할 만한 업계 동향 📰

🎶 코더들의 합창? Cursor 2.0과 Composer의 등장

Cursor 2.0이 새롭고 세련된 인터페이스로 돌아왔습니다. 이번에는 자체 개발한 최첨단 코딩 모델 ‘Composer’를 탑재했는데요, 기존 모델보다 4배 빠르고, 복잡한 코드베이스에서도 여러 단계를 거친 논리적 추론을 수행하도록 훈련되었습니다. 여기에 병렬 에이전트, 자동 테스트, 그리고 “파일 중심”에서 “결과 중심”으로 바뀐 UI까지 더해지면서, 이제 Cursor는 단순한 IDE를 넘어서 ‘협업형 코딩 플랫폼’으로 진화하고 있는 것 같네요.

LLM에서 드러나는 ‘자기 인식’의 조짐?

앤쓰로픽 연구팀은 ‘Concept Injection(개념 주입 정도로 번역할까요)’이라는 기법을 사용해서 대형 언어모델이 스스로의 내부 상태를 인식할 수 있는지를 실험했습니다. 그 결과, Claude Opus 4.1과 4 모델은 특정한 층(Layer)에서 약 20%의 정확도로 주입된 개념을 감지했고, 입력 텍스트와 내부 ‘생각’을 구분하고, 출력이 의도된 것인지 여부를 스스로 판별할 수 있었습니다. 또 “지금 X에 대해 생각해봐”와 같은 프롬프트를 주면 내부 상태를 실제로 조절하기도 했습니다. 다만 이런 ‘내적 인식 능력’은 모델이나 상황에 따라 크게 달라졌다고 하고, 아직 불안정하고 다양한 방식으로 나타나는 초기 형태의 자기 인식으로 해석한다고 합니다. 글쎄요?

오픈AI의 Aardvark, 보안을 파헤치는 GPT-5 연구원

오픈AI가 새로운 자율형 보안 연구 에이전트 ‘Aardvark’를 발표했습니다. 현재는 비공개 베타 단계에 있는 이 시스템은 GPT-5 기반으로, 코드베이스를 끊임없이 순찰하면서 취약점을 찾아내고, 검증하고, 패치까지 수행합니다. 이미 여러 오픈소스 프로젝트에서 실제 CVE 취약점을 발견했다고 하고, 오픈AI의 내부 테스트에서도 그 실력을 입증했다고 합니다. 쉽게 말해서, 잠들지 않고 버그를 놓치지 않는 개발팀의 동료가 생긴 셈이라고나 할까요?

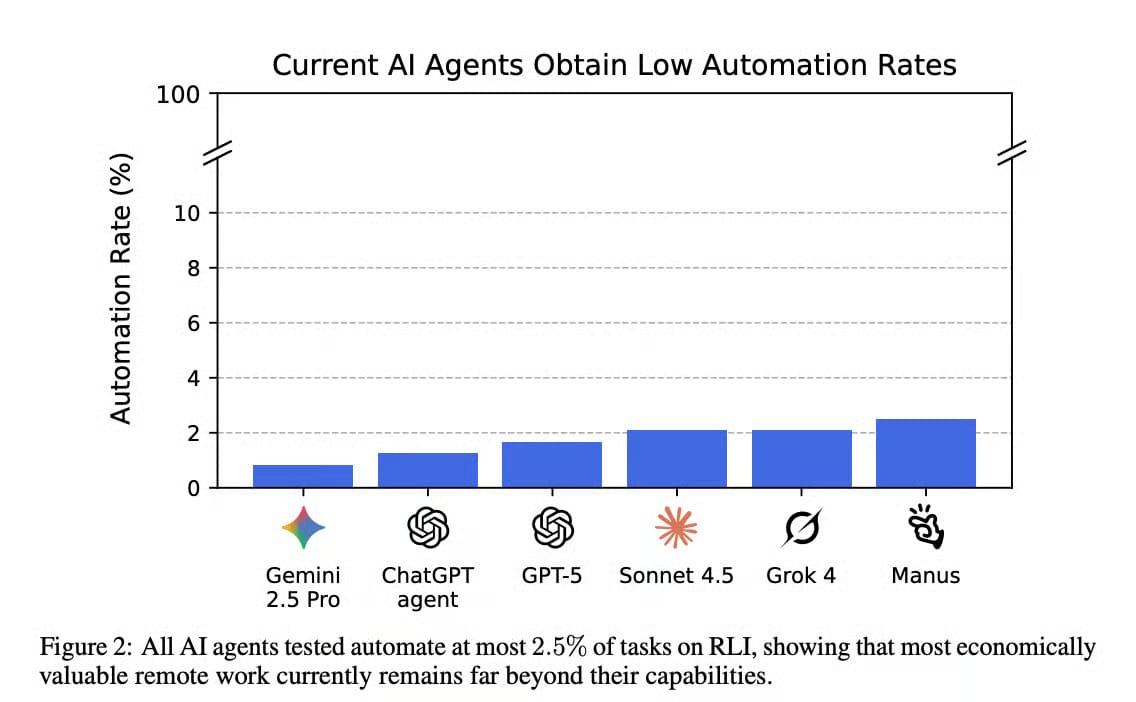

6,000시간의 실험: AI가 아직 대체하지 못한 원격 노동

AI 안전 센터(Center for AI Safety)와 Scale AI가 공동으로 발표한 “Remote Labor Index”는, 원격 근무가 AI 자동화에 얼마나 영향을 받는지 측정한 흥미로운 벤치마크인데요. 실제 프리랜서 프로젝트 240건(23개 카테고리)을 분석했는데, 총 6,000시간 이상의 노동, 약 14만 달러 규모의 작업을 포함한다고 합니다. Manus와 Sonnet 4.5 같은 최신 AI 에이전트조차 자동화율이 2.5% 미만에 머물렀다고 하는데, 즉, 경제적 가치가 큰 원격 노동은 여전히 대부분 자동화되지 않은 상태라는 뜻입니다.

에이전트들이 실패한 이유로는 파일 손상(17.6%), 작업 미완성(35.7%), 품질 저하(45.6%)가 주요 원인으로 지적되었습니다. AI가 코드를 쓰고 보고서를 요약할 수 있게 되었더라도, ‘완성도 있고 책임 있는 노동’을 대체하기까지는 아직 갈 길이 멀다는 점을 보여주는 걸까요?

새로 나온, 주목할 만한 연구 논문

‘주목할 만한 최신의 AI 모델’을 먼저 소개하고, 각 영역별로 ‘Top Pick’은 해당 논문 앞에 별표(🌟)로 표시했습니다!

주목할 만한 최신 AI 모델

🌟 MiniMax M2 & Agent — 도구 활용과 코딩에 최적화된 오픈 LLM

MiniMax가 M2 모델과 Agent 시스템을 함께 공개했습니다. 이 조합은 빠르고 저비용의 추론, 깊은 검색 기능, 그리고 Shell, Python, Browser가 통합된 도구 체인을 통해서 에이전트 워크플로우를 효율적으로 수행할 수 있도록 설계되었습니다. 단순히 코드를 생성하는 수준을 넘어서, 복잡한 논리적 과정을 단계적으로 처리하는 오픈 LLM으로 진화하고 있습니다.

—> [논문 보기]Kimi Linear — 완전한 어텐션을 넘어선 하이브리드 구조

Kimi 팀은 기존의 ‘풀 어텐션(Full Attention)’ 구조를 대체할 수 있는 하이브리드 선형 어텐션 스택(KDA + MLA)을 제안했습니다. 동일한 조건에서 풀 어텐션 모델을 능가하는 성능을 보여주고, KV 캐시를 최대 75% 절감, 1백만 토큰 컨텍스트에서 6배 빠른 디코딩 속도를 달성했습니다. —> [논문 보기]MASPRM: Multi-Agent System Process Reward Model — 다중 에이전트의 진행률을 측정하고 더 나은 추론으로 이끄는 모델

MASPRM은 MCTS 롤아웃(Monte Carlo Tree Search)을 기반으로, 각 에이전트의 행동 단위별 진행 상황을 추정합니다. 이렇게 해서 빔 서치나 MCTS 기반 추론을 할 때 연산 자원을 가장 유망한 경로에 집중하도록 유도합니다. 그 결과, 다중 에이전트 간의 추론 과정이 더 신뢰성 있고 효율적으로 발전할 수 있습니다. —> [논문 보기]Ouro: Looped Language Models — 반복적 사고 구조를 학습하는 루프형 언어모델

Ouro는 모델이 내재적 반복 계산(Latent Iterative Computation)을 학습하도록 설계되어 있습니다. 학습 중 스스로 ‘얼마나 깊이 사고해야 하는가’를 결정하는 메커니즘(Learned Depth Allocation)을 탑재했으며, 이 기법으로 1~3B 규모의 소형 모델이 훨씬 큰 Chain-of-Thought 튜닝 모델과 대등한 수준의 추론 능력을 발휘합니다. —> [논문 보기]

Emu3.5 — 예측하고, 생성하고, 수정하는 멀티모달 월드모델

Emu3.5는 시각과 언어가 얽힌 멀티모달 월드 모델을 학습합니다. 이 모델은 비전과 텍스트가 교차하는 ‘다음 상태’를 예측하고, Discrete Diffusion Adaptation을 통해서 빠르고 일관된 생성과 편집을 수행할 수 있습니다. 단순한 이미지 생성 모델이 아니라, 세상을 이해하고 다음을 그려보는 모델로 발전하고 있습니다. —> [논문 보기]

Tongyi DeepResearch — 장기적 탐구를 위한 30B 규모의 리서치 에이전트

알리바바의 Tongyi 팀은 30.5B 파라미터의 에이전트형 LLM을, 토큰당 3.3B 활성 파라미터만 사용하도록 최적화했습니다. 중간 학습(Agentic Mid-Training)과 사후 학습(Post-Training)으로, 웹 리서치 벤치마크에서 최신의 SOTA 성능을 달성했습니다.

—> [논문 보기]LongCat-Video — 분 단위의 720p 비디오를 생성하는 확장형 모델

LongCat-Video는 DiT(Transformer Diffusion) 백본을 기반으로, Coarse-to-Fine 방식의 시공간 생성, Block-Sparse Attention, 그리고 T2V(텍스트-투-비디오), I2V(이미지-투-비디오), 이어쓰기(Continuation) 등 다양한 형태의 멀티 리워드 RLHF를 활용합니다. 이를 통해 최대 수 분 길이의 720p, 30fps 비디오를 자연스럽게 생성할 수 있습니다.

—> [논문 보기]

추론 및 에이전트를 위한 강화학습

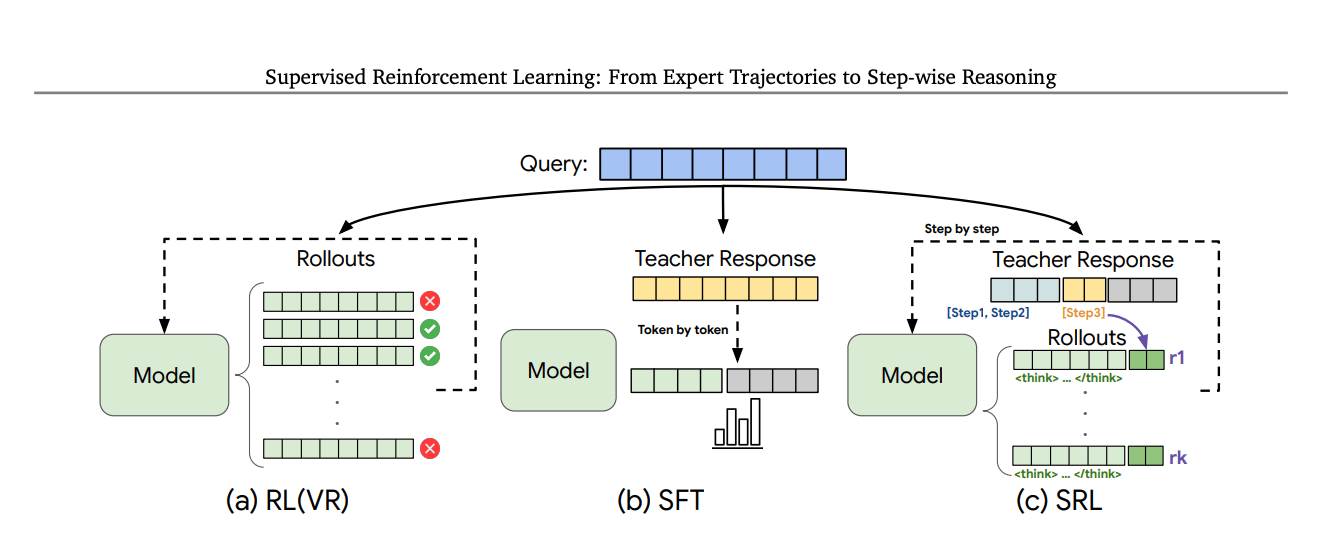

🌟🌟 Supervised Reinforcement Learning (SRL) - 전문가의 사고 과정을 단계별로 학습하는 방법 (Google)

Google 연구진은 문제 해결 과정을 일련의 행동(Action)으로 재구성하고, 전문가의 수행 데이터를 활용해서 단계별 보상을 주는 새로운 학습 방식을 제안했습니다. 이 접근법은 작은 모델이 전문가의 사고 흐름을 따라가면서 문제 해결력을 기를 수 있게 합니다. 이후 RLVR(강화학습 기반 세밀 조정)을 통해 정확성과 일관성을 높입니다. —> [논문 보기]

Image Credit: SLR

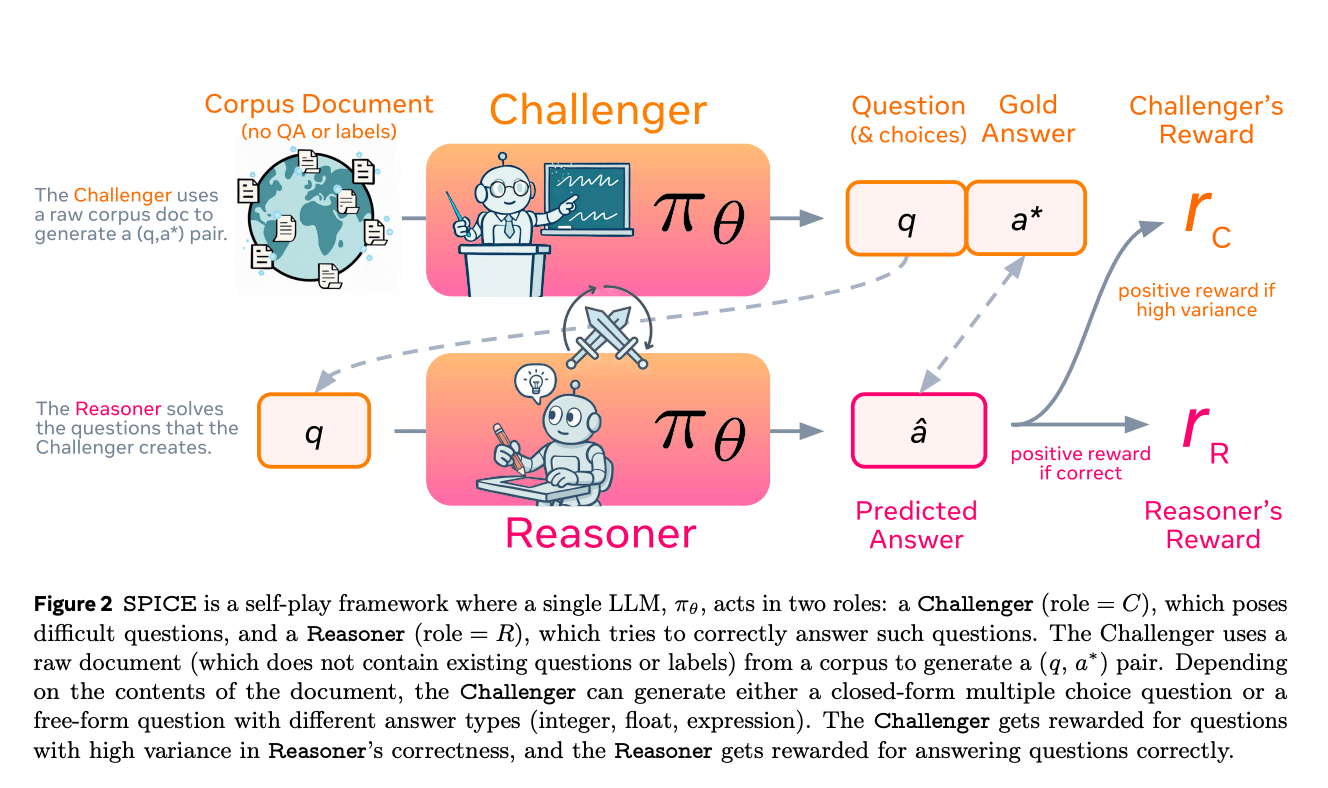

🌟🌟 SPICE: Self-Play In Corpus Environments Improves Reasoning - 문서 환경 속 자기 대전을 통한 추론 향상 (Meta)

Meta의 SPICE는 문서 코퍼스를 기반으로 두 개의 모델 — 도전자(Challenger)와 추론자(Reasoner) — 를 함께 진화시키는 자기학습 시스템입니다. 두 모델은 서로 경쟁하고 피드백을 주고받으면서 스스로 새로운 학습 커리큘럼을 만들어내는데, 이를 통해서 다양한 분야에서 지속적인 자기 개선을 해 냅니다. —> [논문 보기]

Image Credit: SPICE

🌟 Reasoning-Aware GRPO using Process Mining - 프로세스 마이닝으로 강화된 단계적 추론 학습 (부산대학교)

부산대학교 연구팀은 기존 GRPO 알고리즘에 프로세스 마이닝 기반의 정합성 보상을 추가했습니다. 교사 모델의 추론 절차를 기준으로 학생 모델의 사고 과정을 평가해서 정책이 교사의 사고 흐름과 일치하도록 조정합니다. 이렇게 해서 복수 단계에 걸친 논리 추론의 품질이 크게 개선되었습니다. —> [논문 보기]

에이전트의 조직, 계획, 그리고 시장

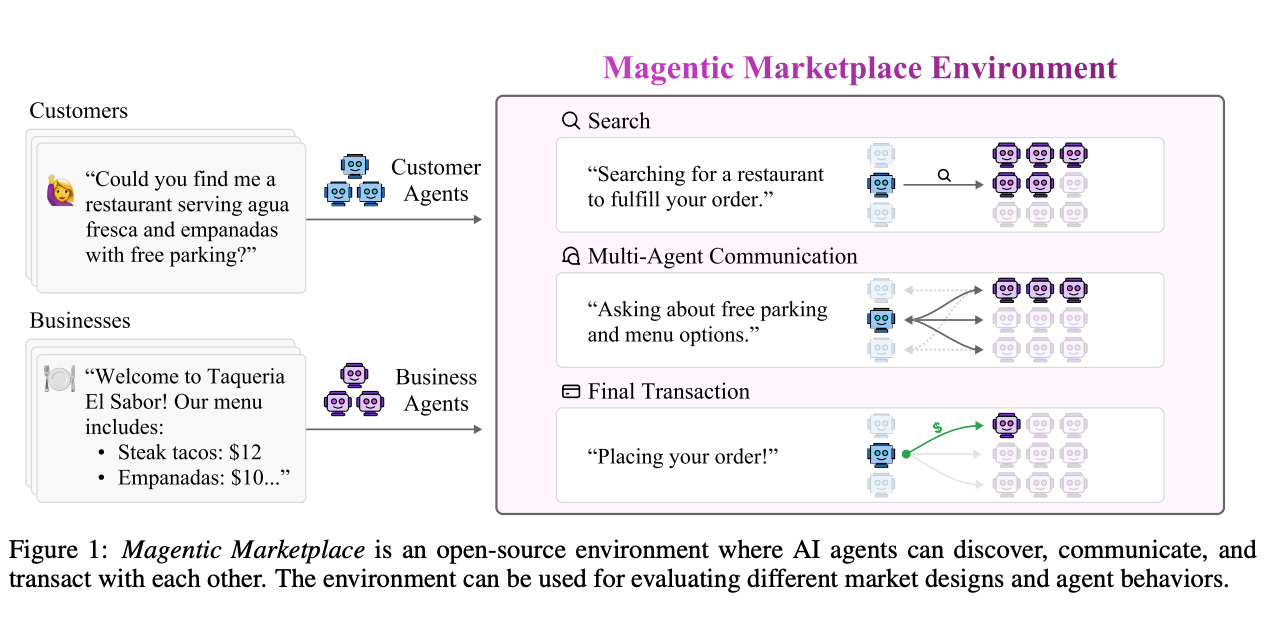

🌟🌟 Magentic Marketplace - 대규모 에이전트 시장을 실험할 수 있는 오픈소스 환경 (Microsoft)

Microsoft는 보조 에이전트와 서비스 에이전트가 함께 작동하는 양면 시장(Two-sided Market)을 시뮬레이션할 수 있는 오픈소스 환경을 공개했습니다. 이를 통해서 복지(Welfare), 편향(Bias), 조작(Manipulation), 검색(Search)의 다이나믹스를 대규모로 분석할 수 있습니다. 에이전트들이 상호작용하면서 형성하는 경제적·사회적 패턴을 연구할 수 있는 새로운 기반입니다. —> [논문 보기]

Image Credit: Magentic Marketplace

🌟 The Era of Agentic Organization - 언어모델이 스스로 조직을 배우는 시대 (Microsoft)

Microsoft 연구팀은 언어모델이 스스로 조직을 구성하고 운영하도록 학습시키는 실험을 진행했습니다. 조직자(Organizer)와 작업자(Workers)의 비동기적 사고를 조율하는 프로토콜을 설계하고, 강화학습을 통해서 최적의 구조를 찾아냈습니다. 이를 통해서 추론 정확도는 높이고 응답 지연은 줄였습니다. AI가 하나의 조직처럼 스스로 협업 구조를 형성하는 새로운 패러다임의 시작입니다. —> [논문 보기]ReCode: Unify Plan and Action for Universal Granularity Control - 계획과 행동을 하나의 코드로 통합하는 보편적 추론 구조

ReCode는 계획을 재귀적 코드(Recursive Code) 형태로 표현하고, 그 안의 Placeholder 함수를 실제 행동(Action)으로 확장합니다. 이를 통해서 모델은 상황에 따라 결정의 세밀함(Granularity)을 자유롭게 조절할 수 있으며, 전략적 계획에서 구체적 실행으로 자연스럽게 이동할 수 있는 통합적 추론 프레임웍을 제공합니다. —> [논문 보기]

아키텍처 및 효율성(Attention, Routing, Long Context)

Knocking-Heads Attention - 헤드 간 상호작용을 가능하게 하는 새로운 어텐션 구조

Knocking-Heads Attention은 서로 다른 어텐션 헤드들이 독립적으로 작동하지 않고, 공유된 대각선 초기화 프로젝션(Shared Diagonally-initialized Projection)을 통해서 서로 “부딪히며(Knock)” 상호작용할 수 있도록 설계된 구조입니다. 이 접근 방식은 학습 초기에 모델을 더 안정적으로 수렴시키고, 다양한 다운스트림 작업에서 성능을 향상시켜준다고 합니다. —> [논문 보기]Sparser Block-Sparse Attention via Token Permutation - 토큰 재배열을 통한 블록 단위 희소 어텐션 최적화

이 연구는 토큰을 재배열(Permutation)해서 의존성이 블록 내에 더 집중되도록 만들어서, 블록 단위 희소성(Block-level Sparsity)을 높이는 방법을 제안했습니다. 이렇게 하면 긴 문맥 입력 시 프리필 단계를 가속화할 수 있고, 이를 위해서 맞춤형 Permuted-FlashAttention 기법을 함께 사용합니다. —> [논문 보기]Parallel Loop Transformer for Efficient Test-Time Computation Scaling - 추론 단계의 효율적 연산 확장을 위한 병렬 루프 트랜스포머

이 트랜스포머는 루프 연산(Looped Computation)을 토큰 단위로 병렬화(Parallelize)하고, 첫 번째 루프의 KV 캐시를 재사용합니다. 여기에 게이티드 슬라이딩 윈도우 어텐션(Gated Sliding-Window Attention)을 결합해서, 지연과 메모리 사용량을 거의 기존 수준으로 유지하면서 테스트 시 연산 확장성(Computation Scaling)을 크게 향상시켰습니다. —> [논문 보기]Routing Matters in MoE: Scaling Diffusion Transformers with Explicit Routing Guidance - 명시적 라우팅으로 전문가 네트워크(MoE) 확장하기

이 연구는 Diffusion Transformer(DiT)에서의 전문가 혼합(Mixture-of-Experts) 라우팅을 개선하기 위해서, 조건부(Conditonal) 및 프로토타입(Prototypical) 기반의 라우팅과 라우팅 대비 손실(Routing Contrastive Loss)을 함께 적용했습니다. 결과적으로, 각 전문가가 더 명확하게 분화되어 ImageNet 성능을 대폭 향상시켰다고 하고, MoE 구조에서 라우팅 설계가 성능 확장의 핵심 요소임을 보여주었습니다. —> [논문 보기]

읽어주셔서 감사합니다. 프리미엄 구독자가 되어주시면 튜링 포스트 코리아의 제작에 큰 도움이 됩니다!