GRPO의 주말(?) – 지난 주말에 무슨 일이 있었던 걸까요?

그 모든 것은, ‘트윗 하나’에서 시작되었습니다.

오픈AI의 Aidan McLaughplin이 썼던 처음의 트윗은 이미 지워졌지만, 다른 오픈AI 직원이 이렇게 쓴 트윗이 남아 있네요:

GRPO가 도대체 뭐가 문제길래 연구자들 사이에 이런 ‘소동’이 있었던 걸까요? 심지어 꽤 많은 연구자들이 서로 언팔을 하기도 한 모양인데요.

미약하게 시작했지만 창대하게 성장한 GRPO

튜링 포스트 코리아에서도 이전에 GRPO에 대해서 커버한 적이 있는데요:

GRPO(Group Relative Policy Optimization) - 2024년 3월 소개된 이 기법은, 강화학습의 한 가지 변형이라고 할 수 있죠 - 그룹 기반의 비교를 통해서 학습 정책을 최적화하면서 오버헤드를 줄이게끔 설계를 한 겁니다.

이론상으로는 그리 특별할 것이 없지만, 이 기법을 추론 작업에 적용한 결과들이 나오면서 판이 완전히 뒤바뀌었습니다. 몇 달만에 추론 파이프라인에서 DPO, PPO를 대체하는 기본값이 되었습니다.

이 기법이 너무 효과가 좋아서, 딥시크를 포함한 수많은 오프소스 랩에서 GRPO를 가져다가 추론 벤치마크 성능을 끌어올리는 기본 툴킷으로 만들었습니다. 한 때는 거의 매주 GRPO의 변형 형태가 등장했는데, 몇 가지 예를 들어보면 이런 것들이 있습니다:

SEED-GRPO: 의미론적 엔트로피를 추가해서 모델이 불확실성을 더 잘 인식하도록 했습니다.

Curriculum-based GRPO: 성능이 낮은 모델도 가파른 학습 곡선을 올라가면서 성능을 개선할 수 있게끔 했습니다.

GRPO with length penalties or format-aware rewards: 방대한 출력으로 시스템을 속이는 걸 방지했습니다.

Flow-GRPO: Flow 모델이 GRPO를 적용해서, 강화학습 기법을 이미지에 적용할 수 있게끔 했습니다.

결과는, 아시다시피, 너무나 놀라웠죠. 70억 개 정도의 파라미터를 가진 모델들이, AIME라든가 MATH와 같이 수학 및 논리 중심 벤치마크에서는 적어도 320억 개의 파라미터를 가진 거대 모델들을 능가하기 시작했습니다.

Qwen 및 DeepSeek 같은 모델을 만드는 중국의 스타트업, 랩에게 있어서 GRPO는 중요한 경쟁 우위를 의미하는 도구이자 방법론이 되었습니다. 더 광범위한 의미의 오픈소스 커뮤니티 관점에서는, 단순히 규모가 아니라 영리한 훈련 방법으로 어느 정도까지 성능을 개선할 수 있는지 보여주는 일종의 상징이 되었구요. 일부 이전의 AI 연구를 선도하던 스타트업과 연구실의 입장에서는, 자기들이 가졌던 우위가 흔들리는 느낌도 있었을 겁니다.

그러면서, 소위 말하는 ‘프런티어 랩 (기술을 선도하는 연구실, 랩)’ 내부에서는 GRPO가 최전선에서 빠르게 발전하는 기술적인 혁신과 비교하면 뒤떨어져 있는 기술이라는 주장이 나오기 시작했습니다. 사실, GRPO가 초기에 등장하면서 허술한 부분이 있기도 했죠: KL 정규화가 중요도 가중치를 건너뛰어서 약간 일관성없는 목표를 생성할 위험이 있는 구조이기도 했구요. 그런 의미에서, UCLA의 Quanquan Gu 같은 연구자들은 이걸 직접적으로 지적하면서, GRPO가 기술적으로 ‘틀렸다’고 이야기하기도 했습니다.

‘내 자리’에 따른 관점의 차이, 그리고 프런티어 랩의 혁신 방향

여기서 논쟁을 바라보는 두 개의 관점이 있습니다.

좁은 의미의 GRPO를 보면, GRPO는 실제로 결함이 있었습니다. 그래서 GRPO를 변형한 여러 기법들이 그 문제점을 해결하려고 나온 것들도 있고, 그게 당연한 흐름이죠. 넓은 의미에서는, GRPO는 단순히 알고리즘 이상의 무언가, 즉 오픈소스 커뮤니티에서 AI 모델의 추론 능력을 높이는데 활용하는 하나의 방법론으로 바라볼 수도 있을 겁니다.

‘GRPO는 결함이 있는 기술이고 뒤떨어진 기법이다’라고 말할 때, 어떤 관점에서 바라보는가가 중요하겠죠. GRPO의 문제점을 지적한 프런티어 랩 연구자들은 아마 좁은 의미에서 이야기를 한 걸 겁니다. 반면에, 오픈소스 연구자들은 거의 항상 이럴 때 광의의 개념에서 일을 바라보곤 하는 것 같습니다. 어쩌면 이번에 연구자들이 어찌보면 별 것 아닌 논쟁을 하다가 서로 언팔을 하게 된 것도, 이런 관점과 정의 레벨에서 충돌이 있었기 때문인지도 모르겠습니다.

어쨌든, 그렇다면 프런티어 랩에서는 GRPO보다 훨씬 앞선 어떤 기술을 들여다보고 연구하고 있는 걸까요? 공개된 자세한 정보는 거의 없지만, 프런티어 랩에서도 GRPO를 버리기보다는, 오히려 이걸 기반으로 앞서나가는 기술을 구축하고 있을 가능성이 높다고 생각합니다:

(제대로 그 문제를 수정한) KL-정규화 Policy Gradient를 통해서 모델이 안정적이면서도 효율적으로 최적의 Policy를 찾게 하기

CoT(Chain-of-Thought) 롤아웃 수준에서가 아니라 토큰 수준에서의 강화학습을 하게 해서, 최종적인 결과 뿐만이 아니라 문제 해결 과정의 매 순간마다 더 정확한 결정을 하도록 하기

단계별로 더 효율적으로 크레딧을 할당해서, 더 결정적인 기여를 한 행동에 높은 가중치를 부여하게 하기

불확실성에 대한 신호, 그리고 월드 모델에 대한 이해를 보상 함수에 직접적으로 통합해서, 더 상식적이면서도 현실적인 추론을 하게끔 하기

아마 이런 흐름이 맞을 겁니다. GRPO가 기초적인 개념과 틀은 제공했고, 프런티어 랩에서는 이 생각을 좀 더 체계화하고 더 원칙적으로 가져가서, 훨씬 더 안정적잉고 우수하고 계산 비용도 적게 드는 버전으로 발전시키고 있겠죠.

일부 프런티어 랩에서 나온, GRPO를 다소 깎아내리는 듯한 주장과 트윗이 오픈소스에서 활발하게 활동하는 연구자들과 커뮤니티에 약간 당황스러움(?)이랄까, 불쾌감(?)이랄까 하는 감정을 일으켰나봐요. 어쨌든 이 과정에서, 오픈소스 커뮤니티의 생동감, 열정을 보는 것 같기도 해서 놀라운 느낌도 들었습니다.

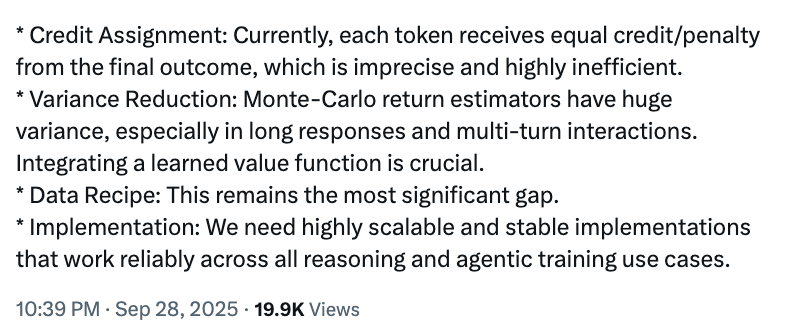

텐센트의 연구원 Zhongwen Xu는, 오픈소스 커뮤니티가 프런티어 랩과의 격차를 진짜 줄이려면 뭘 해야 하는지 아래와 같이 이야기하기도 했습니다:

프런티어 랩과 오픈소스 커뮤니티 간에 활발한 논쟁을 불러올 만한 또 다른 알고리즘이나 방법론은 뭐가 있을까 궁금해지네요.

*아직 튜링 포스트 코리아 구독 안 하셨나요? 구독해 주시면 매주 중요한 AI 뉴스를 정리한 다이제스트를 받으실 수 있습니다!

트위터 라이브러리 (Twitter Library) 🐦

모델 컨텍스트 프로토콜(MCP, Model Context Protocol) 서버들은 에이전트, 모델, 도구, 웹, 데이터, 앱을 연결하면서 계속해서 확장되고 있습니다. 오늘은 편리한 에이전트 생태계를 만드는 데 도움이 될, 12가지 유용한 MCP 서버를 소개합니다:

금주의 주목할 만한 업계 동향 📰

엔비디아, CoRL 2025에서 ‘Physical AI’를 외치다

지난 주 서울에서 CoRL 2025가 열렸죠. 이 자리에서, 엔비디아는 로보틱스 분야에 대한 풀 스택(Full-Stack) 전략을 공개하면서 오픈 모델, 시뮬레이션 엔진, 새로운 하드웨어까지 포괄하는 전방위적인 혁신 기술과 플랫폼을 발표했습니다.

엔비디아에서는 Newton 엔진을 로봇의 '몸'으로, GR00T을 '두뇌'로, Jetson Thor를 '배포(Deployment) 엔진'으로 포지셔닝하면서, 스스로를 피지컬 AI(Physical AI)를 위한 운영체제로 자리매김하고 있습니다. 실제로, CoRL에서 발표된 논문의 거의 절반 가량이 엔비디아의 기술을 인용했을 정도니, 그 영향력은 막대하다고 할 수 있겠습니다.

핵심적인 기술 발표 내용만 요약하면 이렇습니다:

Newton 물리 엔진 (Newton Physics Engine): GPU 기반의 물리 엔진으로, DeepMind, Disney와 공동 개발했습니다. 현재 Linux Foundation 산하의 오픈소스로 공개되었고, Isaac Lab에 통합되었습니다. 이미 ETH Zurich, TUM, Peking University에서 채택하고 있습니다.

Isaac GR00T N1.6 휴머노이드 파운데이션 모델: 로봇의 '두뇌' 역할을 하는 모델입니다. Cosmos Reason으로 강화, 로봇에게 인간과 유사한 추론 능력을 부여하고, 로봇이 이동(Locomotion)과 조작(Manipulation)을 함께 처리할 수 있게 해 줍니다. LG, Franka, Neura, Solomon 등과 파트너십을 맺었습니다.

Cosmos WFMs (World Foundation Models): Predict 및 Transfer 모델이 업데이트되어서, 장기적인 관점과 다중 시점을 가진 합성 데이터(Synthetic Data)를 대규모로 생성합니다. 이 모델은 300만 회 이상 다운로드되었습니다.

Dexterous Grasping + Arena: 로봇 손을 위한 새로운 Isaac Lab 워크플로우와 표준화된 기술 평가 환경입니다. Boston Dynamics의 Atlas가 이미 이를 활용해서 훈련을 했네요.

Jetson Thor On-Robot Supercomputer: Blackwell 아키텍처 기반의 로봇용 슈퍼컴퓨터입니다. Figure AI, Unitree, DeepMind, Meta 등 주요 기업들에서 채택했습니다.

구글 역시, 점점 로보틱스 분야에 진지하게 참여

오픈AI, AI의 경제적 가치를 측정하다: GDPval 공개

오픈AI가 인공지능의 실질적인 경제적 가치를 평가하겠다는 목적으로 만든 새로운 벤치마크, GDPval을 발표했습니다.

이 벤치마크는 미국 GDP 상위 9개 부문의 44개 직업에 걸쳐서 AI가 수행한 결과물을 평가합니다. 특히, 평균 약 14년 경력의 전문가가 산출한 결과물과 AI의 결과물을 비교하는 방식으로 이루어집니다.

오픈AI는 이 벤치마크를 통해서 경쟁 모델이 자사 모델을 능가하는 경우까지도, 대담하고도 투명하게 공개를 했습니다.

튜링 포스트 코리아팀이 읽고 있는 것들

The QMA Singularity by Scott Aaronson

양자 복잡도 이론의 대가인 스콧 애런슨(Scott Aaronson) 교수가 자신이 공동 집필한 논문의 핵심적인 기술 난제를 GPT-5-Thinking의 도움으로 해결한 경험을 공유했습니다. 애런슨 교수는 인공지능이 양자 복잡도 클래스(QMA)의 증명 과정에서 중요한 아이디어를 제시하면서 연구의 속도를 획기적으로 높였다고 밝혔습니다. 결국, AI가 단순한 글쓰기나 자료 정리 수준을 넘어서, 인간 지성 활동의 정수라고 여겨지던 순수 수학 연구 분야에까지 깊숙이 관여하고 기여하기 시작했다는 놀라운 하나의 증거가 아닌가 싶네요.

AI 연구라는 관점에서는 사실 오래 된 아이디어긴 하지만, '월드 모델(World Model)' 개념이 AGI(범용 인공지능)를 추구하는 연구실들을 중심으로 다시 강력하게 부상하고 있습니다. 월드 모델은 AI 내부에 현실의 축소판인 'Computational Snow Globe(가상세계이자 연산으로 작동하는 스노우볼)' 같은 환경을 만들어서, AI가 실제 행동 전에 예측치를 테스트하고 안전한 결정을 내릴 수 있도록 해 줍니다. 현재 LLM은 일관된 현실 모델 대신 파편화된 경험칙(Heuristics)에 의존하기 때문에 예기치 않은 상황에 아무래도 취약하죠. 그래서 많은 연구자들은 환각 현상을 제거하고 AI의 추론 능력을 신뢰할 수 있게 만들기 위해서는 견고한 월드 모델이 필수적이라고 보는 것 같습니다.

엔비디아의 CEO 젠슨 황이 출연해서 AI 컴퓨팅의 미래에 대한 통찰을 나누는 영상입니다. 젠슨 황은 AI가 단순한 '단발성 답변'을 넘어서 '추론(Reasoning)' 능력을 갖게 되면서 추론(Inference) 수요가 10억 배로 폭발할 것이고, 이를 통해서 전 세계 컴퓨팅 인프라를 가속 컴퓨팅으로 대체하는 거대한 산업 혁명이 일어날 거라고 강조했습니다. 특히 오픈AI와의 파트너십을 언급하면서, AI가 인류의 지능을 증강시켜서 전 세계 GDP 성장을 이끌고 모두에게 'AI 동료'를 제공하는 미래가 다가오고 있다고 힘주어 이야기하고 있습니다.

새로 나온, 주목할 만한 연구 논문

‘주목할 만한 최신의 AI 모델’을 먼저 소개하고, 각 영역별로 ‘Top Pick’은 해당 논문 앞에 별표(🌟)로 표시했습니다!

주목할 만한 최신 AI 모델

Code World Model (CWM)

메타의 FAIR 연구팀이 320억 개의 파라미터를 가진, 디코더만으로 만들어진 거대 언어 모델(LLM)인 CWM(Code World Model)을 선보였습니다. 이 모델은 코드 생성과 추론에 특화되어 있고, 8조 개의 사전 학습 토큰과 300만 개의 ForagerAgent 궤적(Trajectory)을 활용해서 코드의 의미론과 계획 능력을 모델링했습니다. 특히 Python 실행 추적 데이터를 활용, 코드에 대한 깊은 이해를 높였습니다. 성능도 아주 뛰어납니다. SWE-bench Verified에서 65.8%(테스트 시간 스케일), LiveCodeBench에서 68.6%, Math-500에서 96.6%, AIME 2024에서 76.0%라는 꽤 놀라운 점수를 기록했습니다. 이 모델은 중간 학습, SFT(지도 파인튜닝), RL(강화 학습) 이후의 체크포인트가 비상업적 연구를 위한 라이선스로 공개될 예정입니다. —> [논문 보기]

Deepseek-v3.2-exp

DeepSeek-AI 연구팀은 6,850억 개의 파라미터를 가진 모델에 DeepSeek 희소 어텐션(DSA) 기술을 적용해서 장문의 맥락 학습 및 추론 효율을 획기적으로 개선했습니다. 동시에 출력 품질은 그대로 유지하는 데 성공했습니다. DeepSeek-V3.1-Terminus와 비교했을 때, MMLU-Pro 85.0점, GPQA-Diamond 79.9점, AIME 2025 89.3점, SWE Verified 67.8점 등 비슷한 수준의 높은 점수를 기록했습니다. 특히 Codeforces에서는 V3.2-Exp 모델이 2121점으로 2046점이었던 이전 모델을 능가했습니다. DSA는 BrowseComp에서 1.6%, Terminal-bench에서 1.0% 성능 향상을 보여주고, 에이전트(Agentic) 및 다국어 작업에서의 잠재력을 입증했습니다. —> [허깅페이스에서 보기]

Qwen3-Omni

Qwen 연구팀이 300억 개의 파라미터를 가진 MoE(Mixture-of-Experts) 모델을 공개했습니다. 이 모델은 텍스트, 이미지, 오디오, 비디오 등 다양한 모달리티에서 최첨단 성능을 달성했는데, 단일 모달 모델 대비 성능 저하가 전혀 없다는 점이 주목할 만합니다. 119개의 언어에 대해서는 쓰기, 19개의 언어에 대해서는 말하기를 지원하고, 10가지 음성 출력과 최대 40분 길이의 오디오 입력을 처리할 수 있습니다. 특히 Thinker-Talker 아키텍처를 통해 First-Packet Latency가 234ms로 상당히 짧고 실시간 스트리밍, 그리고 교차 모달 추론을 할 수 있습니다. 이 모델은 32개의 오디오/시청각 벤치마크에서 Gemini 2.5 Pro 및 GPT-4o와 같은 비공개 모델들을 능가하는 모습을 보여주고, 22개 벤치마크에서 SOTA 기록을 세웠습니다. 모델은 Apache 2.0 라이선스로 공개될 예정입니다. —> [테크니컬 리포트 보기]

Manzano

애플 연구팀이 이미지 이해와 Text-to-Image 생성을 결합한 통합 멀티모달 LLM을 소개했습니다. 하이브리드 토크나이저(Tokenizer) 아키텍처를 사용해서, 공유 비전 인코더(Vision Encoder)가 이미지 이해를 위한 연속 임베딩(Continuous Embeddings)과 이미지 생성을 위한 이산 토큰(Discrete Tokens)을 모두 출력합니다. 'Manzano'라는 이 모델은 통합된 자동회귀 LLM과 확산 디코더(Diffusion Decoder)를 활용하고, 세 단계의 훈련 방식을 거쳐 학습되었습니다. 통합 모델 중에서는 최첨단의 결과를 달성했고, 작업 간의 충돌은 최소화하고 강력한 스케일링 성능을 보여줍니다. 특히 300억 파라미터 사이즈의 버전은 텍스트가 풍부한 VQA(시각 질문 답변)에서 이전 모델들을 능가하고, 생성 능력(GenEval: 1.00, WISE: 0.54)에서도 경쟁력 있는 결과를 보였습니다. —> [논문 보기]

멀티모달, 비전 및 영상 이해, 추론

🌟🌟 Video models are zero-shot learners and reasoners (Google DeepMind) – 일반적인 비디오 모델에서 제로샷(Zero-shot) 지각 및 조작 능력이 나타난다는 걸 보여줍니다. 학습을 하지 않은 작업에서도 AI가 스스로 인식하고 행동할 수 있음을 보여주는 논문입니다. —> [논문 보기]

🌟MetaEmbed: Scaling Multimodal Retrieval at Test-Time with Flexible Late Interaction (Meta) – 메타 토큰을 추가하고 추론 시에 벡터를 스케일링해서 정확도와 비용의 균형을 맞추고, 이렇게 해서 멀티모달 검색의 효율성을 높입니다. —> [논문 보기]

🌟 MMR1: Enhancing Multimodal Reasoning with Variance-Aware Sampling and Open Resources – 긴 CoT(Chain-of-Thought) 데이터를 공개하고, 분산(Variance)이 높은 샘플을 선별해서 강화 학습(RL)의 안정성을 높입니다. 이 기법으로 멀티모달 추론 능력을 강화할 수 있습니다. —> [논문 보기]

이론 및 평가

🌟 Behind RoPE: How Does Causal Mask Encode Positional Information? (KAIST, Microsoft) – 인과 마스킹(Causal Masking) 자체가 어떻게 포지션 의존적인 어텐션(Attention)을 유도하고, RoPE(Rotary Positional Embedding)와 상호작용해서 상대적인 패턴을 왜곡하는지 밝힙니다. LLM의 내부 작동 방식에 대한 깊은 이해를 할 수 있게 하기 위한 논문입니다. —> [논문 보기]

🌟 What Characterizes Effective Reasoning? Revisiting Length, Review, and Structure of CoT (Meta) – CoT(Chain-of-Thought)의 길이 또는 검토보다 '실패 단계 비율(Failed-step Fraction)'이 더 좋은 추론 예측 변수임을 확인합니다. 또, 구조를 인식하는 테스트 시간 스케일링(Test-time Scaling)의 유효성을 검증합니다. —> [논문 보기]

트레이닝 및 최적화 (사전 훈련, RL, CoT)

🌟 Thinking Augmented Pre-training (Mictosoft) – 합성한 사고 궤적(Synthetic Thinking Trajectories)으로 사전 학습 텍스트를 증강해서 데이터 효율성 및 다운스트림 추론을 향상시킵니다. —> [논문 보기]

🌟 Soft Tokens, Hard Truths (Meta) – RL을 통해서 연속적인 사고의 연쇄(Continuous Chain-of-Thought)를 훈련해서, 이산 토큰으로 배포하면서도 CoT 다양성을 높이게 해 줍니다. —> [논문 보기]

🌟 Reinforcement Learning on Pre-Training Data (Tencent) – 사람이 작업한 레이블 없이 사전 학습 코퍼스(Corpora)의 다음 세그먼트 예측으로부터 직접 보상을 도출해서 RL을 대규모로 확장할 수 있게 해 줍니다. —> [논문 보기]

🌟 VCRL: Variance-based Curriculum Reinforcement Learning for Large Language Models (Alibaba) – 정보성 높은 보상 분산(Reward Variance)을 가진 샘플을 선택해서 커리큘럼 훈련(Curriculum Train)을 수행함으로써 수학적 추론을 개선합니다. —> [논문 보기]

🌟 Thinking While Listening: Simple Test Time Scaling For Audio Classification (Stanford) – 추론 시 경량 추론(Lightweight Reasoning) 및 샘플링(Sampling)을 추가해서 오디오 분류의 정확도를 향상시킵니다. —> [논문 보기]

🌟 CAR-Flow: Condition-Aware Reparameterization Aligns Source and Target for Better Flow Matching (Apple) – 조건을 인식하는 변화(Condition-aware Shifts)를 통해서 확률 경로를 단축시켜, 훈련 속도를 높이고 FID(Fréchet Inception Distance) 점수를 개선합니다. —> [논문 보기]

에이전트, 환경 및 플래닝

🌟 ARE: Scaling Up Agent Environments and Evaluations (Meta) – 비동기적이고, 도구도 풍부하고, 다이나믹한 작업 환경에서 에이전트의 능력을 극한으로 테스트할 수 있는 플랫폼과 Gaia2 벤치마크를 제공합니다. —> [논문 보기]

UserRL: Training Interactive User-Centric Agent via Reinforcement Learning – 시뮬레이션된 사용자와 보상 설계를 통해서 멀티턴 대화에서의 유용성을 높이는 에이전트를 훈련합니다. —> [논문 보기]

BTL-UI: Blink-Think-Link Reasoning Model for GUI Agent – GUI 자동화를 위해 인간의 시각적 주의(Visual Attention), 인지(Cognition), 행동(Action)을 모방하고, 과정 및 결과 보상(Process-and-Outcome Rewards)을 활용합니다. —> [논문 보기]

LIMI: Less is More for Agency – 신중하게 선별된 소규모 데이터셋이 대규모 컬렉션보다 강력한 에이전트 기술을 더 효율적으로 이끌어낼 수 있다는 것을 보여줍니다.

—> [논문 보기]

읽어주셔서 감사합니다. 프리미엄 구독자가 되어주시면 튜링 포스트 코리아의 제작에 큰 도움이 됩니다!