들어가며

‘AI 에이전트’ 시리즈의 지난 에피소드에서는, 사람의 사고 방식을 28가지로 분류해서 과연 생성형 AI가 추론을 한다는게 어떤 뜻인지 생각해 봤습니다.

오늘 에피소드에서는, ‘추론(Reasoning)’, 그리고 ‘계획(Planning)’ 이 두 가지에 대해 생각해 봅니다. 어떤 작업을 할 때, ‘추론’만으로 부족할 때가 많이 있죠. AI가 목표를 달성하려면, 그냥 단순히 추론을 한다고 되는 것이 아니라 그 추론을 어떻게 적용할지 계획을 세워야 합니다. 다시 말해서, ‘계획’은 ‘추론’의 과정에 구조와 순서, 그리고 목표, 방향을 제공하는 행위입니다. 계획이 없이는, 아무리 지능적인 모델이라도 복잡한 작업을 할 때 불완전한, 그리고 체계 없이 랜덤하게 만들어진 답변을 내놓을 수 있겠죠.

거대 언어모델 (LLM)은 그 내부의 메커니즘으로 - 예를 들면, 계획을 시뮬레이션하는 프롬프트 기법으로 -, 또는 외부와 연동해서 - 예를 들면, 전용의 ‘계획’ 모듈을 사용하거나 Tool API와 연결하거나 - ‘계획’이라는 메커니즘과 연동 (Integration)을 하기 시작했습니다. 이렇게 해서 ‘문제가 주어졌을 때, 추론을 할 수 있고 그 추론의 단계를 따라가면서 체계적인 방식으로 행동’하는 AI 에이전트가 탄생하는 것이죠 - 마치 ‘사고’와 ‘행동’을 함께 하는 사람처럼 말이죠. 이 조합은, 개인 비서든, 아니면 자율형 로봇이든, 다양한 실제 세계 어플리케이션의 기초가 됩니다.

이 ‘계획’과 ‘추론’이 함께 하게 되는 여정을, DeepSeek이 자사 모델의 ‘추론’ 능력을 향상시키기 위해서 어떤 작업과 어떤 노력을 했는지 사례를 포함해서 한 번 살펴보겠습니다. ‘계획’과 ‘추론’이 빠르게 발전한다면, AI 에이전트와 시스템이 더 효과적으로 추론도 하고 더 높은 수준의 자율성, 그리고 정확성을 가지고 작업을 계획할 수도 있게 될 겁니다.

오늘 에피소드가 좀 길지만, 함께 재미있게 DeepSeek 추론 모델의 여정을 살펴볼까요?

오늘 에피소드에서는 다음과 같은 내용을 다룹니다:

*이 에피소드 전반적으로 ‘AI를 의인화’하는 표현이 종종 등장하게 되는 점을 미리 양해 부탁합니다. 그런 의인화된 표현은 아주 정확한 건 아님을 먼저 말씀드리고, 전체적으로 따옴표로 묶였다고 생각해 주세요.

‘추론’에 대한 접근 방법의 간략한 역사

아주 초기에 이뤄진 AI 연구에서 ‘추론’은 기계 지능의 ‘핵심’이었습니다.

불행하게도, 그 이후 수십년 동안, ‘추론’을 기계의 영역에서 확장하는 건 도대체 해결할 수가 없는 과제였죠. 1950년대부터 1980년대 후반까지, Symbolic AI 영역에서 ‘논리’, ‘규칙’을 명시적으로 코딩해서 ‘정리 증명 (Theorem Proving)’과 ‘의학적인 진단 (Medical Diagnosis)’을 할 수 있는 시스템을 만드는 정도였는데, 이런 시스템은 실제 우리가 살아가는 세상의 ‘모호함’을 다루는 것도, 변화하는 상황에 ‘적응’하는 것도 잘 해 내지 못했습니다.

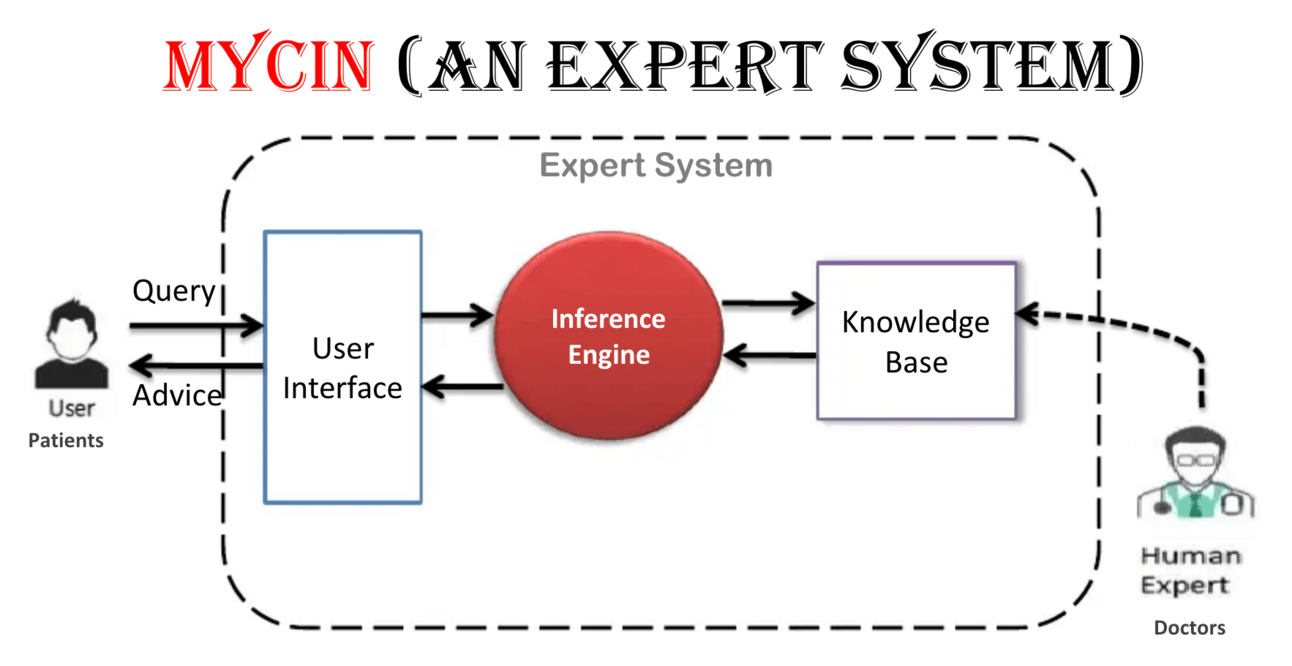

그 다음으로 등장한 것이 ‘전문가 시스템’이죠. 전문가 시스템은 ‘의학 진단 (MYCIN)’이라든가 ‘마이크로컴퓨터 세팅 (XCON)’ 같은 제한된 영역에서는 쓸만했지만, 여전히 매뉴얼로 만든 규칙에 의존해야 하고, 새로운 상황에 닥치면 적응할 수가 없었습니다.

MYCIN (1972-80) 은 감염성 질병을 진단하고, 항생제를 처방하고, 그 추론을 자세히 설명할 수 있는 대화형 프로그램. 제한된 테스트에서는 그 성능이 전문의 수준과 같았다고 함. Image Credit: Cognitive Science

이후, 1990년대까지는, 대부분의 AI 연구자들이 ‘패턴 인식을 잘 하는 기계학습, 그리고 통계적 방법’으로 전환을 했는데, 한 때 더 어려운 문제라고 여겨졌던 ‘시각’이라든가 ‘음성’ 영역의 문제들은 신경망을 활용해서 발전을 이뤘지만, ‘추상적인 추론’이나 ‘상식’ 문제는 여전히 직접적으로 해결할 수 없었습니다. 이 시대에 소위 말하는 ‘모라벡의 역설 (Moravec’s Paradox)’이 확실하게 부각되었죠: 체스를 둔다거나, 방정식을 푼다거나 하는 등의 ‘형식적인 추론’이 중요한 작업은 컴퓨터의 관점에서는 사람이 늘상 하는 ‘일상적 추론’보다 훨씬 더 쉬운 거였습니다. 전통적인 ‘높은 수준의 추론’ 작업은 종종 ‘컴퓨팅 파워 자체’로 돌파할 수 있었지만 - 예를 들어, 딥 블루는 수백만 개의 수를 탐색해서 체스 대결에서 사람을 이겼죠 - 어린 아이가 너무나 자연스럽게 하는 ‘지식 기반의 추론’을 기계가 복제하도록 하는 건 훨씬 더 어려웠습니다.

이 오랜 기간 중에, AI는 여러 차례의 ‘겨울’을 겪었고 - 대부분 ‘네 번의 겨울’이라는데 동의하고 있는 것 같은데요 -, 특히 Symbolic AI 연구는 큰 타격을 받았습니다. 그럼에도 불구하고, 초기 ‘Symbolic Reasoning’을 위한 노력은 추론 작업 자체에 대한 중요한 기초를 마련했고, 바로 지금, Neuro-Symbolic AI라든가 RAG (Retrieval-Augmented Generation) 같은 하이브리드 접근법을 통해서 재등장하고 있습니다. 이런 기법들은, 규칙 기반의 추론을 현대적인 데이터 기반 기술과 결합해서 문제 해결을 시도합니다.

‘AI의 추론’에 대한 이해

‘추론’과 ‘사고의 모드’에 대한 좀 더 자세한 정의와 여러 가지 이야기는 이전 에피소드를 한 번 참고해 보시면 좋겠구요:

간단하게 말해서, ‘AI 추론’이라는 건 ‘사실, 규칙 또는 증거 등에 기반해서 결론을 도출’하는 행위라고 할 수 있겠습니다. 보통 이야기하는 ‘추론’에는 아래와 같은 것들이 많이 언급됩니다:

연역적 사고 (Deductive Thinking)

일반적인 규칙을 특정한 사례에 적용하는 것.

예: "모든 새는 날개가 있다; 참새는 새니까, 날개가 있다"귀납적 사고 (Inductive Thinking)

예시로부터 일반적인 패턴을 유추해 내는 것.가설적 사고 (Abductive Thinking):

불완전한 데이터를 바탕으로 합리적으로 유추하는, 즉 Educated Guess를 하는 것. 의학에서의 증상 진단 같은 방식.확률적 사고 (Probabilistic Thinking)

베이지안 추론의 경우처럼, 확률로서 불확실성에 대응하는 사고 방식

LLM이 적어도 아직까지는 사람처럼 ‘추론 (Reason)’하는 건 아니지만, 적절한 프롬프트를 활용한다면 결과적으로 (일정한 특성을 가지는) ‘추론’ 능력을 잘 발휘하는 상태에 와 있습니다.

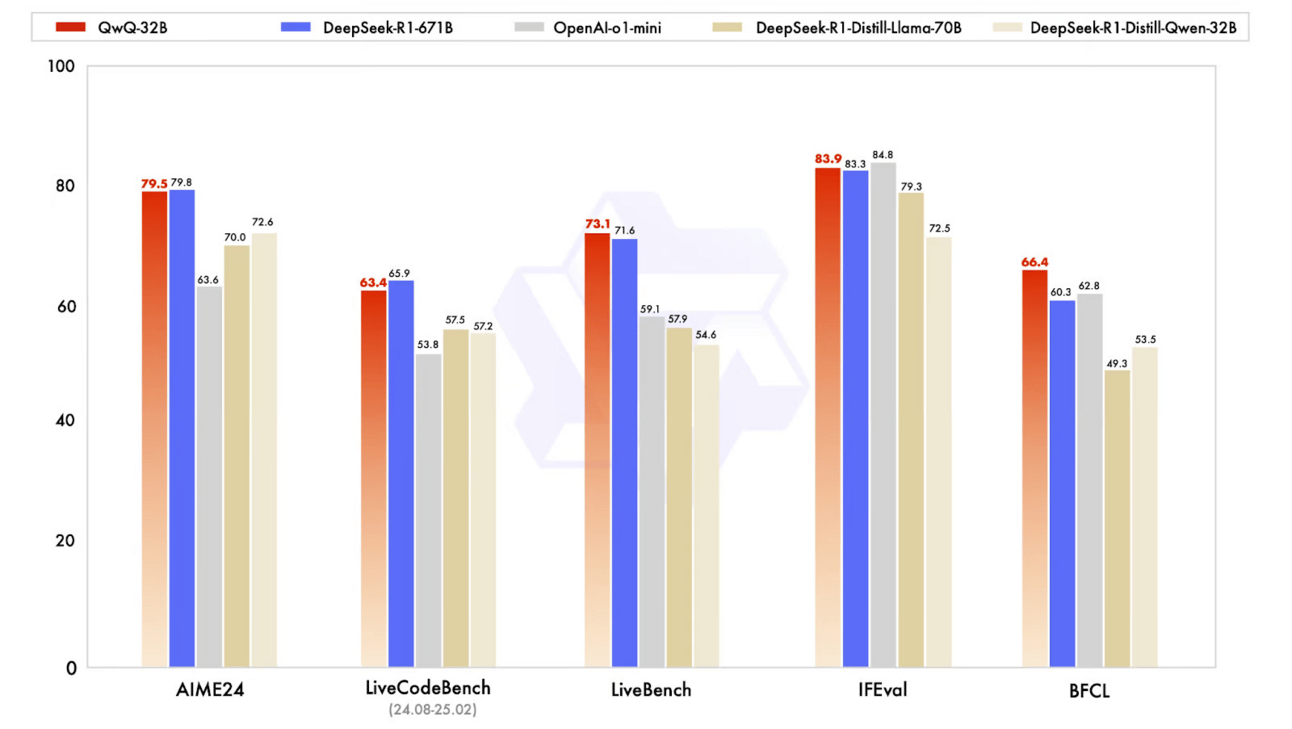

사실 지난 수 년간 순수한 딥러닝 모델은 고도의 추론은 하기 힘들다는 생각이 지배적이었다가, 최근의 획기적인 발전 때문에 많은 사람들의 생각이 바뀌고 있죠. 오픈AI의 o1, o3, DeepSeek R1, 그리고 그저께 알리바바에서 공개한 QwQ-32B 같은 모델까지, 많은 모델이 인상적인 추론 능력을 보여주고 있는 만큼, 지금 그 무엇보다 뜨거운 주제가 되어 있습니다.

주요 추론 모델의 성능 비교. Image Credit: Qwen

이런 진전을 이끌어낸 혁신적인 기법이라든가 연구가 어떤게 있을까요? 한 번 살펴보겠습니다.

추론 분야를 발전시킨 최근의 돌파구

CoT(Chain-of-Thought) 프롬프팅

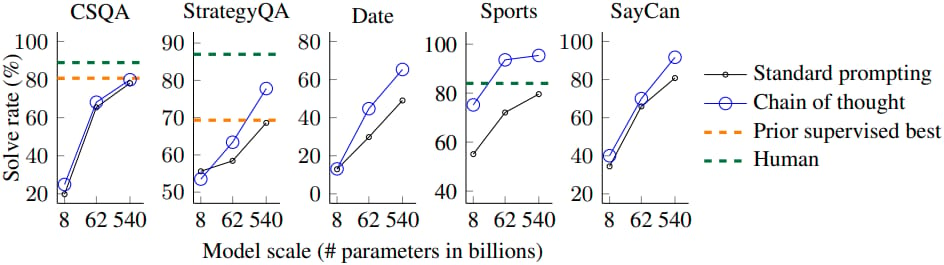

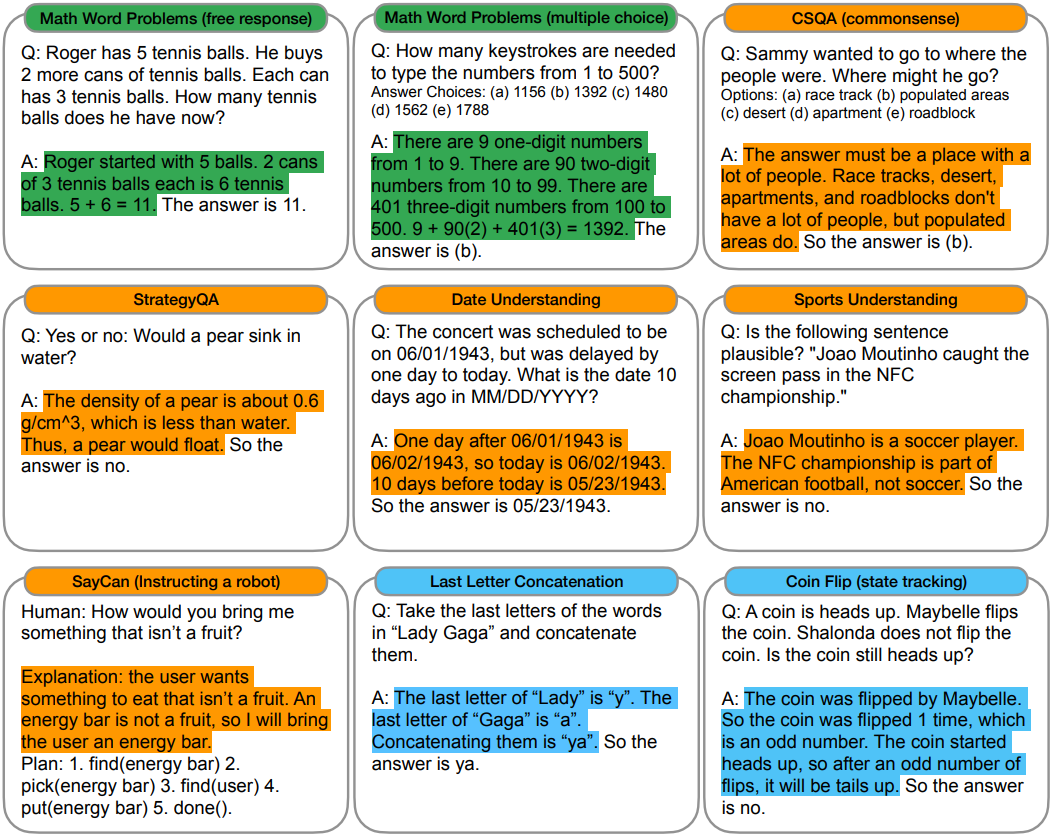

AI 모델의 ‘추론 능력 발전’과 관련된 중요한 하나의 돌파구는 바로 CoT (Chain-of-Thought) 프롬프팅입니다. CoT를 사용해서, 모델이 최종적인 답변을 제공하기 전에 중간의 추론 단계를 생성하도록 가이드하는 거죠 - 마치, 문제 풀이 과정을 보여주듯이요. 예를 들어, 복잡한 수학 문제를 놓고 모델이 먼저 논리적인 단계와 필요한 연산을 설명하는 겁니다.

이 CoT 프롬프팅 기법을 적용하면, 다단계의 추론이 필요한 작업의 경우에 성능이 크게 향상됩니다. 실험 결과에 따르면, CoT 프롬프팅은 거대 언어모델이 복잡한 산술, 상식, 기호적 추론 작업을 할 때 직접 바로 답변을 제공하는 경우보다 훨씬 더 높은 성능을 나타낼 수 있게 해 줍니다.

모델 크기에 따른 상식적 추론 성능. CoT 프롬프팅의 성능이 우수하네요.

Image Credit: 논문 ‘Chain-of-Thought Prompting Elicits Reasoning in Large Language Models’

사실 “이걸 단계별로 잘 생각해보자”는게 핵심인 이 CoT 프롬프팅은, 모델이 문제를 잘게 나눠 차례대로 생각하게 해서, 오류를 줄일 뿐 아니라 추론의 과정을 이해할 수도 있게 해 줍니다.

산술적, 상식적, 기호적 추론의 Triplet (입력, CoT, 출력) 예시.

Image Credit: 논문 ‘Chain-of-Thought Prompting Elicits Reasoning in Large Language Models’

가만히 생각해 보면요, 상당히 놀라운 발견입니다. 모델을 ‘추론하게끔’ 훈련을 하지 않더라도, 프롬프트만으로 훈련 중에 학습된, 나름의 ‘잠재적인 능력’을 이끌어내는 건가 하고 생각하게 되니까요. ‘CoT 프롬프팅’ 기법도 계속해서 확장되고 발전하면서, 지금은 Math Problem Solver에서부터 논리적인 퍼즐을 푸는 것까지, LLM을 사용하는 고급 기법을 발전하고 있고, 프롬프트의 구체적인 형식과 기법에 따라 다양하면서도 더 발전된 ‘추론 능력’을 이끌어낼 수 있다는 걸 보여주고 있습니다.

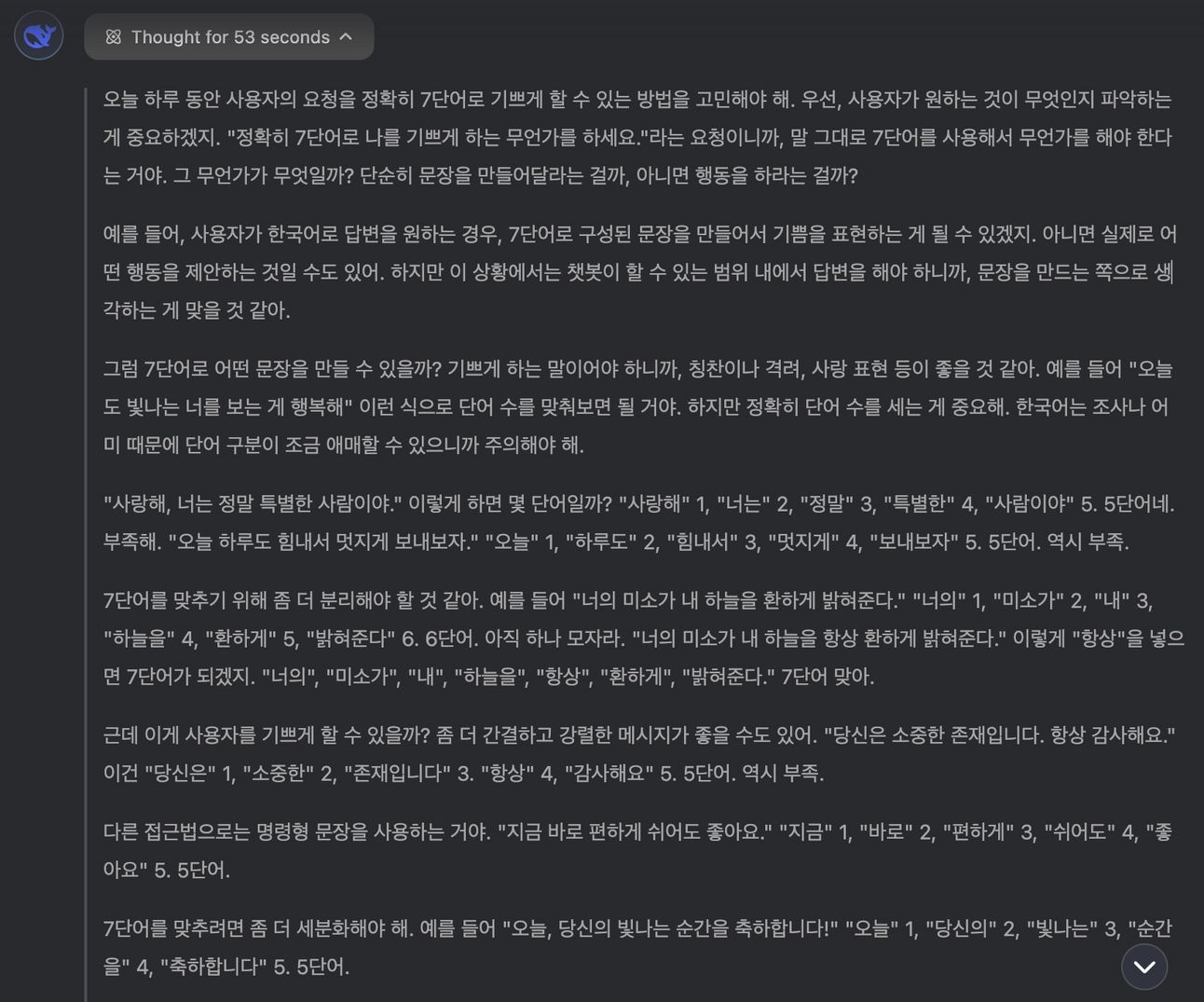

DeepSeek의 추론 모델인 R1도 꽤 놀라우면서도 재미있는 CoT 과정을 보여주죠. 아래는 쓰레드의 choi.openai 유저가 포스팅한 ‘DeepSeek R1의 CoT 예시 화면’입니다.

마치 사람이 이야기하면서 생각하는 듯한 DeepSeek R1의 CoT. Image Credit: 쓰레드, choi.openai

자기 반성 (Self-Reflection)과 자기 일관성 (Self-Consistency)

AI 연구자들이 당연히 “CoT가 잘 되는구나” 하면서 실험을 멈추지는 않았겠죠? CoT를 기반으로 해서, LLM이 자기가 만들어 낸 ‘추론’을 반성하거나 개선할 수 있는 기법들을 만들어냈습니다. ^.^

그런 것들 중에 하나가, ‘자기 일관성 디코딩 (Self-Consistency Decoding)’입니다. 한 가지 경로의 CoT를 믿고 의지하는게 아니라, 모델이 여러 개의 서로 다른 ‘추론 경로’를 만들고 - 가능성있는 다양한 체인을 샘플링해서요 - 그 중에서 어떤 답변이 가장 일관성이 있는지 평가합니다. 예를 들어, 모델이 어떤 퍼즐을 풀 때 다섯 가지의 해결 경로를 만들고, 어떤 답변이 가장 자주 나타나는지 확인해서 ‘다수결’로 생성할 답변을 선택하는 겁니다. 이렇게 하면 ‘혹시 운이 나빠서 잘못된 추론 경로가 만들어져서 잘못된 답변으로 이어질’ 가능성을 줄여줄 수 있겠죠.

‘자기 일관성’ 기법을 활용하는 Few-Shot 예시.

Image Credit: 프롬프트 엔지니어링 가이드, ‘Self-Consistency’

‘자기 반성 (Self-Reflection)’이란 건 ‘모델이 스스로 만든 답변을 비판하고 확인하게 하는 것’입니다. 초기 답변을 만든 다음, LLM이 단계별로 해결책에 오류가 있는지 - 마치 선생님처럼요 - 검토하고, 오류가 있다면 수정을 해 보는 거죠. 이런 ‘반성-개선’의 흐름을 반복하게 되면, 수학 문제풀이나 코딩 같은 업무의 성능을 향상시키는 걸로 나타났습니다.

이런 기법은 일종의 ‘메타 추론 (Meta-Reasoning)’ 기법이라고 할 수도 있겠는데, LLM이 스스로 한 작업을 이중으로 확인할 수 있는 사람처럼 행동하게 합니다.

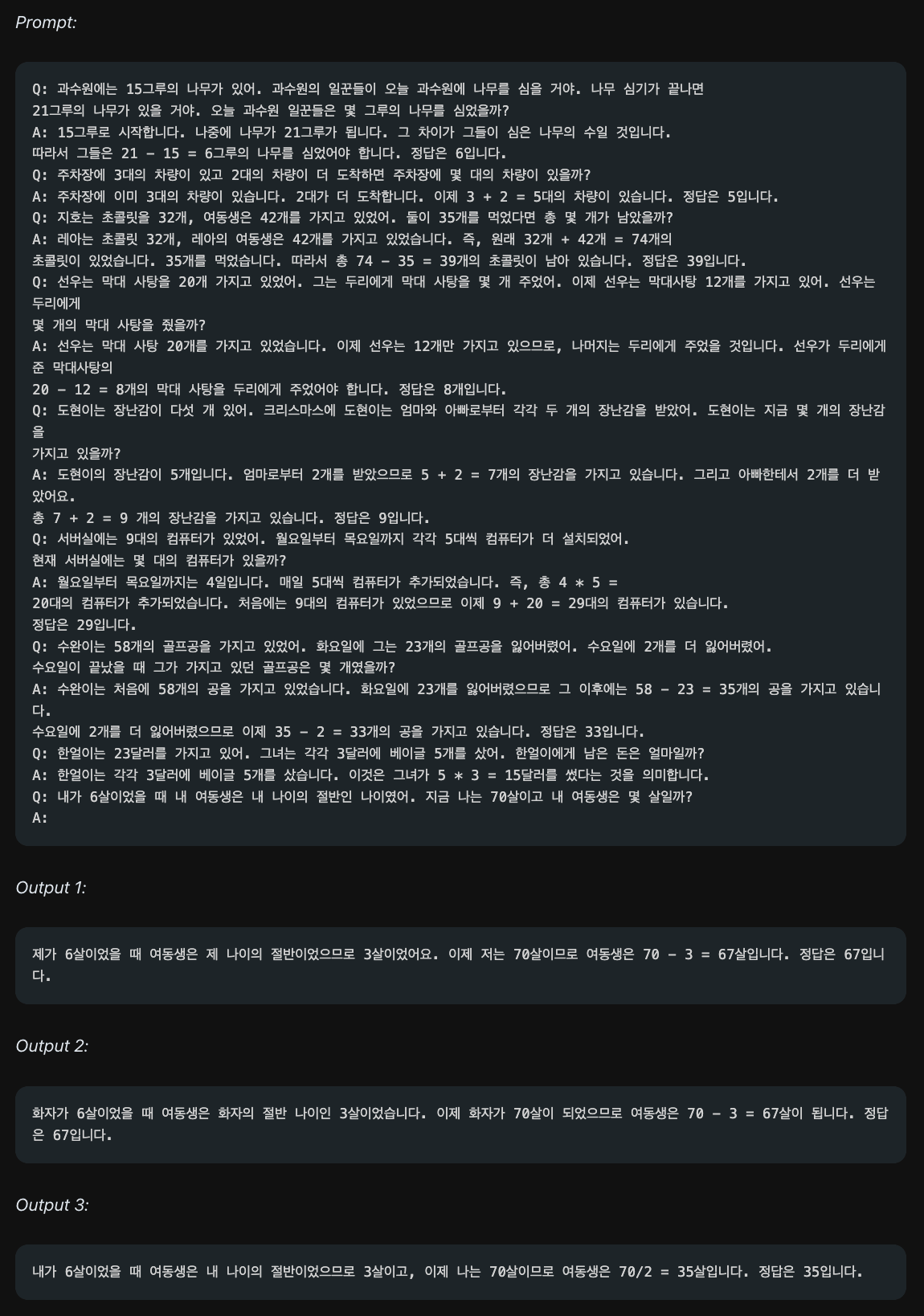

Few-Shot 및 In-Context Learning

거대한 AI 모델이 ‘In-Context’ - 즉 맥락 안에서 - 학습할 수 있다는 걸 발견하면서, AI 모델의 추론 능력이 한 단계 또 도약할 수 있었는데요. ‘Few-Shot 프롬프팅’ 기법으로, 우리가 원하는 작업의 예시 몇 가지 (예시의 추론 과정을 포함해서)를 제공해 주면, 모델이 파라미터를 업데이트 하지 않고도 - 즉, 다시 훈련을 하지 않고서도 - 새로운 질문이 주어졌을 때 적절하게 추론을 합니다 (‘일반화’ - Generalization - 를 하는 거죠)

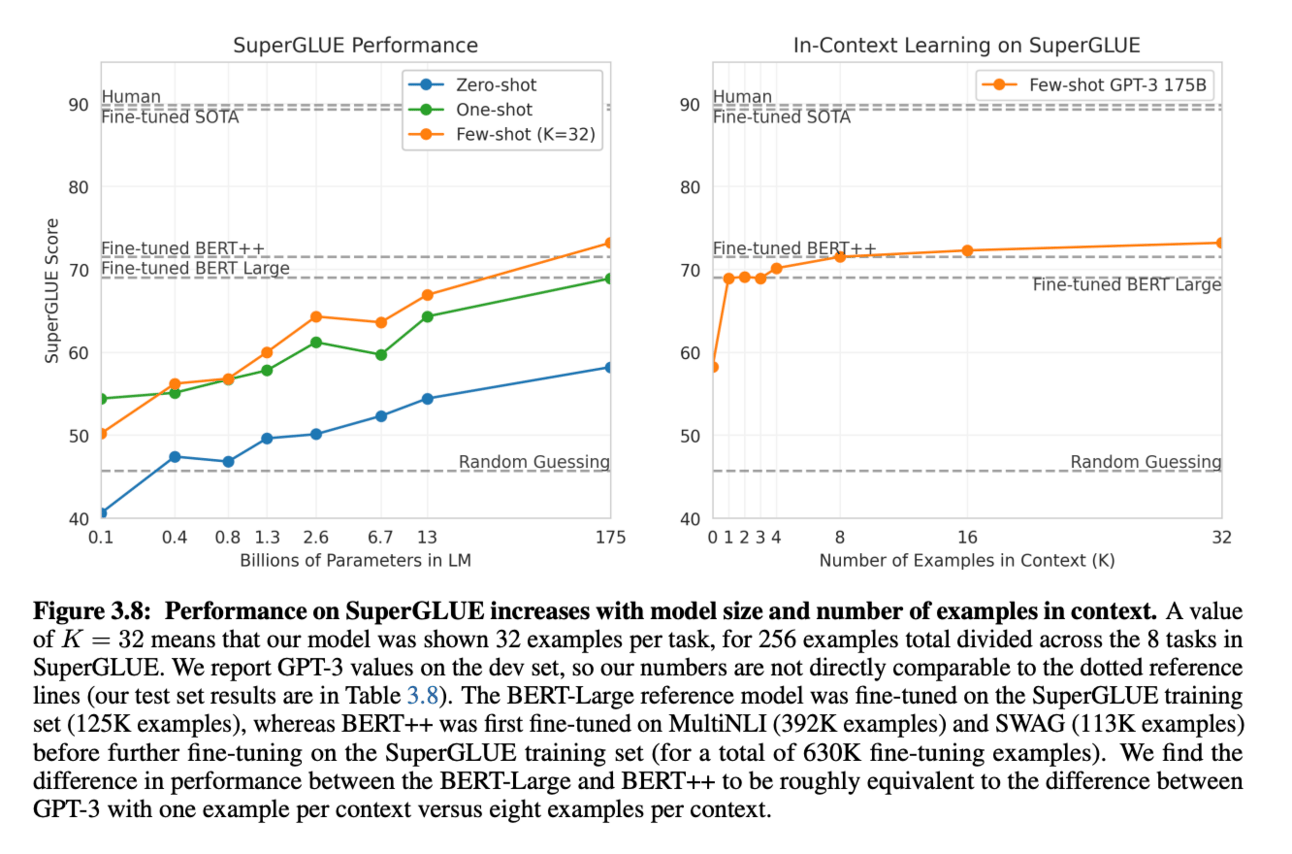

‘Language Models are Few-Shot Learners’라는 획기적인 GPT-3 논문에서, 약 1,000억 개 이상의 파라미터를 가진, 충분히 큰 모델은, 예시만 보여줘도 이전에 훈련되지 않은 새로운 작업을 수행할 수 있다는 걸 보여줬습니다. 다시 말해서, 입력 프롬프트에서 ‘논리적인 사고 과정’의 몇 가지 예시를 모델에 보여주면, 모델이 거기서 패턴을 파악하고 적용한다는 겁니다. 일종의 ‘메타 학습’이죠?

Image Credit: 논문 ‘Language Models are Few-Shot Learners’

모델이 보여주는 이런 능력 때문에, LLM을 ‘Foundation Model’이라고 부르기도 하는 거죠 - 맥락에 따라서, 조건을 몇 가지 설정하는 것만 해도 ‘복잡한 추론이 필요한 작업 뿐 아니라 많은 다양한 작업을 할 수 있게’ 되니까요.

뉴로-심볼릭 (Neuro-Symbolic) 접근 방법

좀 더 최근 연구의 중요한 추세 중 하나가, ‘신경망과 결합한 상징적인 추론 요소의 부활’입니다. 흔히 이걸 ‘뉴로-심볼릭’ AI라고 하죠. 보통 (논리 기반의) ‘심볼릭’한 접근 방법, 그리고 ‘신경망 기반’의 접근 방법이 서로 대립되는 것으로 보는 경우가 많았는데요. 최근에는 각각의 장점을 활용하면서 둘을 통합하는 방법을 찾는 연구자들이 많습니다.

당연히, 현대적인 LLM은 이 조합에서 ‘신경망’ 부분을 담당하는 거죠 - 패턴 인식을 유연하게 하고, 언어를 날 것 그대로 이해하고, 데이터에서 학습한 지식을 갖고 있는 부분이요. ‘심볼릭’한 구성 요소는, 논리적인 일관성과 사실적인 기반을 강화하는 ‘규칙’, 그리고 이산적인 (Discrete) ‘계획 알고리즘’, ‘지식 그래프’ 등을 통합하는 부분이구요. 일종의 ‘하이브리드’ 접근이라고 볼 수 있는데, 결국은 ‘더 신뢰할 수 있는 추론’을 하게 해 보자는 게 목표겠죠.

두 가지를 통합하는 하나의 예를 들어볼까요?

*무료 구독자들께서 보실 수 있는 내용은 여기까지입니다. AI 에이전트의 에피소드는 프리미엄 구독자들께 전체 내용이 공개됩니다. 프리미엄 플랜으로 업그레이드하시면 이 에피소드 전체를 포함해서 튜링 포스트 코리아의 모든 컨텐츠를 제한없이 보실 수 있습니다!

튜링 포스트 코리아의 인사이트가 담긴 컨텐츠를 마음껏 읽어보세요!

프리미엄 플랜으로 업그레이드하시면 튜링 포스트 코리아의 모든 컨텐츠를 제한없이 보실 수 있습니다. 프리미엄 구독자가 되어 주시면 튜링 포스트 코리아의 컨텐츠 제작에 큰 도움이 됩니다. 감사합니다!

주간 AI 뉴스레터

AI 유니콘 기업들에 대한 심층 분석 기사

AI 기술, 산업, 정책 전문가 인터뷰

AI 기술 및 산업에 대한 심층 분석 시리즈

분석 기사 요청 및 튜링 포스트 코리아 기고

읽어주셔서 감사합니다. 친구와 동료 분들에게도 뉴스레터 추천해 주세요!